搜索

搜索

火,Agent可太火了!关于Agent的进展俯拾皆是,根本看不过来……

看过来——这篇综述可能能帮你厘清很多问题:

来自华东师大和东华大学的研究团队发表了“A Survey on the Optimization of Large Language Model-based Agents(大模型智能体的优化方法综述)”,首次从系统化视角对LLM智能体优化策略进行了全面梳理与分析。

论文将将现有方法划分为两大类:参数驱动的优化与参数无关的优化。

前者包括基于监督微调、强化学习(如PPO、DPO)以及微调与RL结合的混合策略,重点讨论了轨迹数据构建、奖励函数设计、优化算法等关键模块。

后者则涉及通过Prompt工程、外部工具调用、知识检索等方式在不修改模型参数的前提下优化Agent行为。

除此之外,作者们还整理了主流的Agent微调与评估数据集,回顾了LLM Agent在医疗、科学、金融、编程等多个应用领域的代表性实践。

最后,研究团队总结了Agent当前面临的关键挑战与未来研究方向。

近年来,随着GPT-4、PaLM和DeepSeek等大型语言模型不仅在语言理解和生成上表现出色,更在推理、规划和复杂决策等方面展现出非凡的能力。

因此,越来越多的研究者开始尝试将LLM作为智能体来使用,探索其在自动决策和通用人工智能方向的潜力。

与传统的强化学习智能体不同,LLM智能体不依赖显式的奖励函数,而是通过自然语言指令、Prompt模板与上下文学习(ICL)完成复杂任务。

这种“文本驱动”的智能体范式展现出极高的灵活性与泛化能力,能够跨任务理解人类意图、执行多步骤操作,并在动态环境中做出决策。

当前,研究者已尝试通过任务分解、自我反思、记忆增强以及多智能体协作等方式提升其表现,应用场景涵盖软件开发、数学推理、具身智能、网页导航等多个领域。

值得注意的是,LLM本身的训练目标是预测下一个token,并非为长期规划和交互学习的Agent任务而生。

这也导致了LLM作为Agent的部分挑战:

尤其是开源LLM在agent任务中的表现普遍落后于GPT-4等闭源模型,而闭源模型的高成本与不透明性,也使得优化开源LLM以提升Agent能力成为当前研究的关键需求。

当前已有的综述要么聚焦于大模型优化本身,要么只讨论agent的局部能力(如规划、记忆或角色扮演),并未将“LLM智能体优化”作为一个独立且系统的研究方向进行深入探讨。

研究团队填补了这一空白,首次以“LLM-based Agent的优化技术”为核心议题展开系统综述,构建统一框架,归纳方法路径,并对比不同技术的优劣与适用情境。

在参数驱动的LLM优化中,作者将其分为3个方向。

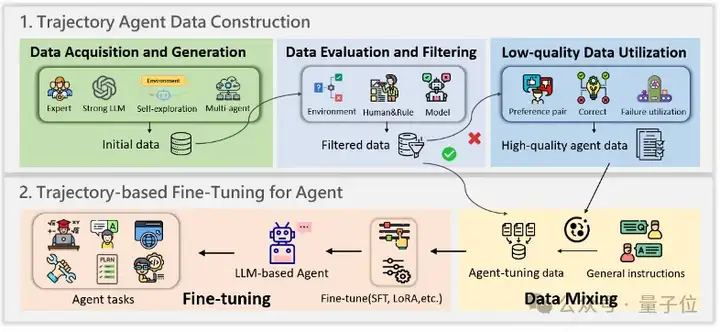

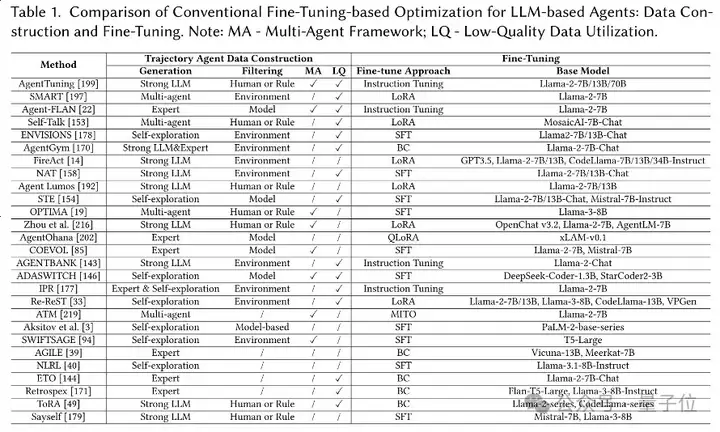

第一个方向,基于常规微调的优化。

又分为2大步骤:构建Agent任务的高质量轨迹数据——用轨迹微调Agent。

首先是数据获取与生成。

高质量的轨迹数据构建开始于初始数据的获取和生成,这不仅需要一组多样化的轨迹,还需要与目标任务充分对齐,以确保有效的学习。

作者将主流方法归纳为以下四类:

其次,数据的评估与过滤。

由于生成的轨迹数据质量参差不齐,对数据进行评估和筛选成为不可或缺的一步。

作者将主流方法归纳为三类:

接着是低质量样本的利用。

除了高质量的获取,对不合格的低质量轨迹也需要再次利用。

目前的主流策略包括:

完成高质量轨迹数据构建后,下一步就是关键的微调阶段。

通过微调,让开源大模型真正适应Agent任务,学会规划、推理与交互,是优化LLM智能体不可或缺的一步。

值得注意的是,仅用Agent任务轨迹微调可能会削弱LLM的通用能力。

因此,大多工作选择混合通用指令数据与Agent轨迹共同训练,以在保留语言基础能力的同时,提升Agent执行能力。

作者将现有的微调方法划分为三大类:

相比于传统的微调方式,强化学习为Agent带来了更具主动性的学习路径。

它让模型不再只是“模仿”,而是能在环境中探索行为、接受奖励与惩罚,动态调整策略,真正实现从试错中成长。

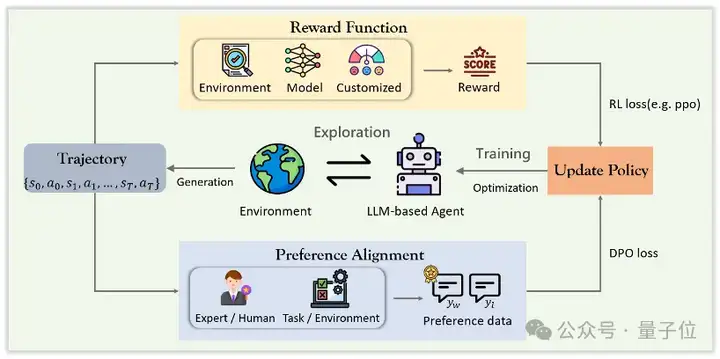

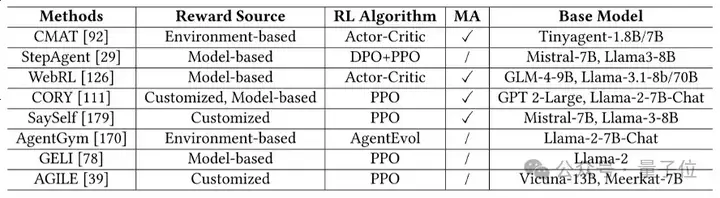

作者将当前RL优化方式分为:基于奖励函数的优化和基于偏好对齐的优化。

先说基于奖励函数的优化。

在强化学习优化中,奖励函数就像智能体的指挥棒,引导模型不断改进策略。通过设定清晰的“做得好 vs 做错了”标准,Agent可以从交互中学习得更精细、更稳健。

作者将当前方法按照三类奖励来源划分3类:

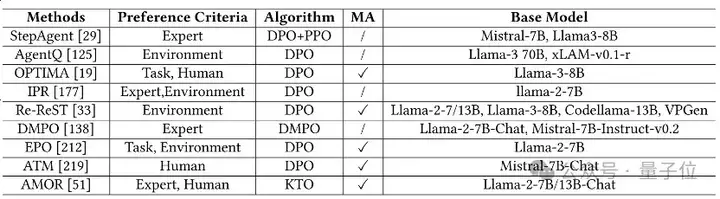

再来看基于偏好对齐的优化。

相比传统RL基于奖励函数的训练方式,偏好对齐提供了更直接、更轻量的优化路径。

它不再依赖繁琐的奖励建模,而是让Agent学会“哪种行为更受人类欢迎”。

其代表方法是DPO,一种更简单的离线强化学习方式,直接通过人类或专家的偏好对样本进行“正负对比”训练。

根据主要偏好数据来源,作者将其这类优化方法分为两类:

综合来看,偏好对齐方法训练高效、部署简单,但强依赖偏好数据质量与覆盖范围,适合结构明确、反馈清晰的任务场景。

而奖励函数类方法更适配复杂多变的环境,但成本更高。

单一的优化方法各有短板——常规微调稳定高效但缺乏动态应变能力,RL灵活强大却计算开销巨大。

于是,越来越多研究开始探索混合微调策略,结合两者优点,构建更强大的LLM智能体。

这类工作主要为:

第一,顺序式两阶段训练。

这也是是当前的主流方法,采取“先SFT、后RL”的思路。

第二,交替优化。

即引入迭代交替机制,在SFT和RL之间多轮来回切换,以实现细粒度提升。

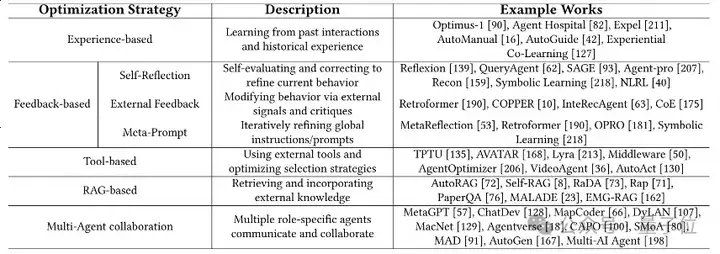

相比参数微调,参数无关的优化方法不涉及模型权重更新,而是通过调整Prompt、上下文和外部信息结构,在资源受限或轻量部署场景中展现出强大潜力。

作者将其分为五类核心策略:

第一类,基于经验的优化。

通过记忆模块或历史轨迹,让Agent“学会复盘”,从过去成功与失败中提炼策略,增强长期适应性。

第二类,基于反馈的优化。

Agent通过自我反思或外部评估不断修正行为,形成迭代闭环;还有方法通过元提示优化调整全局指令结构,提升泛化能力。

第三类,基于工具的优化。

让Agent学会使用工具(如搜索、计算器、API)以增强执行力。部分方法优化工具调用策略,部分则训练Agent构建更高效的任务-工具路径。

第四类,基于RAG的优化。

结合检索与生成,通过从数据库/知识库中实时获取信息增强推理过程,尤其适合知识密集型任务和变化快速的场景。

第五类,多Agent协作优化。

多个LLM Agent协同完成任务,通过角色分工、信息共享与反馈机制实现1+1>2的协同智能。

参数无关优化,让LLM Agent在不动模型的前提下,变得更“聪明”、更“适应”、也更“轻巧”。

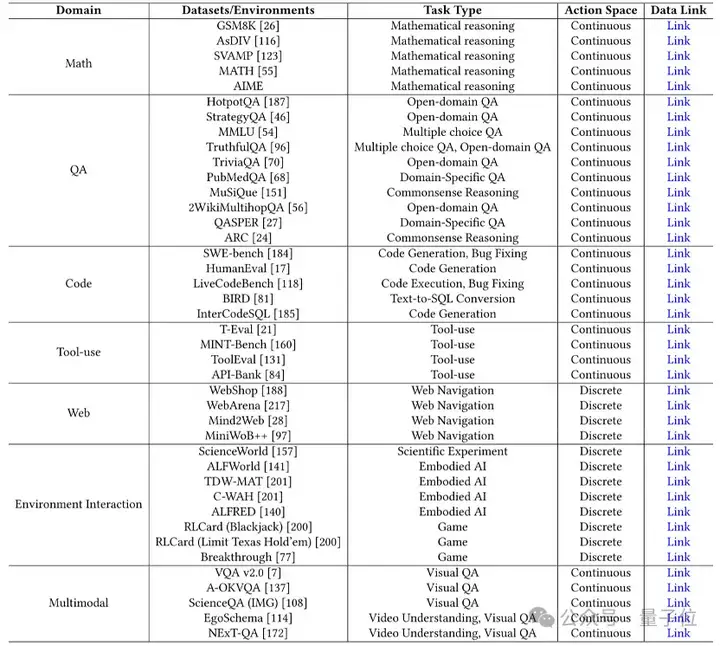

作者将数据和基准分为用于评估和微调的两个大类。

评估任务分为两类。

第一类,通用评估任务。

即按一般任务领域分类,如数学推理,问题推理(QA)任务,多模态任务,编程等。

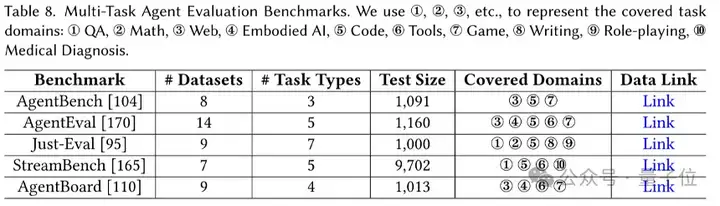

第二类,多任务评估基准。

跨各种任务评估基于LLM的智能体,测试它们概括和适应不同领域的能力。

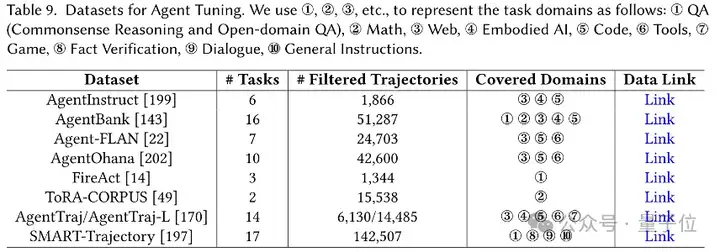

Agent微调数据集,则是针对Agent微调而精心设计的数据,以提高LLM Agent在不同任务和环境中的能力。

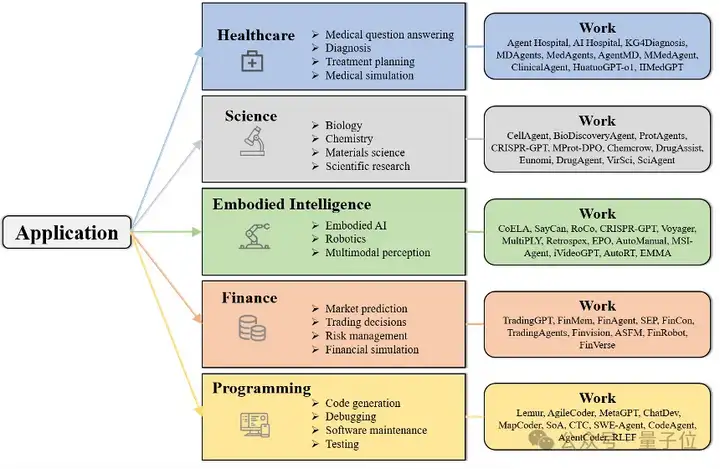

随着优化方法的不断成熟,基于LLM的智能体已在多个真实场景中崭露头角,逐渐从实验室走向实际应用:

数据偏差问题。

Agent高度依赖数据质量,然而预训练数据与微调轨迹分布不匹配,再加上LLM自身生成与评估带来的潜在偏差,易导致性能不稳定。

未来可探索偏差测试、对抗训练、知识边界评估等方法,构建更稳健的数据基础。

算法效率与适应性。

当前强化学习与微调方法在面对稀疏奖励、大动作空间、多步交互时存在成本高、效果差的问题。

如何提升DPO等轻量方法的多轮能力,或探索RL+SFT的混合训练、元学习、自监督方法,将是未来重点。

跨任务跨领域迁移难。

许多方法在单一任务上表现优秀,但在新环境或真实世界中易失效。

需要发展更强的泛化机制,如任务分布对齐、域适应、多任务联合训练等,提升模型迁移与适应能力。

缺乏统一评估标准。

Agent在不同任务(如数学推理、网页导航、具身AI)中使用不同指标,难以横向比较。

建立统一的评估基准,引入推理复杂度、适应性与偏好评分等新维度,将推动Agent研究向更系统、可比的方向发展。

参数驱动的多智能体优化缺失。

目前多智能体策略多依赖冻结LLM,缺乏联合参数训练机制,限制了协同智能的发展。

未来应探索多智能体联合微调、奖励共享机制、层级控制策略,提升整体系统能力与协作水平。

arXiv链接:

https://arxiv.org/abs/2503.12434

GitHub链接:

https://github.com/YoungDubbyDu/LLM-Agent-Optimization

文章来自于“量子位”,作者“华东师大&东华大学”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0