比Nano Banana还夯的生图模型泄露,截图不再是证据了 | 附提示词

比Nano Banana还夯的生图模型泄露,截图不再是证据了 | 附提示词4 月初,LM Arena 评测平台上出现了三个匿名图像模型,代号分别是 maskingtape-alpha、packingtape-alpha、gaffertape-alpha。几小时后它们消失了。OpenAI 官方还没有正式宣布这个模型,但根据 API 返回的元数据和用户侧的测试记录,它已经有了一个被广泛接受的名字:GPT Image 2。

4 月初,LM Arena 评测平台上出现了三个匿名图像模型,代号分别是 maskingtape-alpha、packingtape-alpha、gaffertape-alpha。几小时后它们消失了。OpenAI 官方还没有正式宣布这个模型,但根据 API 返回的元数据和用户侧的测试记录,它已经有了一个被广泛接受的名字:GPT Image 2。

超快速 AI 生图领域再破性能天花板!香港科技大学唐靖团队、香港科技大学(深圳分校)胡天阳、小红书 hi-lab 罗维俭提出全新通用强化学习框架 TDM-R1,精准破解超快速扩散生成的核心痛点 —— 仅需 4 步采样(4 NFE),便将组合式生成指标 GenEval 从 61% 飙升至 92%,

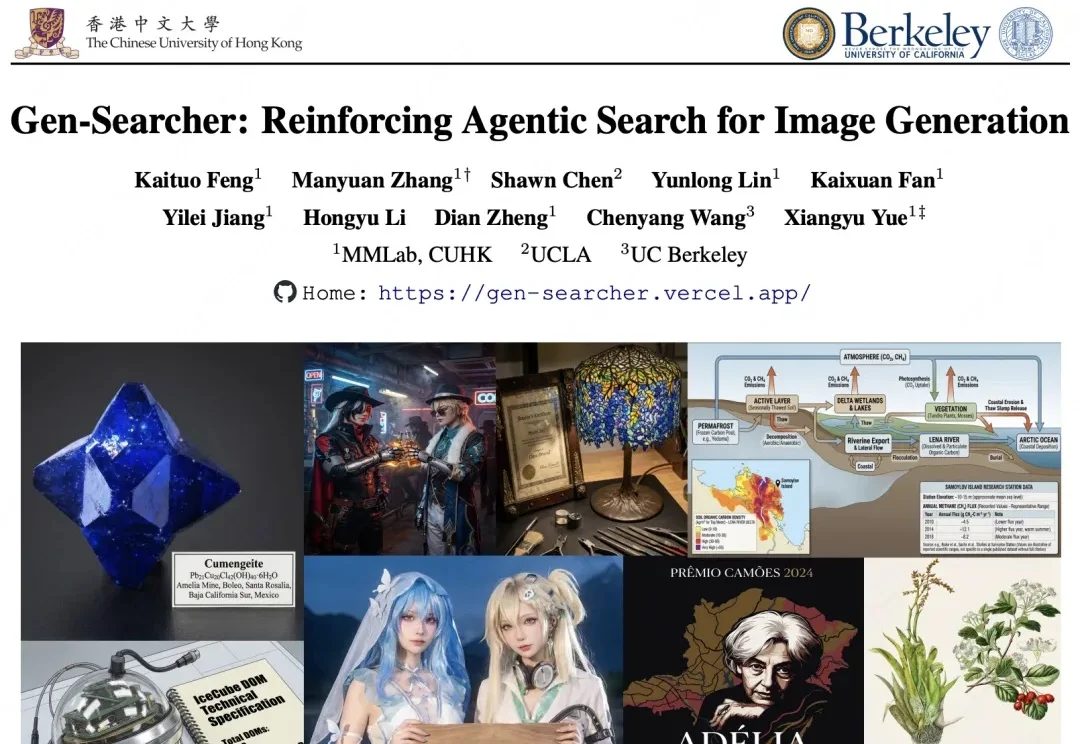

过去两年,图像生成模型在质感和审美上一路狂飙,但大多仍是 “直接出图” 的范式。

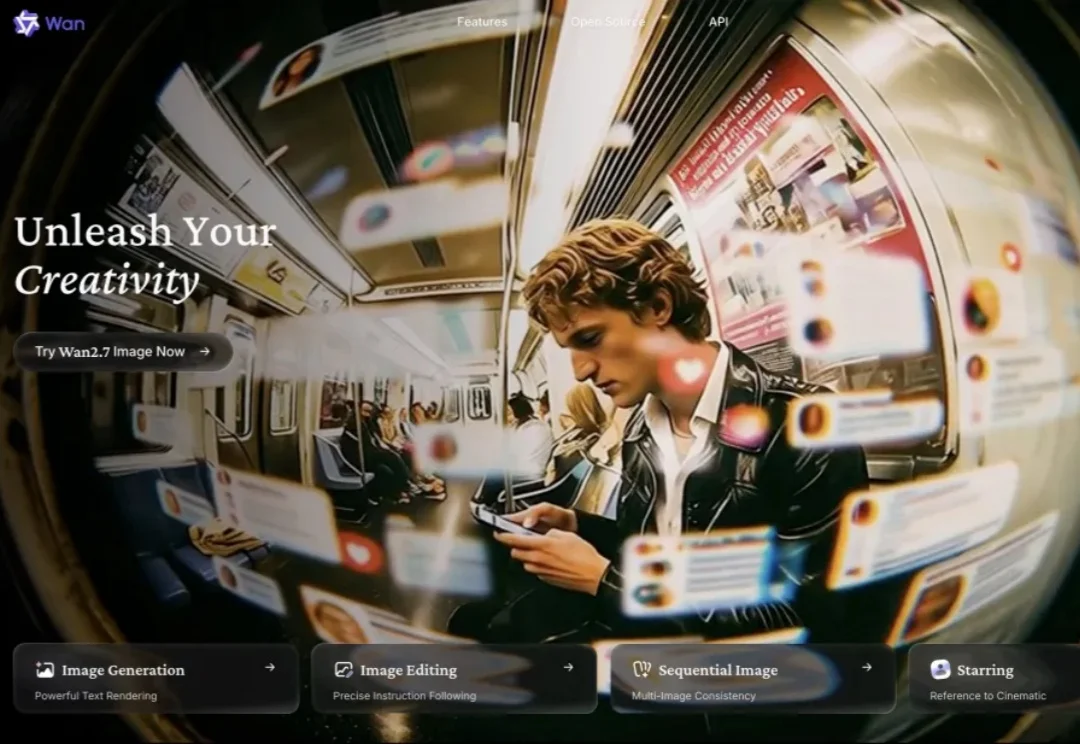

3月30日,阿里巴巴内部发布了 Wan2.7-Image 图像生成与编辑统一模型。根据官方公布的数据,在人类偏好盲测评分中,Wan2.7-Image 目前位列国内第一。从放出的评测雷达图来看,无论是文本生图(Text-to-Image)还是综合图像编辑(Image Editing),它的各项指标基本都盖过了市面上主流的几家头部模型。

龙虾终于会画图了!阿里Wan2.7-Image刚刚上线,捏脸到骨相级、首创「调色盘」、3K超长文本写满A4不崩,还能接入OpenClaw一句话出图。

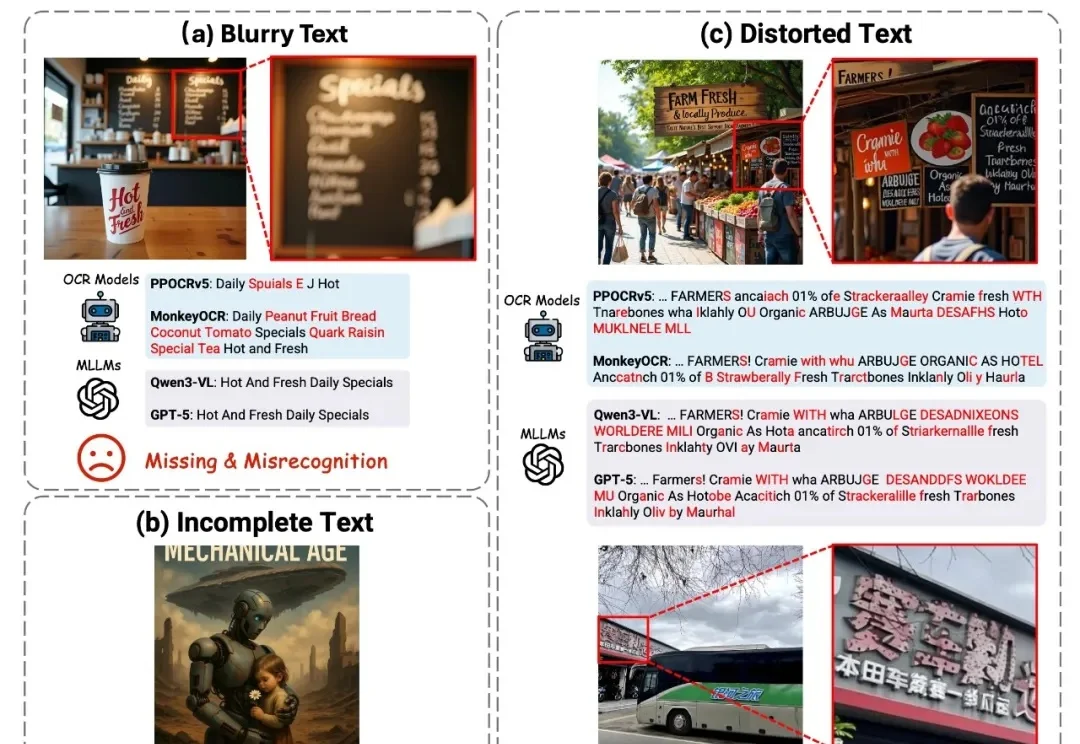

在生成式 AI 浪潮中,文生图技术已实现跨越式发展,在视觉呈现上达到了前所未有的高度。然而,在生成图像中准确合成拼写正确、结构规范且风格协调的文字 —— 视觉文本渲染(Visual Text Rendering, VTR),至今仍是该领域尚未攻克的核心难题。

嗨大家好!我是阿真! 前几天发过提示词生图相关的推文,大家普遍有个痛点,直接生成但是写提示词很痛苦,提示词调整来调整去,有点小问题又想再抽卡,最后时间浪费了,效果也一般般。

「2.0 比不上 1.0 Pro,真正的升级还得看 Nano Banana 2 Pro。」这是不少网友在昨天 Nano Banana 2 推出后,体验完的明显感受。一方面部分场景下的生成速度有所提升,还有文本渲染的表现也更稳定,但是图片的美学表现,却似乎还不如之前的 Pro 版本。

一周一更,谷歌又在深夜扔出「深水炸弹」。就在刚刚,最强生图模型Nano Banana 2横空出世,背靠全新Gemini 3.1 Flash Image。 它不仅生成速度飞快,多语言文字处理更强,还能实时联网,一次直出4K大片。

马上春节假期都结束了,不知道大家有没有人被家里催婚 😭 我这几天一直躺在屋里,为了躲避惨无人道的亲戚催婚,睡得昏天暗地,睡觉、刷抖音、刷 X、刷小红书、吃饭、睡觉,闭环了。 就在昨天,我日常刷抖音的时