AI歌手Yuri火爆全网,周杰伦们慌不慌?

AI歌手Yuri火爆全网,周杰伦们慌不慌?Yuri,出现在最适合她的时间。永不塌房的AI歌手,才是最值得追的明星?

Yuri,出现在最适合她的时间。永不塌房的AI歌手,才是最值得追的明星?

免费VS付费,2025 高考志愿怎么填?

《新智核》独家获悉,字节旗下Seed团队将招募多个机器人相关业务的一号位,包括机器人产品负责人、机器人工程技术负责人,以及具身智能大模型负责人。这一系列动作表明,Seed在机器人及具身智能领域加速布局的决心。

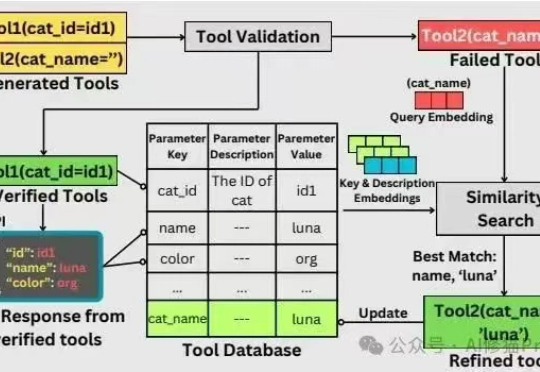

我想问您一个问题:上次为了让AI代理调用某个第三方API,您花了多长时间写包装代码?一天?三天?还是一周?不过现在,Brandeis大学的研究者们带来了一个让人眼前一亮的解决方案——Doc2Agent,它能从API文档直接生成可执行,MCP可调用的Python工具,而且成功率还挺不错。

Agent 成为新一轮创新叙事的中心坐标。在技术边界不断推进的同时,一个显著的变化也在悄然发生:AI 创业从「拼技术」进入到「拼交付」时代。

让AI编程助手成为更可靠的开发伙伴

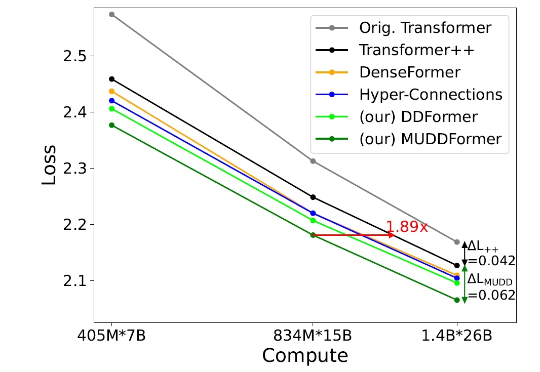

但在当今的深度 Transformer LLMs 中仍有其局限性,限制了信息在跨层间的高效传递。 彩云科技与北京邮电大学近期联合提出了一个简单有效的残差连接替代:多路动态稠密连接(MUltiway Dynamic Dense (MUDD) connection),大幅度提高了 Transformer 跨层信息传递的效率。

通过“视觉神经增强”机制,直接放大模型中的视觉关键注意力头输出,显著降低模型的幻觉现象。

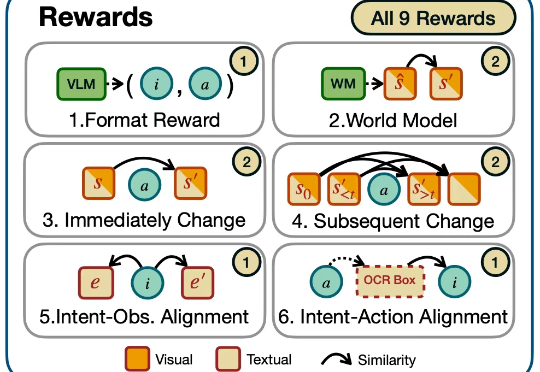

迈向通用人工智能(AGI)的核心目标之一就是打造能在开放世界中自主探索并持续交互的智能体。随着大语言模型(LLMs)和视觉语言模型(VLMs)的飞速发展,智能体已展现出令人瞩目的跨领域任务泛化能力。

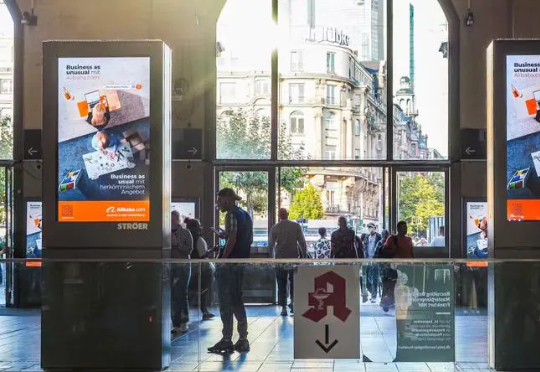

阿里国际站总裁张阔强调AI转型需全员设定目标,Accio AI搜索工具半年用户超百万,询盘量月环比增10倍。张阔考察中美贸易摩擦后发现中国供应链不可或缺,外贸订单强劲增长。AI从卖家侧提升效率后转向买家搜索,推动业务全面AI化,618外贸订单增42%。

全网翘首以盼的DeepSeek-R2,再次被曝推迟!据The Information报道,由于DeepSeek CEO梁文锋始终对R2的表现不满意,因此R2迟迟未能发布。此外,他们还援引两位国内知情人士的消息称,R2研发进程缓慢可能是由于缺少英伟达H20芯片。

91岁退休多年的John Blackman从未碰过代码,却在孙子指点下用AI工具,仅用两天搭出多租户管理系统。

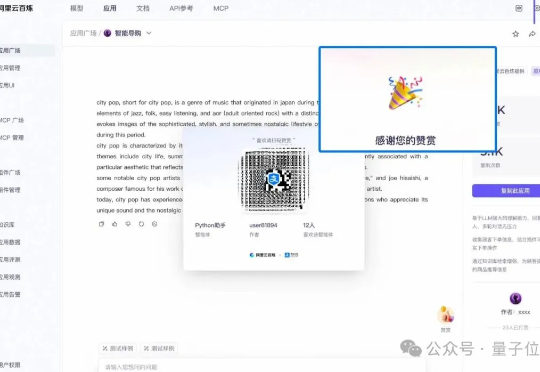

2025年已成为名副其实的Agent元年。 不论是Operator、Manus、Genspark等爆款Agent的相继出现,还是各大厂商陆续发布MCP协议支持,种种迹象都在印证着AI Agent正经历从“玩具”到“工具”的关键转折。

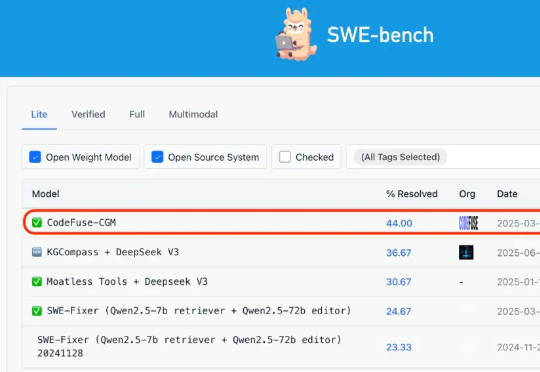

Agentless+开源模型,也能高质量完成仓库级代码修复任务,效果媲美业界 SOTA 。

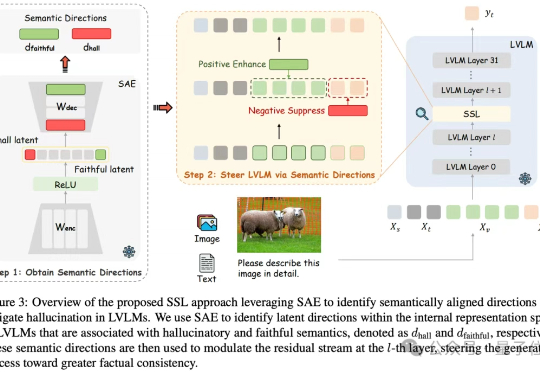

当前大型视觉语言模型(LVLMs)存在物体幻觉问题,即会生成图像中不存在的物体描述。

最近,扩散语言模型(dLLM)有点火。现在,苹果也加入这片新兴的战场了。

GPT-5,已经被OpenAI员工抢先用上了?就在今天,奥特曼在X上关注了一个神秘人,引起全网猜测。不止两人爆料,自己可能提前体验了GPT-5,甚至也有网友疑似被灰度测试到了。今夏推出的GPT-5,已经掀起全网疯狂!

让机器人下厨房,获数千万元融资!享刻智能正式官宣完成数千万元Pre-A轮系列融资,投资方阵容相当豪华:世纪长河科技集团、启迪之星联合领投,网龙天映创投、广华创投等多家机构跟投。

Agent能“看懂网页”,像人类一样上网?阿里发布WebDancer,就像它的名字一样,为“网络舞台”而生。

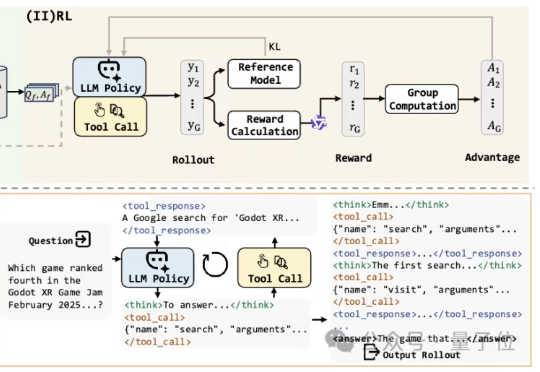

LLM 智能体(LLM Agent)正从 “纸上谈兵” 的文本生成器,进化为能自主决策、执行复杂任务的 “行动派”。它们可以使用工具、实时与环境互动,向着通用人工智能(AGI)大步迈进。然而,这份 “自主权” 也带来了新的问题:智能体在自主交互中,是否安全?

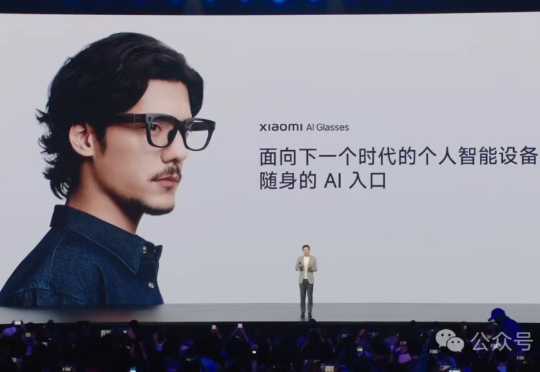

更适合中国宝宝的体质的 AI 眼镜。昨晚的小米「人车家全生态发布会」,除了万众瞩目的 YU7,最受关注的就是压轴的小米 AI 眼镜。

当地时间 6 月 26 日,在上个月的 Google I/O 上首次亮相预览后,谷歌如今正式发布了 Gemma 3n 完整版,可以直接在本地硬件上运行。

刚刚,OpenAI 研究员Aidan McLaughlin的一条推文引爆了网友们的关注。

![Black Forest震撼开源FLUX.1 Kontext [dev]:媲美GPT-4o的图像编辑](https://www.aitntnews.com/pictures/2025/6/27/49d75709-5310-11f0-82be-fa163e47d677.jpg)

前段时间,沉寂了很久的Flux官方团队Black Forest Labs发布了新模型:FLUX.1 Kontext,这是一套支持生成与编辑图像的流匹配(flow matching)模型。FLUX.1 Kontext不仅支持文生图,还实现了上下文图像生成功能,可以同时使用文本和图像作为提示词,并能无缝提取修改视觉元素,生成全新且协调一致的画面。

OpenAI 发文 智谱是其全球战略的竞争对手

朋友们,大家好呀! Google 昨晚发布并且开源了自己的终端代码运行助手,GEMINI-CLI ,完全是照着 Claude Code 来对标。如果你已经非常习惯使用 Claude Code 了,相信也可以无缝切换到 Gemini-Cli 来尝试使用。

每年数百万患者在医疗转诊中“消失”,这家纽约创业公司用AI重建连接,估值半年飙升至6.05亿美元。

在近日举办的2025年新领军者年会上,中国生物制药首席执行长谢承润接受媒体采访,并发表了AI在药物研发中应用的相关看法。

今晚科技圈的热搜话题,毫无疑问聚焦小米。Yu7之外,AI眼镜也在小米人车家全生态发布会前就吸引足了好奇心。

在 AI 生成技术不断颠覆创意行业的今天,Runway 再次迈出了激动人心的一步。作为全球领先的生成式 AI 公司,Runway 长期致力于打造下一代艺术与娱乐工具。