中国团队首次夺魁!无问芯穹FlightVGM获FPGA'25最佳论文,峰值算力超GPU21倍

中国团队首次夺魁!无问芯穹FlightVGM获FPGA'25最佳论文,峰值算力超GPU21倍国际可重构计算领域顶级会议 ——FPGA 2025 在落幕之时传来消息,今年的最佳论文颁发给了无问芯穹和上交、清华共同提出的视频生成大模型推理 IP 工作 FlightVGM,这是 FPGA 会议首次将该奖项授予完全由中国大陆科研团队主导的研究工作,同时也是亚太国家团队首次获此殊荣。

搜索

搜索

国际可重构计算领域顶级会议 ——FPGA 2025 在落幕之时传来消息,今年的最佳论文颁发给了无问芯穹和上交、清华共同提出的视频生成大模型推理 IP 工作 FlightVGM,这是 FPGA 会议首次将该奖项授予完全由中国大陆科研团队主导的研究工作,同时也是亚太国家团队首次获此殊荣。

什么,你在开发RAG竟然还没听说过Embedding模型还有排名?在AI应用开发热潮中,Embedding模型的选择已成为决定RAG系统成败的关键因素。然而,令人惊讶的是,许多开发者仍依靠直觉或跟风选择模型,而非基于系统化评估。

只需几句话,AI 模型就可以被提示创作一个故事、一幅图像,甚至一部短片。但根据 Weber Wong 的说法,“这些模型都是“由非创意人士制作,供其他非创意人士感受创意的。”

上个周末,百度文库那个自由画布全量上线了。

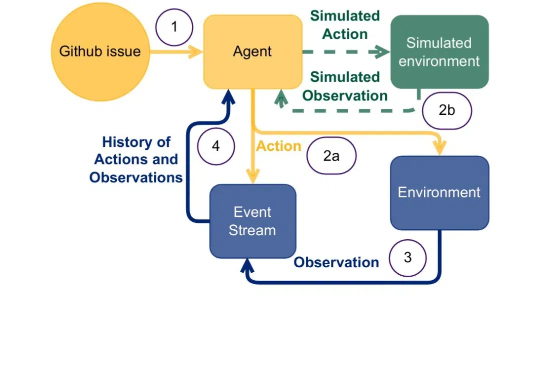

LLM在推理任务中表现惊艳,却在自我纠正上的短板却一直令人头疼。UIUC联手马里兰大学全华人团队提出一种革命性的自我奖励推理框架,将生成、评估和纠正能力集成于单一LLM,让模型像人类一样「边想边改」,无需外部帮助即可提升准确性。

听说了嘛?朋友,元宝电脑版新鲜出炉了!

现有的可控Diffusion Transformer方法,虽然在推进文本到图像和视频生成方面取得了显著进展,但也带来了大量的参数和计算开销。

AI 搜索加广告,你能接受吗?

大语言模型(LLMs)在当今的自然语言处理领域扮演着越来越重要的角色,但其安全性问题也引发了广泛关注。

扎克伯格也有「暗部」。

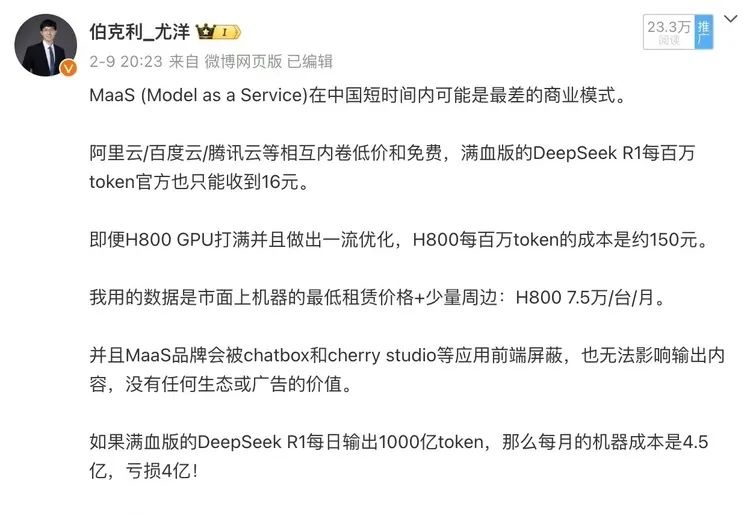

争吵之后,AI Infra公司的未来何去何从。

通过Deepseek、ChatGPT、Gemini等大模型说出来的话,不少没有辨别能力的小伙伴就会默认是公道与正确的。其实是未必。1.Deepseek、ChatGPT、Gemini等联网搜索的结果与规则还在完善;

黑石的野心远不止于对AI的“豪赌”。这家老牌资产管理公司正在加速转型,从传统的不动产投资巨头,转变为全球科技基础设施的资本掌舵者。

从漫长等待到极速突破

3月3日,智谱公布了最新一轮融资:本轮战略融资金额超10亿元人民币,参与投资方包括杭州城投产业基金、上城资本等。智谱称:此次融资旨在推动智谱国产基座GLM大模型的技术创新和生态发展。

2025年1月,CEA(Council of Economic Advisers,美国总统经济顾问委员会)发布了一份详细的人工智能人才报告,全景式地扫描了美国AI人才的现状。

近些日子,老詹突然“爱”上了DeepSeeK,简直有点相见恨晚的感觉!几乎每天都摆弄这玩意儿。然而,处着处着,我发现,这家伙有点靠不住!最大的问题是,说假话!

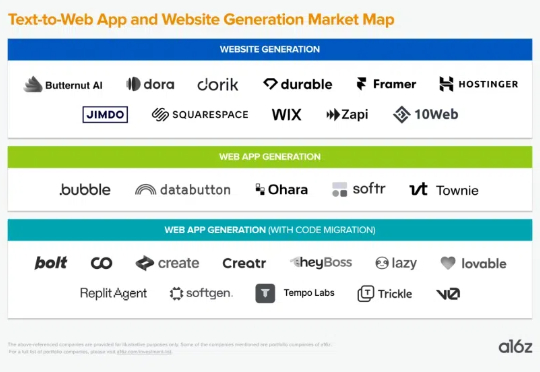

昨天,两位独立开发者上演了一场现场设计大战: Brett Williams,Webflow老司机,通过他的网页设计工作室Designjoy年入100万+美元 Henrik Westerlund,19岁营销专业辍学生,来自Lovable,一款通过文本提示生成完整功能网页应用的AI产品

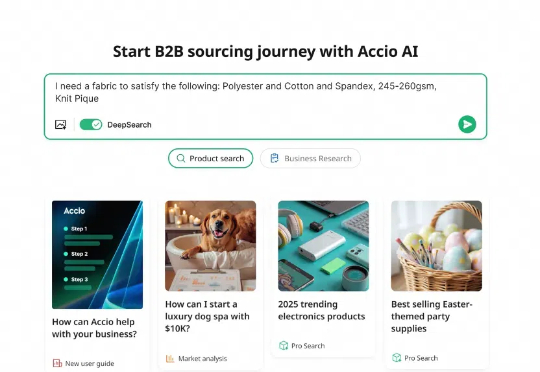

我想在沙漠里建一个室内滑雪场。DeepSeek:可以,详细计划如下。这是阿里国际站首个AI搜索引擎Accio接入DeepSeek之后的演示首秀。即便是这么离谱的想法,它还是在短短30秒内搜索了大量资料、反复推理,给出了一份有理有据的商业计划。

近日,马斯克和谷歌联创谢尔盖·布林,分别抛出了惊人言论。前者大胆预测,2029年AI将超越人类智慧总和,20%概率会导致文明灭绝。而后者则喊话员工每周工作60小时,全力开发可能取代自己的AI。

AI智能体有自己的交流方式。

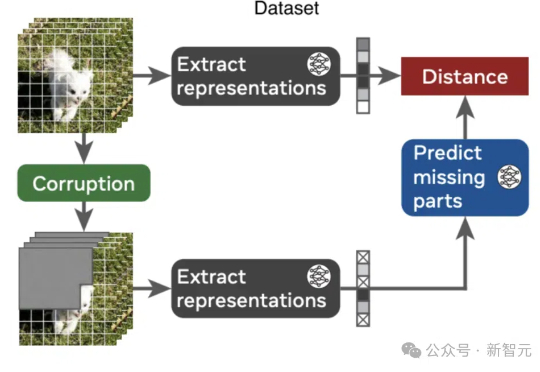

AI如何理解物理世界?视频联合嵌入预测架构V-JEPA带来新突破,无需硬编码核心知识,在自监督预训练中展现出对直观物理的理解,超越了基于像素的预测模型和多模态LLM。

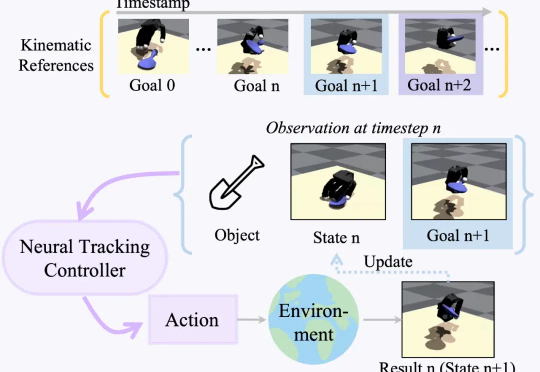

现实世界的机器人距离科幻小说里的机器人世界还有多远?通用灵巧操控何时才能实现?朝着这一伟大的目标,研究通用灵巧操控轨迹跟踪的 DexTrack 便应用而生。

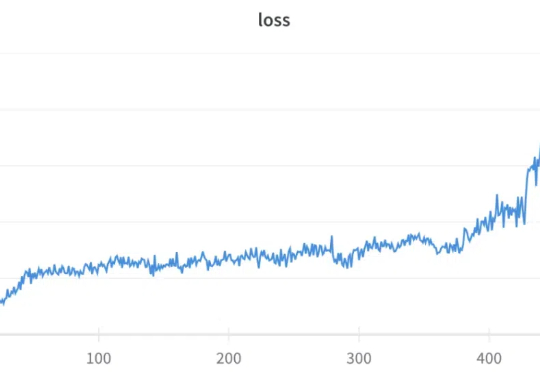

GRPO(Group Relative Policy Optimization)是 DeepSeek-R1 成功的基础技术之一,我们之前也多次报道过该技术,比如《DeepSeek 用的 GRPO 占用大量内存?有人给出了些破解方法》。

从本质上讲,LLM会根据用户从UI的输入生成代码示例。然后,生成的代码会通过中间件逻辑进行处理,根据逻辑跟踪文件、代码更改和第三方API调用。

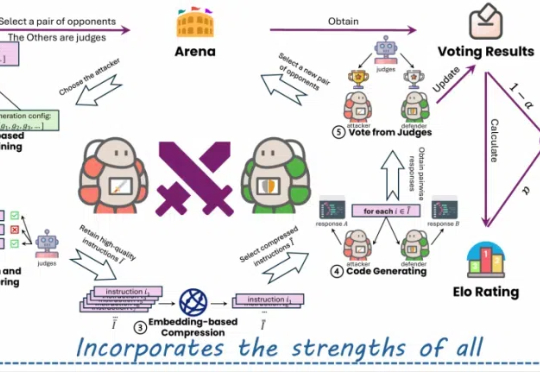

近年来,大型语言模型(LLMs)在代码相关的任务上展现了惊人的表现,各种代码大模型层出不穷。这些成功的案例表明,在大规模代码数据上进行预训练可以显著提升模型的核心编程能力。

原来,大型推理模型(Large Reasoning Model,LRM)像人一样,在「用脑过度」也会崩溃,进而行动能力下降。

BPO服务商往往处理周期漫长;因缺乏相关背景信息和权限,某些任务难以保质完成——终端客户的体验低效且充满挫败感。

这家初创公司希望让大公司争夺大众市场,而自己专注于吸引行业专业人士,并与 Lionsgate 达成一笔里程碑式的交易。

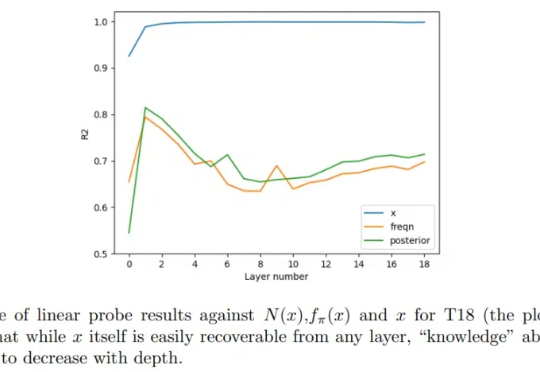

Transformer 很成功,更一般而言,我们甚至可以将(仅编码器)Transformer 视为学习可交换数据的通用引擎。由于大多数经典的统计学任务都是基于独立同分布(iid)采用假设构建的,因此很自然可以尝试将 Transformer 用于它们。