蛋白质模型的GPT时刻来了!

清华大学智能产业研究院(AIR)周浩副教授课题组联合上海人工智能实验室发布了AMix-1:

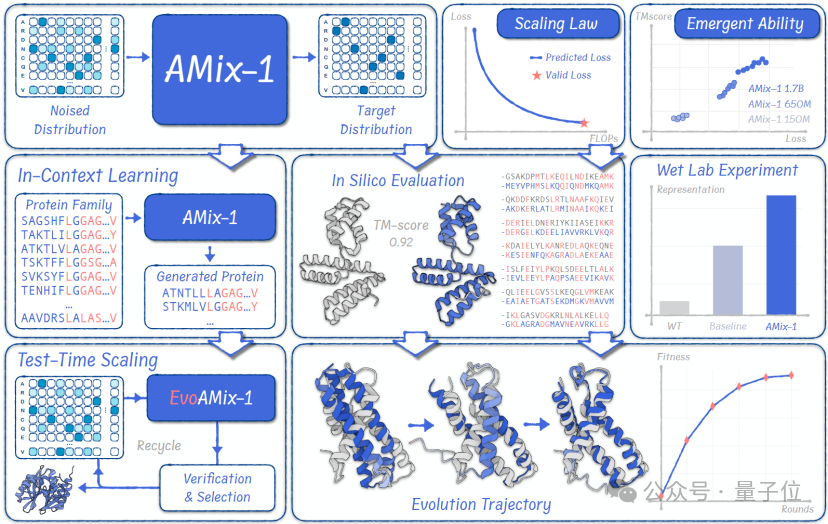

首次以Scaling Law、Emergent Ability、In-Context Learning和Test-time Scaling的系统化方法论来构建蛋白质基座模型。

这为通往蛋白质的通用智能构建起了新的技术范式。让停留在BERT时代、缺乏可扩展性和通用性的蛋白质基座领域实现了向GPT时代的跨越。

就像NLP领域的ChatGPT一样,AMix-1不再局限于某一种蛋白质任务,而是能举一反三、自主学习。

这个“蛋白质GPT”能自己摸索规律,看几个例子就会设计新蛋白,甚至越研究越厉害。

由AMix-1设计的蛋白质已经通过湿实验的硬核考验,最优变体蛋白质活性提升了50倍。

并且,它的模型权重、代码和技术细节已全部公开,下面来看看具体细节。

当语言模型涌现出通用智能时,蛋白质模型的通用智能还有多远?

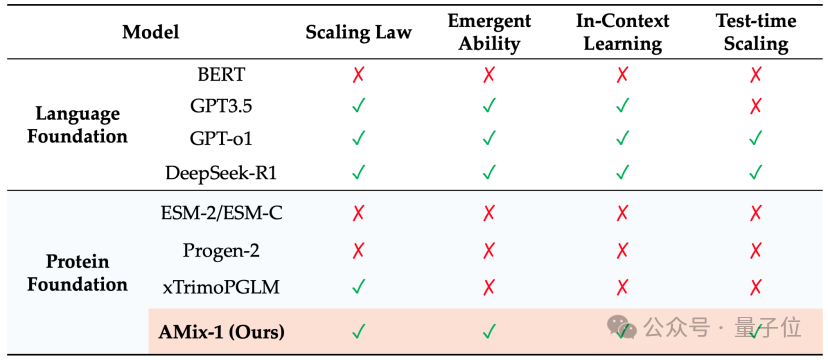

在NLP领域,语言模型基座经历了从BERT到GPT的跨时代变化,涌现出了各种超出预期的通用智能,BERT时代的模型关心具体任务的提升,缺乏对可扩展性、通用性和涌现能力的系统化讨论。

而在GPT时代,系统化的讨论逐渐显现,通用智能的爆发也因此开始。

然而,在蛋白质基座领域,几乎没有贯彻这条智能涌现的路径,一系列工作同样停留在BERT时代,在“预训练+任务微调”这一范式下前行,缺乏对可扩展性、通用性和涌现能力的系统化讨论。

AMix-1是基于贝叶斯流网络(Bayesian Flow Networks, BFNs)的蛋白质基座新范式,为蛋白质基座模型实现Test-time Scaling提供了一整套系统性的技术方案:

实际上我们可以将其概括为AMix-1的四大“超能力”。

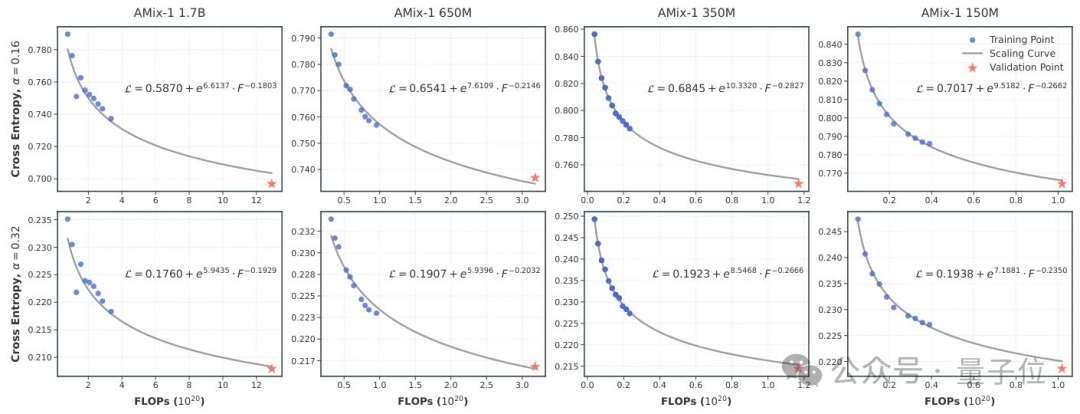

就像学生刷题越多、成绩提升越稳定,AMix-1有个“可预测的成长曲线”。

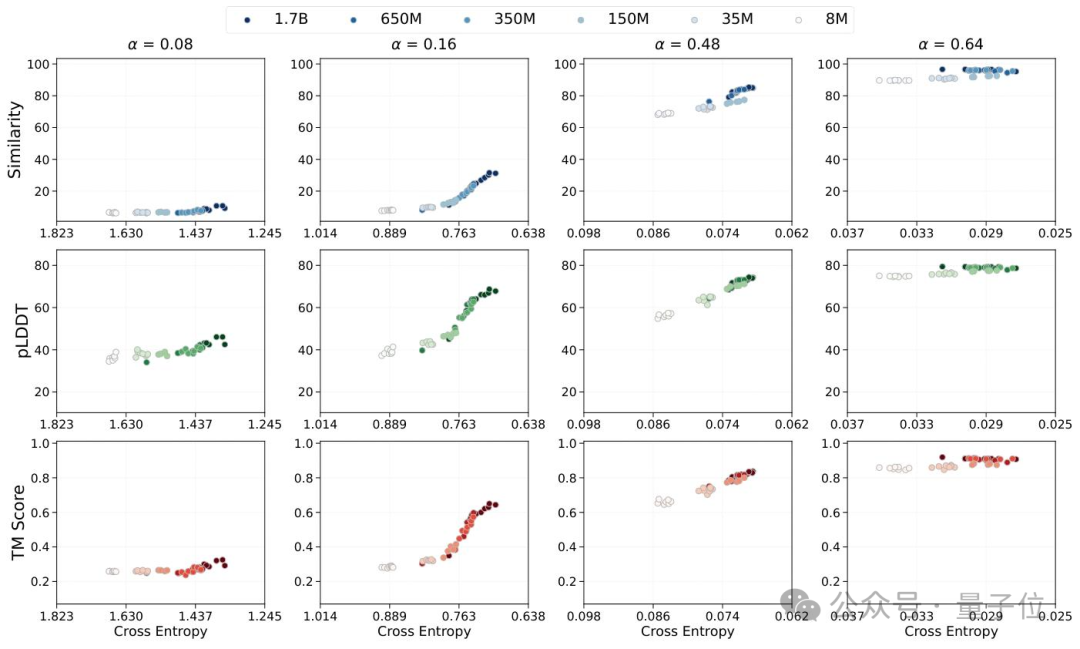

研究者设计了从800万到17亿参数的多尺度模型组合,利用训练FLOPs(浮点操作数)作为统一衡量指标,精确拟合、预测了模型交叉熵损失与计算量的幂律关系。

他们发现,只要增加模型参数、训练数据或计算量,AMix-1的性能(比如预测蛋白质结构的准确度)就会按规律提升。

这意味着科学家能精准规划资源,不用担心花了钱却没效果,为更大规模的蛋白质研究铺平了路。

AMix-1最神奇的一点是会“顿悟”。

刚开始训练时,它只懂识别蛋白质的基本序列,但随着训练深入,当loss降到某个阈值时,它会自动具备“结构感知能力”——

不用任何人教,就能自动理解蛋白质的折叠方式、空间结构。

这种能力不是渐进,而是跳变。就像从只会认字母,突然学会了读懂整篇文章的意思,这种“质变”让它能更好地把握蛋白质结构和功能的关系。

这实际上是其In-Context Learning机制在蛋白质设计过程中的体现。

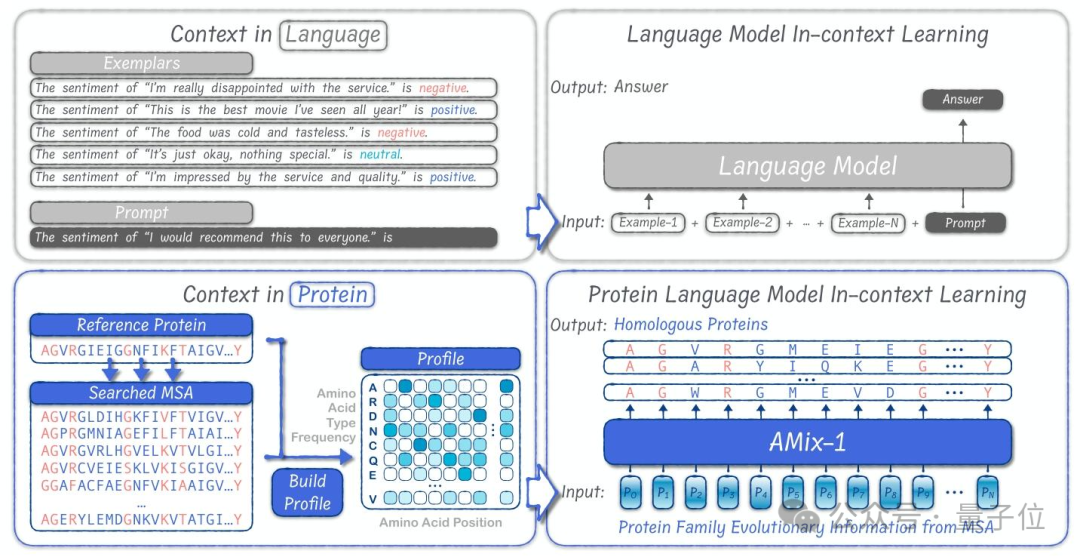

以前设计蛋白质,要针对不同任务改算法,就像做一道新题要重新学公式。

但AMix-1 会上下文学习:给它几个同类蛋白质的例子(比如一组能在高温下工作的酶),它能自动总结规律,直接设计出符合这些规律的新蛋白,不用任何额外训练。

具体来说,这种方法把一组蛋白质MSA(多序列比对)压缩成一个位置级的概率分布,作为提示输入给模型。

而模型不需要任何微调,就能根据这些例子自动推理出结构和功能规律,并生成符合意图的新蛋白。

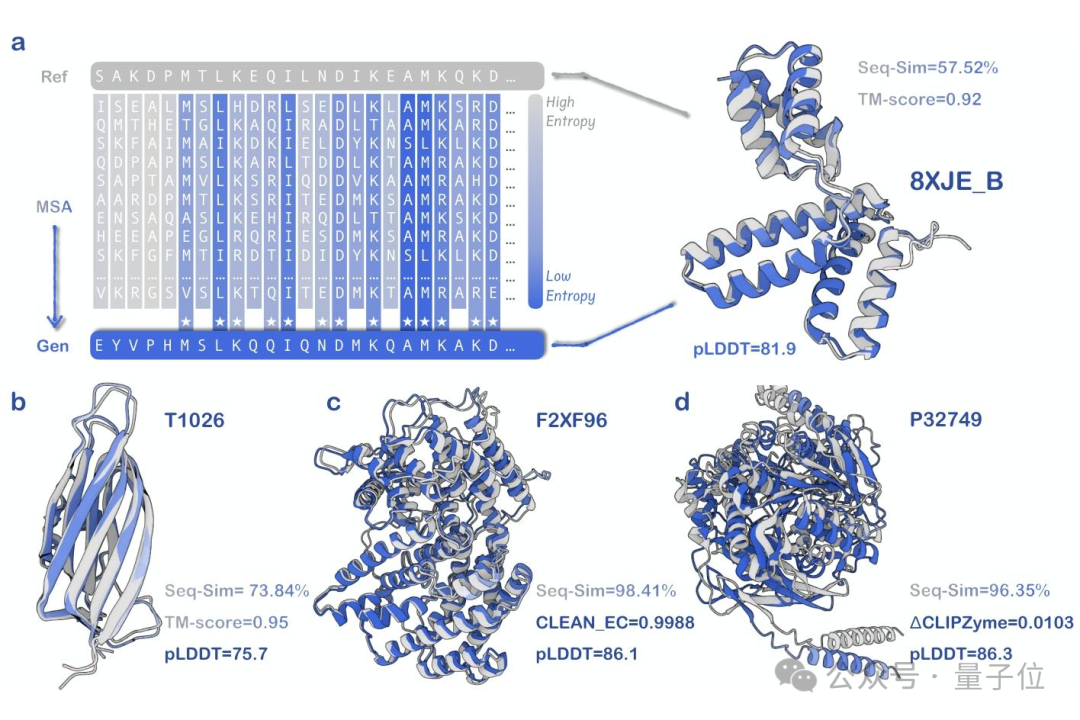

在结构任务上(上图a-b),以常规同源蛋白甚至在近乎无同源的“孤儿蛋白”为提示,AMix-1生成在预测结构上高度一致的新蛋白;

在功能任务中(上图c-d),AMix-1在输入蛋白的酶学功能和化学反应引导的酶设计上,AMix-1能生成出功能高度一致的蛋白酶。

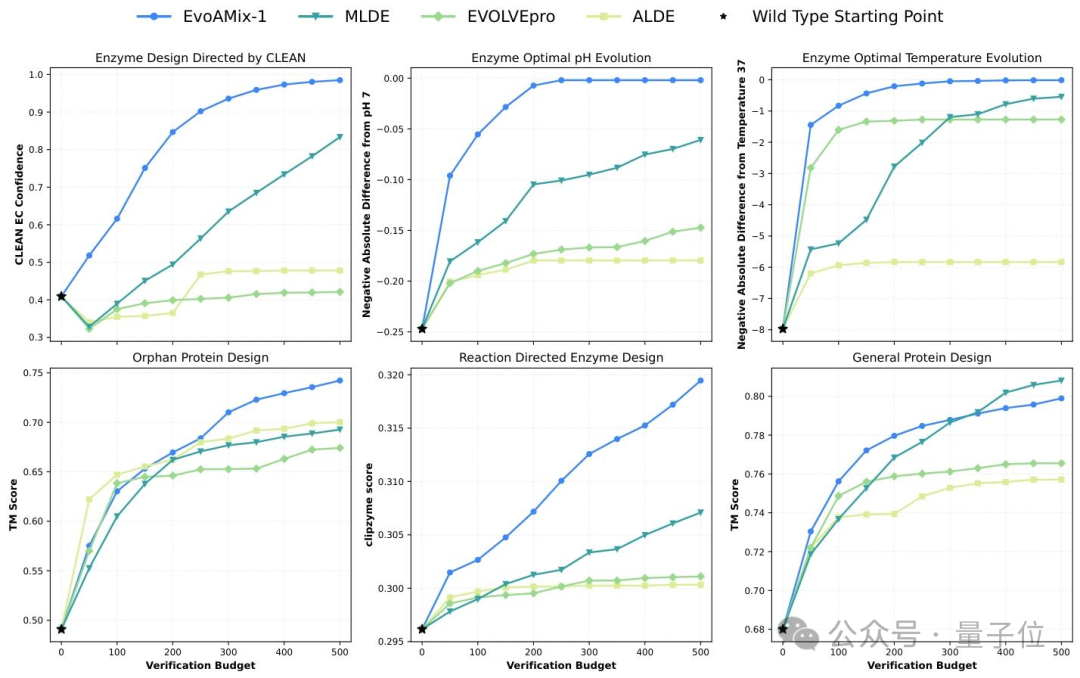

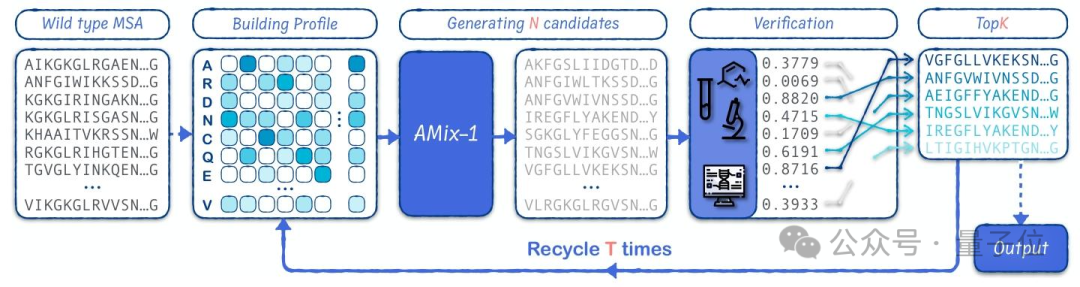

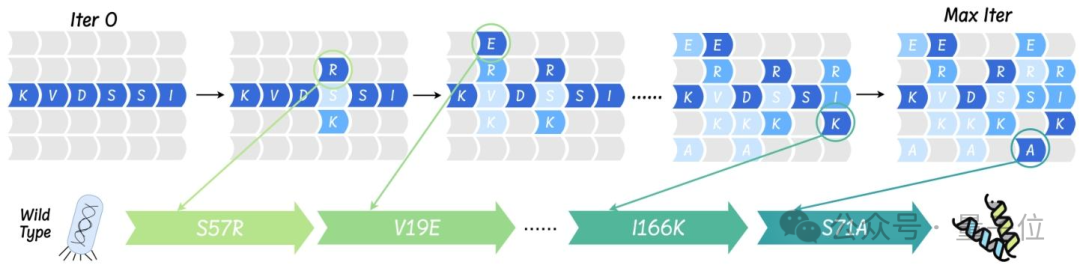

AMix-1设计了独特的测试时扩展方法EvoAMix-1,能够利用其特有的上下文学习范式,在简单可插拔的验证(包括计算模拟与湿实验评估)加持下,实现模型能力随验证预算提升的可持续扩展。

同时,AMix-1也是第一个具备了测试时扩展能力的蛋白质基础模型。

实验结果显示,EvoAMix-1在所有任务上展示出强劲的扩展能力,同时也体现其跨任务、跨目标的强大通用性。

下图展示了EvoAMix-1在六个定向进化基准中的Test-time Scaling性能。

这也就是说,给它更多验证时间和资源,它能不断优化设计结果。

比如设计酶的时候,第一次生成10个候选蛋白,测试后挑出最好的2个,再让它基于这2个继续改进,重复几次,就能得到性能远超初始版本的蛋白质。

下图展示了AMix-1在推理阶段进行进化扩展算法的工作流程。

AMix-1已经通过了湿实验的硬核考验。

研究者想优化一种叫AmeR的转录调控因子(常用于合成生物学的基因开关),让它更擅长结合DNA。

用AMix-1生成40个变体后,实验发现最优的变体蛋白质活性提升了50倍,比目前最先进的方法还提升了77%。

更关键的是,整个过程全自动化,不用科学家手动调整,完美实现了「从模型到实验」的闭环。

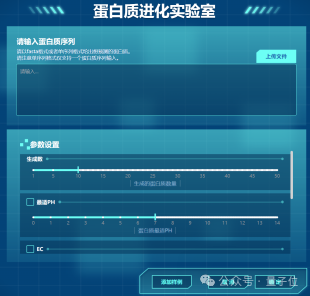

清华大学智能产业研究院还联合上海人工智能实验室研发了一个虚拟生物实验室。

AMix-1支撑了该虚拟生物实验室的蛋白质生成与进化工作。

以前需要反复试错、耗钱耗时的蛋白质改造,现在可能像和ChatGPT聊天一样简单~

技术报告:https://arxiv.org/pdf/2507.08920

项目主页:https://gensi-thuair.github.io/AMix-1/

模型权重:https://huggingface.co/GenSI/AMix-1-1.7B

代码仓库:https://github.com/GenSI-THUAIR/AMix-1

虚拟生物实验室:https://virtualbiolab.intern-ai.org.cn/

文章 来自于微信公众号“量子位”,作者是“闻乐”。

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner