AI传奇人物、前特斯拉AI总监Karpathy宣布发布全新项目nanochat!

一个极简但完整的「从零构建ChatGPT」训练框架。

Karpathy说这是他写过的最疯狂的项目之一!

相当于每个人都可以自己拥有一个专属的ChatGPT。

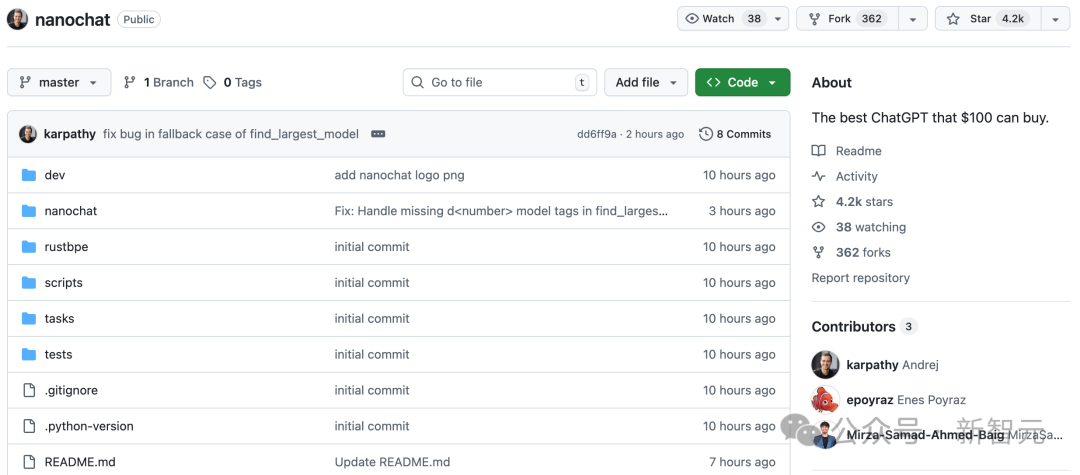

项目刚放出还不到12个小时,GitHub星标就破4.2kStar!(还在持续疯涨中)

GitHub项目:https://github.com/karpathy/nanochat

全是社区自来水流量,这就是Karpathy在AI领域的号召力!

与早期的nanoGPT不同,nanochat不仅涵盖预训练,还囊括了从数据准备、预训练、中期训练(对话、多项选择题、工具使用)、SFT、RL微调到推理部署的全流程。

整个系统仅约8000行干净代码,启动一台GPU机器、运行一条脚本,4小时后你就能在网页界面与自己训练的「小ChatGPT」对话。

Karpathy将其称为LLM101n的「压轴之作」,同时也可能成为未来研究基线和开源社区的实验平台。

让我来仔细看看如何仅仅用8000行来「克隆」ChatGPT:

项目全程花费低至约100美元(约在一台8XH100节点上训练4小时)。

可以训练、克隆一个可以对话的小型ChatGPT,它能创作故事/诗歌、回答简单问题。

只需要训练约12小时即可超过GPT-2的核心指标。

随着进一步扩展到约1000美元(约41.6小时训练),模型会迅速变得更连贯,能解决简单的数学/代码问题并做多项选择题。

训练24小时的模型(其FLOPs大致相当于GPT-3Small125M,约为GPT-3的1/1000)在MMLU上能进入40分段,在ARC-Easy上进入70分段,在GSM8K上进入20分段等。

总结一下就是:

这个项目体现出他的核心理念:

「降低 LLM 研究与复现门槛,让每个人都能亲手训练自己的模型。」

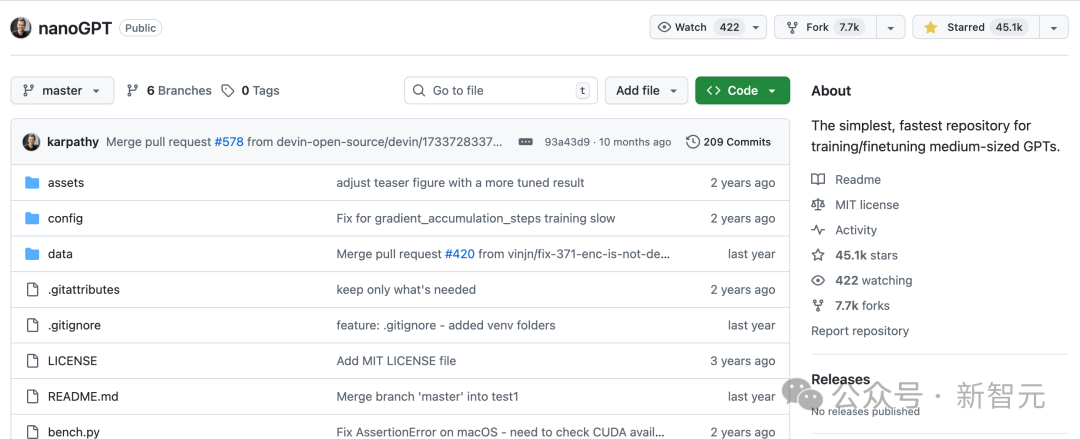

这种民主化路线,与他在nanoGPT时期倡导的「从零实现Transformer」如出一辙。

项目地址:https://github.com/karpathy/nanoGPT

Karpathy说他的目标是把完整的「强基线」栈整合到一个连贯、极简、可读、可修改、可最大化派生的仓库中。

nanochat将成为LLM101n(仍在开发中)的压轴项目。

Karpathy认为nanochat也有可能发展成一个研究工具或基准,就像之前的nanoGPT一样。

nanoGPT教你造大脑,nanochat教你造ChatGPT。

如果说nanoGPT是「Transformer源码教学项目」。

那么,nanochat则是「LLM生态系统微缩版」、OpenAI同款、你的专属AI。

二者关系可理解为「从神经网络基础到产品级对话系统」的两步闭环。

从Vibe Coding到nanoGPT,再到如今的nanochat,Karpathy不愧是「AI教育者」的最佳代言人。

这一「疯狂之作」并非狂想,而是Karpathy对AI开放、可学习、可复现理想的又一次践行。

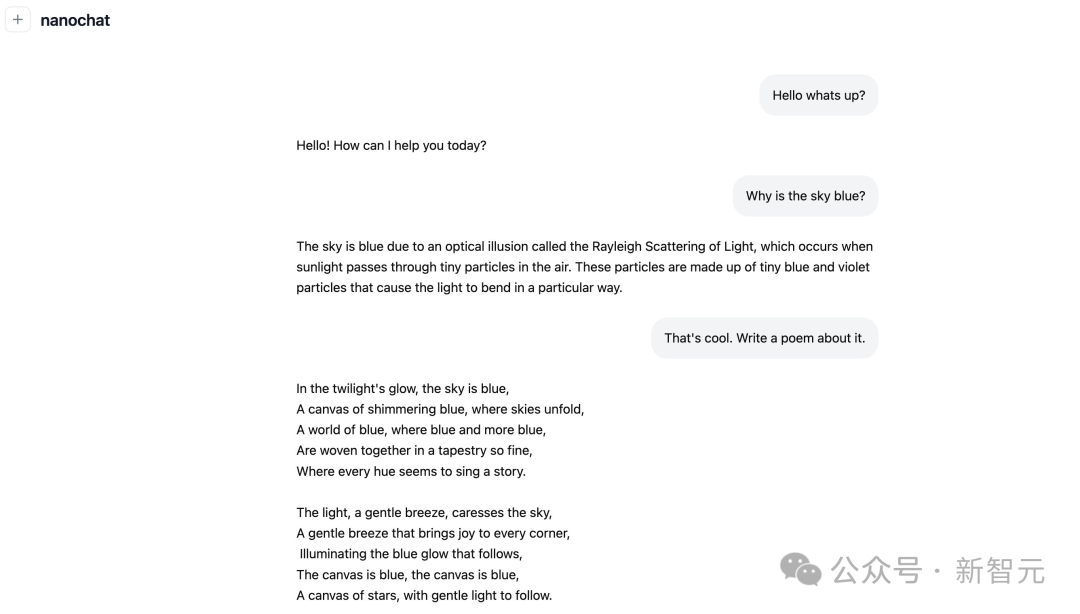

小型ChatGPT效果展示

Karpathy在WebUI部署了nanochat项目。

他还给出了「与价格为100美元、运行4小时的」nanochat的示例对话。

很……有趣!

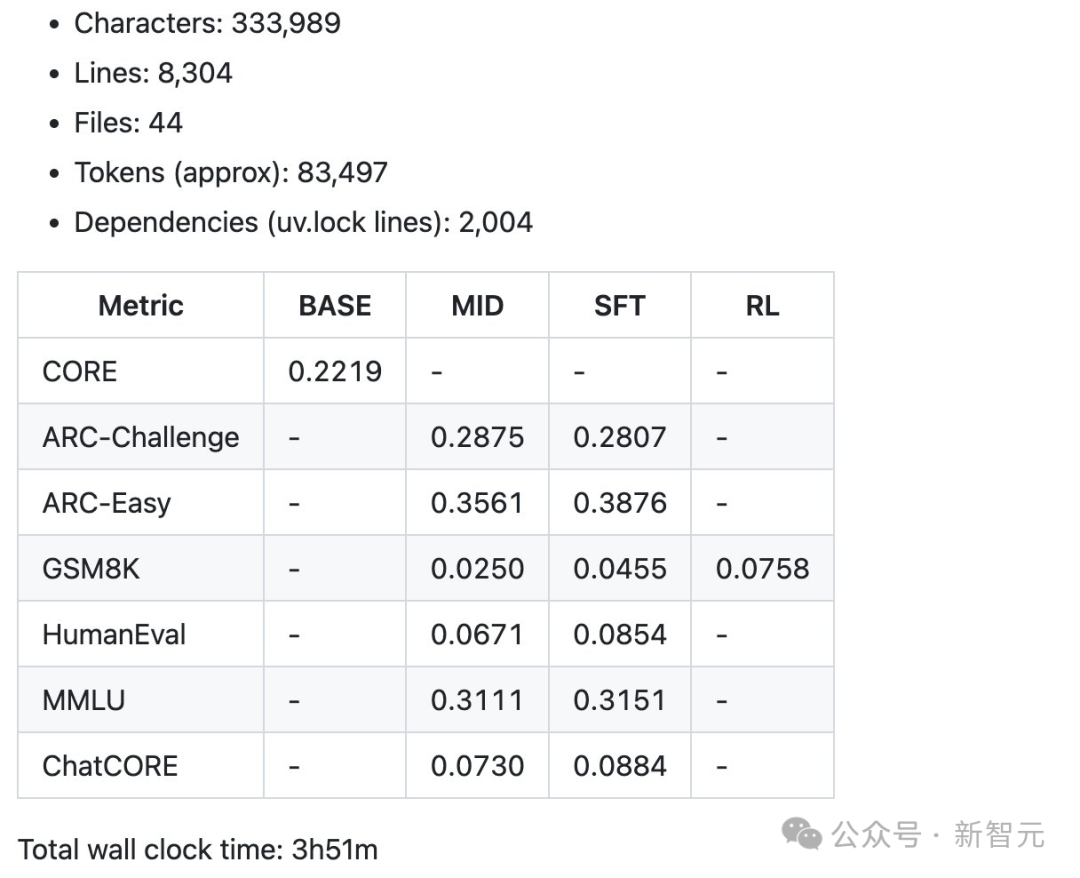

下面这张图展示的是Karpathy在nanochat「$100速度跑」实验(即只用一台GPU、约4小时训练出的ChatGPT 小模型)中生成的「成绩单」部分内容,说明模型规模、训练耗时、以及在各类标准评测上的性能。

这些数字展示了nanochat的「极简」精神:完整实现了 ChatGPT 的训练、微调与推理,却仍保持在8000行代码以内。

参考资料:

https://x.com/karpathy/status/1977755427569111362

https://github.com/karpathy/nanochat

文章来自于微信公众号 “新智元”,作者 “新智元”