AI 聊天机器人一直有个问题:它们没有脸。你可能已经习惯了和文字框对话,在各种应用里打字提问、等待回复。这种交互方式确实高效,但总觉得少了点什么。人类天生就是视觉动物,我们更喜欢和真实的脸对话,而不是盯着冰冷的文字。这也是为什么即使在通讯软件如此发达的今天,视频通话依然无法被取代。当你需要深入交流、建立信任或解决复杂问题时,看到对方的表情和肢体语言会让整个对话变得完全不同。

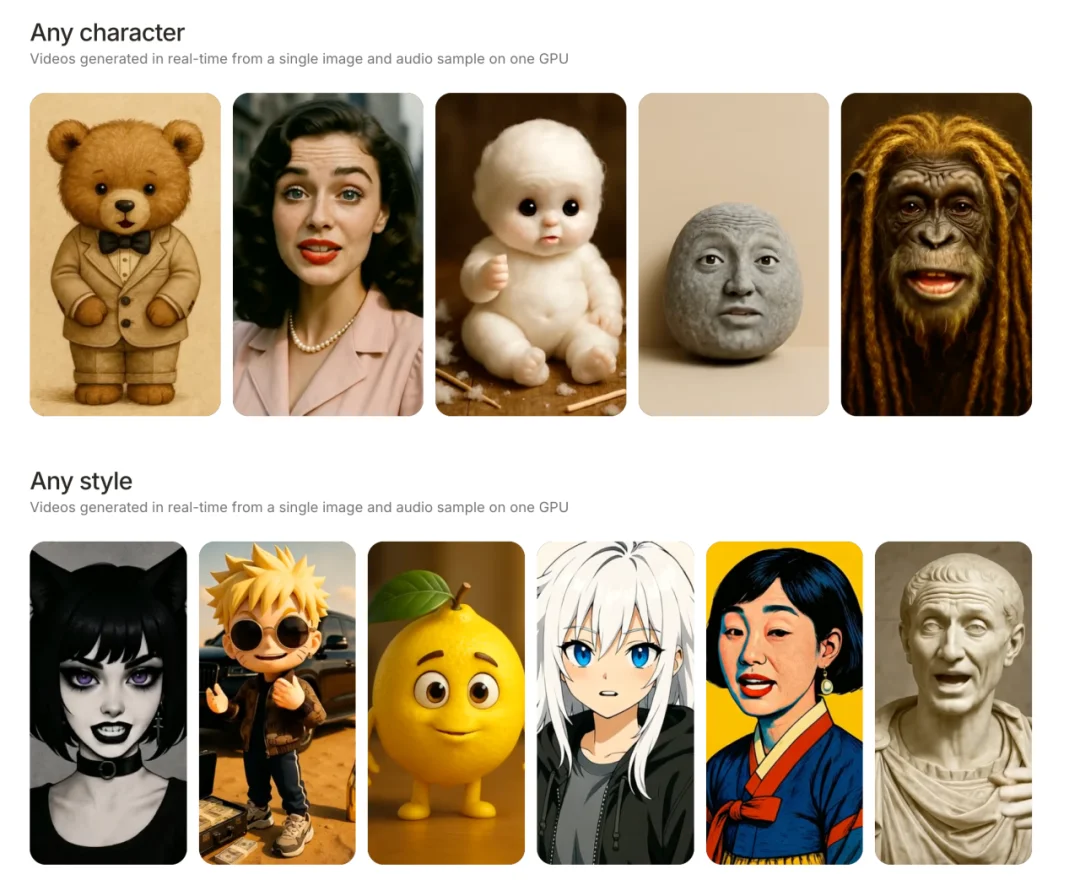

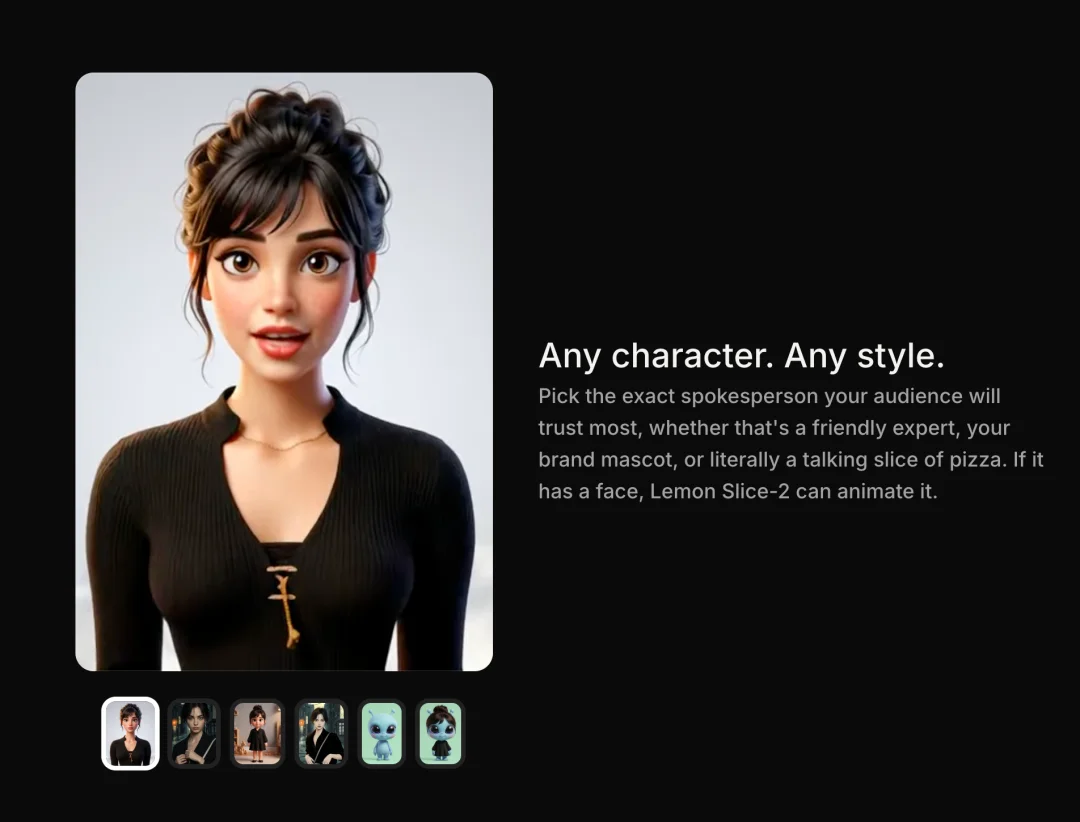

这个观察让我对刚刚获得 1050 万美元融资的 Lemon Slice 产生了浓厚兴趣。这家由 Y Combinator 和 Matrix Partners 领投的创业公司,正在做一件听起来有点疯狂但又极具前瞻性的事:他们开发了一个叫做 Lemon Slice-2 的 AI 模型,可以把任何一张静态图片——无论是公司员工照、卡通角色、还是文艺复兴时期的油画——瞬间变成一个能实时对话的视频头像。不需要上传训练视频,不需要复杂的预处理,甚至不需要是真人照片。只需要一张图,你就能和这个角色进行面对面的视频对话。

我知道这听起来像是科幻片的情节,但当 Y Combinator 的合伙人 Jared Friedman 说"这是自 ChatGPT 首次发布以来,我第一次试用一个产品时想到'啊,这就是未来人们与计算机对话的方式'"时,我意识到这可能真的是一个重要的转折点。我们正处在一个关键时刻:AI 不再只是回答问题,而是开始以更人性化的方式与我们互动。

为什么现有的 AI 头像都不够好

说实话,AI 头像这个概念并不新鲜。过去几年里,我见过不少公司尝试做这件事,比如 D-ID、HeyGen、Synthesia 这些比较知名的玩家,还有 Genies、Soul Machine、Praktika 和 AvatarOS 等专注于数字头像的公司。但坦白说,我每次体验这些产品时都会感到一种说不出的不适感。

Lemon Slice 的联合创始人兼 CEO Lina Colucci 对这个问题的描述非常精准:"我迄今为止看到的现有头像解决方案都给产品带来了负面价值。它们看起来很诡异,动作僵硬。前几秒可能还不错,但一旦你开始与它们互动,就会感到非常不自然,完全无法让人放松。真正阻碍头像技术普及的原因,就是它们还不够好。"这话说得太对了。我之前试用过一些 AI 客服头像,表面上看确实是个人脸在说话,但那种机械的表情变化、不自然的眼神移动、以及完全对不上节奏的嘴型,反而让整个体验比纯文字聊天还要糟糕。

这种"恐怖谷效应"在 AI 头像领域特别明显。所谓恐怖谷,指的是当机器人或虚拟角色看起来几乎像真人但又不够逼真时,人们会产生强烈的不适感。很多现有的 AI 头像恰好落在这个恐怖谷里——它们努力想要看起来像真人,但各种细节的不自然反而让人感到毛骨悚然。我认为这也是为什么尽管技术已经存在多年,但 AI 头像始终没有真正普及的核心原因。

另一个问题是现有解决方案的局限性。大多数 AI 头像工具都需要你上传训练视频,或者只能处理写实风格的人脸,又或者需要针对特定角色训练定制模型。这意味着如果你想创建一个卡通角色的 AI 头像,或者想让一个历史人物的画像开口说话,基本上是做不到的。这种限制极大地缩小了应用场景,也让很多有创意的想法无法实现。

Lemon Slice-2 的技术突破在哪里

Lemon Slice-2 之所以引起我的关注,是因为它从技术路径上就走了一条完全不同的道路。这是一个 200 亿参数的视频扩散 transformer 模型,和 OpenAI 的 Sora 或 Google 的 Veo3 属于同一类技术,但专门针对会说话的角色进行了优化,并且特别强化了实时性能。

我特别欣赏的一点是,Lemon Slice-2 采用了"零样本"学习方式。什么意思呢?就是你只需要提供一张图片,不需要任何训练数据、不需要视频素材、也不需要提前告诉系统这是什么风格,AI 就能立即生成一个可以实时对话的视频头像。这意味着你可以上传一张公司员工的证件照、一个你喜欢的卡通小动物、甚至是蒙娜丽莎的肖像,然后马上开始和它进行视频对话。这种灵活性是现有技术根本做不到的。

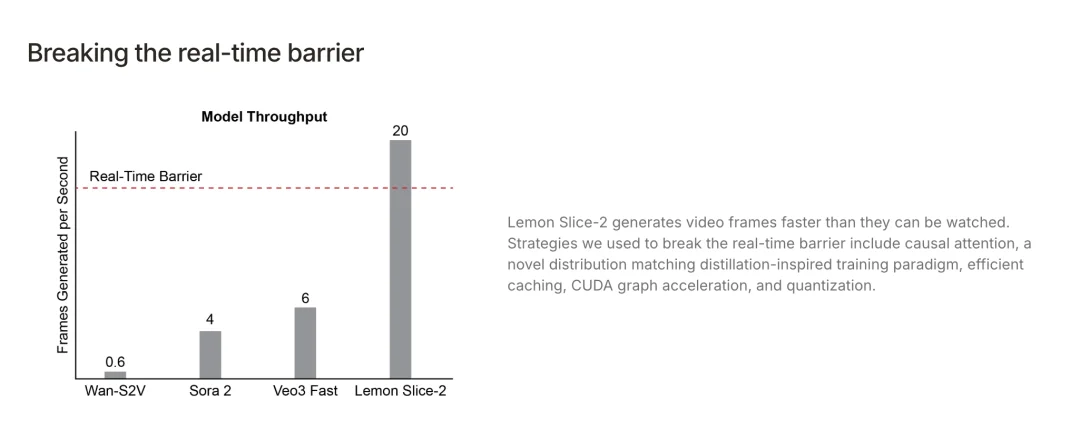

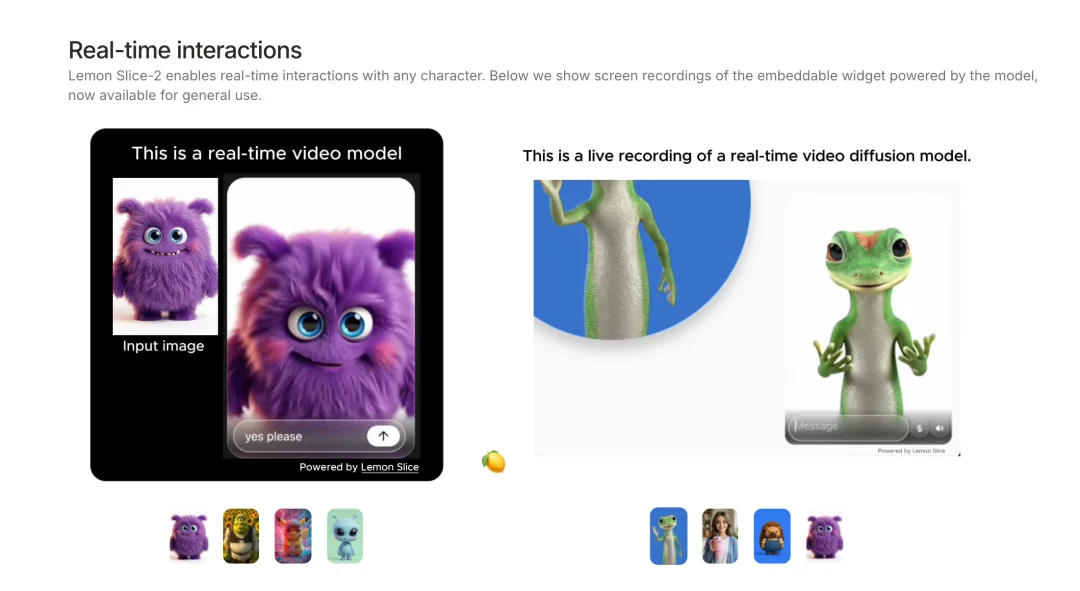

更厉害的是它的性能表现。Lemon Slice-2 可以在单个 GPU 上以每秒 20 帧的速度实时生成视频流。你可能对这个数字没什么感觉,但我来解释一下:大多数视频内容每秒播放 24-30 帧才会显得流畅,而 Lemon Slice-2 能够在单 GPU 上达到 20 帧/秒,意味着生成视频的速度比你观看的速度还要快。这种性能让真正的实时互动成为可能,而不是那种延迟几秒钟、看起来卡顿的互动体验。

从技术细节来看,Lemon Slice 采用了多种创新策略来实现这种实时性能。包括因果注意力机制、一种新颖的分布匹配蒸馏训练范式、高效缓存、CUDA 图加速以及量化技术。这些听起来很技术化的名词,实际上都是为了解决同一个问题:如何让 AI 头像的响应速度足够快,快到用户感觉就像在和真人对话。根据 Lemon Slice 公布的数据,用户体验到的平均响应时间只有 2.8 秒,而其中视频生成部分只占了 730 毫秒,也就是不到一秒。剩下的时间主要花在语音识别和语言理解上。这个速度已经接近人类对话的自然节奏了。

我认为 Lemon Slice-2 最大的技术优势在于它是一个通用的端到端模型。什么意思?就是它从头到尾生成每一个像素,而不是基于预录制的动作或模板进行拼接。这种方法虽然计算成本更高,但带来的好处是质量上限几乎没有限制。Y Combinator 的 Jared Friedman 对此评价说:"Lemon Slice 采用的是我认为唯一能够最终克服恐怖谷并通过头像图灵测试的基础机器学习方法。他们训练的模型类型与 Veo3 或 Sora 相同:视频扩散 transformer。因为这是一个通用模型,采用端到端的方式处理整个过程,所以它的质量提升没有上限;而其他方案的质量上限都达不到照片级真实感。它还能同时处理人类和非人类面孔,并且只需要一张图片就能添加新面孔。"

这里有个很关键的点:Lemon Slice-2 支持完整的身体动画,包括面部表情、手势和全身动作。这不是那种只有嘴巴在动、身体僵硬的粗糙头像,而是可以做出自然手势、点头、摇头、甚至改变坐姿的生动角色。这种细节上的丰富性,正是让 AI 头像跨越恐怖谷的关键。当一个角色在解释复杂概念时能够配合手势,在表达同情时能够微微前倾身体,在思考时能够眼神飘移,这些微妙的非语言信号会让整个交互体验完全不同。

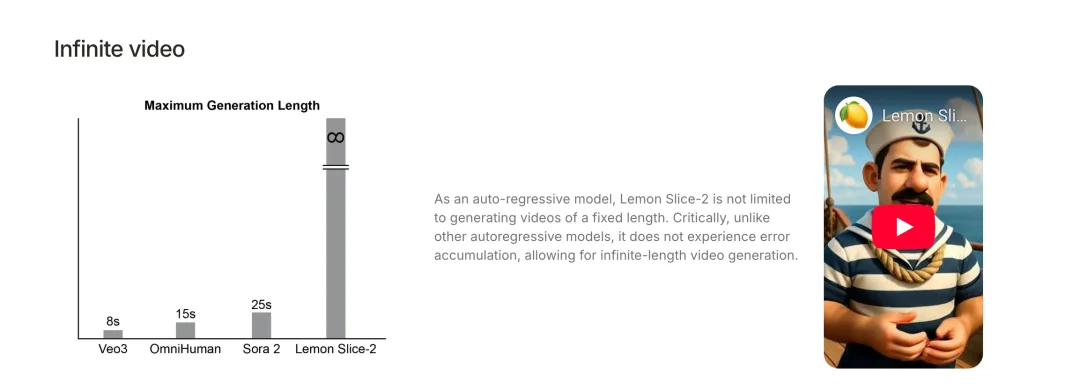

另一个让我印象深刻的技术特性是无限长度视频生成能力。作为一个自回归模型,Lemon Slice-2 理论上可以生成任意长度的视频。更重要的是,它不会出现误差累积的问题。什么是误差累积?在很多自回归模型中,每生成一帧新的内容,都会基于前面生成的内容,这样一来,任何微小的错误都会在后续生成中被放大,导致视频质量随着时间推移而下降。但 Lemon Slice-2 通过特殊的技术设计避免了这个问题,这意味着即使是长时间的对话,头像的质量也能始终保持稳定。

这项技术能用来做什么

当我深入了解 Lemon Slice 的应用场景时,我发现这项技术的想象空间比我最初想的要大得多。它不仅仅是给聊天机器人加个脸那么简单,而是在重新定义很多领域的用户体验。

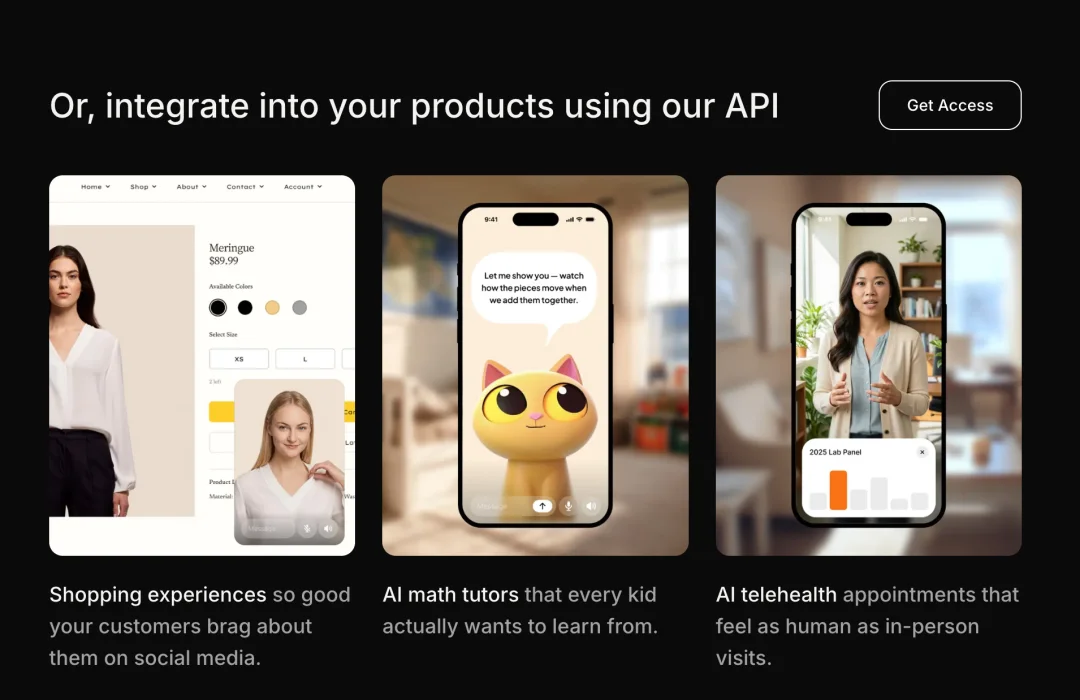

拿教育来说。想象一下,一个正在学数学的小学生,不是面对枯燥的练习题和文字解释,而是有一个可爱的外星人角色作为他的数学老师。这个外星人会用生动的表情和手势讲解数学概念,能够回答孩子的任何问题,还能出题测验并根据孩子的反应调整难度。当孩子答对题目时,外星人会开心地竖起大拇指;当孩子遇到困难时,它会耐心地换个方式再讲一遍。这种互动式的学习体验,比传统的在线教育视频或文字课程要吸引人得多,尤其是对注意力容易分散的儿童来说。

电商领域的应用也让我很感兴趣。现在的在线购物体验虽然方便,但缺少了实体店导购的人性化服务。有了 Lemon Slice 的技术,网站可以部署一个虚拟造型师,不仅能够回答关于退换货政策的问题,还能帮你浏览整个网站、推荐搭配、甚至"试穿"不同的服装让你看效果。这种体验比简单的聊天机器人要丰富得多,也比静态的产品图片更有说服力。用户可以问"这件外套配什么裤子好看",虚拟造型师会展示几种搭配方案,用户可以继续追问细节,整个过程就像在实体店里和真实导购对话一样自然。

医疗领域的潜力也很大。去医院看病时,在候诊室填写各种表格是一个让人头疼的环节。有了 AI 头像,这个过程可以变成一次轻松的对话。虚拟助理会用亲切的语气引导患者回答问题,解释为什么需要这些信息,甚至在察觉到患者紧张时给予安慰。对于一些初步的医疗咨询,比如解释某个手术流程或注意事项,有个看得见的"医护人员"来讲解,会比阅读长篇文字说明要容易理解得多,也能减轻患者的焦虑感。

企业培训是另一个我认为会被这项技术深刻改变的领域。新员工入职培训、产品知识学习、合规培训等等,传统上都是通过录播视频或在线文档来完成的。这种单向的信息传递效率很低,员工常常走神或者对某些内容一知半解。但如果培训内容是通过一个互动式的 AI 头像来传递,员工可以随时提问、要求重复讲解某个部分、或者通过问答来检验自己的理解,这种主动学习的效果会比被动观看视频好得多。

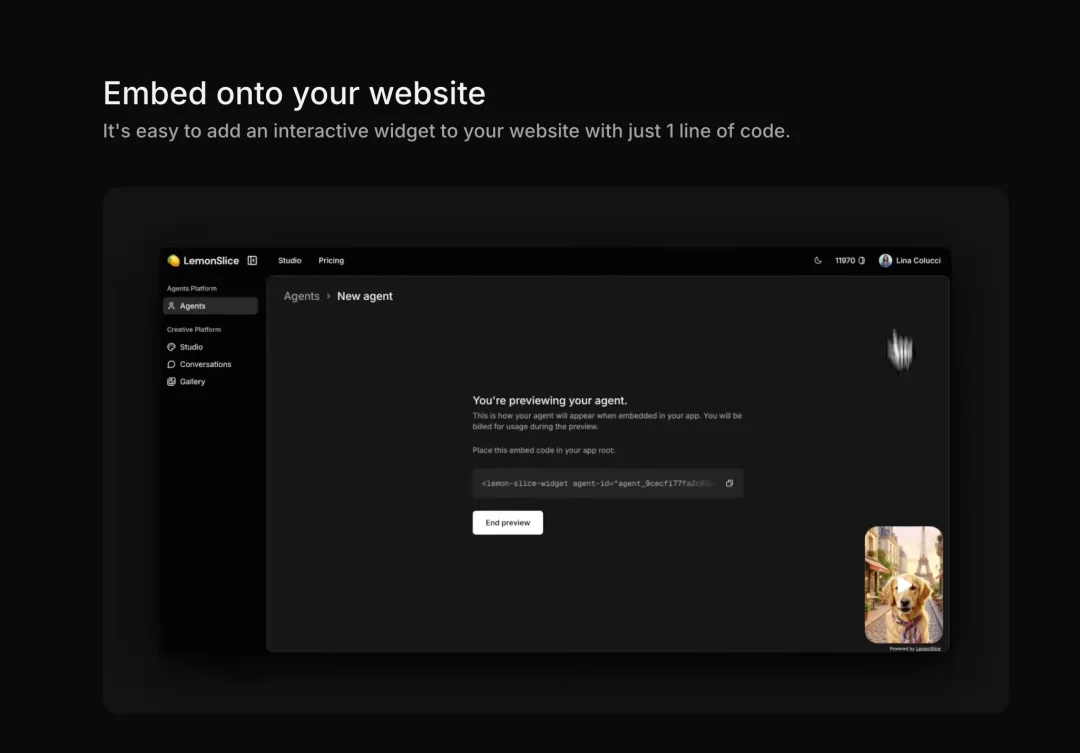

Lemon Slice 为开发者提供了两种接入方式:一个是 API,供那些想要将交互式头像深度集成到自己产品中的开发者使用;另一个是可嵌入的 widget,只需要一行代码就能在任何网站上添加一个"视频聊天气泡"。这种低门槛的接入方式,我认为会大大加速这项技术的普及。即使是没有深厚技术背景的中小企业,也能轻松为自己的网站添加一个 AI 客服头像,让客户体验到面对面服务的感觉。

为什么是现在

我一直在思考一个问题:为什么实时交互式 AI 头像技术是在现在这个时间点突破的?毕竟,视频生成、人脸动画、语音合成这些技术单独来看都已经存在多年了。我认为有几个关键因素的汇聚,让现在成为了这项技术爆发的完美时刻。

首先是大语言模型的成熟。ChatGPT 的出现让大众真正体验到了 AI 对话的魅力,但也暴露出纯文字交互的局限性。人们开始期待更丰富、更自然的 AI 交互方式。Lemon Slice 的联合创始人 Lina Colucci 提到,在生成式 AI 的早期阶段,他们就开始尝试不同的视频模型,当时就意识到视频必然会变得可交互。"像 ChatGPT 这样的工具之所以引人注目,就是因为它们是可交互的,我们希望视频也能拥有这种交互层。"这个洞察非常关键——交互性才是 AI 应用的核心价值。

其次是计算能力的提升。200 亿参数的模型能够在单个 GPU 上实时运行,这在几年前是不可想象的。GPU 性能的持续提升、模型优化技术的进步、以及各种加速框架的成熟,共同让实时视频生成从理论可能变成了现实可行。Lemon Slice 使用的因果注意力、高效缓存、CUDA 图加速等技术,都是近年来才发展成熟的。

第三是市场需求的明确。疫情期间,视频通话成为了人们工作和生活的常态,这培养了用户对"面对面"交流的习惯和期待。即使疫情过去,这种习惯也保留了下来。人们已经习惯了在屏幕上看到对方的脸,而不仅仅是打字聊天。这为 AI 头像技术创造了接受度的土壤。

Matrix 的合伙人 Ilya Sukhar 对此有个很有意思的观点:"人们与脸产生连接,而不是文字框。"他还提到,人们更喜欢从 YouTube 学习而不是阅读长篇文字。这说明视觉媒介本身就更符合人类的认知习惯。当 AI 交互也能借助视觉渠道时,自然会带来更好的用户体验。

从投资角度看,Lemon Slice 获得的 1050 万美元融资也说明了资本市场对这个方向的认可。投资者不仅包括专业的风险投资机构如 Matrix Partners 和 Y Combinator,还有 Dropbox 的 CTO Arash Ferdowsi、Twitch 的 CEO Emmett Shear 这样的行业领袖,甚至包括音乐组合 The Chainsmokers。这种多元化的投资者组合,反映出这项技术的应用潜力被不同领域的专业人士所认可。

竞争格局与差异化

在深入研究 Lemon Slice 时,我也关注了这个领域的竞争格局。AI 头像和视频生成已经是一个相当拥挤的赛道,有不少玩家在不同的细分方向发力。

D-ID、HeyGen 和 Synthesia 主要专注于从文本或音频生成讲话视频,常用于营销内容制作、企业培训视频等场景。它们的优势在于能够快速批量生成高质量的视频内容,但交互性相对较弱。Genies 专注于游戏化的个人头像,Soul Machine 则主打超写实的数字人,Praktika 聚焦于语言学习场景,AvatarOS 则在构建头像操作系统。每家公司都在自己的细分领域深耕。

Lemon Slice 的差异化在哪里?我认为有几个关键点。一是技术路径的根本性不同。大多数竞争对手使用的是针对特定场景或垂直领域优化的定制方案,而 Lemon Slice 采用的是通用的"苦涩教训"扩展方法——通过更多数据和更大算力来提升模型能力,这是在其他 AI 模态中已被证明有效的路径。Matrix 的 Ilya Sukhar 特别强调了这一点:"这是一个技术深度很强的团队,有交付机器学习产品的历史记录,而不仅仅是演示和研究。其他许多玩家都是针对特定场景或垂直领域定制的,而 Lemon Slice 采用的是通用的'苦涩教训'扩展方法(数据和算力),这在其他 AI 模态中已经奏效。"

二是实时性能的突破。Lemon Slice 强调他们是第一家真正实现生产就绪的实时交互视频的公司,而不仅仅是技术演示。虽然其他一些实验室也有实时 AI 视频的技术演示,但 Lemon Slice 是唯一一家发布了可用 API 或产品的公司。这种从研究到产品的转化能力,在技术创业中往往比纯粹的技术先进性更重要。

三是风格的灵活性。不同于那些只能处理写实人脸或只能生成游戏角色的竞争对手,Lemon Slice-2 的扩散模型方法让它能够生成任何风格的头像。你可以用它创建一个超写实的企业代言人,也可以创建一个卡通风格的儿童教育角色,或者是一个抽象艺术风格的创意角色。这种灵活性大大拓宽了应用场景。

我特别认同 Y Combinator 的 Jared Friedman 的判断。他认为 Lemon Slice 采用的视频扩散 transformer 方法是唯一能够最终克服恐怖谷的技术路径。其他基于模板、拼接或者特定场景优化的方案,质量上限都达不到照片级真实感,而通用的端到端模型理论上没有质量天花板,只要有足够的数据和算力,就能不断提升。

创始团队的独特性

在分析一家技术创业公司时,我总是会特别关注创始团队。Lemon Slice 的三位联合创始人——Lina Colucci、Sidney Primas 和 Andrew Weitz——的背景让我印象深刻,不仅因为他们的学术资历,更因为他们的多元化经历。

三位创始人都拥有博士学位,分别来自 MIT、Harvard、Stanford 和 Duke 等顶尖学府,在 AI 领域有深厚的专业积累。但让他们与众不同的是,他们同时也是终身创作者。Colucci 是芭蕾舞者、音乐家和视频博主,而 Primas 和 Weitz 则从 YouTube 早期就开始制作家庭视频。这种对视觉叙事的热爱和理解,我认为正是驱动这家公司愿景的核心动力。

这种技术能力与创意感知的结合非常罕见但又极其重要。纯技术背景的团队可能会过度关注技术指标,而忽略了用户体验的细微之处。而纯创意背景的团队则可能有好的想法但缺乏实现能力。Lemon Slice 的团队兼具两者,既能够开发出技术上领先的模型,又能够理解什么样的头像表现会让用户感到舒适和愉悦,而不是不安和抗拒。

Colucci 在采访中说的一句话让我很有共鸣:"人们与脸产生连接,而不是文字框。"这句话看似简单,但背后体现的是对人类交流本质的深刻理解。这不是一个纯粹的技术洞察,而是一个关于人性的观察。我相信正是这种对人类情感和交流方式的敏感度,让 Lemon Slice 团队能够设计出真正让人感到自然和舒适的 AI 头像。

目前团队只有 8 人,但他们计划用这笔融资来招聘工程和市场团队,同时支付训练模型所需的计算成本。在 AI 领域,计算成本是一个非常现实的考量因素。训练一个 200 亿参数的模型,需要大量的 GPU 资源和时间,这也是为什么充足的资金支持对这类技术公司如此重要。

我对未来的思考

站在 2025 年底这个时间点,我对交互式视频技术的未来有一些思考。Lemon Slice 的愿景是"所有视频最终都将是交互式的——即时生成并个性化给观看者"。这个愿景听起来有些激进,但我认为它指向了一个很可能实现的未来。

想象一下,未来的在线教育不再是录播课程,而是每个学生都有一个专属的 AI 教师头像,根据学生的学习进度、理解能力和兴趣爱好来个性化调整教学内容和方式。客户服务不再是千篇一律的回答,而是根据每个客户的历史、偏好和当前情绪来定制交流风格。新闻播报不再是单向传播,而是观众可以随时打断提问、要求深入解释某个细节的双向对话。

这种转变不仅会改变内容的呈现方式,还会从根本上改变内容的生产和消费模式。当视频可以实时生成和个性化时,传统的"制作-分发-消费"模式将被"对话-生成-互动"模式所取代。内容创作者的角色也会改变,从制作具体的视频内容,转变为设计知识库、个性和交互规则,让 AI 基于这些元素来生成无限多样的交互体验。

我也看到一些潜在的挑战。技术上,要实现真正自然流畅的长时间交互,还有不少细节需要打磨。比如如何让 AI 头像在长对话中保持表情和动作的多样性而不显得重复?如何处理复杂的多轮对话中的情绪变化和氛围转换?如何在保证实时性的同时进一步提升视频质量?

从商业角度看,计算成本仍然是一个需要关注的问题。虽然 Lemon Slice 已经优化到可以在单 GPU 上实时运行,但大规模部署时的成本仍然不低。如何在保证质量的前提下进一步降低成本,让更多中小企业也能用得起这项技术,是一个需要解决的问题。

社会层面上,我们需要思考 AI 头像普及后对人际交流的影响。当人们习惯了与 AI 头像对话,这会不会影响他们与真人交流的能力和意愿?如何确保技术增强而不是替代人与人之间的真实连接?这些都是值得深思的问题。

但总体而言,我对这个方向充满乐观。Lemon Slice 正在做的事情,不仅仅是开发一个新产品,而是在探索人机交互的新范式。就像触摸屏改变了我们与手机的交互方式,语音助手改变了我们与智能音箱的交互方式,交互式视频可能会改变我们与各种数字服务的交互方式。从文字到语音,从语音到视频,从单向到双向,从静态到动态,每一次交互方式的演进都让技术更加人性化,更加贴近人类自然的交流习惯。

Lemon Slice-2 的发布,或许只是这场变革的开始。我期待看到更多创新的应用场景涌现,也期待看到这项技术如何与其他 AI 能力结合,创造出我们现在还无法想象的体验。未来的数字世界,可能真的会像 Lemon Slice 团队所设想的那样,充满了生动的、可交互的、个性化的视频体验。而这一切,都始于一个简单但深刻的洞察:人们与脸产生连接,而不是文字框。

文章来自于微信公众号 “深思圈”,作者 “深思圈”

【开源免费】Fay开源数字人框架是一个AI数字人项目,该项目可以帮你实现“线上线下的数字人销售员”,

“一个人机交互的数字人助理”或者是一个一个可以自主决策、主动联系管理员的智能体数字人。

项目地址:https://github.com/xszyou/Fay

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales