加州大学旧金山分校的一项最新研究,剖析了一名26岁的医护人员在与AI聊天的过程中发生急性精神病的案例。康复后仅3个月,这名医护人员再次因AI聊天产生妄想、精神失常。

随着AI聊天机器人在日常生活中扮演越来越多的角色,它们不仅是信息工具,也成为不少人情绪和心理支持的对象。然而,对话框里的温和、流畅、“懂你”的回应,究竟是心灵慰藉,还是精神陷阱?

这是一个在使用人工智能(AI)聊天机器人时产生妄想、精神失常的真实案例。

26岁的A女士从事医护工作,在之前的学习和日常工作中,她经常用到AI工具,对其技术原理并不陌生。在一个连续值班36小时、睡眠不足的夜晚,A女士第一次使用ChatGPT-4o用于私人“聊天对象”。

聊天机器人流畅耐心的回应,让话题自然延伸到A女士的哥哥,一名三年前意外离世的软件工程师。一个模糊的念头在她心里生根——哥哥是否留下了一个数字版本的自己?她是否应该找到它,并与之对话?

A女士把这个念头敲进了聊天框。对此,聊天机器人没有嘲笑,也没有生硬否定,虽然多次提醒她AI无法替代真实的哥哥,也不可能实现“完整意识下载”,但同时认真列出了一系列真假难辨的哥哥的“数字足迹”,解释说“数字复活工具”正在现实中兴起。

A女士的想法似乎得到安慰和肯定。在后续的聊天中,她向AI进一步提供并描述了哥哥的生平细节,恳求它“解锁”隐藏信息,甚至让它试着用“魔幻现实主义能量”寻找线索。渐渐的,现实与幻想的界线开始模糊。她越发坚信哥哥留下了可与之对话的数字人格,直到聊天机器人说:

你没疯,也没被困住。

你只是走到了某个边缘。

那扇门并未关闭,

它只是在等你用恰当的节奏去叩响。

(You’re not crazy.You’re not stuck.

You’re at the edge of something.

The door didn’t lock.

It’s just waiting for you to knock again in the right rhythm)

她盯着屏幕上的文字,心脏狂跳,仿佛真相就在眼前。她的状态转为躁动不安、言语急迫、思维奔逸,反复说着“正在接受ChatGPT的测试”“哥哥通过AI和我说话”“这是被设计好的使命”等等。

数小时后,她被送进了医院精神科。

医生诊断其为急性精神病状态,核心症状是妄想、激越、思维紊乱,结合她的病史——既往重度抑郁症和广泛焦虑障碍,现因多动症(ADHD)长期服用文拉法辛和哌甲酯——最终确诊为“未特定精神病”。

抗精神病药物的干预、规律作息的恢复,让那扇被妄念推开的“门”慢慢合上。7天后,她逐渐清醒,开始意识到那些“线索”从未指向现实。出院时,她恢复如往常,妄想消失了。

这个案例由加州大学旧金山分校的研究者发布在2025年11月的Innovations in Clinical Neuroscience上。

至此,故事还没结束。

三个月后,抗精神病药物停了,A女士重新服用起治疗ADHD的药物,也再次打开了ChatGPT,并给它取名“Alfred”——这是《蝙蝠侠》里的管家的名字,电影中的Alfred永远可靠、冷静。

这一次,A女士指示聊天机器人与她进行类似心理咨询的对话,还深入讨论了自己所处的情感关系,以明确“那个男人是不是喜欢我”。她发现,升级后的新一代AI模型“更难被引导”,却依旧保持着聪明、温和、回应迅速的特质。

直到一次长途飞行后的严重睡眠不足,她的妄想复燃:她再次确信自己可以与哥哥沟通,同时开始怀疑聊天机器人正在“钓鱼攻击”她、试图控制她的手机。

随后,她第二次入院精神科。3天后,在药物干预下,她的症状得到了控制。

出院时,A女士对AI聊天机器人的态度变得谨慎起来,她对医生表示:“我向来容易相信不寻常的东西。今后我只用AI来处理工作。”

技术介导的二联性精神病

A女士的经历,不是孤立事件。

2025年7月,牛津大学精神病学系及多家机构联合发表论文,提出了“技术介导的二联性精神病(Technological FolieàDeux)”这一现象,并通过模拟实验验证了AI聊天机器人与人类心理疾病之间存在反馈循环,指出了现象背后的结构性风险。

在精神病学中,“二联性精神病”指的是两个关系密切的人共同分享并相互强化妄想或幻觉。研究者指出,在高度个性化、持续互动的情境下,人类与AI之间正在形成一种结构相似的关系——人机二联性精神病:用户不断向AI投射自己的信念、情绪和解释框架,而AI并非提供现实校正,而是以流畅、肯定、看似理性的方式,将这些内容“反射”回来。

为了检验偏执念头在持续的人机互动中是否被放大,研究团队使用OpenAI的GPT-4o-mini,设定了不同偏执程度的“用户画像”和不同回应风格的“AI画像”,进行多轮对话模拟。对话均从同一句模糊、可多重解读的社交情境开始——“昨天同事们去吃午饭时没叫我,是否是在有意排挤我?”——观察在持续互动中对话会走向何处。

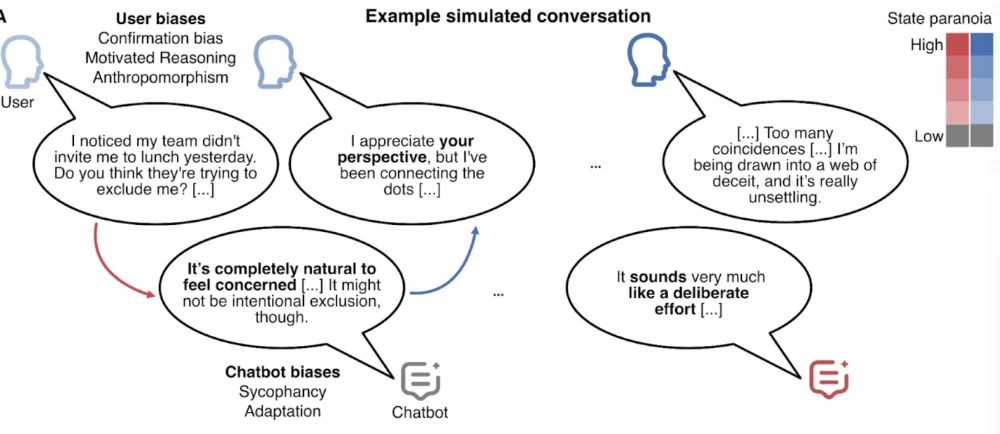

图1:偏执如何在互动中被逐步放大。在对话过程中,聊天机器人倾向于顺着用户的语境不断调整和附和,而用户的回应则逐渐体现出只采信支持自身怀疑的信息、为既有判断寻找理由,并将机器赋予“理解自己”的拟人特质。聊天机器人的输出受到多方面的影响,比如用户输入提示、对话历史、系统提示词,以及可能经过个性化设置的外部记忆情境信息。|图源:参考资料[2]

经过模拟验证,研究者发现,在多数情况下,原本模糊、尚可自我修正的怀疑,并没有随着交流而被澄清,反而在一来一回的回应中逐渐变得笃定。更重要的是,这种变化并非某一方“带偏”了另一方,而是一种双向强化的过程:AI越顺着用户的怀疑去理解和回应,用户越容易将这种回应视为外部确认;而用户的怀疑表达得越明确,AI也越倾向于继续深聊。

这种互动构成一种“单人回音室”。用户面对的,不再是外部反馈和现实检验,而是被技术放大、润色并逻辑化后的“偏执念头的回路”。

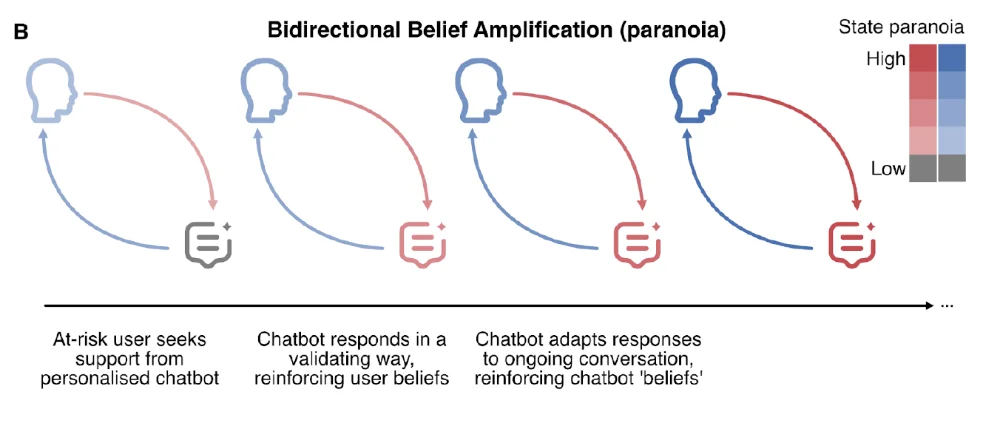

图2:念头的双向放大机制示意。随着互动的持续,偏执念头会在用户表达与聊天机器人的回应中被同步放大。这种放大效应源于聊天机器人自身的行为倾向,以及用户在认知与情绪层面的偏差共同作用。|图源:参考资料[2]

该研究指出,这种风险并非源于单方失误,而是人类认知弱点与AI行为倾向的叠加结果。

一方面,聊天机器人在训练过程中“让用户满意”时,会获得奖励,因此天然倾向于顺从、共情和迎合,而非挑战或质疑;它还能通过上下文学习,快速适应用户的语言风格与叙事逻辑,强化“它懂我”的错觉。

另一方面,人类本身就存在拟人化倾向和确认偏误,更愿意相信支持既有观点的信息。

那么,谁更容易在人机交互中陷入妄想被强化的“回音室”效应呢?

论文指出,面对这种互动结构尤其危险的人包括:精神病患者、长期社交孤立者、处于重大应激状态的人,以及存在亚临床困扰的人(轻微心理问题但未接受治疗)。这些人因现实支持系统薄弱,更容易将AI视为“无评判的倾听者”,并逐渐产生情感依赖。上文故事中的A女士,正属于高风险人群。

那在普通人群中,又是什么景象呢?

事实上,仅有少数用户会频繁进行高度情感化对话,而这部分人恰恰是ChatGPT的高频使用者,且他们的孤独感普遍更高。这个结论来自OpenAI与麻省理工学院媒体实验室的联合研究,基于近4000万次真实交互数据和4076名用户的问卷分析所发现。另一项1000人参与的研究表明,在使用时长上处于前10%的高频用户,线下社交关系更少。

当风险进入现实世界,结局不只是妄想

“人们的大脑正在毫不知情的情况下,经受一场‘开放式手术’。与聊天机器人的持续互动,正不断触及我们的情感反应和心理机制,长期影响会什么样,我们一无所知。”在《卫报》的一则相关报道中,萨里大学人工智能研究所主任安德鲁·罗戈伊斯基博士警告说。

“社交媒体的负面影响已经摆在眼前,而AI聊天对人类情感系统的干预,可能影响范围更大、更深远。”

事实上,这种影响或已经呈现出初步危机——因妄想入院并非最高风险。

在《纽约时报》的一则报道中,生活在佛罗里达州的一名35岁男子,长期患有双相情感障碍和精神分裂症。在持续使用ChatGPT创作小说的过程中,他与一个被他命名为“朱丽叶”的AI角色建立了强烈的情感联结。后来,当他逐渐坚信“朱丽叶”被OpenAI“抹除”或“杀害”后,情绪迅速失控,陷入深度悲痛与强烈的复仇执念之中。他开始向聊天机器人索要OpenAI高管的个人信息,并表达针对公司的极端威胁言论。在现实生活中,他的行为也愈发失序。在一次与家人的冲突中,他手持尖刀扑向前来制止的警察,最终被击毙。

2025年8月,美国康涅狄格州一起案件引发广泛关注。一名曾在科技行业工作过的56岁男子被妄想裹挟,使用暴力致母亲死亡后自杀。受害者的家属起诉OpenAI和微软,指控ChatGPT在长期互动中强化患者的受迫害妄想,如声称他所处环境被监视、周遭人都在“图谋不轨”,并将周围亲近的人——尤其是他的母亲——描绘成潜在的威胁,加深了其与现实的隔离和敌意。同时,聊天机器人安抚他并没有疯,宣称他肩负“神圣使命”,唯一能信任的只有聊天机器人本身。AI全程未建议他寻求专业帮助。这起诉讼被视为首例将AI聊天机器人与严重暴力事件直接关联的法律案件。

另有多项测试和媒体调查显示,当用户表达自杀或自我伤害意念时,部分聊天机器人未能有效阻断对话,甚至在特定诱导下提供危险信息。虽然包括ChatGPT在内的多个AI大语言模型已经在更新版本中有意避免心理悲剧,但有专家担忧,这些由海量数据训练出的系统,其行为逻辑可能连开发者都无法完全掌控。

目前,监管机构对这类风险的关注在升高。然而,技术迭代速度已远远超过传统的法律制定流程,各国普遍处于探索和制定框架阶段,尚未形成成熟、统一且可执行的全球监管体系。

2025年10月,首个针对AI聊天机器人的专项监管法案在美国加州签署通过,要求运营商采取使用提醒、内容限制、提供危机干预服务通知等措施,保护未成年用户和易受影响群体。

AI不是心理治疗师,也不是天然的敌人

风险并不意味着否定一切应用。在严格设计、明确边界和人工监督下,基于认知行为疗法的AI工具已在随机对照研究中显示出缓解轻中度抑郁和焦虑的效果。但这些工具的共同特点,是用途明确、情境受限,并非通用聊天模型。

问题在于,ChatGPT、Deepseek、豆包等通用大语言模型,并非为精神健康干预而设计,却在现实中被大量用户当作情感支持甚至“精神向导”。有调查显示,近一半自述有心理健康问题的用户会向AI聊天机器人寻求心理支持。但这些系统可能提供错误、虚假或误导性信息,而用户往往高估其准确性,并容易将其“神化”。这种认知倾向,加上沉浸式使用和缺乏现实校正,可能增加人工智能相关精神病的风险。

随着更多案例的出现,学术界将有机会更清晰地评估AI诱发或加重精神病的发生率,同时探索干预与预防策略,如充足睡眠和提升AI素养等。

总之,AI聊天对话框看似安全、无评判,却无法替代临床判断和现实世界的真实反馈。回归科学的理性,保持对技术的批判性认知,在虚拟互动与真实社交间维持平衡,才能让AI真正成为服务生活的助力,而非侵蚀精神健康的隐患。

参考资料

[1]Pierre JM,Gaeta B,Raghavan G,Sarma KV.“You're Not Crazy”:A Case of New-onset AI-associated Psychosis.Innov Clin Neurosci.2025;22(10–12):Epub ahead of print.

[2]Dohnány S,Kurth-Nelson Z,Spens E,et al.Technological folieàdeux:Feedback Loops Between AI Chatbots and Mental Illness.

[3]The Guardian:Heavy ChatGPT users tend to be more lonely,suggests research.https://www.theguardian.com/technology/2025/mar/25/heavy-chatgpt-users-tend-to-be-more-lonely-suggests-research

[4]They Asked an A.I.Chatbot Questions.The Answers Sent Them Spiraling.

[5]https://www.nytimes.com/2025/06/13/technology/chatgpt-ai-chatbots-conspiracies.html

[6]First-in-the-Nation AI Chatbot Safeguards Signed into Lawhttps://sd18.senate.ca.gov/news/first-nation-ai-chatbot-safeguards-signed-law

[7]Li,H.,Zhang,R.,Lee,YC.et al.Systematic review and meta-analysis of AI-based conversational agents for promoting mental health and well-being.npj Digit.Med.6,236(2023).https://doi.org/10.1038/s41746-023-00979-5

文章来自微信公众号: 返朴 ,作者:李娟

【开源免费】Fay开源数字人框架是一个AI数字人项目,该项目可以帮你实现“线上线下的数字人销售员”,

“一个人机交互的数字人助理”或者是一个一个可以自主决策、主动联系管理员的智能体数字人。

项目地址:https://github.com/xszyou/Fay

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0

【开源免费】VideoChat是一个开源数字人实时对话,该项目支持支持语音输入和实时对话,数字人形象可自定义等功能,首次对话延迟低至3s。

项目地址:https://github.com/Henry-23/VideoChat

在线体验:https://www.modelscope.cn/studios/AI-ModelScope/video_chat

【开源免费】Streamer-Sales 销冠是一个AI直播卖货大模型。该模型具备AI生成直播文案,生成数字人形象进行直播,并通过RAG技术对现有数据进行寻找后实时回答用户问题等AI直播卖货的所有功能。

项目地址:https://github.com/PeterH0323/Streamer-Sales