超过 20 家机构投资。

我们独家获悉,爱诗科技近期完成了 3 亿美元 C 轮融资,由鼎晖投资领投,超过 20 家机构参与,包括中国儒意、三七互娱等文娱行业产业方,亦庄国投、苏创投等地方国资,和 UOB Venture Management、 Lion X 基金等海外机构。

这是目前为止中国视频生成领域最大的单笔融资。

我们了解到,爱诗 2025 年底年度经常性收入(ARR)超过 4000 万美元。据他们去年 10 月的公开信息,旗下手机端 App 产品 PixVerse(海外版)和拍我 AI 的总用户数当时已超 1 亿,月活超 1600 万。

据公开报道和数据,中国背景的 AI 创业公司中,ARR 超过 5000 万美元的公司仅有数家,如 Manus、Lovart、Genspark、Heygen 等。

大部分视频生成公司或产品,如 Runway、快手可灵、生数科技、MiniMax 海螺等都主要服务相对专业的内容创作者,在 Web 端提供服务。

爱诗也有这块业务,但从 2024 年下半年,他们开始主做 C 端产品,在当年第四季度上线了移动端视频生成和分享 app PixVerse。字节旗下的即梦在同年 3 月开始内测,初期以图片生成为主;后来引起更大关注的 Sora app 则是在第二年(2025 年)10 月上线。

在模型技术探索上,爱诗的最新进展是在今年 1 月发布 PixVerse R1,它可以实时生成、且能让画面无限延续,这是自回归方法带来的特性之一。“实时 + 无限画面” 也是视频生成领域久被讨论的趋势,它可能会解锁交互式内容和生成式游戏等新体验。

PixVerse R1 上用户分享的原创互动世界

探索这一方向的公司还有 Sand.ai 和 Vivix AI。Sand.ai 由光年之外联合创始人曹越创立,曾在 2025 年 3 月开源了使用自回归技术的视频生成模型 MAGI-1;Vivix AI 由商汤前执行研究总监刘宇创立,专注 “实时交互多模态内容”。

Seedance2.0 爆火出圈后,压力传导给了其他视频生成公司。爱诗联合创始人谢旭璋告诉我们,他们也有焦虑,但从用户数据来看,Seedance2.0 对爱诗的影响并不明显:“因为视频生成的市场足够大,大家还没到需要正面竞争的阶段。”

以下是此轮融资前后,我们和谢旭璋的访谈,涉及近期的资本市场变化、Seedance 2.0 等行业进展和新竞争,以及爱诗自己的 “世界模型” 探索。

融资 3 亿美元后,继续自研模型、全球化、to C

晚点:单轮 3 亿美元创下视频生成金额记录。为什么在 25 年年底,投资市场对这个方向、对爱诗表现出这种热情?

谢旭璋:因为从注意力和收入看,视频生成都是 AI 各具体方向里增长很快的。同行也融了不少钱。(注:美国视频生成公司 Runway 于 2026 年 2 月完成 3.15 亿美元融资。)

晚点:为什么这一轮有这么多机构?是因为参与方很多,但有魄力出大钱的机构又比较少吗?

谢旭璋:去年底启动融资的时候本想融 1 亿美金,但国内外投资人想参与的比较多,就决定多融一些,储备充足弹药。

晚点:准备怎么花这 3 亿美元?

谢旭璋:继续投入研发,探索新业务,拓展全球市场。我们希望做出最好的视频模型,也把 R1 系列做得更好。

晚点:你们模型训练一次的成本是多少?3 亿美元里,会有多少用在模型研发上?

谢旭璋:研发同参数量甚至效果更好的模型,我们平均每月用的训练资源不到千卡,成本大概只有同行的 10%,今年希望能加大几倍的投入。

晚点:为什么可以比同行低?

谢旭璋:综合优势——模型架构、算法、工程、产品能力。外界解读时会希望能找到一些简单结论,但其实没有单一归因。

之前一些比我们融了更多钱的大模型公司不缺人,不缺数据,但其中多数公司依然做不出视频生成模型,说明训视频生成模型本身有难度。

晚点:但 OpenAI 这样的顶尖 AI Lab 还是可以做出来,而广义上来说,你们也是对手。

谢旭璋:确实 2024 年年初 Sora 刚发布后,大家都在说 “创业公司完蛋了”、“大厂一统天下”,“创业公司应该做应用别搞大模型了”...... 虽然外界有很多讨论,但我们内部比较坚定,要把模型能力掌握在自己手中。

Sora 出来也有一个好处。我们是 23 年就成立的,在那之前,连做视频模型创业在中国都是非共识,大家更关注大语言模型公司的进展。所以我们已经把自研视频生成从非共识坚持到它变成共识了,那何不再坚持一下呢?

晚点:这股劲儿什么时候得到释放的?

谢旭璋:24 年下半年,我们发了 PixVerse V3。当时有一个超级英雄变身的效果,在全球病毒式传播。那时我们觉得模型和应用都做对了。

晚点:当时怎么想到或试出 “模板” 这个应用形态的?

谢旭璋:我们当时想做 ToC,决定要用 “模板” 这个应用形态也是为了服务普通人。这和我们最早做这家公司的初心是符合的,只能说那时候的技术能力 ready 了。

晚点:字节是不是更能把这个事做好了?

谢旭璋:那时他们还没反应过来,给了我们机会。

晚点:如果字节现在投入更多来做视频生成的 C 端应用呢?它有流量、有产品、有模型。

谢旭璋:我们不是在做同样的事。字节流量最大的视频产品是抖音和 Tiktok,它们最主要还是做短视频消费,而我们的重点是让没做过视频的普通用户能用 AI 创作视频。新的创作者能在我们这里获得用原生 AI 创作和分发的体验。

晚点:你们在视频生成领域进行了这么多探索,你觉得哪个场景是真正能够支撑百亿收入的?

谢旭璋:其实这件事已经发生了。在美国,一个月视频生成 API 的调用量就超过了 1 亿美金,一年其实就有 100 亿人民币的 API 调用量。

晚点:你们现在还有什么在坚持的非共识吗?

谢旭璋:在 Seedance2.0 发布后继续投入模型自研,继续做全球化 ToC,继续服务普通人,这些依然是非共识。另一个就是继续投入以视频为载体的世界模型 R1。

Seedance 2.0 出现是好事,行业没到正面竞争阶段

晚点:Seedance2.0 爆火出圈,你们感到焦虑和有压力吗?

谢旭璋:我们是有焦虑。但从 2023 年成立到现在,三年里,同样的事我们经历了太多次——Sora、可灵、Veo 等等,“改变世界” 的发布太多了,“颠覆” 太多了。

从数据看,我们没受什么影响。其实 Sora 2 发布时,对我们也没有很大影响。C 端视频生成的市场比大家想象得要大得多,还远远没到直接竞争的阶段。

晚点:Sora App 已经发了快半年了。现在来看你觉得 Sora App 是一个真正的 C 端平台机会吗?

谢旭璋:至少从结果来看,Sora App 的留存显著不如 PixVerse。

晚点:根据 SensorTower 的第三方估测,Sora App 的 30 日留存是 8%,你们的留存是多少?

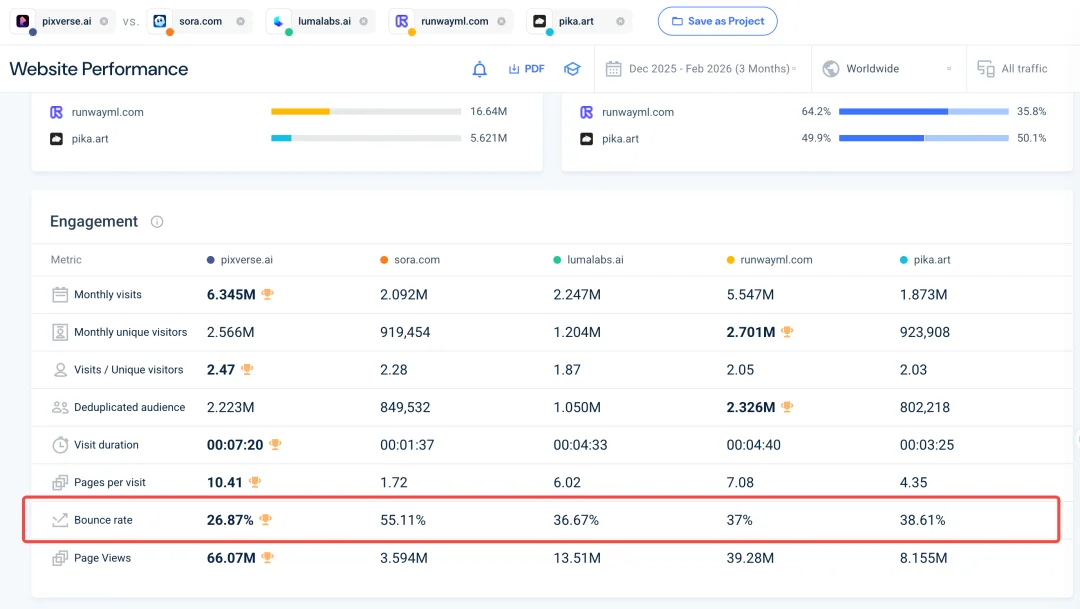

谢旭璋:在 Similarweb 上能看到我们的 Bounce rate 比 Sora 低。Bounce rate 数值低,代表用户愿意在你的网页上去尝试。从第三方平台的数据来看,我们的 App 和网页留存都是行业内最高的。(注:Bounce rate 是在选定时间段内,仅浏览网站单一页面后离开的访客占比。简单说它代表用户打开 App 后,没有进行有意义的互动就立刻关掉会话的比例。)

晚点:有了 Seedance 2.0,字节的即梦有可能成为一个 “更成功版的 Sora App” 吗?

谢旭璋:据我们了解,过去半年到一年,即梦主要的用户群体还是专业用户。Seedance2.0 之后它会不会还是这样,可能也要一两个月之后才能知道。Sora app 刚出来的时候,很多人都觉得它是 Super App ,但这在一个月后就被证伪了。

还有一点,即梦做中国市场,我们做全球市场。Seedance2.0 是一个很好的模型,但会不会诞生下一个 Super App?未必。

晚点:你们自己的核心用户画像是什么?

谢旭璋:我们的用户群体里有很多是第一次用 AI 做视频的人。全球有几十亿人看视频,这中间有不到 10% 的视频创作者,而剩下 90% 的人也有表达欲。我们想用 AI 帮他们变成创作者。

晚点:你们也在同时服务 B 端专业内容制作者,这和 C 端产品的关系是什么?

谢旭璋:C 端占大头,B 端的专业内容制作业务也在增长,比如今年我们在漫剧这类行业里有明确的收入增长。

可以交互的视频出现会改变内容生产逻辑

晚点:爱诗节前新发布了 “世界模型 PixVerse R1”,它是一个可以实时生成的视频生成模型,这是真的 “世界模型” 吗?有人质疑这是蹭概念和热点。

谢旭璋:行业内关于世界模型的实现有多条技术路径,Sora 发布时叫 World simulator(世界模拟器),Runway 也发布过以视频为载体的世界模型。我们对世界模型的定义更通俗地说,是让 AI 通过学习足够多事物运行的规律,产生一个可预测模拟物理、因果、时空等规律的模型。

在这个大方向上,有的公司会通过视频、3D、机器人等等来实现。那我觉得,我们的模型学习视频代表的客观的世界,构建一个虚拟世界,也是一个非常重要的技术路线。

晚点:我们看到 R1 模型的效果视频,用户发一段提示词想和画面互动的时候,画面会被比较生硬地改变,且只能持续几秒,几秒之后又会变回原来的状态。这是你们满意的效果吗?

谢旭璋:R1 模型有很多使用场景。我们有一些稳定的故事线,也有一些完全发散的,是根据不同场景进行设计的。模型本身是一个完全开放、有无限可能的模型,但还处于比较初步的阶段。

晚点:为什么你们要投入 “实时” 和 “无限生成”?

谢旭璋:我们团队一直在做一些前瞻性尝试。2023 年大家都在卷语言模型,我们就开始做视频了;后来瞄准 ToC 市场做 AI 模板,当时也少有人做。现在的实时生成也是一样,我们想探索视频大模型还能怎么落地,想走出一条新路。

至于 R1,是因为我们判断,未来视频和游戏的边界一定会越来越模糊。一旦视频变得能交互了,全新的内容、用户和创作机会就会涌现,所以我们必须提前布局。

晚点:可交互的视频生成,具体能带来什么新机会?

谢旭璋:在 R1 里,创作和消费是融为一体的。看视频的人就是创作者,比如通过消耗 Token 来参与互动。以后大家看到的视频,可能基础框架一样,但具体画面和走向会跟着个人的喜好实时变化。这会给现有的内容消费模式带来实质性的改变。

晚点:有多少人想一边看视频一边创作?会不会大部分人只想安安静静看个视频,休息一下呢?

谢旭璋:很多用户他也有一些希望让别人看到的想法,也许通过视频生成能让别人看到他心中的画面。用户也更乐于去分享这样的内容。

晚点:R1 模型现是一个单独的 web 端产品(https://realtime.pixverse.ai),合适会用到你们的移动端产品上?

谢旭璋:它目前是一个单独的产品线。我们会尝试移动端的形态,同时也在考虑把 R1 进一步迭代成 AI 原生视频游戏引擎。

晚点:R1 发布后,有哪些行业的 B 端客户来找你们合作?

谢旭璋:游戏行业比较多。最近谷歌的 Genie 3 冲击了传统游戏引擎,R1 也可能用 AI 原生模型重构游戏的底层创作。它可能会成为 AI 游戏引擎的核心底座。以后的游戏开发不用再像过去那样熬漫长的大周期了,无论是玩法、画面还是剧情,AI 都能让它变得更轻量、更具想象力。更重要的是,它能帮那些不懂代码但有创意的人,把点子变成真正的游戏。

同时,短剧、漫剧团队也在积极找过来。以前的视频都是拍好再分发给观众;但想象一下,以后看短剧,主角是去当 “赘婿” 还是创业,剧情能让观众自己选。一旦视频变得可交互,整个内容产业的底层逻辑就变了。

我们自己还是会专注底层技术,期待与游戏、影视、智能设备等行业的合作伙伴共同探索,在这个模型上做出第一个有意义的产品。

文章来自于微信公众号 “晚点LatePost”,作者 “晚点LatePost”

【开源免费】OWL是一个完全开源免费的通用智能体项目。它可以远程开Ubuntu容器、自动挂载数据、做规划、执行任务,堪称「云端超级打工人」而且做到了开源界GAIA性能天花板,达到了57.7%,超越Huggingface 提出的Open Deep Research 55.15%的表现。

项目地址:GitHub:https://github.com/camel-ai/owl

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0