AI视频生成已能「画得像」,但不会「想得对」。VBVR推出百万级视频推理数据集,首次系统评测模型对空间、物理、逻辑和抽象的推理能力,发现顶尖模型通过率仅68%,暴露其缺乏真实认知,推动视频AI从「视觉模仿」迈向「智能推理」。

近年来,视频生成模型在视觉质量、时序一致性和文本对齐等方面取得了显著进展,从最初的模糊光影到如今足以乱真的好莱坞级画面,「视觉质量」的竞争已趋于白热化。然而,一个被长期忽视的深层命题逐渐浮出水面:视频模型真的「理解」它所创造的世界吗?

现有研究和评测体系,更多聚焦于「好不好看」「像不像」,而视频中真正与智能相关的能力——对空间、物理、逻辑、因果与抽象规则的推理——却长期缺乏系统性刻画。一个核心瓶颈在于,视频推理领域至今缺少一个规模足够大、任务覆盖足够全面、且评测可验证、可复现的数据集与基准。

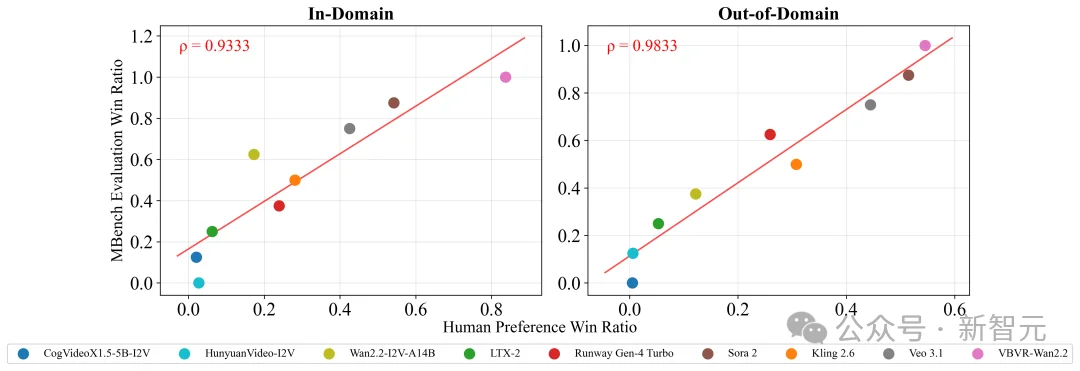

近日来自NTU、CMU、斯坦福、UCB等32所高校的研究员联合提出 VBVR(Very Big Video Reasoning),并不是一个单点 benchmark,而是一套一次性补齐所有短板的面向视频推理研究的完整基础设施。

论文链接:https://arxiv.org/pdf/2602.20159v2

视频链接:https://www.youtube.com/watch?v=isnyV_BDgBE

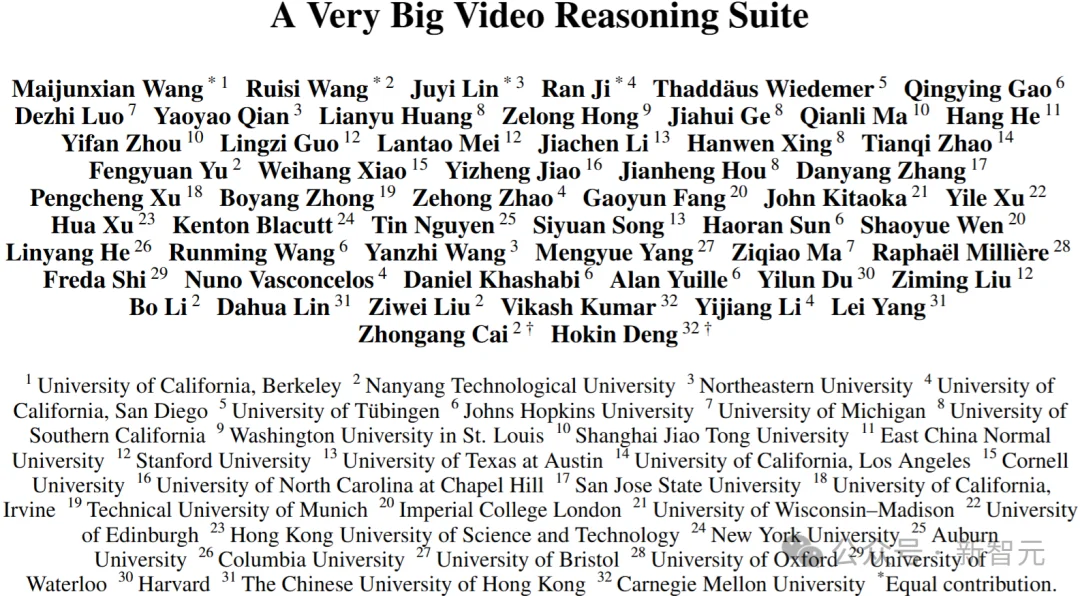

图片1 VBVR 概览。 左侧:网格展示了覆盖认知架构的代表性任务,并根据其对应能力进行颜色编码:空间性(Spatiality)、变换(Transformation)、知识(Knowledge)、抽象(Abstraction)和感知(Perception)。在网格中心,展示了 VBVR(2.015M 样本) 与其他 九个数据集总和(12.8K 样本) 的规模对比:圆的大小按比例绘制。右上:在域内(in-domain)和域外(out-of-domain)评估中的扩展行为(scaling behavior)。右下:基于五种认知能力的基准性能表现。

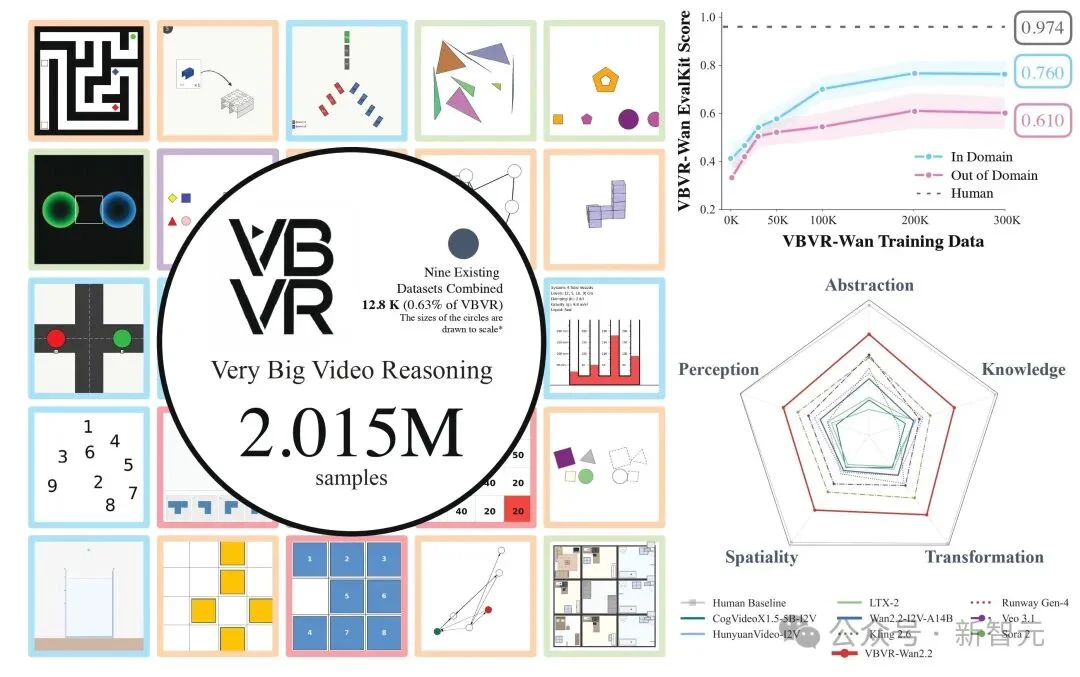

图片2 VBVR-Dataset 的示例任务实例,按五种认知能力进行组织。每个序列展示了为得到有效解所需的结构化推理过程。这些任务通过生成器实现,支持可扩展的实例变化。

在规模层面,VBVR-Dataset 的数字很醒目:200 个任务、2,015,000 张图像、1,007,500 个视频片段,约为既有同类资源的三个数量级。本文还特别设置了公开任务与隐藏任务,用于后续排行榜评估,避免基准被过度「刷榜化」。

研究团队根据人类认知理论,将视频推理能力划分为六大核心支柱(Pillars),涵盖 200 个精心设计的任务。同时这个数字随着社区的不断贡献还在增长,每一类都对应可参数化的任务生成器,能够持续采样新实例:

VBVR-Bench 的核心主张是:视频推理评测应从「模型当裁判」(LLM-as-a-Judge)的主观评估范式,转向基于规则的可验证评分机制。在该基准中,每一个测试任务都配套明确的任务规则与加权评价指标,评估维度涵盖目标识别、路径合法性、执行效率、时序一致性以及逻辑有效性等关键因素。

这种设计带来的首要优势是,

完全可复现:对于同一模型输出,在相同规则体系下应始终得到稳定一致的评分结果,不会因评审模型的温度设置、提示词差异或上下文变化而产生波动。

深度诊断能力:它不仅能给模型打分,还能通过分析五大认知支柱(感知、空间,知识、变换、抽象)下的细分表现,揭示出模型在不同认知能力之间的相互依赖与权衡。研究者能够准确定位模型失败的具体原因,例如是目标识别错误、路径规划违反约束(如穿越障碍),还是由于生成视频抖动而导致的任务完成失败。

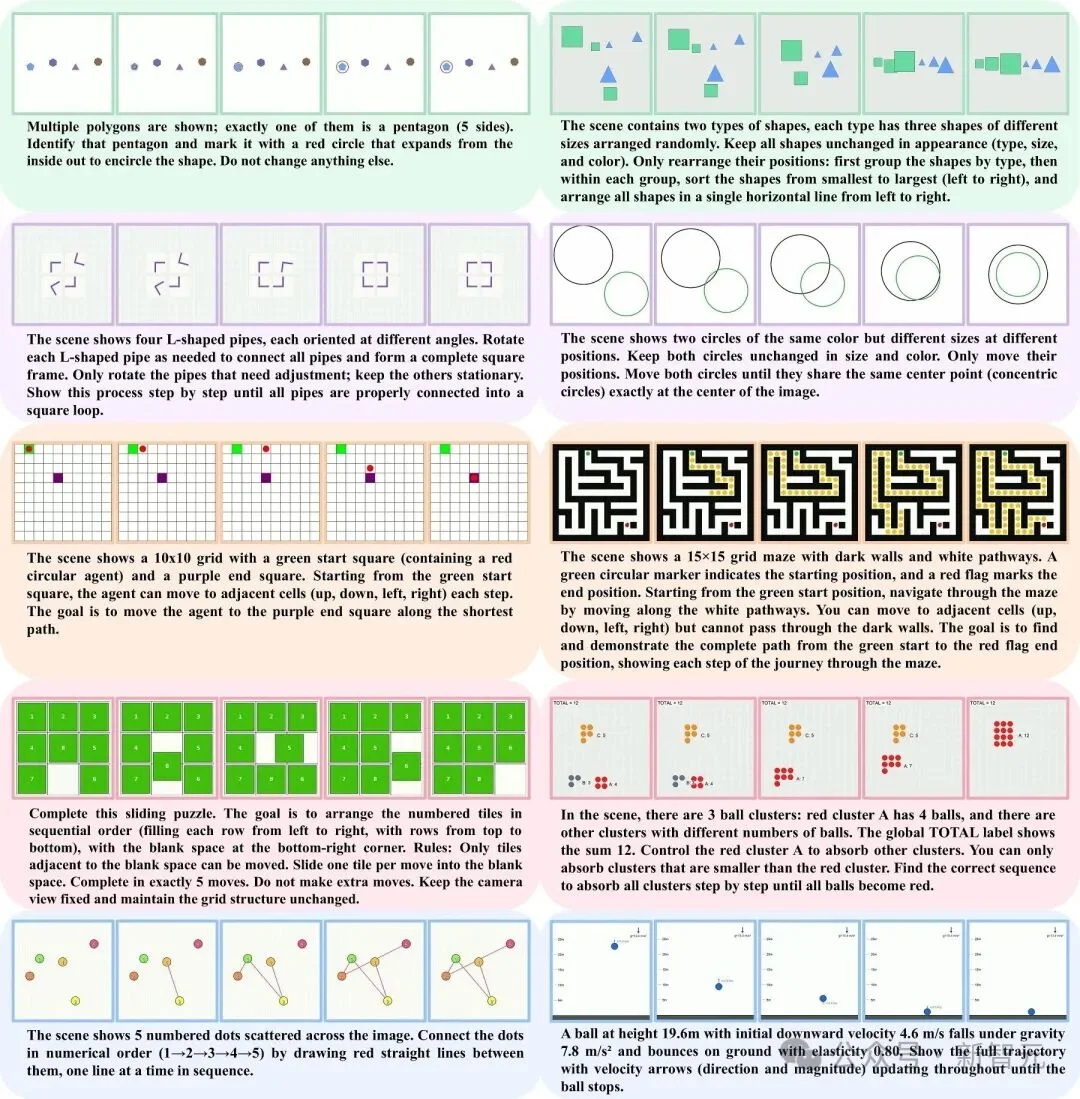

为了验证这种自动化规则评分是否靠谱,研究团队进行了人类偏好对齐实验。结果显示,VBVR-Bench 的自动化评分与人类判断的 Spearman 相关系数超过了 0.9,证明了规则评分的权威性。

图片3 人类偏好对齐分析:VBVR-Bench 自动胜率与人工偏好胜率呈高度相关。

推理能力的 Scaling Law (规模化规律)

实验揭示了明显的规模效应,在基础模型Wan2.2-I2V-A14B上利用VBVR-Dataset 上微调后,得到的VBVR-Wan2.2模型在基准上实现了取得了显著性能提升。

从0.371跃升至0.685整体相对提升达到84.6%,并在多个能力维度上超过当时的主流专有模型。

泛化能力的「早期信号」

虽然域内与域外任务之间存在性能差距,但研究观察到随着数据规模扩大,模型开始表现出向未见过任务迁移推理能力的趋势。这意味着模型不仅仅是在记忆模式,而是在逐步内化某些通用的物理或逻辑规则。

这种性能提升并非可以无限持续。随着训练,域外任务与域内任务之间仍然存在约15%的泛化差距。

也就是说,仅依赖于「增加同类型数据规模」虽然能够带来显著性能增益,但仍不足以完全弥合系统性的泛化鸿沟。论文因此反复强调一个重要结论:规模化能够显著提升性能,但其效果仍然受到结构性上限的限制。

研究人员希望VBVR-Dataset也能够为下阶段研究提供一个实验土壤,社区可以以此为基础,进行架构层面的改造,例如显式状态跟踪、结构化推理模块、和自校正机制。

场景可控性是可验证推理的先决条件(Controllability before reasoning):通过定性分析发现,领先模型的高分本质上源于其极强的「约束执行」能力。

相比于基础模型在生成时会随意重写背景或物体标识,导致中间状态不可验证VBVR-Wan2.2展现出了一种「外科手术式」的精确度:它能严格遵循指令执行删除、旋转或多步操作,而不对画面其他元素产生任何意外扰动。

这种「非必要不修改」的确定性证明,模型已开始摆脱随意的「视觉脑补」,转而学习在物理规则的框架内进行受控演进。

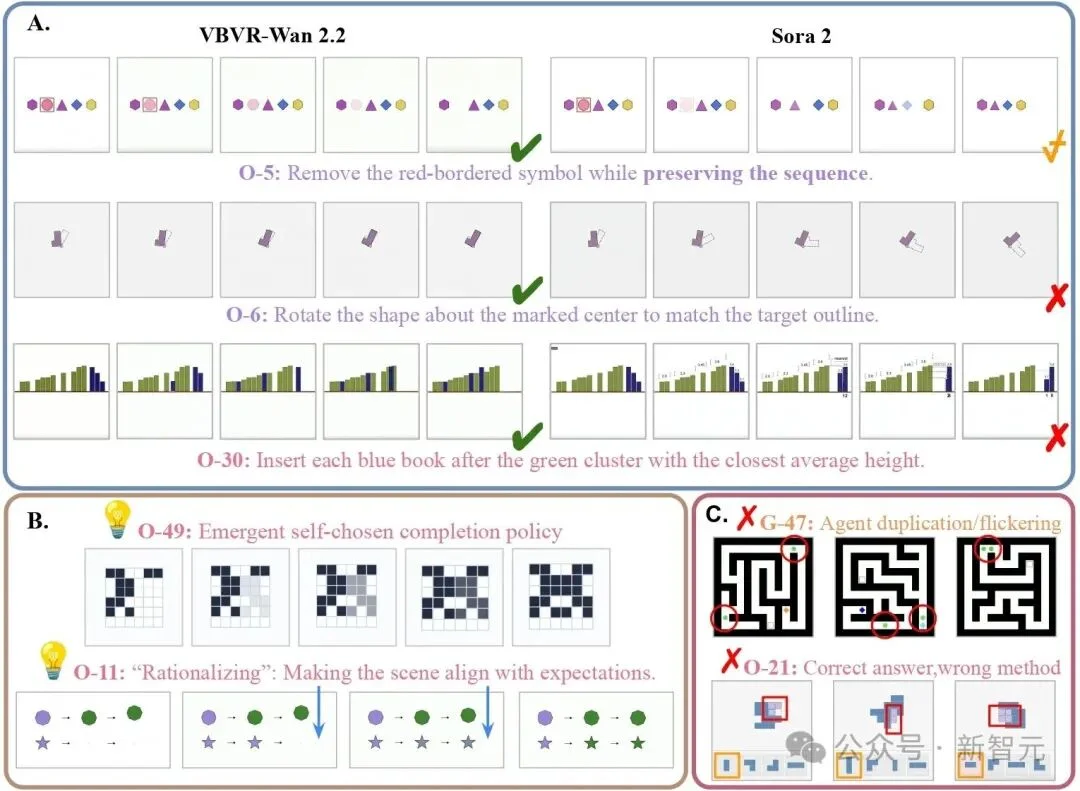

图片4 域外任务的定性概览:部分A展示了VBVR-Wan2.2与Sora 2在三个任务上的同任务、同样本对比;部分B展示了VBVR-Wan2.2在完全没见过的任务上的涌现现象; 部分C展示了VBVR-Wan2.2在任务上的实际边界。即使在改进后,模型仍可能在长生成任务中仍会出现一些问题,例如结果看似正确,但中间步骤并不遵循真实决策逻辑。这类「答案对了、过程错了」的现象,正是下一阶段视频推理评测必须继续强化的部分。

VBVR团队坚信,开放与共享是推动视频推理社区发展的基石。

VBVR-Dataset的百万级视频数据已向社区全量公开。

不仅如此,各个任务的参数化生成器代码以及高效的DataFactory云端架构也将同步开源。

基于云端无服务器的架构系统( AWS Lambda)支持多达990个节点并行作业,仅需2-4小时即可完成百万级数据的生产,且单次运行成本控制在800-1200美元之间,实现了极高的数据生产效能。

参考资料:

https://arxiv.org/pdf/2602.20159v2

文章来自于“新智元”,作者 “LRST”。

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0