专门为短剧、动漫和影视内容创作训练的垂直模型,长什么样?

2026 年春节档,一个数据很震撼:据 Monnfox 统计,AI 漫剧播放量突破了 25 亿次,占短剧大盘近 30%。

去年这个时候,AI 漫剧还是「看个新鲜」的东西,大部分人刷到了会觉得画面有点怪,动作有点僵,没什么意思,看两秒就划走了。

但今年,整个 AI 漫剧市场的规模、日均上新数量、用户规模都开始大幅增加,赛道已经过了「能不能做」的阶段。

因此,一个很现实的问题也就随之出现了。

通用视频模型虽然越来越强,但放到漫剧和短剧的具体场景里,还是有些短板存在。这些问题,很难靠「把通用模型继续做大」来解决。它们更多是因为,通用模型在训练的时候,就没有针对这些场景做过专门的优化。

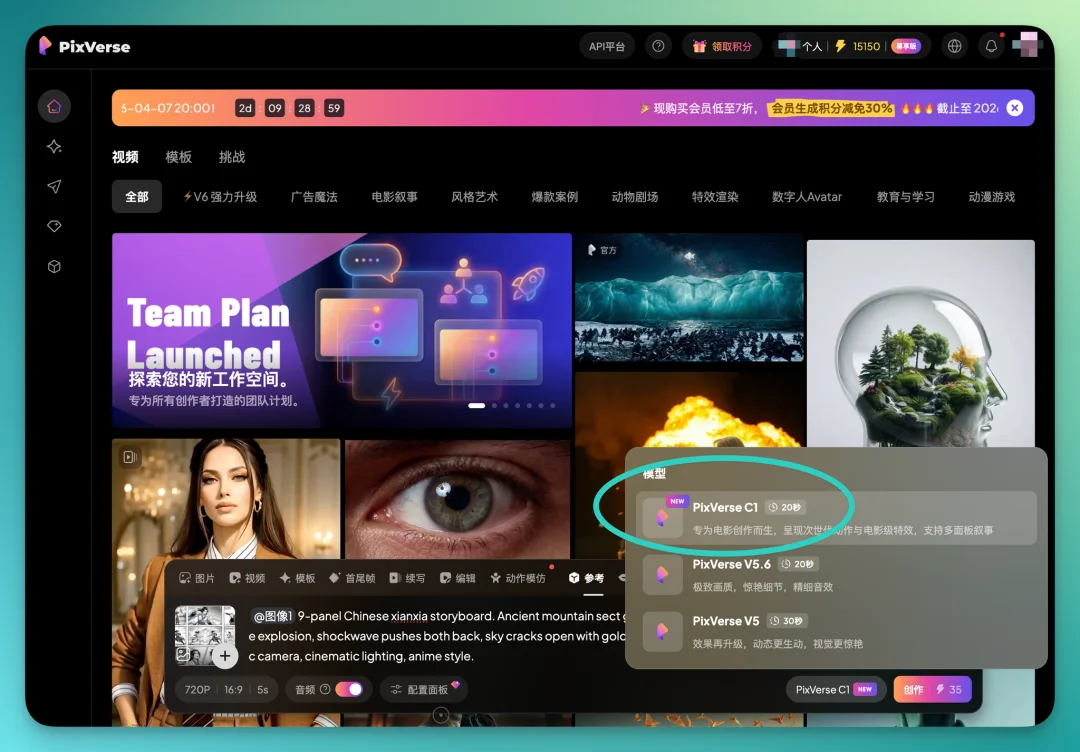

也正是在这个背景下,2026 年 4 月 8 日,爱诗科技(PixVerse)发布了 C1,一个定位很明确的模型:全球首个影视行业大模型,专门为短剧、动漫和影视内容创作训练的垂直模型。

接下来,先从 PixVerse 最近密集发布的模型说起,聊聊 C1 在它们产品线里到底是什么位置,之后分享我们的实测。

如果你关注 AI 视频这个领域,会发现 PixVerse 从 2025 年下半年开始,发布节奏快得有点密集。

先简单过一遍。

2025 年下半年,V5 系列连着迭代了好几个版本。V5 本身是通用能力的一次大升级,动效、高清画质、角色一致性、提示词遵循都拉上来了,我们在《PixVerse V5 突袭上线,我们在「拍我AI」上第一时间深度实测》中详细体验过。V5 Fast 把 1080P 视频的生成时间压到了 30 秒以内。

到了 12 月,我们在《实测拍我AI V5.5:发现AI视频创作不需要复杂“工作流”了》一文中,发现 V5.5 做了一个比较关键的事情,第一次支持分镜加音频的一键生成,算是从「生成一条视频」走向了「讲一个故事」。

2026 年 1 月,R1 来了。定位是全球首个通用实时世界模型,简单说就是视频生成从「等结果」变成了「实时互动」,用户可以在画面生成的过程中改变方向。这跟 V 系列的逻辑完全不一样,走的是交互式体验。

2 月,V5.6 在 Artificial Analysis 的 i2v 和 t2v 两个榜单上,都拿到了全球第二,仅次于 Seedance 2.0。

然后 3 月 30 日,发了 V6 模型。

V6 是通用旗舰的又一次大升级,角色真实感、复杂运动、物理模拟、音视频同步全面拉满,最长支持 15 秒生成。

之后的 C1 ,则是另一个方向。

它跟 V6 没有衍生关系,也不是在 V6 基础上微调出来的。C1 是爱诗科技独立训练的垂直行业大模型,针对打斗动作、术法特效、多宫格分镜这些场景做了专项优化。

这也是爱诗科技第一次针对某个具体行业,单独训了一个模型。

下面是我们用 C1 做的几个实测,覆盖了它最核心的几个能力。每个 Case 都附上了实际使用的 Prompt。

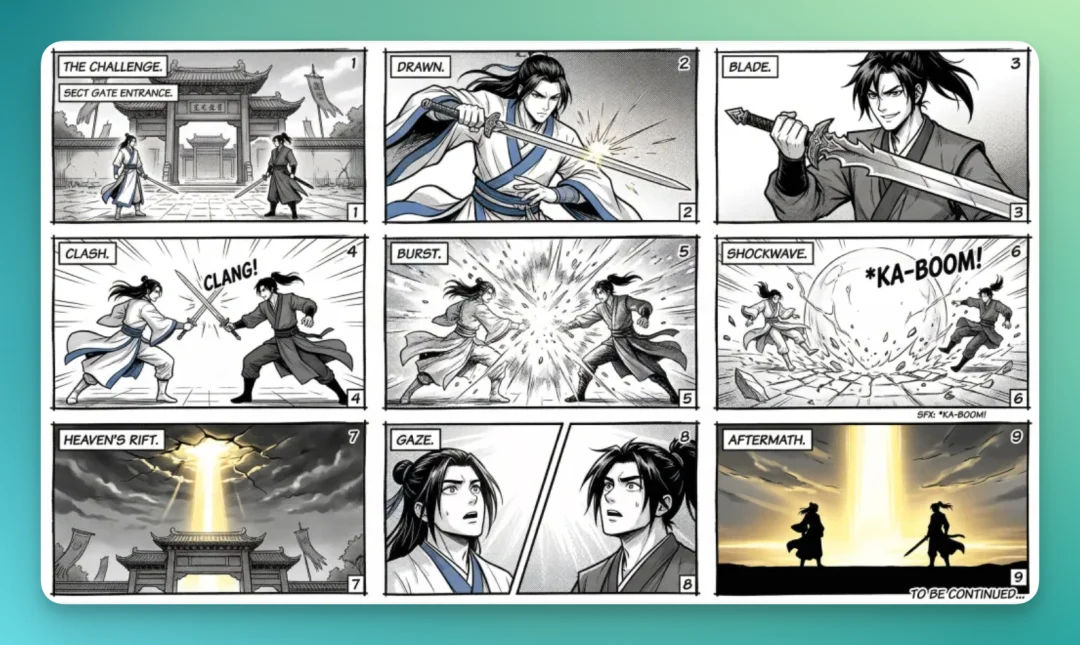

多宫格分镜直出,是这次 C1 的一个核心能力。

你可以直接丢一张九宫格的 AI 漫剧图进去。模型会自己去读里面的画面关系,理解每一格在讲什么,然后把这些分镜串起来,自动生成一条完整的视频。基本不需要你再去手动拆镜头或者补逻辑。

操作也很简单。输入框里选 C1 模型就行。分辨率最高支持到 1080P,时长最长 15 秒。音频是一起生成的,不用额外处理。整体就是一套从图到视频的直出流程。

我试了一张古装玄幻风的 9 宫格分镜图,每一格分别是:远景山门、两人对峙、拔剑出手、剑气碰撞、冲击波扩散、角色后退、天空裂开、光柱冲天、最后定格。

对了,这一整套图也可以直接在 PixVerse 里生成,里面同样提供 Nano Banana Pro 模型。

然后你可以直接把这张图传给 C1 作为参考,提示词如下:

古代山门宗派入口,两名修士对峙,拔剑相向,真气碰撞产生粒子爆炸, 冲击波将双方震退,裂开一道金色光柱,最终以人物在发光天空前的剪影定格。 动态镜头,电影级光影,动漫风格。

出来的效果还不错。每一格之间的衔接是顺的,角色的服装和配色在不同分镜里也能保持一致。

运镜节奏有变化。对峙是慢推,碰撞瞬间会加速,最后光柱给了一个慢慢拉远的大全景。

有几个画面做得挺好。比如剑碰撞那一下,画面有轻微震动,光粒子会往外散开,有那种漫剧常见的粒子感,也比较接近日漫、国漫里的表现。

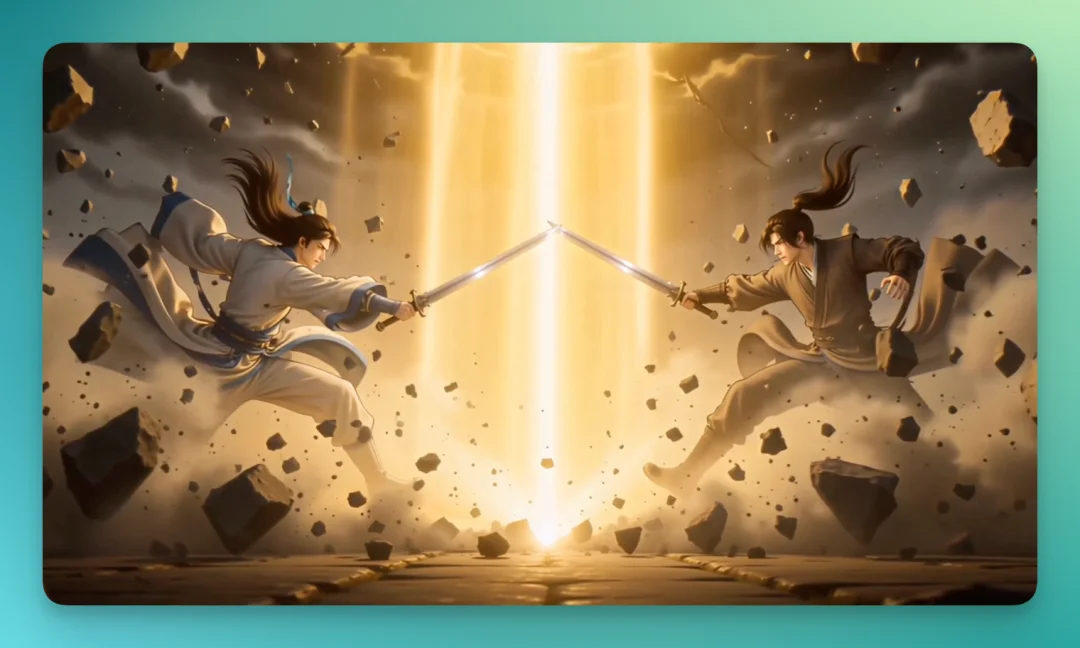

再比如这种术法效果,这一块也是 C1 这次比较明显的能力。

两个人对拼之后,天空里直接拉出光柱。能看到碎石被带起来,画面有震动,角色脚步也有切换。整体更接近漫剧那种表现逻辑。

C1 这次还有一个比较明显的点,不只是术法效果,打斗动作的连贯性也做得更稳。包括一些基础的物理感,还有打斗里的特效表现,整体都还可以。

比如我写了一段偏古典武侠的提示词,不走仙侠,是那种更写实一点的风格。

画面整体偏暗,有电影感。设定是两名双胞胎武者,兄弟反目,在雨夜屋顶对战。主要是剑招来回对拼,同时会有光粒子、水滴这些细节,以及人物表情的变化。

提示词如下:

两名双胞胎武者,反目成仇,在雨夜的屋顶上激烈对战。快节奏的剑法,一人快速挥剑攻击,另一人格挡并以旋踢反击。每次碰撞时,雨水溅起。慢动作捕捉刀刃相撞的瞬间,随后恢复正常速度。电影式武侠风格,昏暗忧郁的光影。

两个角色的空间关系一直是稳定的,没有出现穿模。雨点在打斗里的飞溅也比较自然。

做了一个快转慢的升格处理。剑刃碰撞那一帧放慢,雨滴悬住,然后再恢复正常速度。

这段里有几个点比较明显。角色表情更细了,尤其是一些微表情,比如皱眉。水滴打在脸上的效果也做出来了。再加上光影和高亮的变化,整体会更真实一些。

C1 模型其实支持多种漫剧形式,像 3D 漫也可以做。

我是在上面那段视频的提示词基础上改了一下设定,不再要求是双胞胎,而是换成两名不同形象的武者,同样放在屋顶上对战。

在 3D 漫这个场景里,人脸表情其实比二维漫更难做,但 C1 这次的表现还可以。

如果仔细看,能看到光粒子和水滴迸开的细节,尤其是打到角色发丝上的效果会更明显。再往下看,连两个人握剑的状态都做出了区别,比如剑柄的造型不一样,手上的青筋也能看到。

甚至再仔细看一点,会发现动作细节也做出来了。

比如白衣武士后踢腿的时候,会顺带带出一层水雾。后面两个人在屋顶移动时,几乎每一步都会把脚边的水雾带起来。

短剧里的术法特效,是现在 AI 战斗漫剧里一个很关键的吸引点。前面也能看到,C1 在这块是做了强化的,这次可以专门看它处理高强度的光影和偏魔幻的术法效果。

比如我写了一个场景:三名修士在燃烧的寺庙里,对抗一个巨大的火焰恶魔。这个场景里需要有冰盾这种技能。

C1 对这类术法的“理解”和推理还可以,比如让一个修士施展冰盾,再叠加雷电效果,去和恶魔的火焰做碰撞。

提示词如下:

三名修士在燃烧的寺庙中与巨大的火焰恶魔激战。 一名修士施展冰盾,绿色衣服修士挥舞发光的长矛扑向恶魔从空中发射闪电。 恶魔挥动巨爪,击碎冰盾。碎片四散,火焰粒子飘浮空中。史诗般的动漫战斗,动态的镜头角度。

做好的视频如下:

仔细看,虽然还是有一些小瑕疵,但整体术法效果是成立的。比如冰盾和恶魔碰撞时的碎裂感,绿色修士挥动长矛时带出来的光焰效果,还有空中闪电打下来时带动的场景变化,整体都做得不错。

尤其是修士在空中释放闪电那一段,整体看起来很有冲击力。

当然,上面这个视频里还是有一些小瑕疵。这也是用 C1 做这类 AI 漫剧时常见的问题。而且这些问题后期很难靠剪辑去修,因为画面本身就是生成出来的。

不过 PixVerse 本身就有一个配套能力,叫 Edi,本质是一个视频后处理工具。

简单说就是,你生成了一条视频,整体效果大概有个 60-70 分,某些地方有小问题,比如多了个不该有的元素,或者角色手里的道具想换一个。这时候不需要重新生成,直接用 Edi 在原视频上做修改就行。

把上面这些实测放在一起看,往回拉一层,有几个事情值得聊一聊。

【1】第一个,垂直模型的出现,说明 AI 视频赛道开始「分工」了。

过去两年,所有的 AI 视频模型都是在通用性上深耕,这条路在早期是对的,因为基础能力需要先拉到一个水位线以上。但当头部的通用模型都拉到 90 分以上之后,剩下那 10 分的提升变得越来越难。

而每个具体行业,都有自己的「那 10 分」。

漫剧需要的是打斗流畅度、特效真实感、分镜一致性,这些和通用模型追求的「画面美感」「运动自然」并不完全重合。C1 的出现,某种程度上是在说:通用模型做到 90 分之后,接下来的竞争,可能在垂直场景里。

【2】第二个,AI 漫剧的生产是「工业流水线」。

在 AI 漫剧领域里,很多实际操作的人,感受最深的大概率是工作流的变化。以前做一集 AI 漫剧,得一条一条视频单独生成,再一条一条检查、筛选、剪辑,整个流程非常碎片化。

C1 的多宫格分镜,本质上是把「视频生成」和「分镜逻辑」合到了同一步里。再加上 Edi 的后处理能力等等,一条从生成到修改到批量调用的工具链,正在成型。

对于那些日更几十条甚至上百条短剧的团队来说,这套工具链的价值,远比某个单项能力的提升要大得多。

顺带提一句,C1 目前有一个限时免费体验的窗口:4 月 7 日到 4 月 17 日,国内外 Web 端都可以直接免费使用 C1 的全部功能。API 客户在上线后 7 天内还能拿到 8 折。感兴趣的话,这个时间窗口可以去试试。

回到聊的那个事情。

AI 漫剧赛道现在不缺热度,大家的注意力已经不在「AI 能不能做漫剧」这个问题上了。

真正的问题是:谁能把这个赛道的生产效率,拉到下一个水位线?

C1 给出的回答简单直接:直接针对行业场景单独训练模型,把打斗、特效、分镜这些最痛的点一个一个解决掉,再配上后处理工具和 API 接口,形成一套完整的工具链。

这条路能走多远,最终取决于它在真实生产环境里的表现。但至少从目来看,AI 漫剧专属模型,在漫剧短剧这个赛道里,确实有一些别人做不了的东西。

AI 漫剧的竞赛,可能刚刚进入下半场。

文章来自于"十字路口Crossing",作者 "镜山"。

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0