对本地部署玩家,尤其是Mac用户来说,长上下文推理最大的痛点往往不是“模型不够聪明”,而是稍微多用点上下文,统一内存就被撑爆了”,这一点在最近的Gemma-4 31B的部署中尤为明显,在同等上下文的情况,显存占用比Qwen3.5-27B高约一倍不止,直接劝退了不少人。但好消息是,谷歌近期提出的TurboQuant KV缓存量化算法,正是为了解决这个痛点而生。

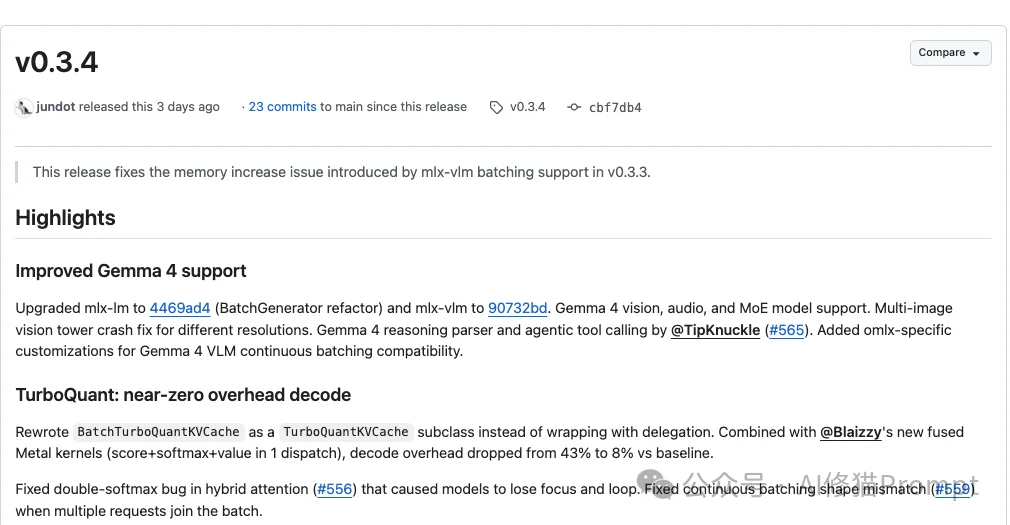

oMLX框架近期通过连续几次硬核版本迭代,正式引入并优化了这一特性。我的实测与社区反馈汇总显示:在搭配原生支持超长上下文的Gemma-4模型时,TurboQuant并不能让你的模型智力飞跃或速度暴涨,但它能把原本根本跑不动的128K甚至256K极限长上下文,硬生生拉入“能用、敢开、可持续实战”的区间。

不过,它的收益高度依赖于你使用的上下文长度、框架版本以及具体的推理负载。本文不喊改变行业的口号,只通过实测数据与技术脉络,把三件事说透:它到底是什么,在oMLX里怎么开,以及长上下文场景下的实测表现究竟如何。

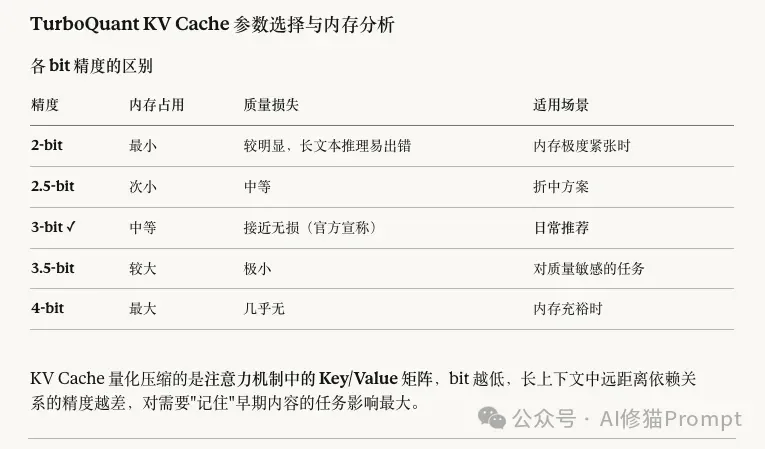

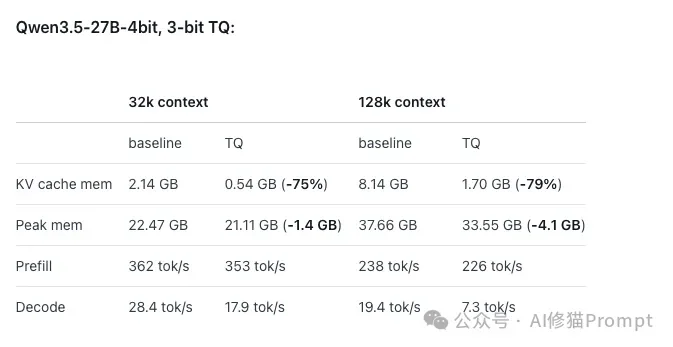

在讨论怎么用之前,我们需要先纠正一个常见误区:TurboQuant不是用来压缩模型权重的(比如常见的Q4、Q8量化),它是专门针对大模型运行时的KV缓存(KV Cache)进行极高效压缩的算法。

我们之所以要把Mac(Apple Silicon)、oMLX框架和TurboQuant+Gemma-4模型绑在一起讨论,是因为这个组合精准踩中了当前本地部署的几个极限挑战:

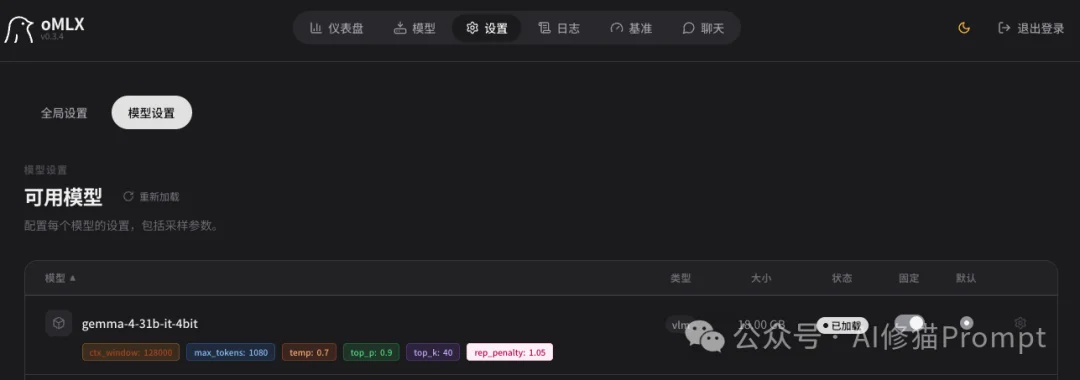

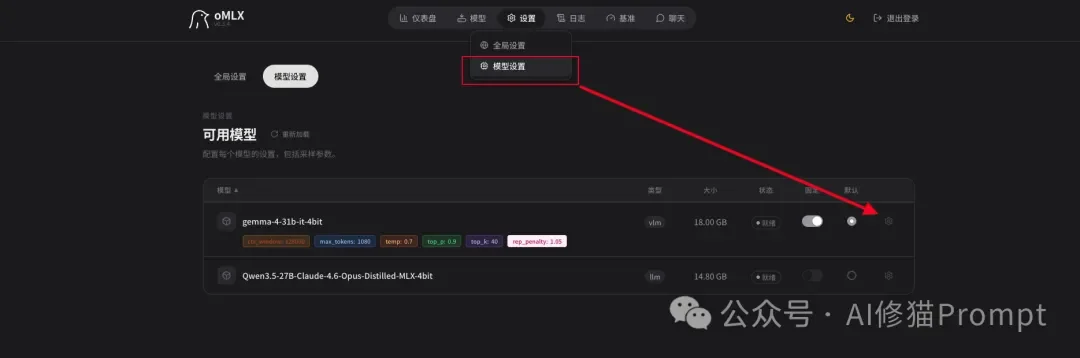

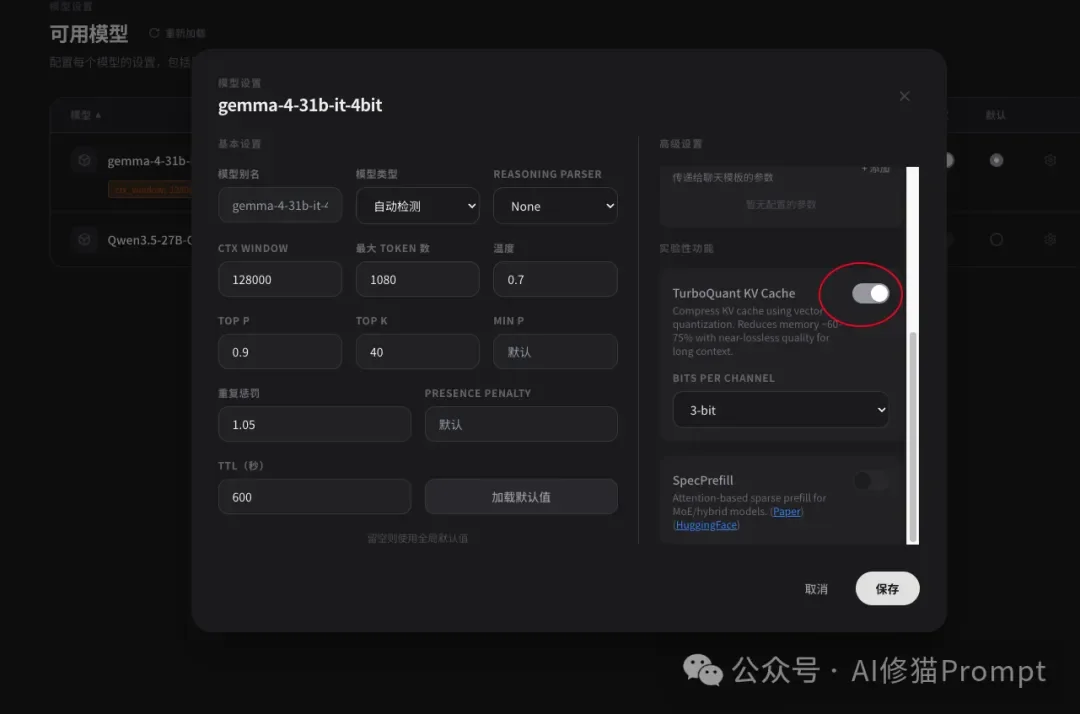

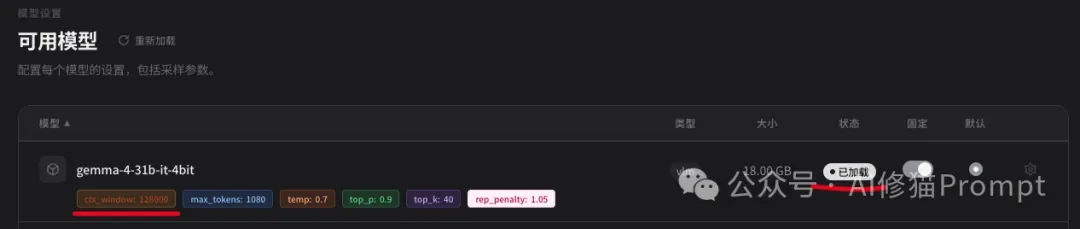

既然是实战攻略,我们直接来看最能避坑的操作指南。如果你现在就想打开oMLX尝试,请务必先核对以下几点:

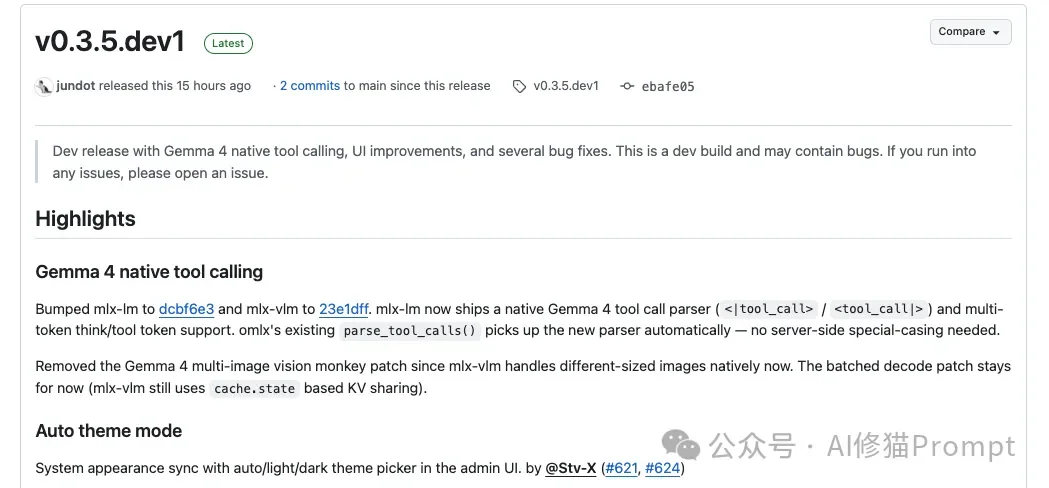

强烈建议升级至 oMLX v0.3.4 及以上版本(或v0.3.5.dev1)。

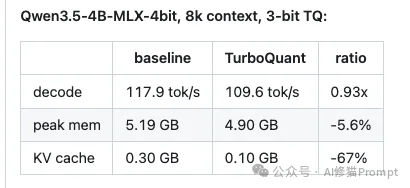

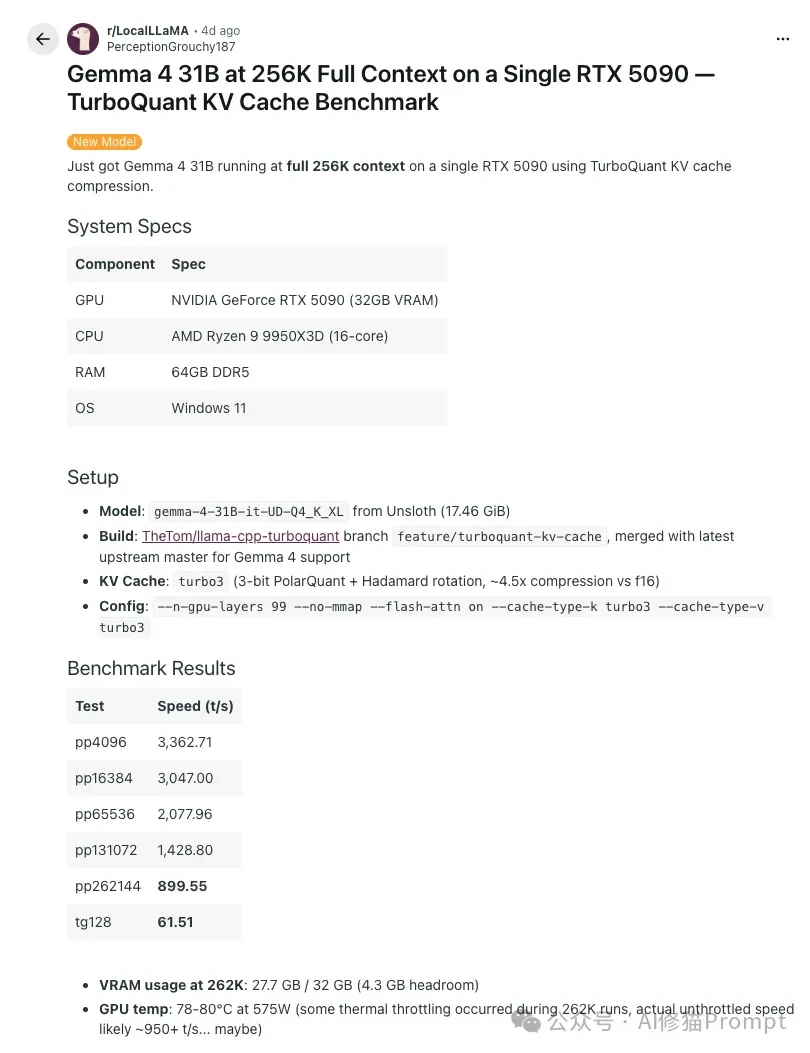

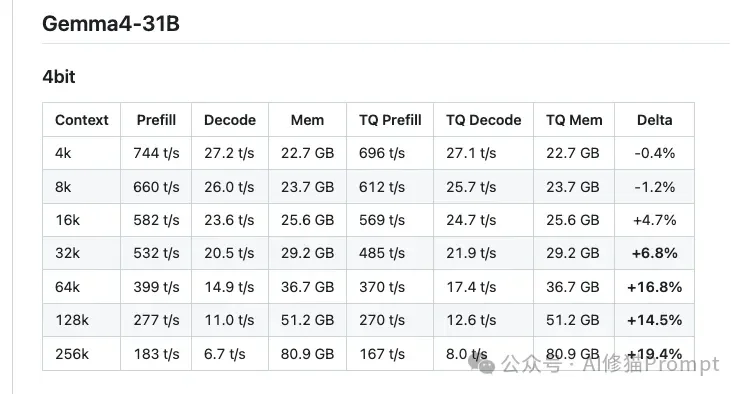

为了验证“很能打”是不是句空话,咱们不能只看简单的跑分截图。综合社区基准测试(如Incept5、LocalLLaMA等)和官方Release Notes的数据,我梳理了以下多维度的测试对照体系:

将不同上下文长度的数据切分后,TurboQuant的价值曲线非常清晰:

在8K或16K以下的场景,启用TurboQuant的收益几乎为零。

到了这个区间,TurboQuant开始发挥威力。

这是TurboQuant真正的“统治区”。

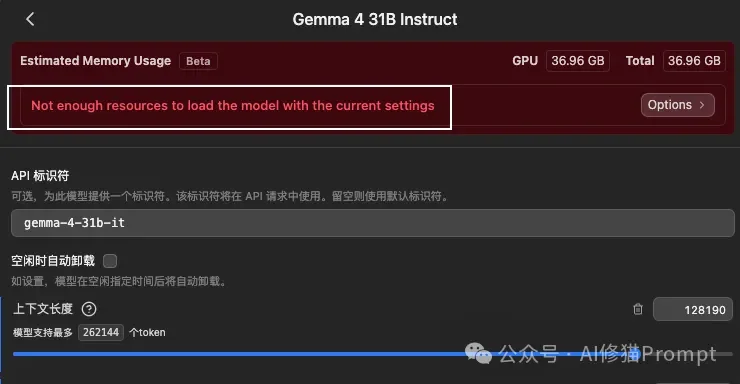

如果用一个不带TurboQuant的推理栈,如目前的LM Studio,下图。那128k上下文连加载都加载不了。

很多人会问:为什么开了量化,有时候速度变慢了,有时候速度反而变快了?

不过,需要特别指出一个核心技术难点:存储态的KV变小了,并不意味着“峰值内存”会同比例缩小。如果Prefill(预填)阶段仍需要完整的FP16张量来计算,那你的机器可能依然会因为短时间的峰值而崩溃。oMLX团队在后续版本引入的“Prefill即时量化”与“混合注意力”机制,正是为了削弱这根要命的峰值天线。

如果你在Mac上使用OpenClaw、Claude Code等Agent,请务必关注以下误区:

技术没有银弹,它只服务于对口的场景。

强烈推荐人群:

不太建议开启的人群:

文章看到这里,结论已经呼之欲出。

对于那些只想体验简单对话的用户,TurboQuant确实像是个可有可无的极客玩具。但对于致力于在本地环境中挖掘大语言模型生产力的用户来说,oMLX v0.3.4+ 结合 TurboQuant 绝对是一次里程碑式的实用进步。

尤其在搭配Gemma-4这样原生具备256K长上下文底子的模型时,TurboQuant扮演的不是“加速器”,而是至关重要的“续命血包”。它用微乎其微的质量损失(近乎无损)和极小的运算开销,为你释放了动辄数十GB的宝贵内存空间。这不仅意味着你能跑更长的数据,更意味着长工作流不再随时面临内存雪崩的恐惧。

一句话建议:如果你正在使用oMLX,立刻升级到最新版;如果你的工作流开始频繁报错OOM,毫不犹豫地打开TurboQuant 3-bit开关。

文章来自于"AI修猫Prompt",作者 "AI修猫Prompt"。

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0