让大模型真正走进现实世界,是当下最迫切的需求之一。

但美好的愿景,在真实的物理环境面前却屡屡碰壁。

那些在文本世界里对答如流的通用视觉语言模型(VLM),一旦装进机器人脑子里,常常显得笨手笨脚。

原因很简单——物理世界容不得半点含糊。通用模型平时看图“大差不差”就行,但具身智能需要的是极度精细的三维空间感知,以及涉及到真实物理交互的预测和规划。拿着“做题家”的脑子去干真实的体力活,自然水土不服。

面对这个行业痛点,腾讯混元团队联合腾讯Robotics X实验室开发的HY-Embodied-0.5系列基础模型交出了一份相当硬核的答卷。这并非是一次在通用大模型上的简单“微调”,而是一场从底层架构到训练范式,完全为“具身智能”量身定制的重构。

这一次,HY-Embodied团队推出了两款主力模型:

为了让AI真正“看懂”物理空间并做出准确反应,团队在架构、数据组织和训练流程上做出了大量创新。

他们不仅采用了原生分辨率的视觉编码器,还针对性地采用了Mixture-of-Transformers(MoT)架构,并引入视觉潜在Token机制,进一步强化了视觉与语言空间的对齐。

在训练端,模型先由超过100M的高质量具身专属数据打底,并引入迭代式后训练范式,应用了拒绝采样微调、强化学习、在线蒸馏等方案,驱动模型思维链自主进化,并将大模型的能力高保真地“压缩”传授给仅有2B激活参数的轻量级变体。

HY-Embodied系列模型不仅在开源Benchmark上达成了断层式的领先,更在物理实操中证明了自己绝非纸上谈兵:通过将VLM底座应用在VLA(视觉-语言-动作)模型,直接让其接管现实世界中的机器人控制。

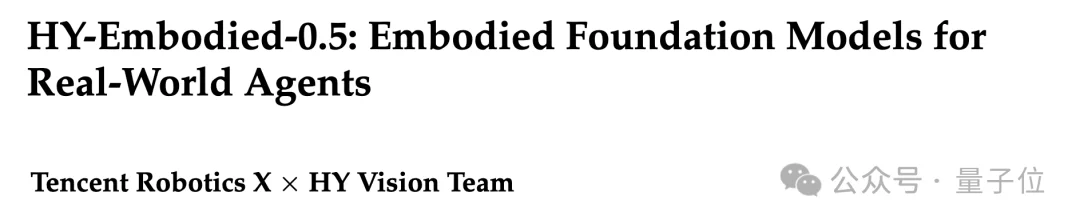

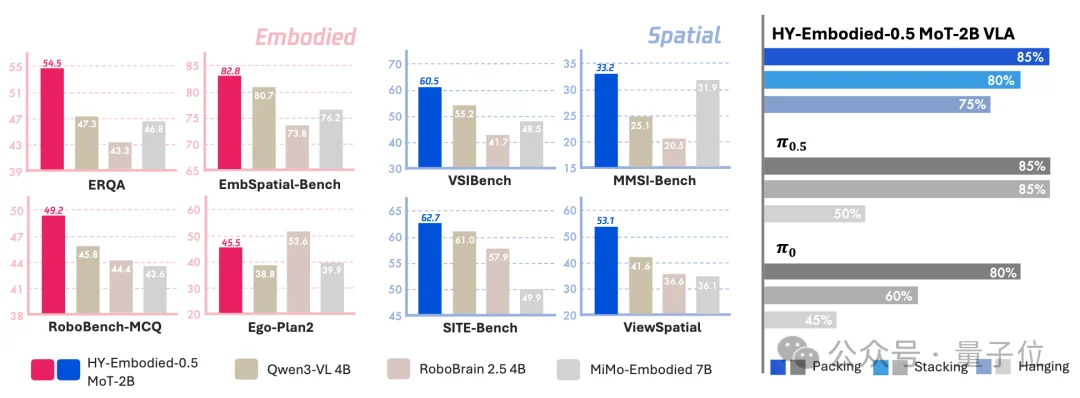

在涵盖感知、推理、规划的22项权威评测榜单中,HY-Embodied-0.5展现了极其恐怖的战斗力。小身板的MoT-2B模型共取得16项最佳,超越参数更大的通用底座Qwen3-VL-4B和具身专属模型RoboBrain2.5、MiMo-Embodied等。

△ HY-Embodied-0.5 2B参数量评测结果

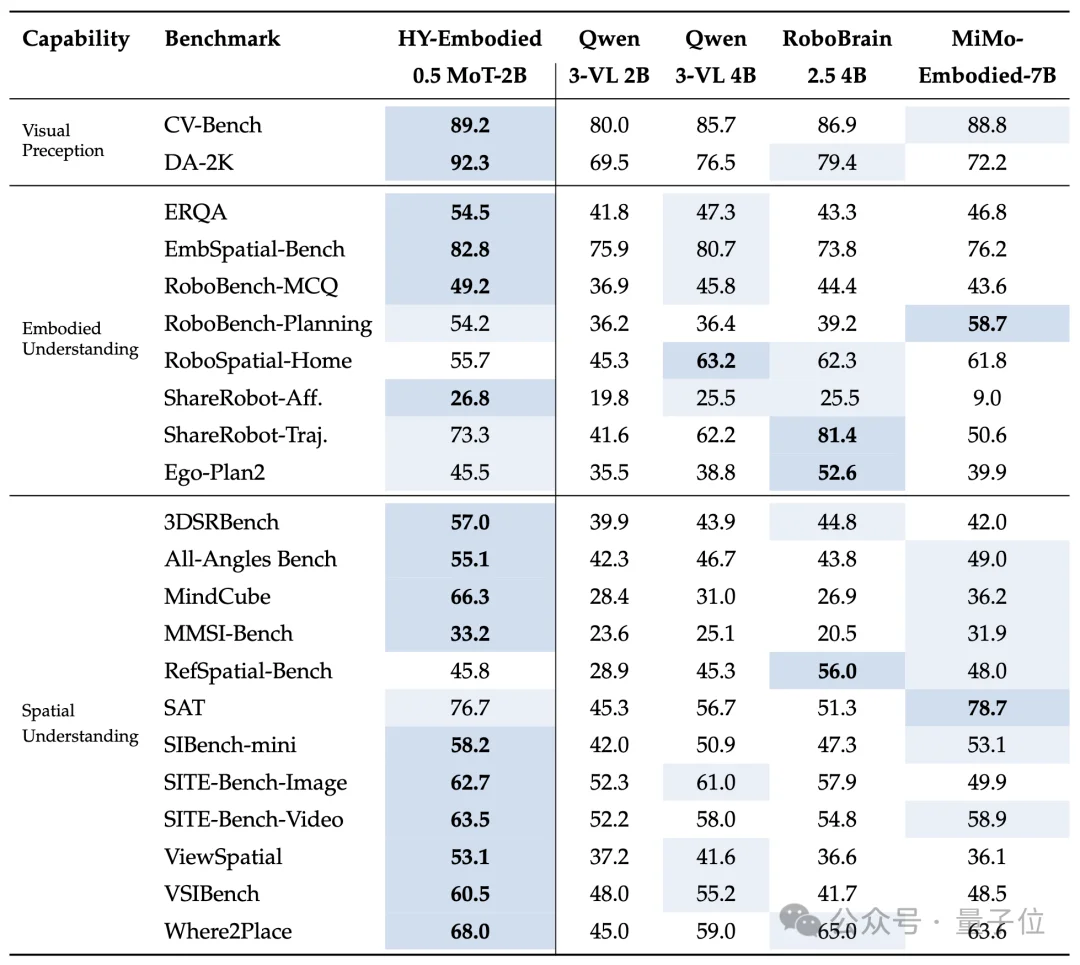

而完全体的MoE-A32B在具身测评标准下的综合成绩与目前的行业标杆Gemini 3.0 Pro等抗衡。

△ HY-Embodied-0.5旗舰模型评测结果

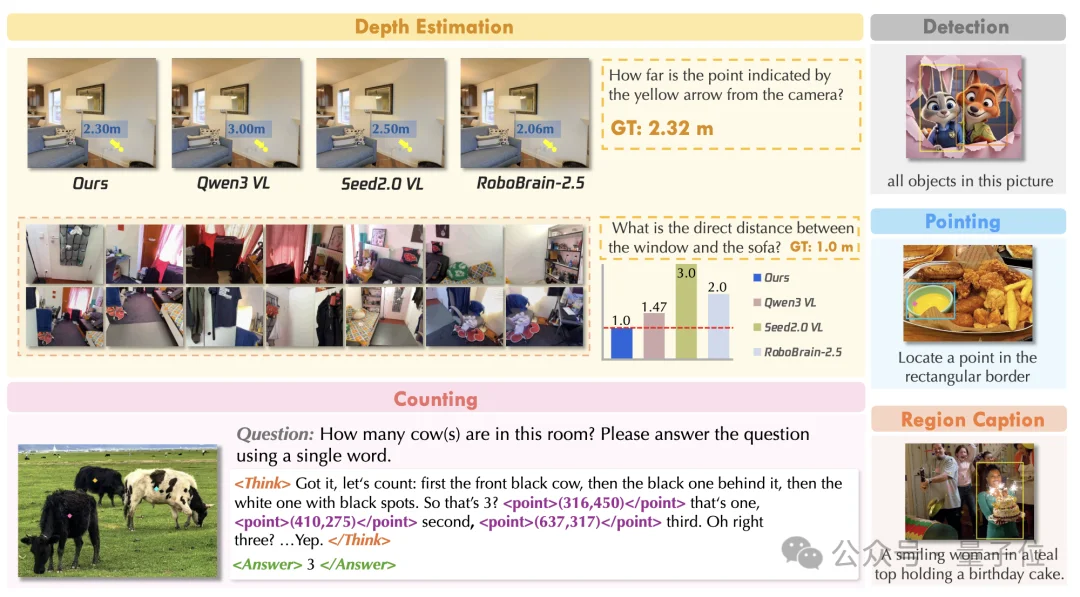

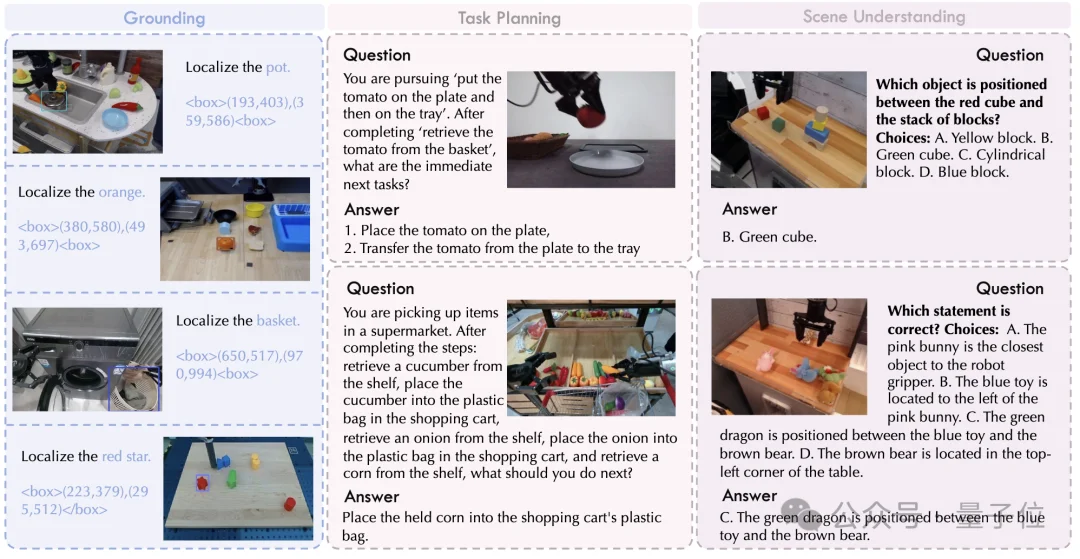

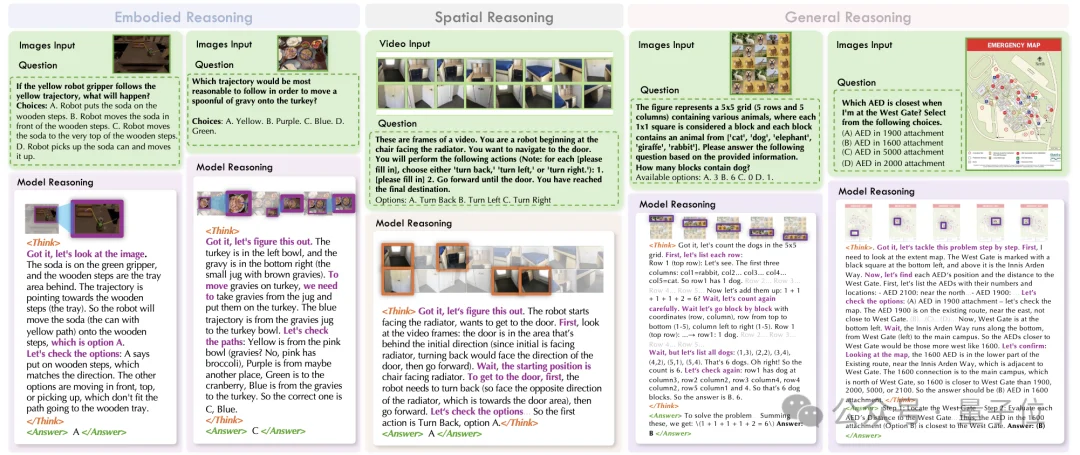

除了领先的评测性能,2B小模型也有不错的使用体验。在视觉感知和具身任务上,不仅有准确的结果,还有清晰合理的推理过程。

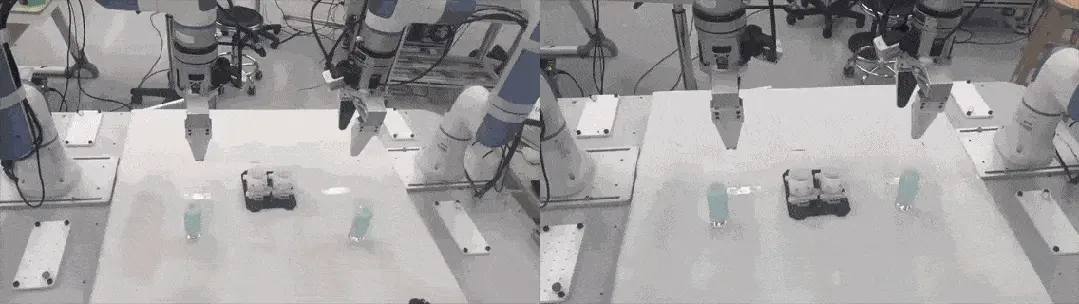

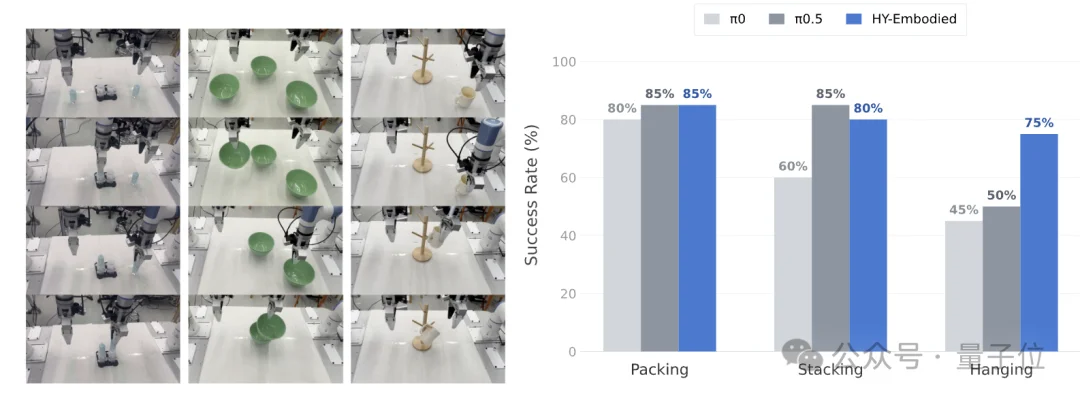

将更强的VLM基座应用到机器人实机任务上也能取得更好的效果。预训练的HY-Embodied-0.5基座(右图)相比基线模型(左图)。

使用相同动作训练数据,在打包、堆叠、悬挂三个实机任务上,HY-Embodied基座相比于pi0和pi0.5初始化的模型能取得更好的效果。

多模态训练中,由于视觉信号信息量极大,模型在拼命“看懂”图像时,往往会挤占原本属于语言的参数空间,导致“看图厉害了,说话变笨了”的灾难性遗忘,这在2B规模的端侧模型上尤为明显。

HY-Embodied-0.5在架构上致力于实现模态自适应与无损感知。也就是说,端侧模型(如HY-Embodied-0.5-MoT-2B)不仅要在不丢失信息的前提下看清输入,还要让视觉和语言“各司其职”,在互不干扰中实现性能翻倍。

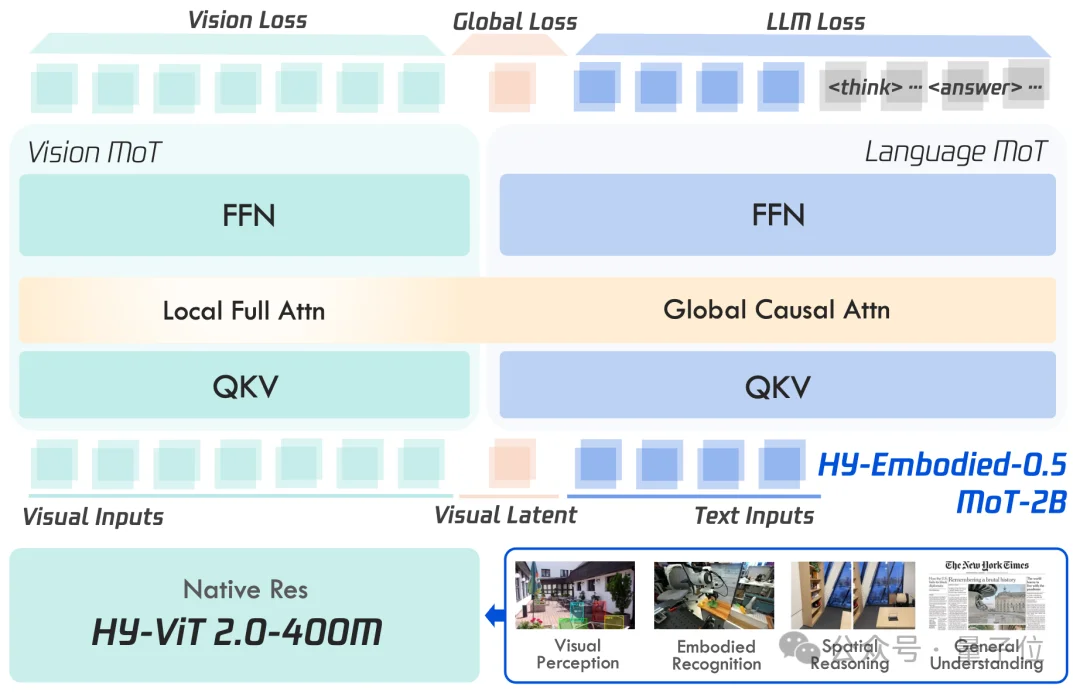

△ HY-Embodied-0.5 MoT-2B架构图

为了打破端侧小模型的性能瓶颈,HY-Embodied在基础VLM架构上进行了深度重构,其核心包含三个关键部分:

HY-ViT 2.0不仅原生支持任意分辨率输入,还针对端侧专门打造了400M参数的高效版本。它通过从更强大的内部大模型进行知识蒸馏,并引入视觉重建监督和微型LLM的语言监督,确保喂给大语言模型的视觉信号做到信息损失最小化。

为了让视觉和语言不打架,模型引入了MoT机制,为视觉分支赋予了非共享参数。具体而言,它复制了语言模型的FFN和QKV参数并用预训练权重初始化,专门交由视觉Token计算。这使得模型参数量翻倍但推理效率几乎不受影响。

同时,由于图像不具备语言那种单向序列的特性,模型专门为视觉Token解锁了独立的全向(双向)注意力机制,并引入视觉Next-code预测任务(利用将每个8x8图像块压缩为单一代码的2k离散词表作为监督),提供更强的视觉监督信号。

受潜在思维机制的启发,HY-Embodied-0.5在每一个视觉输入序列(如图片或视频帧)的末尾,都追加了一个专属的“视觉潜在Token”。在预训练阶段,这些Token会直接接受来自超大ViT全局特征的监督。它们就像是连接视觉与文本内容的桥梁,极大地拉升了端侧小模型的整体感知容量和细粒度理解能力。

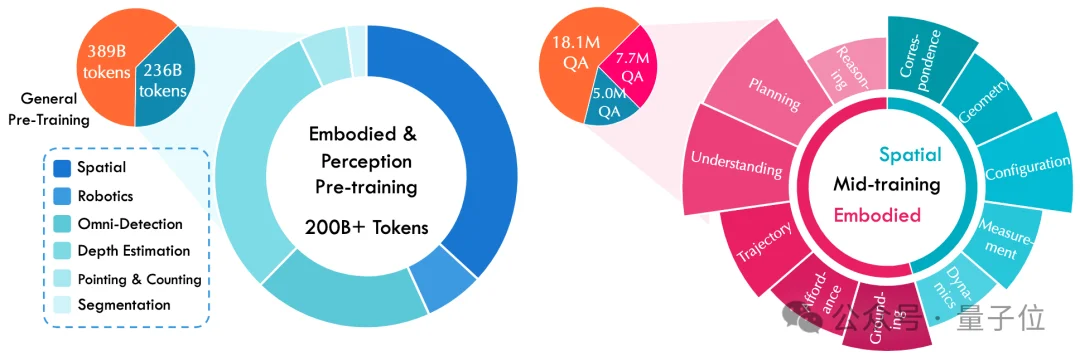

△ HY-Embodied-0.5训练数据组成

HY-Embodied-0.5团队希望模型能够像真实的物理智能体(Agent)一样,建立从“立体空间感知”到“逻辑规划执行”的完整认知链路。为了给模型注入真实的物理直觉,HY-Embodied-0.5摒弃了零碎的数据堆砌,将海量基础视觉数据与高度专业的具身、空间认知数据进行了深度整合:

视觉感知数据系统性地为模型构筑了全方位、多维度的“底层视觉理解”能力。从宏观的二维与三维全维检测、感知物理环境的深度估计,到微观的高分辨率语义分割,乃至极具挑战的密集目标指向与精确计数。这些数据让模型不仅建立起了对复杂场景像素级的精准把控,更为后续精细化的具身物理操作奠定了坚实可靠的视觉锚定基础。

空间感知数据系统性地注入了专为三维环境打造的“空间感”。从几何深度、空间拓扑,到跨视角的物理对应,乃至严苛的绝对物理度量。这些数据让模型彻底打破了二维像素的局限,建立起了真实的立体几何直觉。

HY-Embodied-0.5将真实世界的物理操作数据拆解为严密的三个层级:感知、语义理解与高级规划。它涵盖了从基础的视觉锚定、可供性预测,到提取自真实机械臂第一视角的长视野动作推理与轨迹预测。通过这些数据,模型不仅学会了评估当前的任务状态,还能在包含视觉谜题和直觉物理规律的复杂场景中,精确生成下一步的动作序列。

HY-Embodied-0.5在训练范式上致力于实现“从基础感知到深度思考,再到端侧部署”的完美闭环。也就是说,模型不仅要在海量数据中打好视觉和语言的地基,还要通过自我演化真正掌握长链条逻辑推理能力。

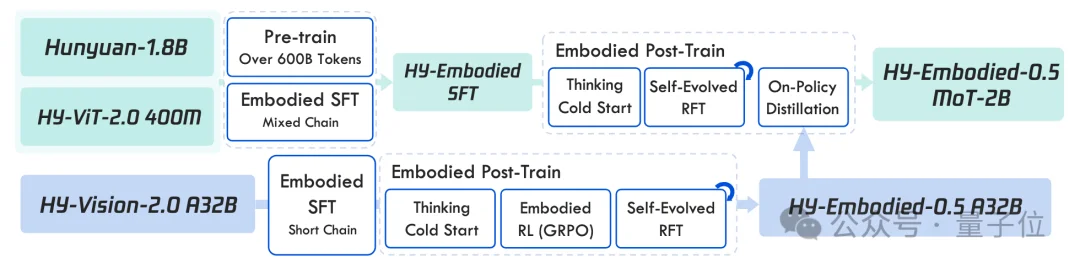

△ HY-Embodied-0.5训练流程

为了培养出既懂常识又具备强悍具身推理能力的模型,HY-Embodied设计了一套多阶段、渐进式的深度训练配方。

首先,模型在海量多模态语料,以及空间和具身数据中提升自身感知能力,按照数据质量和规模分为预训练(Pre-train,超过600B token)和中程训练(Mid-train,超过30M条数据)两部分,打好模型的认知地基。紧接着的监督微调(SFT)更在高质量的推理数据中激发模型的推理能力。

为了让模型在复杂的具身任务中找到最优行动策略、获得自我进化的推理能力,HY-Embodied-0.5引入了一系列专为具身任务优化的后训练流程。

在训练过程中,先利用强化学习鼓励模型自由探索出更好的行为模式,而后引入迭代式的自我演化范式。模型通过拒绝采样微调(RFT),将模型评判出的高质量推理过程保留下来,巩固了模型的思维模式,将偶然的成功转化为可靠的能力。

更进一步,HY-Embodied-0.5通过引入在线蒸馏策略,让端侧小模型自己先尝试输出,大模型则直接针对小模型“犯错的节骨眼”进行实时指导,将大模型的能力转移给更紧凑的端侧模型。

基座模型是通向真实世界Agent的重要基础。

LLM Agent在解决复杂抽象问题上已经展现出了惊人的推演能力与想象力,但我们更迫切地希望,模型能在更广阔的物理现实中大展拳脚。正如HY-Embodied系列模型所探索的那样,大模型的认知链路正在被成功延伸至物理实操与机器人控制中。

期待在未来,随着具身智能基座的不断演进,AI能够真正跨越虚实边界,在真实世界中落地更广泛、更深远的应用。

GitHub:

https://github.com/Tencent-Hunyuan/HY-Embodied

Huggingface:

https://huggingface.co/tencent/HY-Embodied-0.5

文章来自于"量子位",作者 "腾讯混元团队"。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner