RESEARCH

2026 年 4 月,Nathan Lambert 和 Florian Brand 发布了 The ATOM Report,一份关于开源语言模型生态的综合采纳度快照。这份报告追踪了约 1500 个主线开源模型的下载量、衍生模型、推理市场份额和性能数据,覆盖 2023 年 11 月到 2026 年 3 月

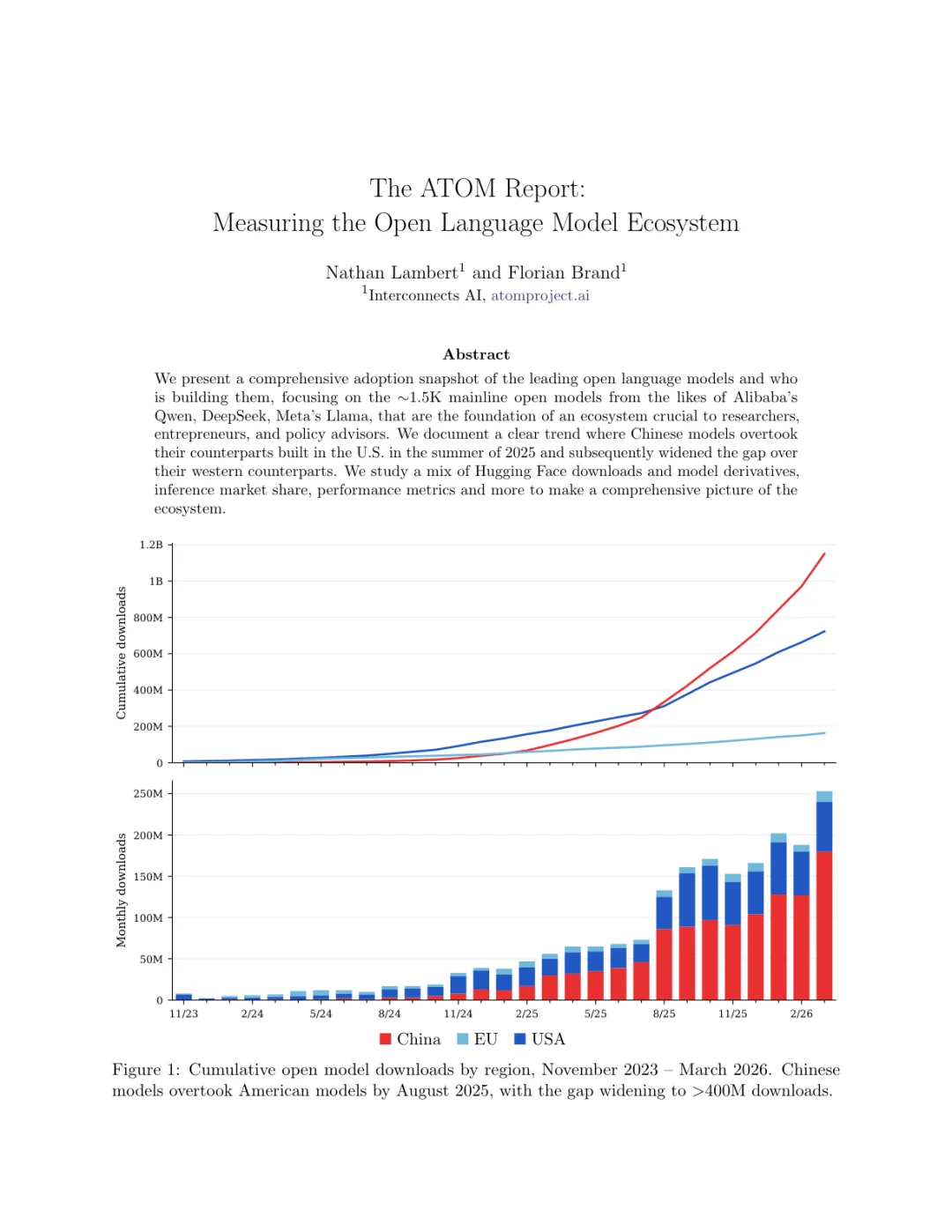

核心结论很直白:中国开源模型在 2025 年夏天超过了美国,之后差距持续扩大。到 2026 年 3 月,中国模型的累计下载量达到 11.5 亿 次,美国是 7.23 亿次,差距超过 4 亿

ATOM Report Figure 1:按地区划分的开源模型累计下载量

ATOM 是 Interconnects AI 主导的项目,Nathan Lambert 此前在 Hugging Face 工作,后来创办了 Interconnects AI。数据来源是 Hugging Face 下载量和衍生模型数据、OpenRouter 推理 token 份额、Arena Elo 评分、Artificial Analysis 智能指数

追踪的是「主线开源语言模型」,不包括 embedding 模型、文生图扩散模型或其他非生成式架构。约 1500 个模型在研究期间累计产生了超过 30 亿 次下载

报告不做政策建议,只做数据呈现。政策建议在 ATOM Project 主站 atomproject.ai 另外发布

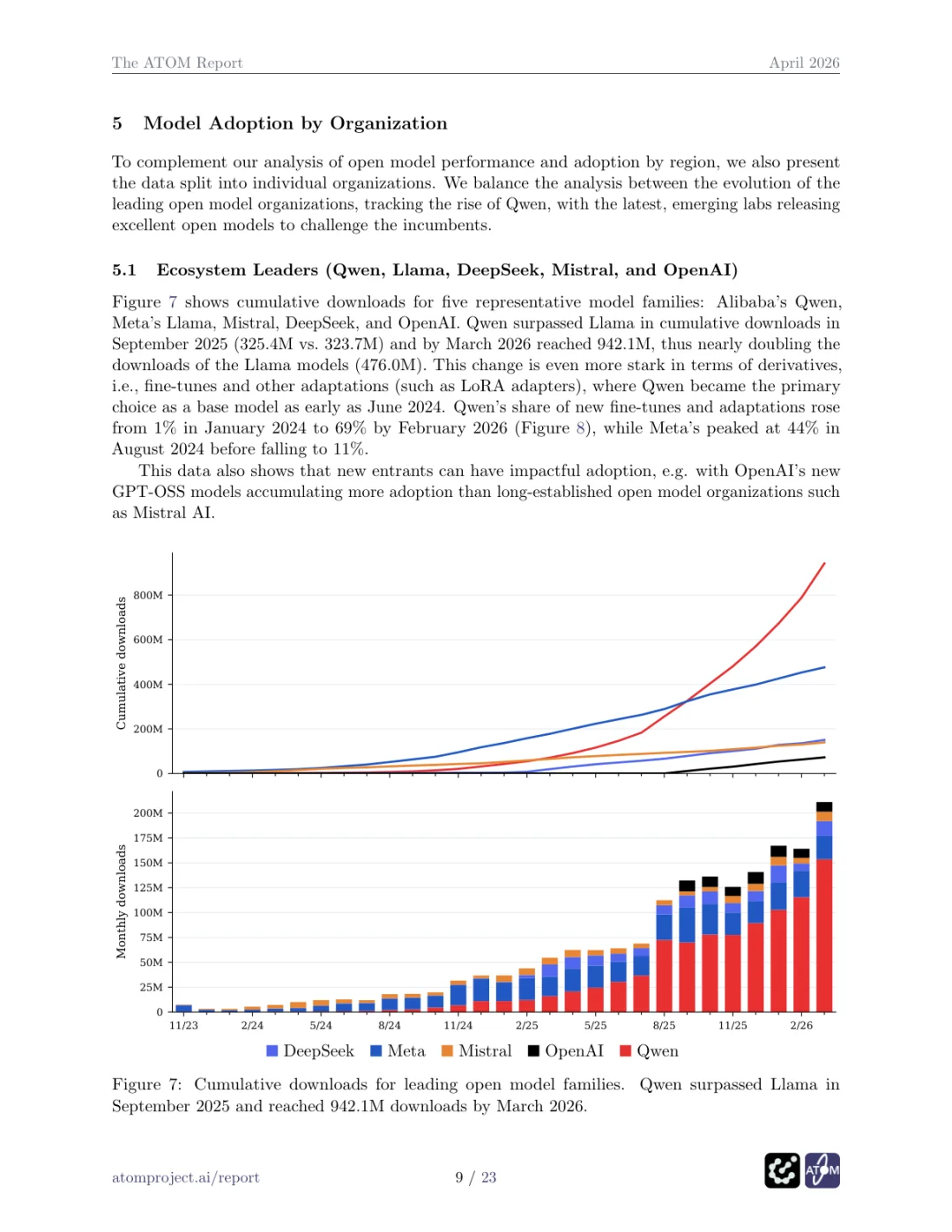

到 2026 年 3 月,Qwen 的累计下载量达到 9.42 亿 次,是 Llama(4.76 亿)的将近两倍。2026 年 2 月,Qwen 单月下载 1.536 亿次,超过 Meta、DeepSeek、OpenAI、Mistral、NVIDIA、Zhipu AI、MiniMax、Moonshot AI 八家加起来的 7120 万次

按组织划分的累计下载量:Qwen 遥遥领先

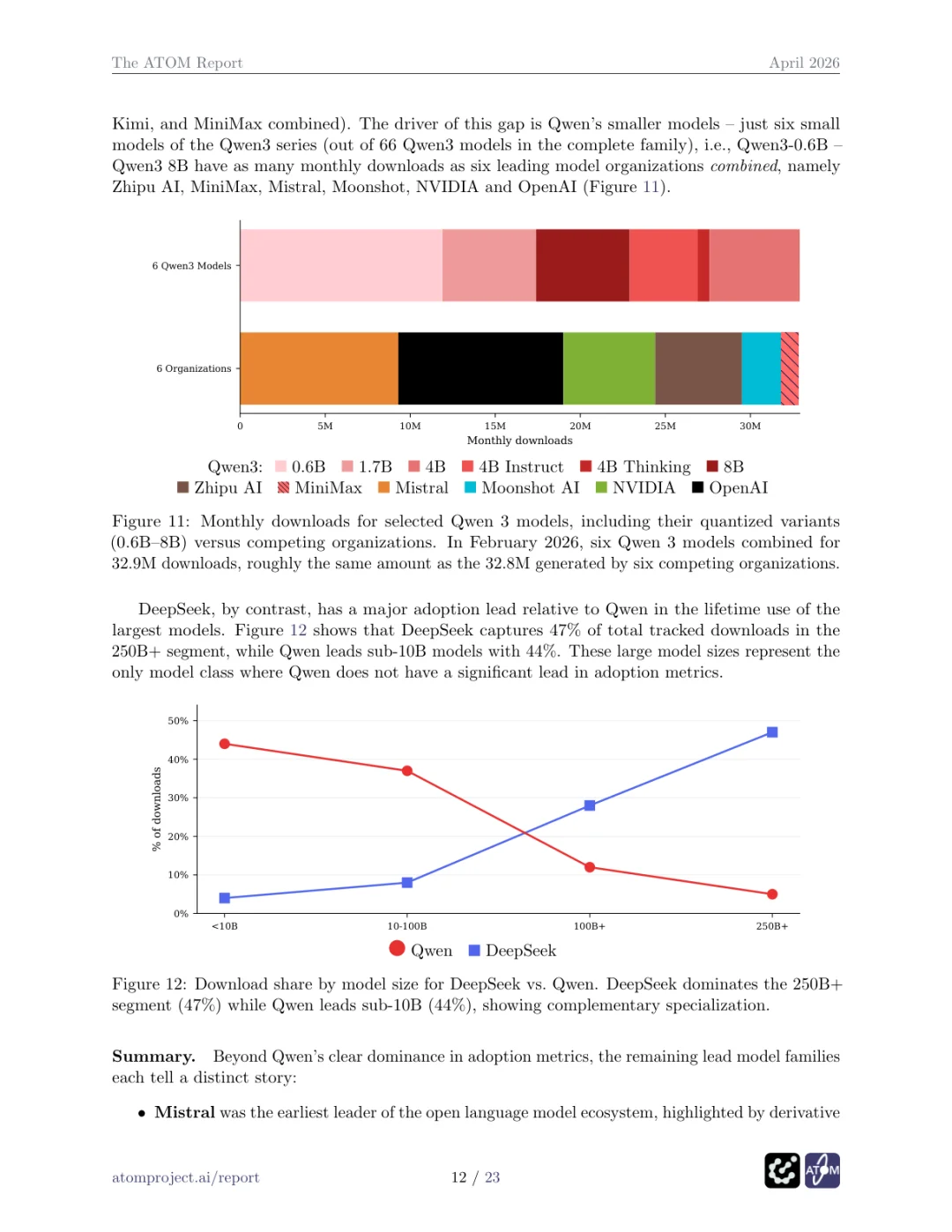

更极端的对比:Qwen3 系列中 6 个小模型(0.6B 到 8B)的月下载量,跟 Zhipu AI、MiniMax、Mistral、Moonshot AI、NVIDIA、OpenAI 六家组织的全部模型加起来差不多

Qwen3 小模型 vs 六家组织 + DeepSeek vs Qwen 按模型大小

唯一的例外是 250B+ 超大模型,DeepSeek 以 47% 的下载份额领先,Qwen 优势集中在 10B 以下(44%)。报告称之为「互补性专业化」

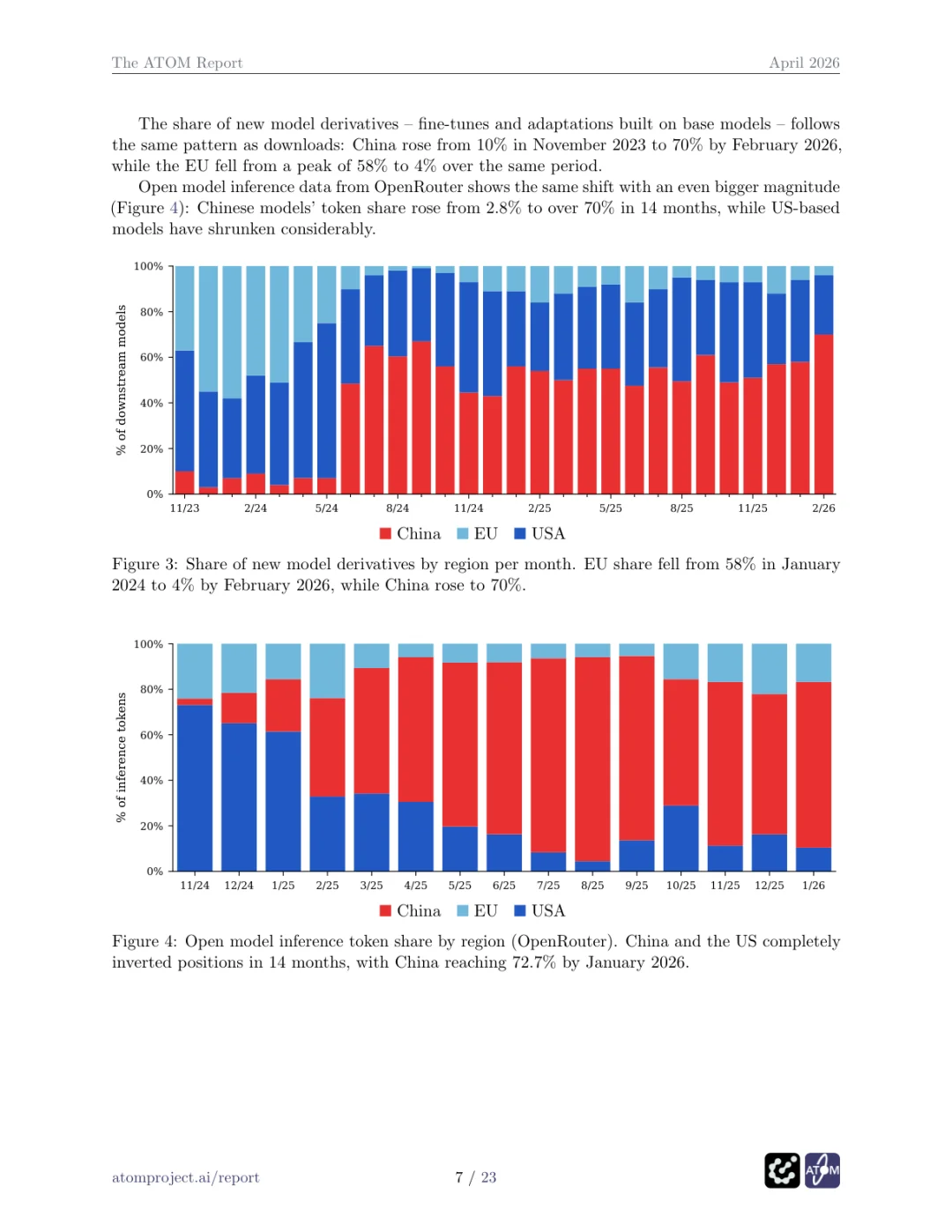

中国从 2023 年 11 月的 10% 上升到 2026 年 2 月的 70%。欧洲从峰值 58% 跌到 4%

OpenRouter 数据。中国模型从 2024 年 11 月的 2.8% 上升到 2026 年 1 月的 72.7%。中美完全互换了位置

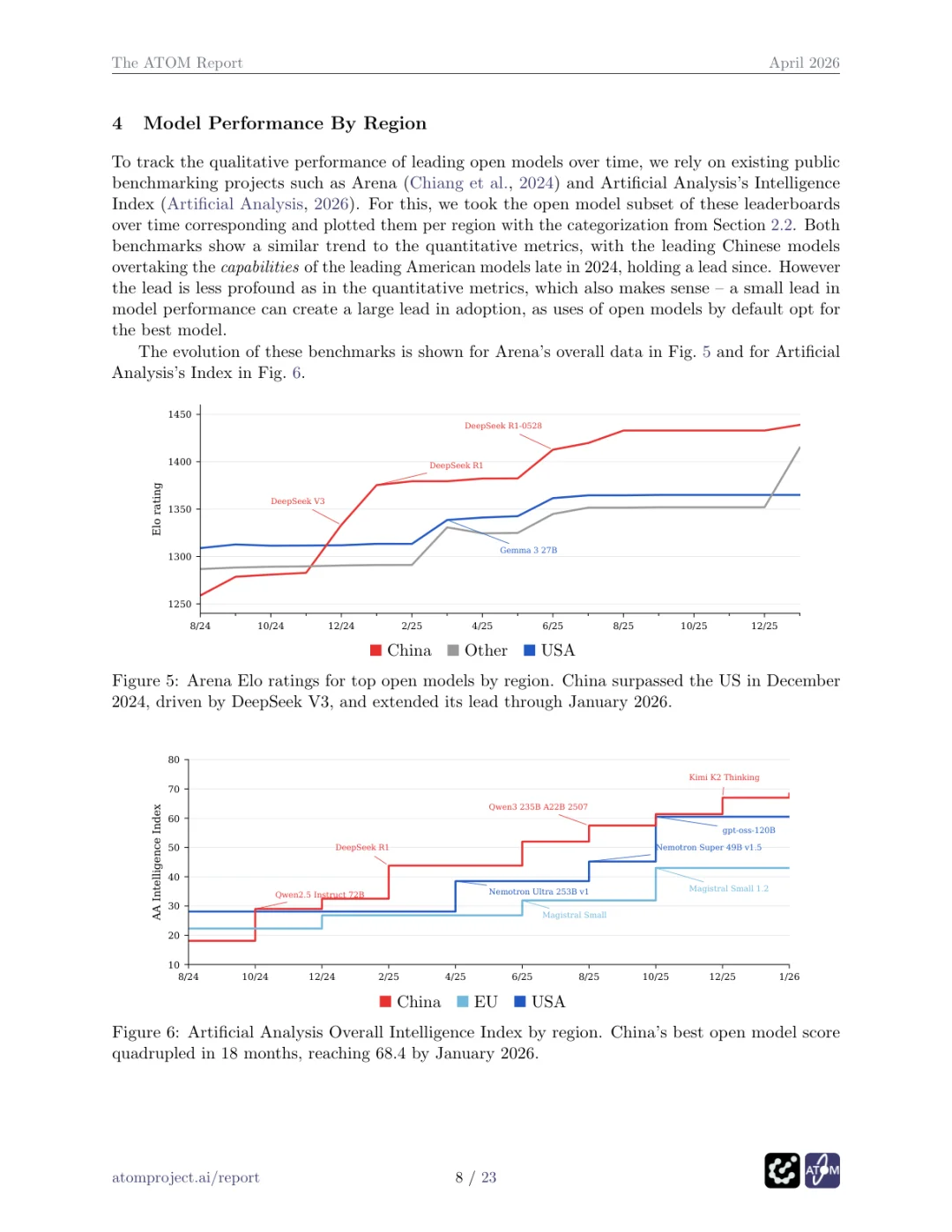

Arena Elo 和 Artificial Analysis 智能指数都显示,中国最佳开源模型在 2024 年底超过了美国,之后保持领先

衍生模型份额(上)+ 推理 token 份额(下)

Arena Elo(上)+ Artificial Analysis 智能指数(下)

性能上的小幅领先可以创造采纳度上的大幅领先,因为用户默认会选最好的那个

整个开源模型生态的增长速度本身就很惊人。2025 年 3 月到 2026 年 3 月,累计下载量从 3.39 亿增长到 20.4 亿,同比增长 6 倍。其中中国同比增长 11.9 倍,美国 4.1 倍,欧洲 2.5 倍

报告提出了 Relative Adoption Metric(RAM),解决一个老问题:1.5B 小模型天然比 400B 大模型下载量高出 10-50 倍。简单比较下载量没有意义

RAM = 某模型发布后第 t 天的累计下载量 / 同参数量级 top 10 模型在同一时间点的中位数。1.0x 是持平,高于 1.0x 是跑赢

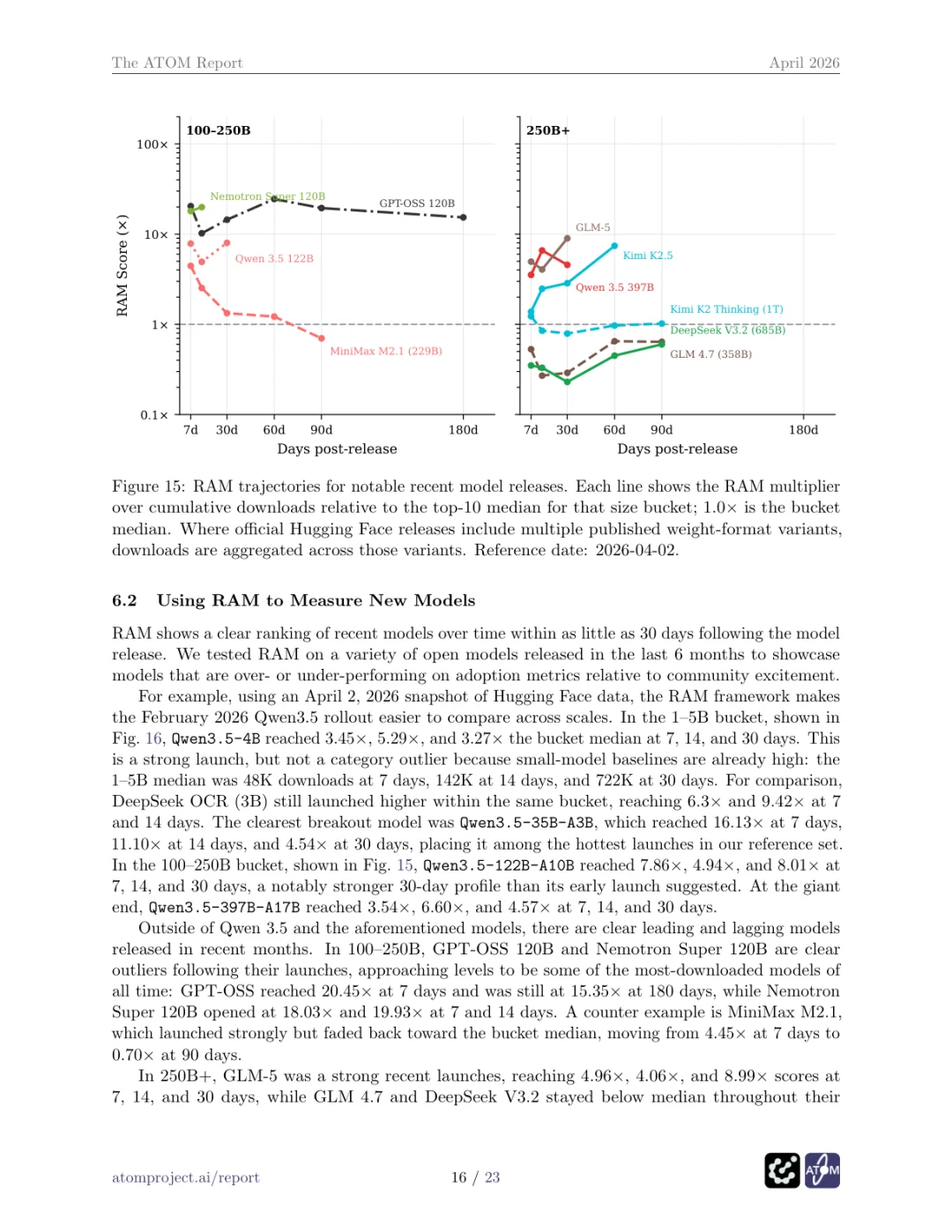

RAM 轨迹:100-250B 和 250B+ 区间

GPT-OSS 120B 发布 7 天后 RAM 达到 20.45x,180 天后仍然 15.35x,是 100-250B 区间的绝对异类。Nemotron Super 120B 开局 7 天 18.03x

250B+ 区间,GLM-5 表现不错(30 天 8.99x),但 DeepSeek V3.2 和 GLM 4.7 全程低于中位数。Kimi K2.5 有一个有趣的加速曲线,从 7 天 1.38x 到 60 天 7.42x

RAM 揭示了下载量看不到的现象:美国模型在中大型参数区间的相对采纳度依然很强

GPT-OSS 和 Nemotron 的 RAM 远高于大多数中国模型,说明在绝对数量被碾压的情况下,美国个别模型仍然能在特定尺寸段获得不成比例的高采纳度

Llama 累计下载量排第二(4.76 亿),但在推理平台上已经从 2025 年 1 月 37.4%% 的峰值跌到了零。Llama 4 发布后没有扭转趋势

GPT-OSS 从 2025 年 9 月才开始发布,到 2026 年春季月下载量已超过 Mistral 全部历史模型组合。RAM 显示 GPT-OSS 120B 可能成为有史以来下载量最高的模型之一

Mistral 曾是开源生态先驱(2023 年 12 月衍生模型份额 57%%),但累计下载量从未加速到 Qwen 或 Llama 的水平

HuggingFace 不是唯一分发渠道(中国还有 ModelScope),下载量不等于活跃使用。但报告的立场是:所有可用使用数据都跟 HuggingFace 下载量趋势高度相关

参考材料

The ATOM Report

https://atomproject.ai/report

The ATOM Project

https://atomproject.ai/

Nathan Lambert 推文

https://x.com/xeophon/status/2041889677343343014

文章来自于"赛博禅心",作者 "金色传说大聪明"。