最近,AI 圈又多了一个「48 小时开源」的故事。

4 月 20 日,OpenAI 发布了 Chronicle,带来了一个很关键的能力:AI 可以直接「看见你的屏幕」,并持续记住上下文。

这意味着什么?不只是聊天更顺了,而是交互方式变了。在写代码、改文档、调设计稿时,你不再需要向 AI 反复解释「这个」、「刚刚那个文件」或「上一步做了什么」,它自己看得到,也记得住。

当然,获得这种能力目前有一个前提:订阅。Chronicle 目前仅对 ChatGPT Pro 用户开放,每月 100 美元。

然而仅仅 48 小时后,另一条路线出现了。一群 00 后开发者组成的团队「Vida」,发布了一个开源项目:OpenChronicle。

他们的动机在发布推文中写得很直白:

OpenAI 的 Chronicle 指向了一个重要的未来。但 AI 的记忆,不应该被锁在 100 美元/月的付费墙之后。所以,我们把它开源了。

同样是「看屏幕 + 持续记忆」,但它做了三件更激进的事:可以完全本地运行、可以接任意模型(包括本地模型)、可以被不同 AI Agent 共享调用。

换句话说,他们不是在做一个单纯的功能替代品,而是将「AI 的眼睛和记忆」从单一产品中直接拆解出来。至此,AI 第一次拥有了可复用的「记忆层」。

这件事也没有停在 GitHub。OpenChronicle 发布后很快在海外社区引爆讨论,相关帖子短时间内超过 2000 条,不少开发者开始接入、复现甚至二次开发。

OpenChronicle迅速形成话题,9小时内Posts超过2000条。

社区里的一句高赞评论是:「这不只是一个开源项目,这是把 AI 从『产品形态』往『系统形态』推了一步。」

那么,这个「记忆层」具体能做什么?开发团队给了三个非常具体的用例。

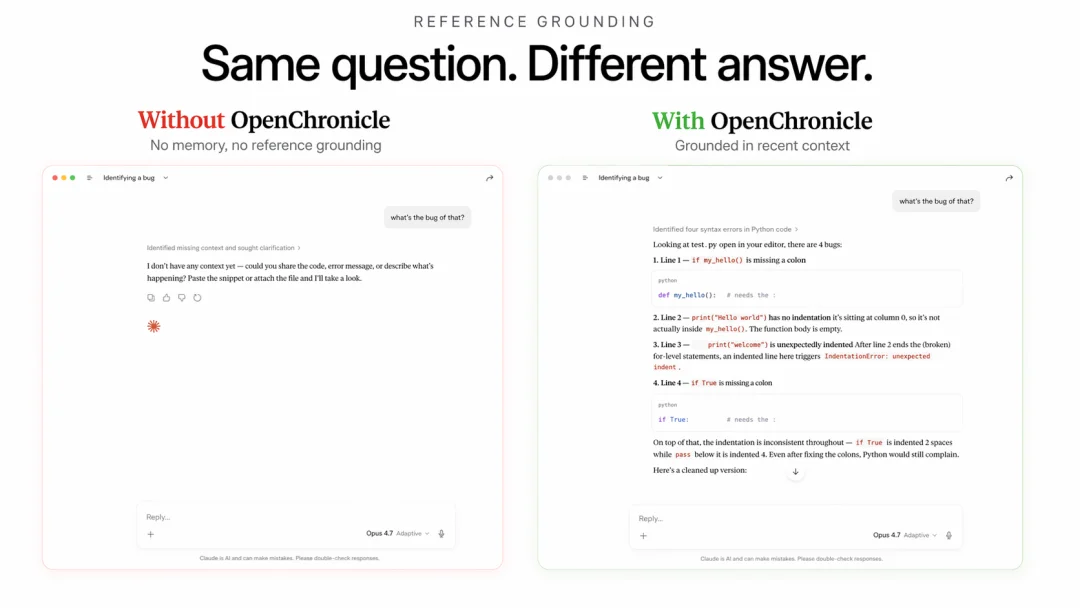

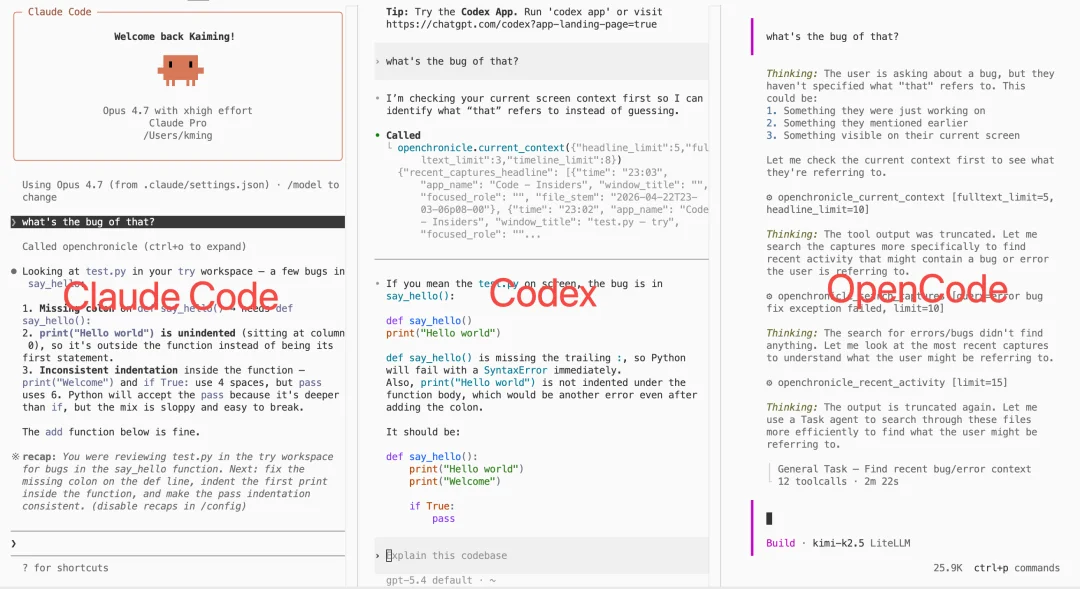

1)结合上下文,理解你的指代

当 AI 缺乏持续记忆时,突然问一句「what's the bug of that?」,模型往往不知所措。但接入 OpenChronicle 后,Agent 会直接调取你当前的屏幕上下文(如 VS Code 里打开的文件、报错信息),将「that」精准解析为具体代码,带来截然不同的交互体验。

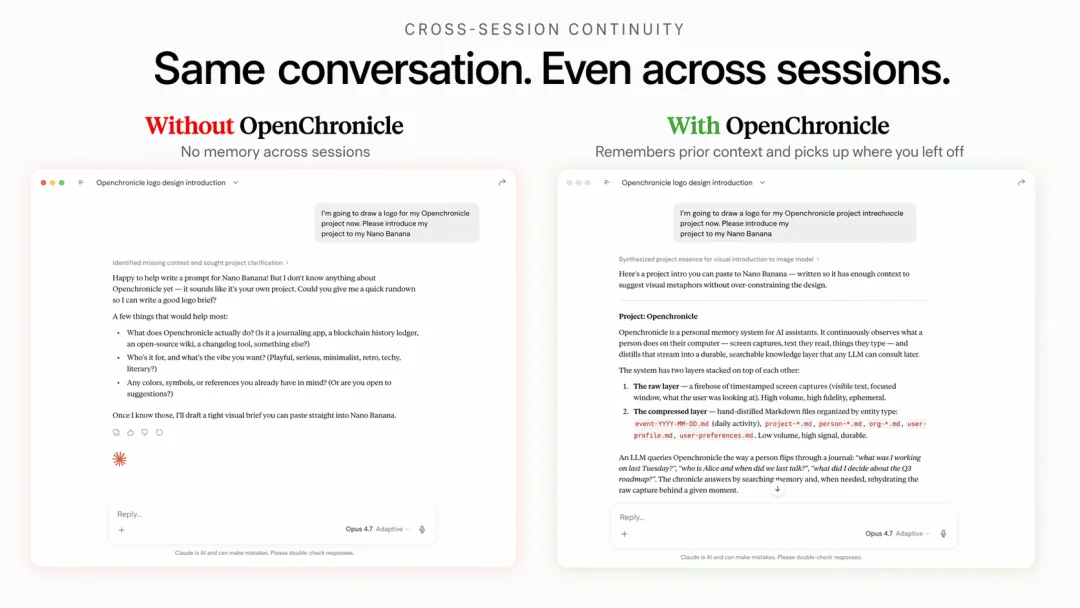

2)跨会话连续性

开发团队做了一个测试:在一个全新的对话里,让 Claude 写一个 OpenChronicle 的 logo prompt。注意,开发团队从来没有在 Claude 中提过 OpenChronicle。

没有连续记忆时,模型第一步是反问:「OpenChronicle 是什么?」;但有了 OpenChronicle,它会直接从开发者在其他软件(浏览器、飞书、VS Code)的操作中检索项目信息,然后一步给出结果。不需要解释,不需要复制粘贴上下文,对话之间不再是孤立的。

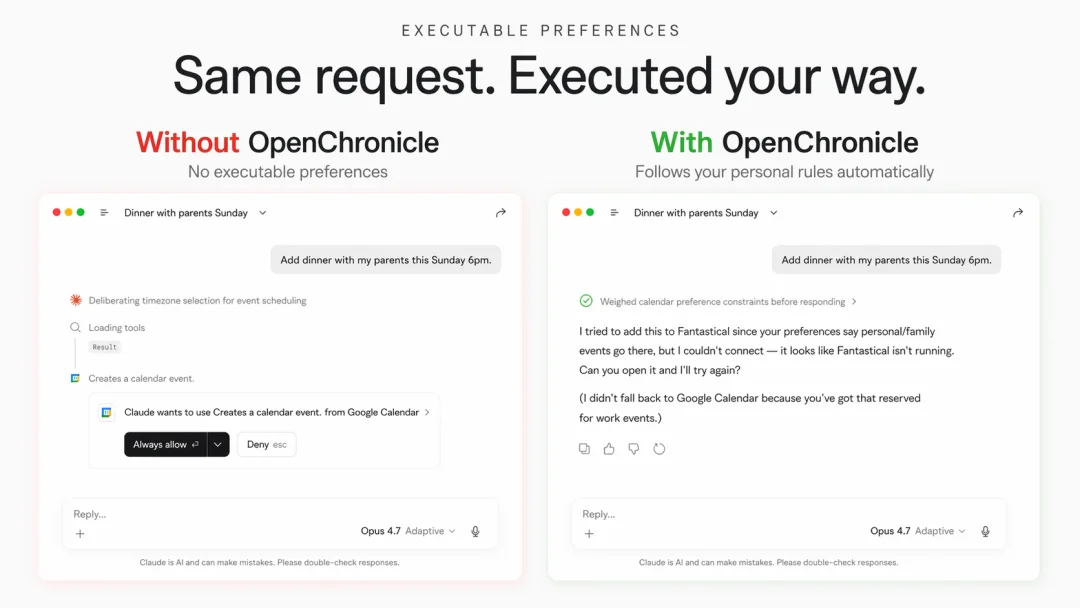

3)让 Agent 学会你的习惯并执行

这一点很微妙,但极为关键。在开发团队看来:记忆不应该只是帮助 Agent「理解你」,还应该让它「按照你的方式行动」。

比如 OpenChronicle 发现一个用户,习惯于工作用 Google Calendar,家庭用 Apple/Fantastical。当用户说:「Add dinner with my parents this Sunday.」 Agent 会自动把这个任务路由到「家庭日历」,而不是工作日历。

一个 Agent 学会你的习惯、按照你的行为模式执行任务的未来,似乎已经触手可及。

从「对话记忆」,到「工作流记忆」

与主流 AI 的 Memory 不同,OpenChronicle 会观察你正在使用的应用(IDE、Notion、Figma),读取屏幕内容(代码、文档、界面),并记录一个任务是如何一步步推进的。它记住的不是聊天,而是「你在干什么」。

这件事一旦成立,体验就会发生一个很微妙但很本质的变化:你在飞书上和团队讨论的开发方案。不用解释上下文,AI 可以直接接着你们的思路往下走;你在改第三版设计稿,AI 不只是看这一版,还知道前两版是怎么一步步改过来的。

它开始理解「过程」,而不是某一个瞬间的输入输出。它更像是一层基础设施。

OpenChronicle 不绑定特定模型或工具,Claude Code、Codex、OpenCode、Claude Desktop 等都可以一键接入,甚至连 MCP 配置都是自动生成的。

这意味着开发者不需要再为每一个 Agent 单独做一套记忆系统。不同工具之间,也第一次有机会共享同一份「用户上下文」。AI 记忆,开始变成一层可以被复用的东西。

甚至连「记忆怎么存」,都不是黑箱

OpenChronicle 没有把自己做成一个黑盒:

这让「AI 记忆」第一次长得有点像数据库,或者操作系统组件:不是一个功能,而是一块可以被组合的基础能力。

同时,它也选了一条很明确的路线:本地优先。你可以用本地模型总结记忆,数据完全不出设备。也可以随时暂停,随时恢复。记忆可以很强,但不一定要变成「全程监控」。

更大的变化,还在后面

如果把视角再往后拉一点,这件事就更加有趣。

过去,大多数 AI 的工作方式很简单: 你问 → 它答 → 结束。但现在开始变了。AI 会先看环境、再结合历史、再参与当前任务、然后继续留下痕迹。

交互的单位,从「一次对话」,变成了一段「持续发生的过程」。AI 不再只是被调用,而是开始「待在你的工作里」。

Chronicle 和 OpenChronicle,其实是两种很典型的选择:一种,是把「记忆」做成产品能力,放进订阅体系里;另一种,是把「记忆」拆出来,变成所有系统都能用的一层基础设施。

但真正的问题,其实不在「开源还是闭源」。而在另一件更现实的事:当 AI 可以长期记录你的行为、你的习惯、你的工作过程——这些东西,归谁?

OpenChronicle 的答案很简单:留在本地,归用户。于是,一个新的结构开始出现了:模型可以换,工具可以换,但你的「上下文」始终是连续的。

这让三件事情开始松动:

如果说大模型阶段解决的是「AI 能不能理解并回答你」,那么下一阶段的核心命题将是:「AI 能否持续陪伴并参与你的世界」。而这一次,分歧已经出现。

文章来自于微信公众号 "机器之心",作者 "机器之心"

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0