Transformer论文作者Lukasz Kaiser以及GAN作者Bing Xu转发关注了一项工作——

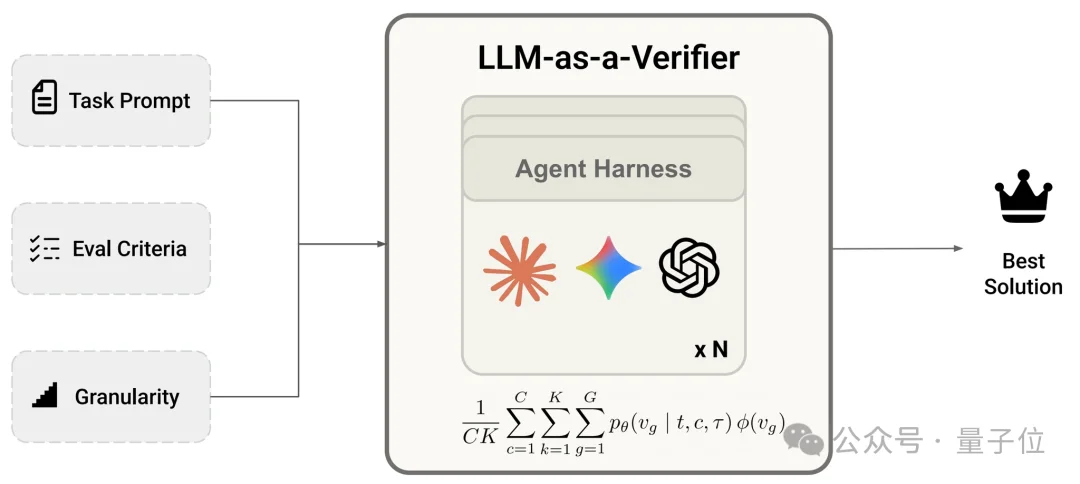

LLM-as-a-Verifier验证框架,该方法是一种通用的验证机制,可与任意Agent Harness和模型结合。

由斯坦福、伯克利与英伟达联手打造。

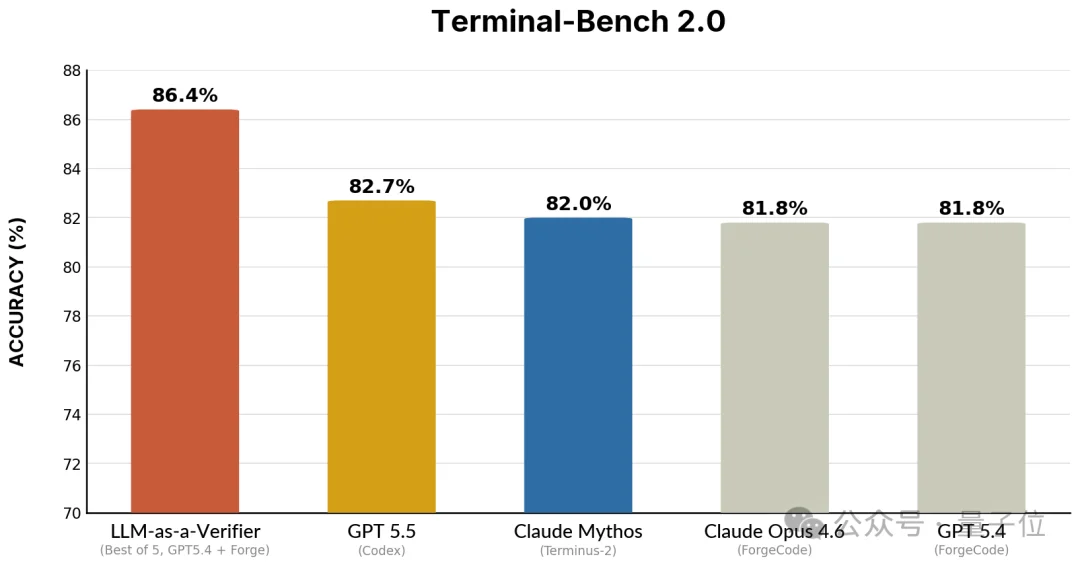

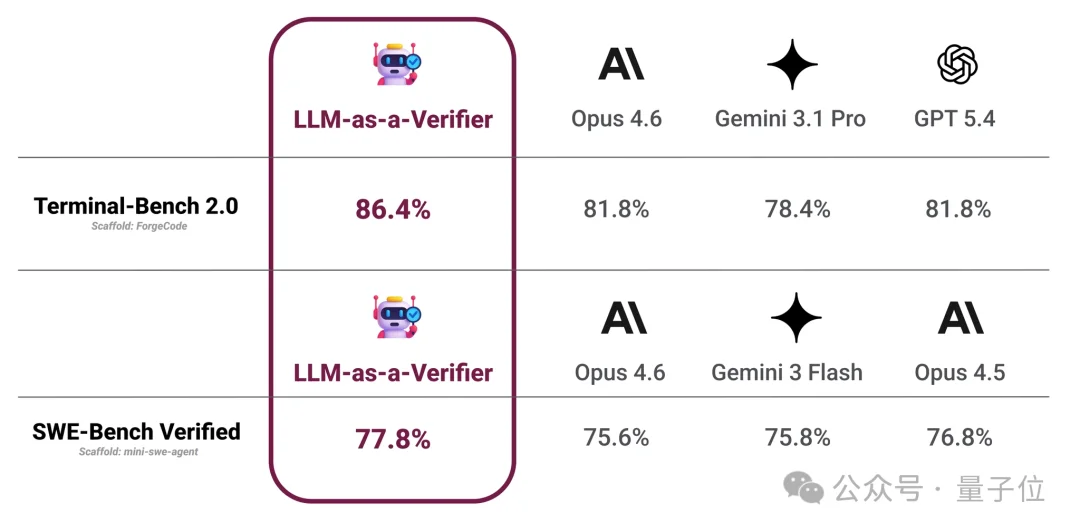

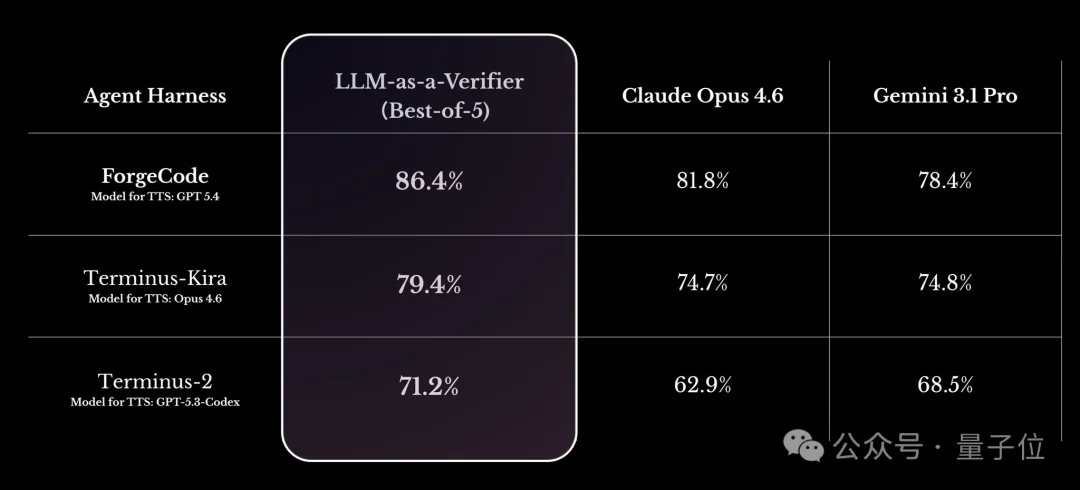

研究表明通过扩展验证阶段的计算量(scaling verification compute),可以显著提升Agent整体性能,并在最有影响力的AI编程基准Terminal-Bench上超越Claude Mythos和GPT-5.5!

LLM-as-a-Verifier在AI Coding基准Terminal-Bench和SWE-Bench Verified上均取得了当前最优(SOTA)性能。

大多数Agent Harness实际上已经“具备”解决问题的能力。

当我们多次运行同一个Agent(例如运行100次),它往往能够在某一次尝试中生成正确答案。

但问题在于,它们无法判断哪一个才是正确的。

这一问题在长时序任务(long-horizon tasks)中尤为严重。

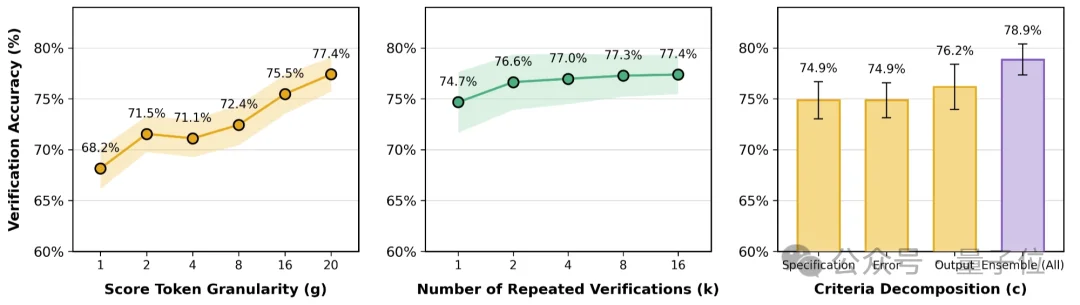

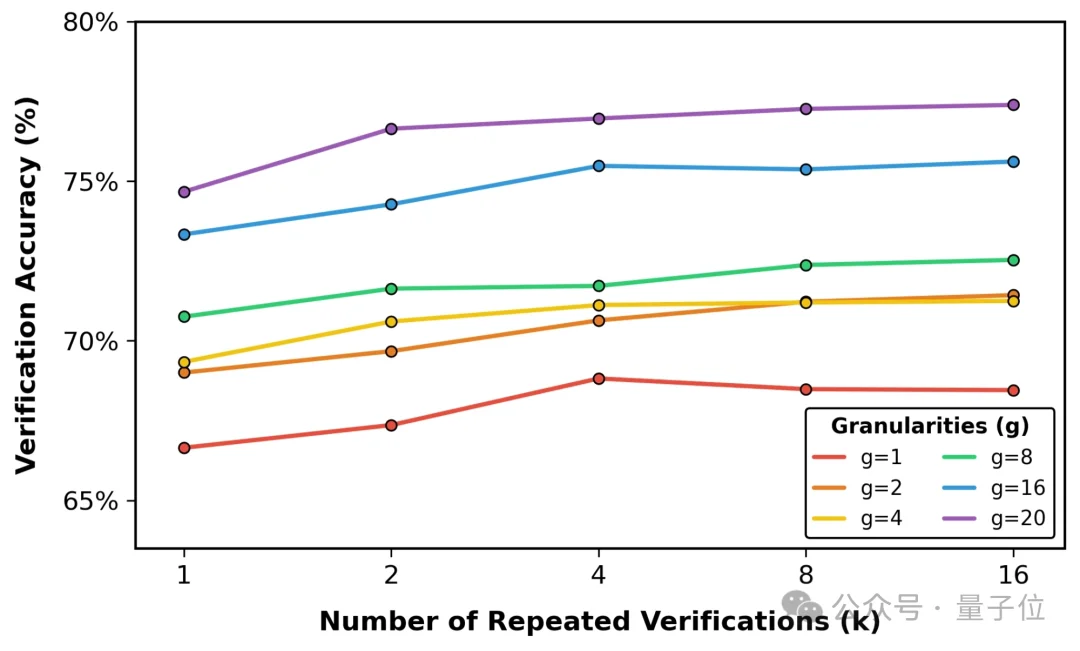

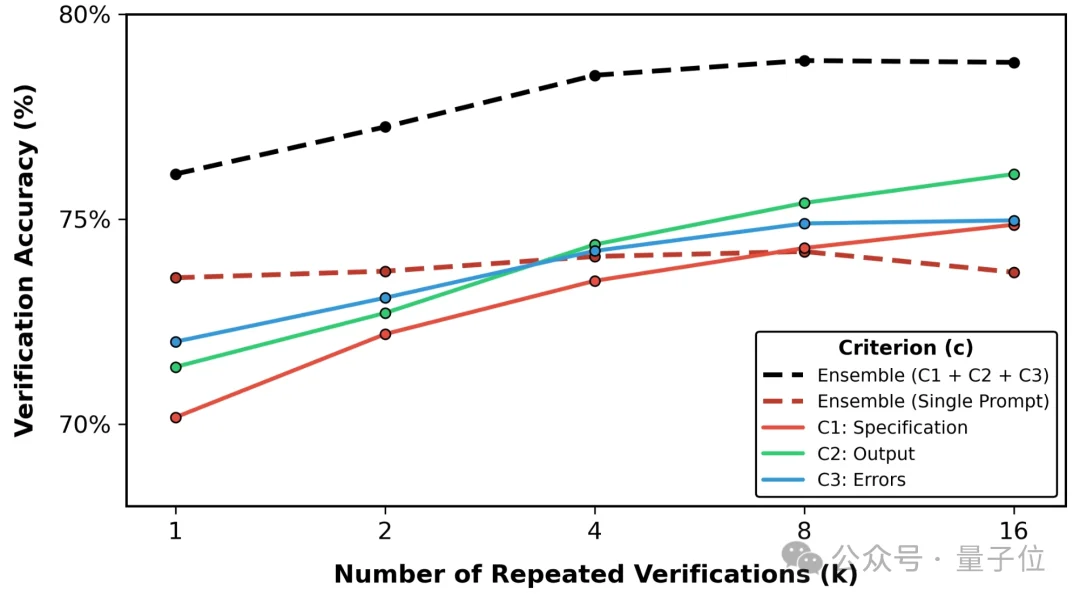

LLM-as-a-Verifier通过scaling评分token的细粒度(score granularity)、多次评估(repeated verification)以及评价标准的分解(criteria decomposition),显著提升了验证能力,并进一步提高了下游任务的成功率。

此外,团队发现随着评分token细粒度的提升,正负样本之间的得分区分度会进一步拉大。

标准的LLM-as-a-Judge通过提示模型输出一个评分结果(例如,1到8之间的分数),并选择概率最高的评分作为最终的离散分数。

然而,这种方法往往存在评分粒度过于粗糙的问题。

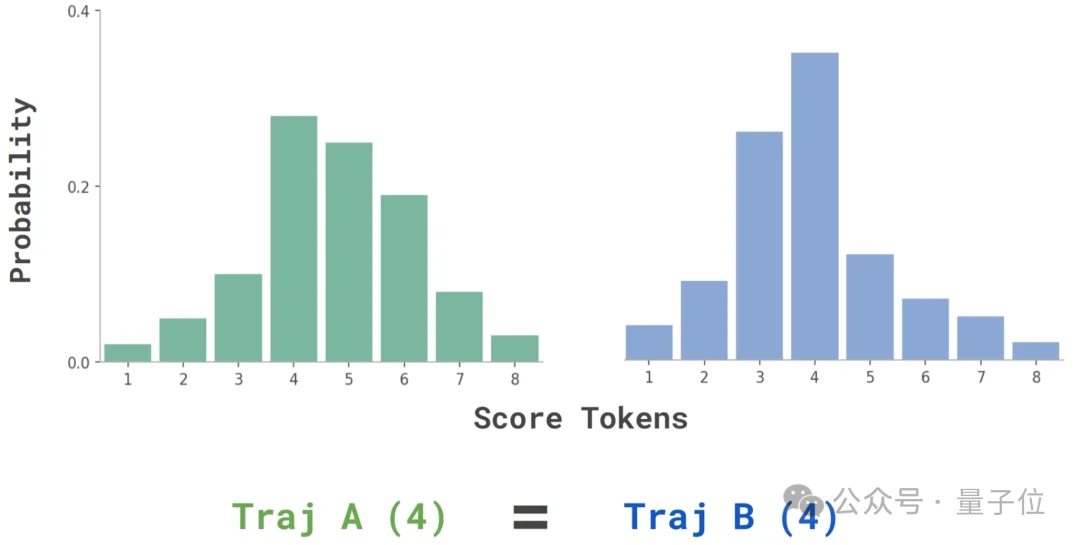

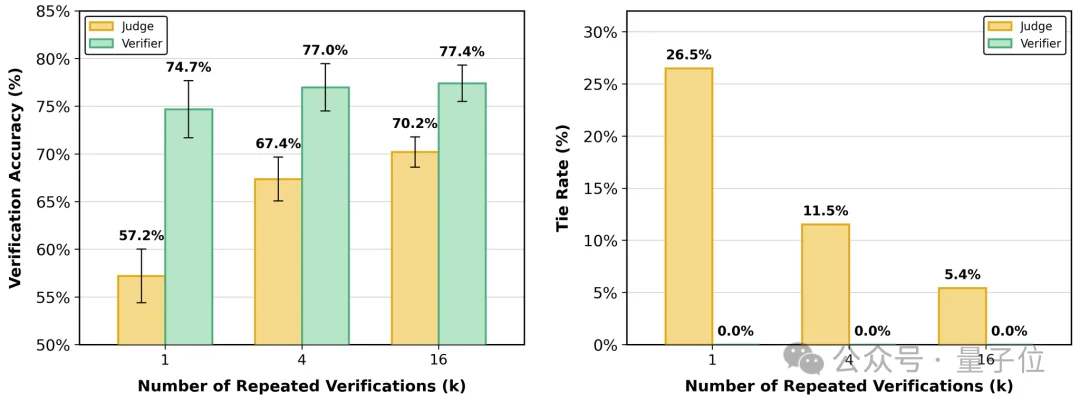

在比较长时序Agent轨迹(trajectories )时,LLM-as-a-Judge通常会为不同的轨迹分配相同的分数(例如,两条轨迹都被评为4分),从而导致平局,无法有效区分它们。

这种粗粒度的评分机制在Terminal-Bench上出现了27%的平局情况,限制了评判的精确性和区分能力。

从定义上讲,judge(裁判者)是对整体情况形成总体判断并给出结论的人;而verifier(验证者)则是对具体事项进行真实及正确性核验的人,因此需要更细致、更具体的评估。

为此,团队提出了LLM-as-a-Verifier。它通过扩展以下三个维度来提供细粒度反馈:

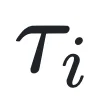

给定任务t以及两条候选轨迹和, LLM-as-a-Verifier构造评分prompt, 并通过从<score_A>和<score_B>中提取toplogprobs,得到对应的条件分布:

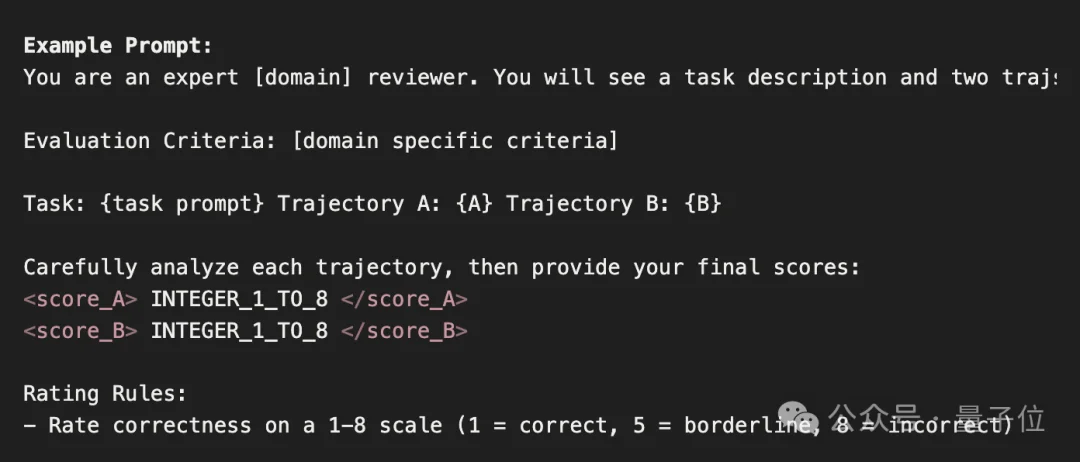

LLM-as-a-Verifier将轨迹的奖励表示为:

其中:

在选择最佳轨迹时,我们采用循环赛(round-robin tournament):对每一对候选轨迹(i, j), 验证器都会利用上述公式计算其reward。

奖励更高的轨迹获得胜利,而在全部比较中胜场数最多的轨迹,将被选为最终结果。

在Terminal-Bench 2.0和SWE-Bench Verified等复杂的长时序基准任务中,LLM-as-a-Verifier的表现全面超越了前沿模型并均取得了当前最优(SOTA)性能。所有实验结果均来源于官方排行榜.

LLM-as-a-Verifier能够在不同的Agent Harness框架中实现无缝集成,其通用性验证于以下三个基准任务:

这表明,无论针对何种Agent Harness或模型,该验证方法皆可高效兼容并提升性能。

LLM-as-a-Verifier在验证准确率和消除平局方面全面领先于传统的LLM-as-a-Judge。

即使在增加重复验证次数的情况下(如 k=16),Verifier方法依然保持了至少7%的验证准确率优势。

此外,它完全消除了平局现象。

试验结果表明,增加评分token的粒度(granularity)以及提高重复验证次数(repeated verifications)均显著提高验证准确率。

此外,在评分token维度的细化分级(1→20)中,量化误差得到了极大降低,从而更接近真实奖励。

LLM-as-a-Verifier放弃传统的单一评分机制,采用将轨迹验证解构为三个可组合的评估标准:

相比传统的LLM-as-a-Judge方法, LLM-as-a-Verifier框架利用更细致的评分粒度、重复验证,以及评估标准分解,实现了更高的验证准确率和更精确的区分能力,消除了评分平局现象,不仅提升了Agent性能,还显著增强了模型在长时序任务中的安全性和稳定性。

本项目由斯坦福大学CS博士生Jacky Kwok负责。主要贡献者包括伯克利EECS博士生Shulu Li。通讯作者有Ion Stoica(UC伯克利教授、Databricks创始人)、Azalia Mirhoseini(斯坦福教授,曾任职于DeepMind与Anthropic)、以及Marco Pavone(英伟达AI与自动驾驶研究总监)。

博客:llm-as-a-verifier.notion.site

代码:llm-as-a-verifier.github.io

联系方式:jackykwok@stanford.edu

文章来自于微信公众号 "量子位",作者 "量子位"

【开源免费】DeepBI是一款AI原生的数据分析平台。DeepBI充分利用大语言模型的能力来探索、查询、可视化和共享来自任何数据源的数据。用户可以使用DeepBI洞察数据并做出数据驱动的决策。

项目地址:https://github.com/DeepInsight-AI/DeepBI?tab=readme-ov-file

本地安装:https://www.deepbi.com/

【开源免费】airda(Air Data Agent)是面向数据分析的AI智能体,能够理解数据开发和数据分析需求、根据用户需要让数据可视化。

项目地址:https://github.com/hitsz-ids/airda

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0