导读:腾讯混元团队提出了 Multi-Stream Scene Script(MTSS),一种全新的视频描述范式 —— 将传统的 "一段话描述整个视频" 升级为 "多流结构化剧本",通过 Stream Factorization 和 Relational Grounding 两大核心原则,让视频描述既忠实又可扩展,在视频理解和生成任务中均取得显著提升。

多分镜、ID 保持、音画同出…… 当视频生成模型开始具备这些核心能力时,一个容易被忽略的瓶颈开始浮出水面:你拿什么来描述一段视频,才能获得更好的效果?

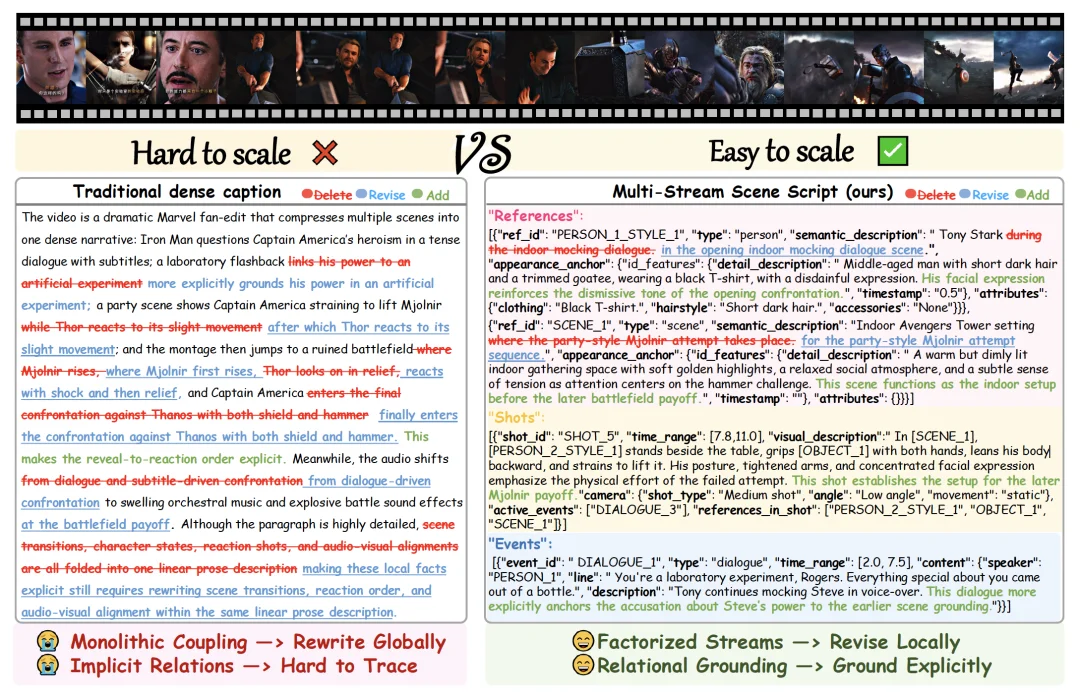

当前主流的做法,是把视觉、听觉、人物、场景、镜头运动等所有信息,全部揉进一段密密麻麻的自然语言段落里 —— 这就是所谓的 Monolithic Caption,我们姑且叫它「流水账」式描述。

这种写法的问题,其实和写剧本一样直观:把演员表、分镜表、音效表全写在一篇散文里,导演没法用,演员看不懂,后期更没法改。

那有没有可能,给视频写一份真正的、更高效的「结构化剧本」?

腾讯混元团队给出的答案是:MTSS——Multi-Stream Scene Script。

「流水账」到底差在哪?

三个绕不开的问题

要理解 MTSS 为什么值得关注,得先看看传统 Monolithic Caption 在实际应用中到底碰到了什么墙。

这些不是理论上的困难 —— 当你想要实现多分镜生成、跨镜头身份保持、音画同出时,「流水账」就成了最大的瓶颈。

不写流水账,改写分镜剧本:

「MTSS」怎么设计的?

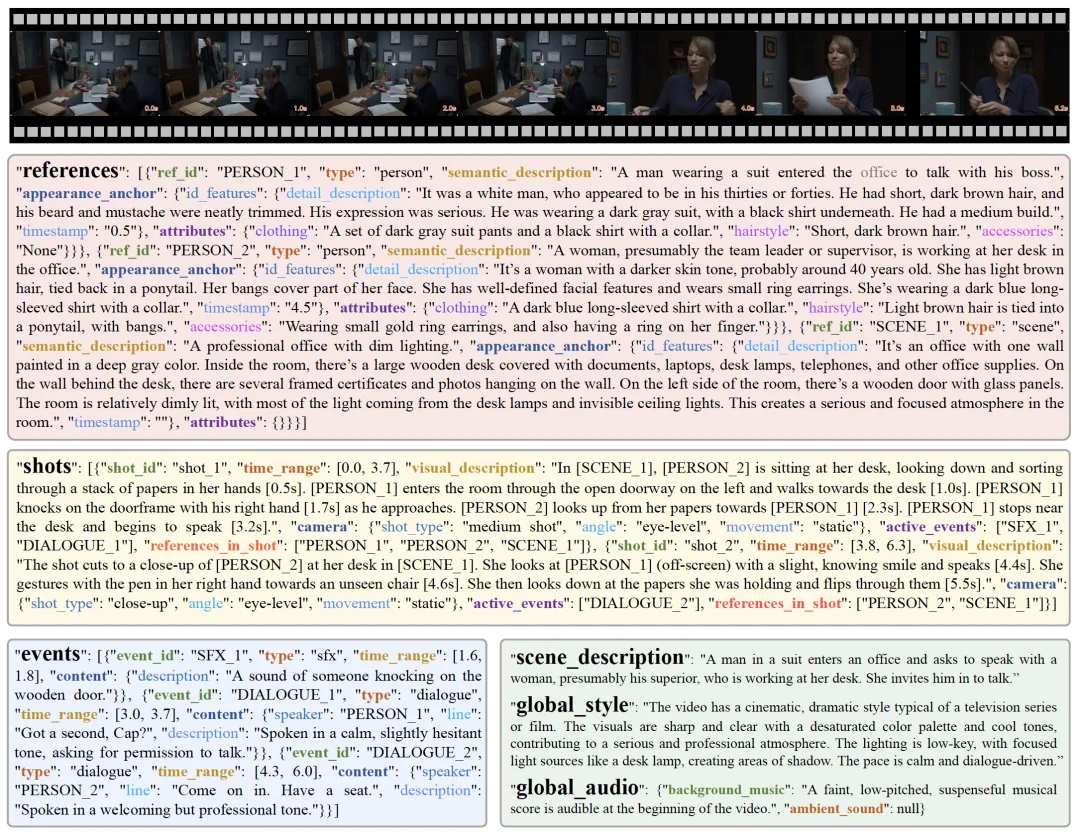

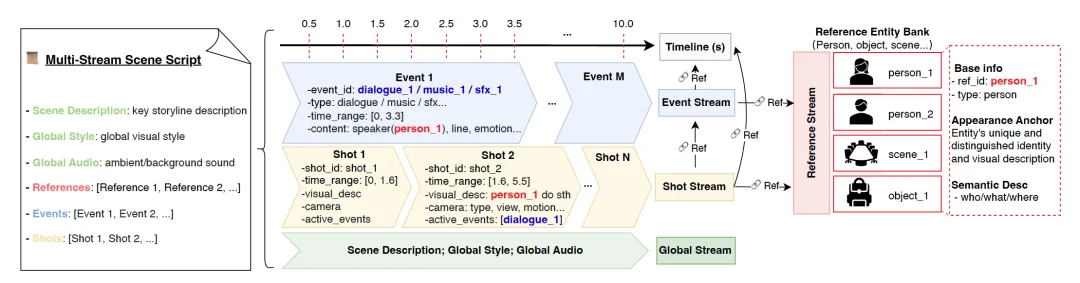

MTSS 的核心思想非常直观:不写流水账,改写 JSON 格式的分镜头剧本。 它的两大核心设计原则:Stream Factorization 与 Relational Grounding。

Stream Factorization:把一段视频拆成四条并行的信息流

MTSS 将复杂的音视频动态剥离开来,变成四个专门的、并行的信息流,并互相引用,实现了对视频信息更本质的表达方式:Reference Stream(资产信息)—— 特征锚点核心;Event Stream(事件信息)—— 发生了什么;Shot Stream(镜头信息)—— 如何呈现;Global Stream(全局信息)—— 全局信息。

Relational Grounding:让四条流 "活" 起来

仅仅分解是不够的 —— 孤立的信息流无法形成连贯的脚本。MTSS 通过 Relational Grounding 在两个维度上重新建立联系:身份锚定实现实体全局引用,时间锚定实现多轨道并行对齐。

这样一来,修改任何一条流中的局部信息(如改变一个角色的台词),不会影响其他流的内容,真正实现了「局部编辑,全局一致」。

与 Monolithic Caption 的效果对比

与传统 Monolithic Caption 相比,MTSS 具备以下核心优势:

理解与生成两手抓:

MTSS 到底有多能打?

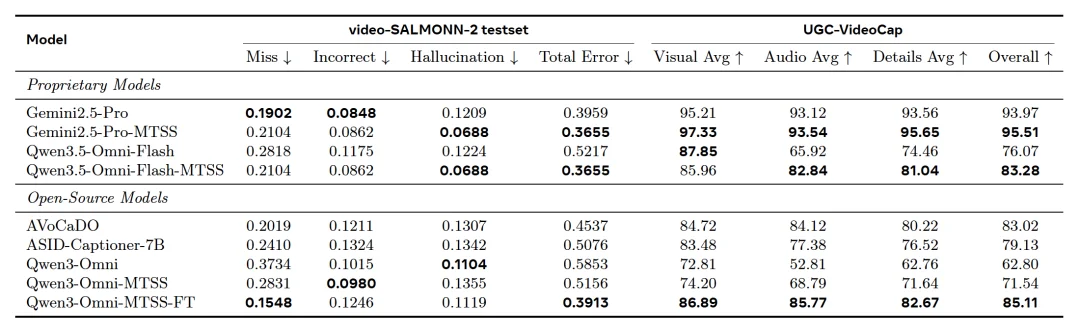

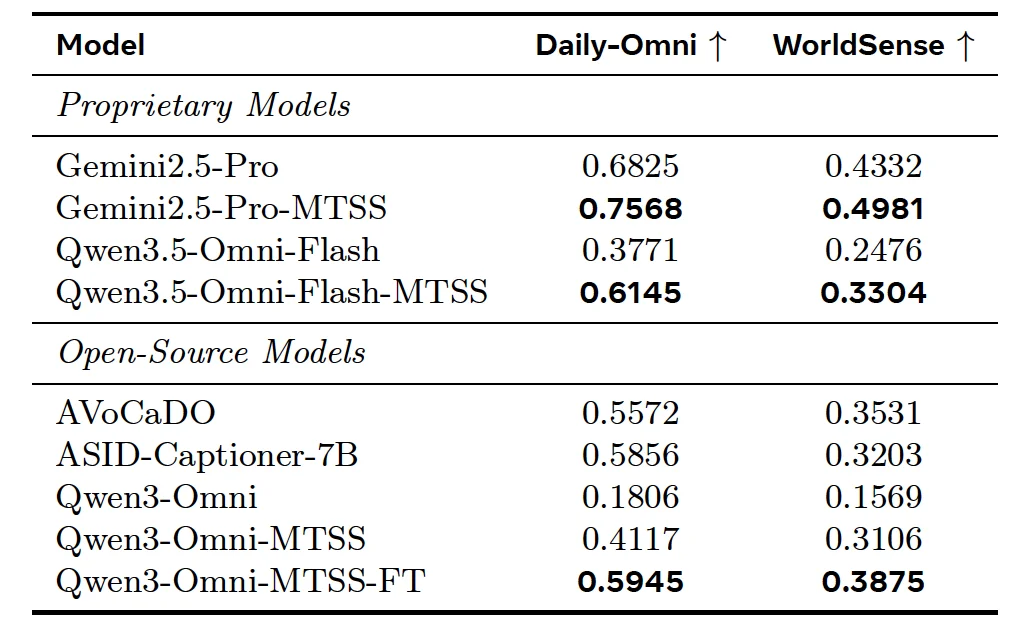

说一千道一万,不如数据说话。针对 MTSS 范式设计的有效性验证,团队在视频理解和视频生成两个赛道上都进行了详尽的实验和评估。

视频理解:格式一换,效果就来

在实验设计上,团队同时评估了 Zero-shot Prompting(直接让模型输出 MTSS 格式)和 Supervised Fine-tuning(在 MTSS 数据上微调)两种使用方式,从而将「格式本身的优势」和「训练带来的优势」进行了有效分离。

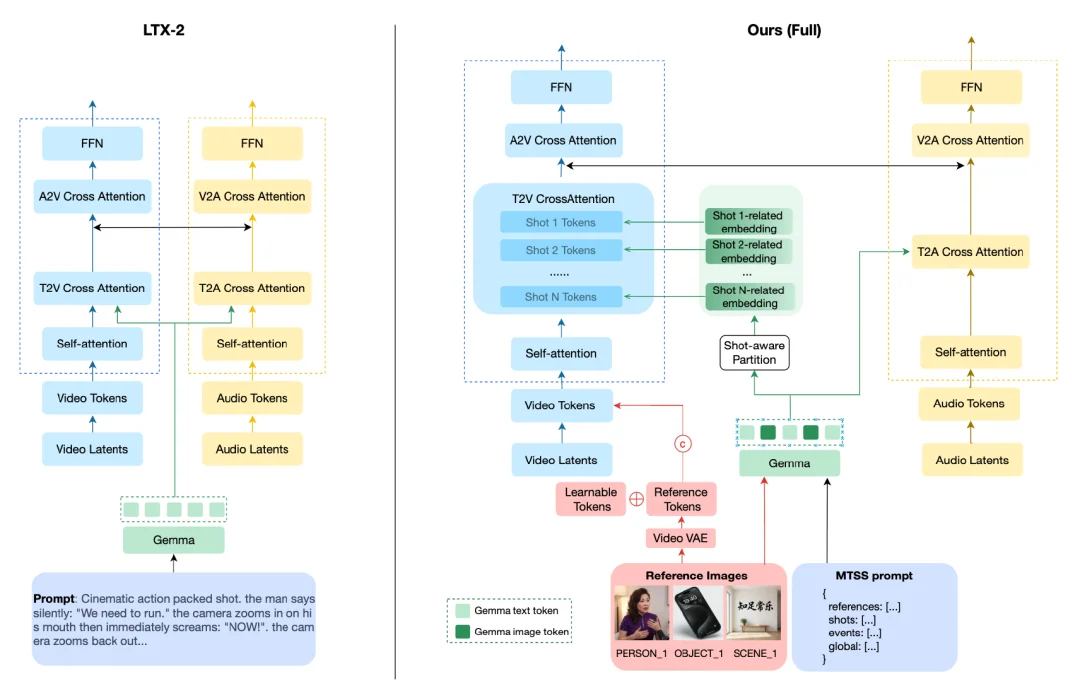

视频生成:从「理解端的描述格式」到「生成端的控制接口」

随着视频生成模型发展至具备多分镜、ID 注入保持、音画同出等核心能力,如何高效地让视频生成模型具备这些能力,数据表达是最关键变量之一。

为了验证 MTSS 范式对视频生成模型的有效性和高效性,团队以音画同出的开源模型 LTX-2 为基础,进行了适配训练验证。主要改动包括:Shot-Aware Structured Attention(镜头感知结构化注意力)和 Identity Customization(身份定制模块)。

效果分析:

结语:从「流水账」到「剧本时代」

长期以来,视频理解、视频生成领域一直试图让模型通过海量的 "糙数据" 自己去领悟视频规律。然而,MTSS 工作证明了:更接近数据本质的表达范式能释放出远超架构微调的红利。

MTSS 不仅是一种 Caption 数据格式,它更像是一个友好的 "认知脚手架",帮助人类和模型更轻易地理解视频、生成视频。

虽然我们仍然面临视角剧烈变化时仍有角色身份维持的挑战,但 MTSS 无疑为下一代 可控、超长、多镜头联合音视频生成大模型 指明了一条极具潜力的数据工程道路。告别 "流水账",迎接 "剧本时代",视频大模型正在进入更加专业化的工业级工作流。

文章来自于微信公众号 "机器之心",作者 "机器之心"

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0