在当今大模型技术飞速发展的背景下,单一模型往往难以在所有场景下都保持绝对优势。近日,以自然启发式 AI 算法闻名的 Sakana AI 宣布,其全新商用 AI 产品——多智能体编排系统「Sakana Fugu」正式开启 Beta 测试。这一动作标志着 Sakana AI 从前沿学术研究向商业化落地迈出了重要一步,也为解决大模型“偏科”问题提供了一种全新的工业级解法。

Sakana Fugu 通过协调多种前沿基础模型的“池”,在编程、数学、科学推理等多个领域实现最先进的性能。

在初期,我们的 Sakana Fugu 模型将以 API 形式提供。它一直是公司内部研究与工程团队的关键工具,现在我们已准备好邀请 Sakana AI 之外的人来试用:

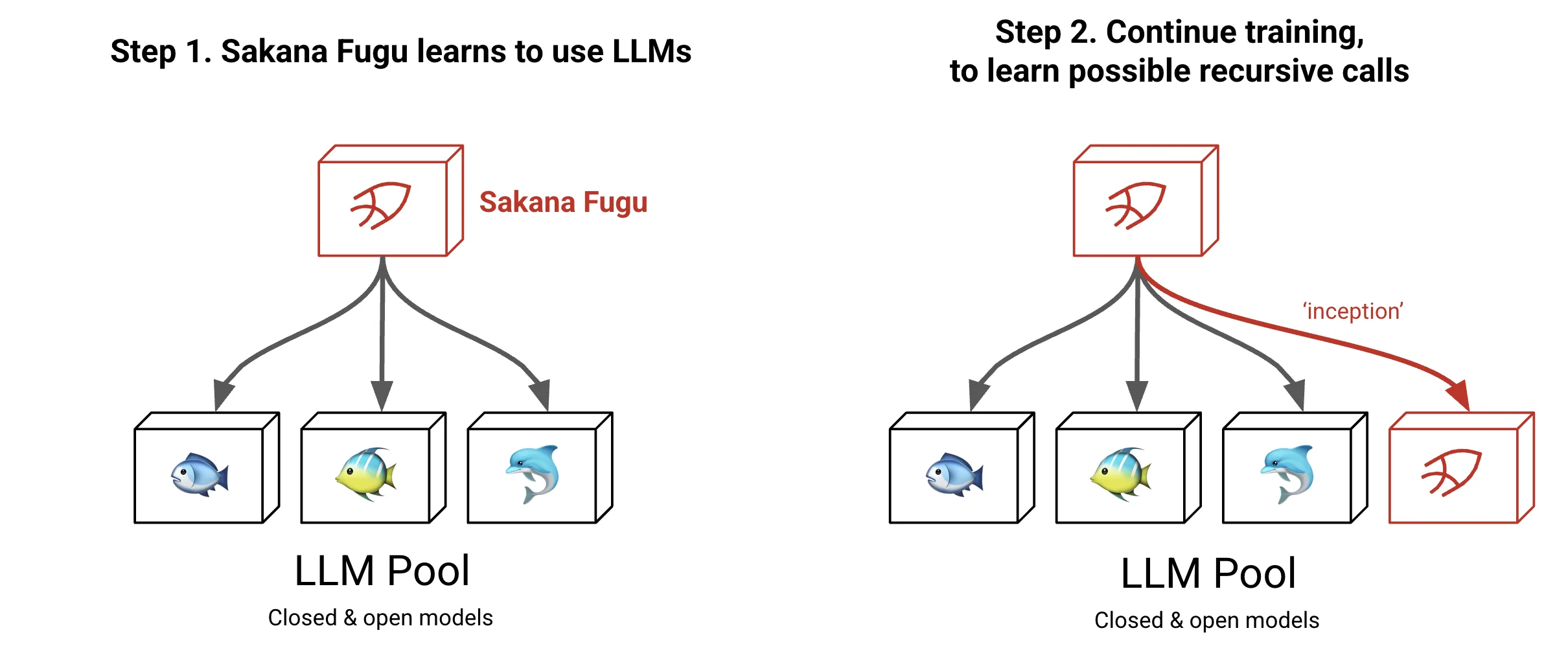

Sakana Fugu 模型本身是一个小语言模型,它会学习调用大语言模型(LLM,左侧图示)。在训练过程中,它还可以学会调用自身,从而实现“测试时的扩展(test‑time scaling)”(右侧图示)。Sakana Fugu 实际的编排机制是自适应且复杂的。(注:原文在此后出现脚注编号 *1,对应页面下方脚注说明)

Sakana AI 的核心理念

Sakana AI 的核心理念是,最强大的 AI 系统并非孤立扩展的单体模型,而是协同工作的多个专业智能体集合。这一理念贯穿我们所有已开发的项目:进化模型合并,它证明了各种开源模型可以组合起来,产生单个模型所不具备的能力;AI 科学家,它证明了协同工作的 AI 智能体可以自主完成科学研究的整个流程;ShinkaEvolve,它利用进化搜索技术,在 LLM 生成的程序池中发现性能优于人类编写的解决方案的算法;以及AB-MCTS,它证明了多个前沿模型通过树搜索进行协作,可以在复杂的推理任务上显著优于任何单个模型。

Sakana Fugu 是该研究方向的成果形式。

Sakana Fugu

传统的架构模型使用方法通常需要用户管理多个 API 密钥,因为不同提供商的模型往往专注于不同的领域。这种多模型管理会导致经济效率低下。此外,由于模型优势通常是针对特定问题而非特定领域,因此最终用户难以通过模型切换进行细粒度优化。

Sakana AI 的 Fugu 模型解决了这些局限性。Fugu 模型通过动态协调和编排一个由众多强大模型组成的多样化模型池,实现了卓越的性能。Fugu 不依赖领域知识来规定团队组织、角色或工作流程,而是学习如何从模型池中动态地组装代理,并通过非显而易见但高效的协作模式来协调它们。

Sakana Fugu 模型基于我们在 ICLR 2026 上的论文(Trinity和Conductor),我们大幅改进了这些方法,以提高性能和用户体验,并将其作为商业产品提供。

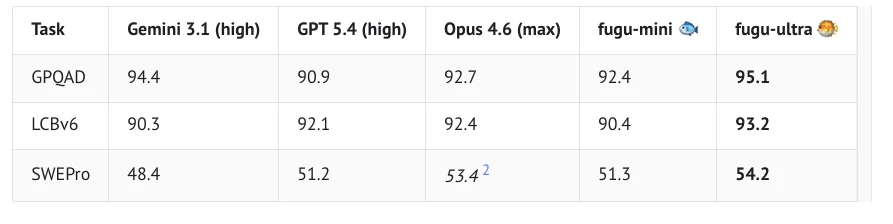

Fugu 在多个极具挑战性的基准测试中取得了新的 SOTA。

其中包括:

• SWE-Pro:针对软件工程和真实世界代码库处理能力的严苛测试,证明了 Fugu 在复杂编程场景的实用性。

• GPQA-D(Google-Proof Q&A Dataset):这是一个连拥有博士学位的人类专家都感到棘手的高难度问答数据集,Fugu 的表现印证了其强大的深度推理能力。

• ALE-Bench:进一步展示了其在多样化智能体任务中的综合优势。

Fugu 模型在既定基准测试中表现出色。上表是我们目前测试版模型的部分测试结果。

Sakana Fugu 使用方法

Sakana Fugu 可通过 API 访问,并兼容标准的 OpenAI 格式端点。如果您已通过 API 使用 GPT、Gemini 或 Claude,则只需进行少量更改即可将 Sakana Fugu 集成到现有工作流程中。在熟悉的界面背后,Sakana Fugu 会自动处理模型池中的协调工作——建立协作拓扑结构、分配角色并分派子任务以完成复杂任务。

有两种版本可供选择:Sakana Fugu Mini 🐟,针对延迟进行了优化;以及Sakana Fugu Ultra 🐡,完整的编排系统,针对高要求任务的性能进行了优化。

行业影响分析:重塑 AI 集成生态与开发工作流

Sakana Fugu 的发布,无论是对企业级用户还是对整个 AI 开发生态,都将产生深远的影响。

第一,大幅降低企业的试错成本与接入门槛。 Fugu 采用了OpenAI 兼容 API 的形式对外提供服务。这意味着现有的 AI 应用开发者几乎不需要重写底层的业务逻辑或大幅度修改现有的工作流,只需更改 API 端点,就能将原本依赖单一模型的系统,无缝升级为一个由多模型驱动的超级大脑。这种“即插即用”的体验将极大加速多智能体技术在企业中的普及。

第二,推动“模型路由”与“多智能体协同”成为行业标配。 过去,开发者在构建复杂应用时,往往需要手动配置不同 API 的调用逻辑(例如用 A 模型写代码,用 B 模型做审查)。Fugu 将这一过程自动化、智能化。未来,开发者的关注点将不再是“哪个模型最好”,而是“如何利用像 Fugu 这样的编排系统解决业务问题”。

第三,延长了现有大模型的生命周期。 通过 Fugu 的编排调度,一些在综合排名上不再顶尖的老模型,可能会因为其在某些特定子任务上的微弱优势而被重新组合利用。这不仅提高了算力资源的使用效率,也为整个大模型生态提供了一种更加包容和可持续的发展路径。

文章来自 “ https://sakana.ai/fugu-beta/ “

【免费】cursor-auto-free是一个能够让你无限免费使用cursor的项目。该项目通过cloudflare进行托管实现,请参考教程进行配置。

视频教程:https://www.bilibili.com/video/BV1WTKge6E7u/

项目地址:https://github.com/chengazhen/cursor-auto-free?tab=readme-ov-file

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md