我们对于 “个人助手” 的想象,正在变得越来越具体。

一个真正嵌入日常生活的 AI 助手,需要能够从每个人生活中的蛛丝马迹里学习和理解,解决复杂生活场景中问题。

在 AGI-Next 前沿峰会上,腾讯姚顺雨举了一个很生活化的例子:当你问 AI “今天吃什么” 时,真正限制答案质量的,可能不是模型不够大,也不是推理不够强,而是它不知道你今天冷不冷、想不想吃热的、最近和朋友聊过什么、家人又有什么偏好需要纳入考虑。

因此,下一代 AI 助手真正需要的,往往不是记住更多 “知识”,而是对 “生活上下文(context)” 的理解与推理。这也正是 CL-Bench family 最新续作 CL-Bench Life 想要回答的问题。

下面,我们将结合混元模型团队的最新博客《Real life is where context gets hard》,看看那些人类应对起来几乎毫不费力的日常,对于 AI 来说为何如此棘手。

想要真正解决现实世界的问题,AI 不能仅仅依赖训练时记住的知识,它必须从当下正在发生的事情中学习新的 context、基于它们进行推理,并记住那些真正关键的信息。此前,我们打造了 CL-Bench 来测试这种上下文学习能力。但现在回过头看,我们给 AI 了 一个巨大的捷径:context 已被提前整理好。

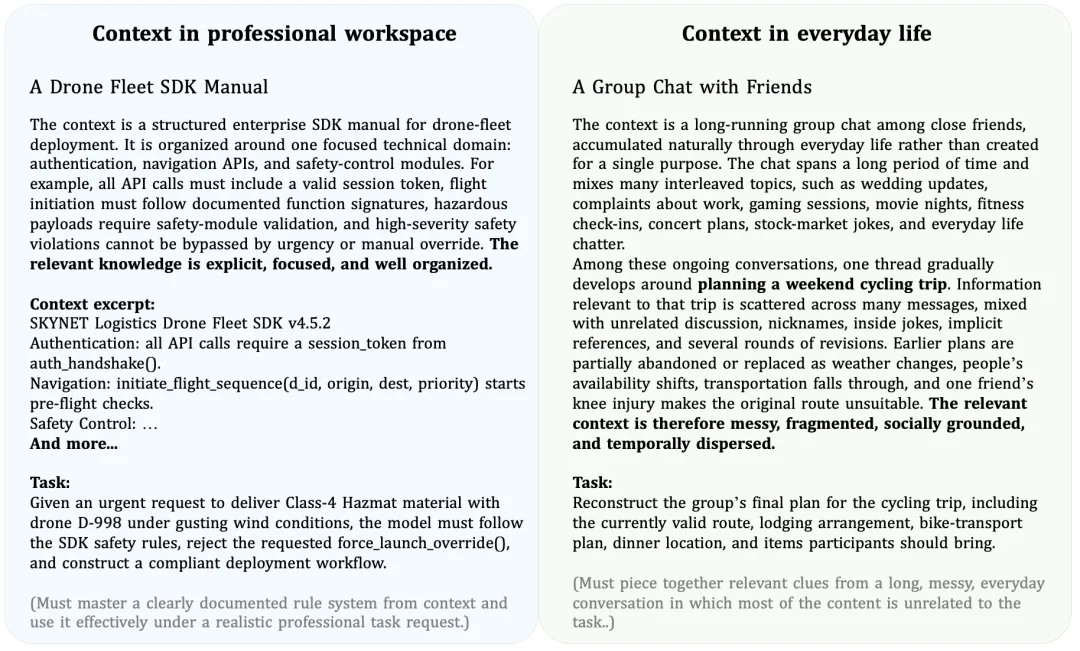

图:专业领域或工作场景中的 context 结构相对清晰,知识点更聚焦(左);日常生活中的 context 更凌乱,更碎片化,往往包含多个话题(右)。

这种假设在专业的领域下相对成立,但在大家的日常生活中却截然不同。回想一下我们每天都要面对的 context:

① 在一个日常闲聊和各种话题交错展开的亲友群中,理清大家本周末的时间安排、出行意愿、忌口等信息,敲定一份大家都能接受的周末旅行计划;

② 从 “文件传输助手” 里散落的几十条没来得及读的分享链接和随手写的备忘录中,拼凑出一份完整的产品规划;

③ 又或是从自己过去大半年断断续续的运动打卡和康复日志中,分析出某个部位总是容易受伤的真正原因。生活是混乱的、极其碎片化的,仅仅依靠时间线勉强串联。

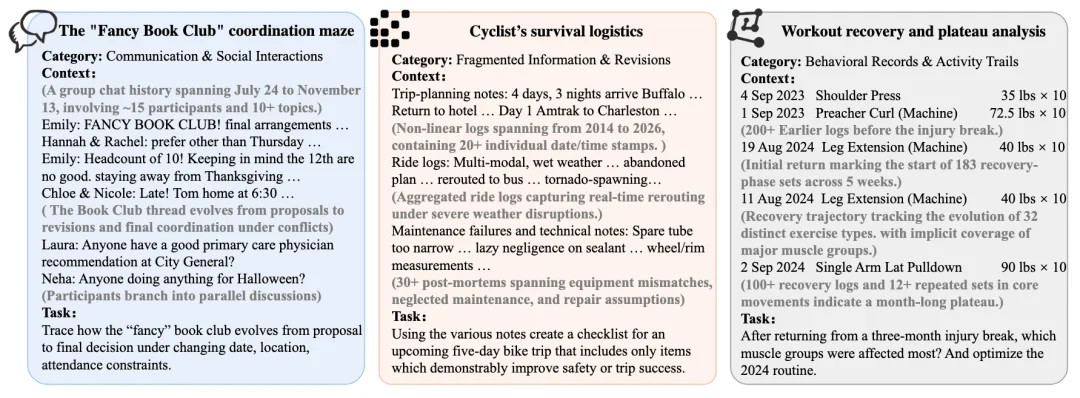

图:三个日常生活面临的 context 例子。Case 1: AI 需要分析一段冗长、嘈杂的多人群聊,其中包含多条交错讨论线、不断变化的计划,以及分散在不同时段的时间冲突,来帮助组织一次读书会;Case 2: AI 需要分析大量零散的骑行记录、车况维修记录、突发事件和日记,为五天骑行计划筹备一份以安全为核心的检查单;Case 3: AI 需要分析某个用户数百条受伤前后的训练记录,判断哪些肌群受到的影响最大并安排恢复计划。

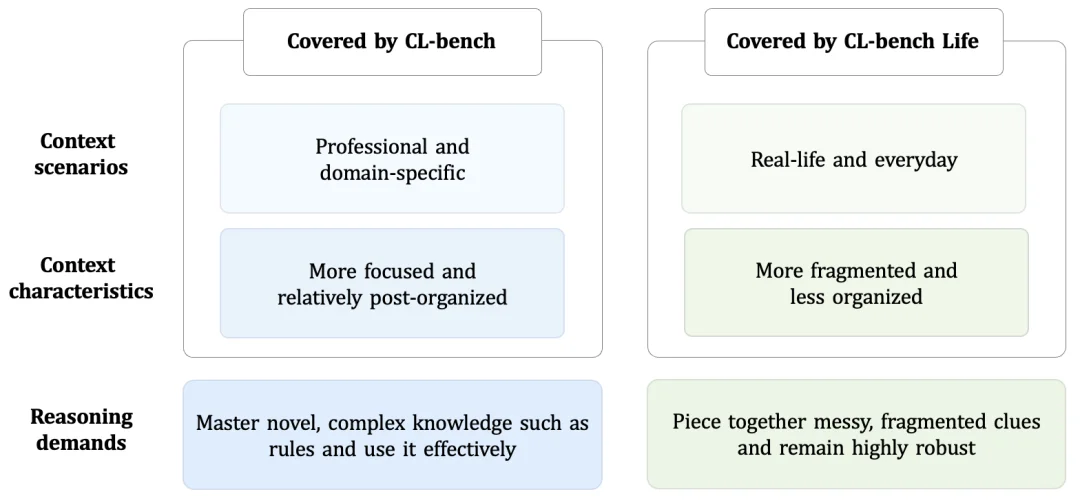

我们常常低估了这对 AI 来说有多难。最初的 CL-Bench 测试的是模型能否掌握并用好复杂的新知识。但现实生活从来没有发给我们一本 “说明书”。AI 不能只停留在理解干巴巴的规则上;它还必须能够在混乱、稀碎的线索中拼凑出事情的真相,并在各种干扰下保持极高的鲁棒性。

图:CL-bench 和 CL-bench Life 所覆盖的两类 context-learning。

如果真想让 AI 蜕变为真正的私人助手,它们就必须切实读懂我们到底是如何生活的。为了迈出这一步,腾讯混元团队弥补了 CL-bench 未覆盖的场景,正式推出 CL-Bench Life。

为了精准衡量 AI 在现实生活中的 “上下文学习” 能力,腾讯混元正式推出了 CL-Bench Life。这是一个完全由人工精心构建的基准,包含了 405 个真实的任务。

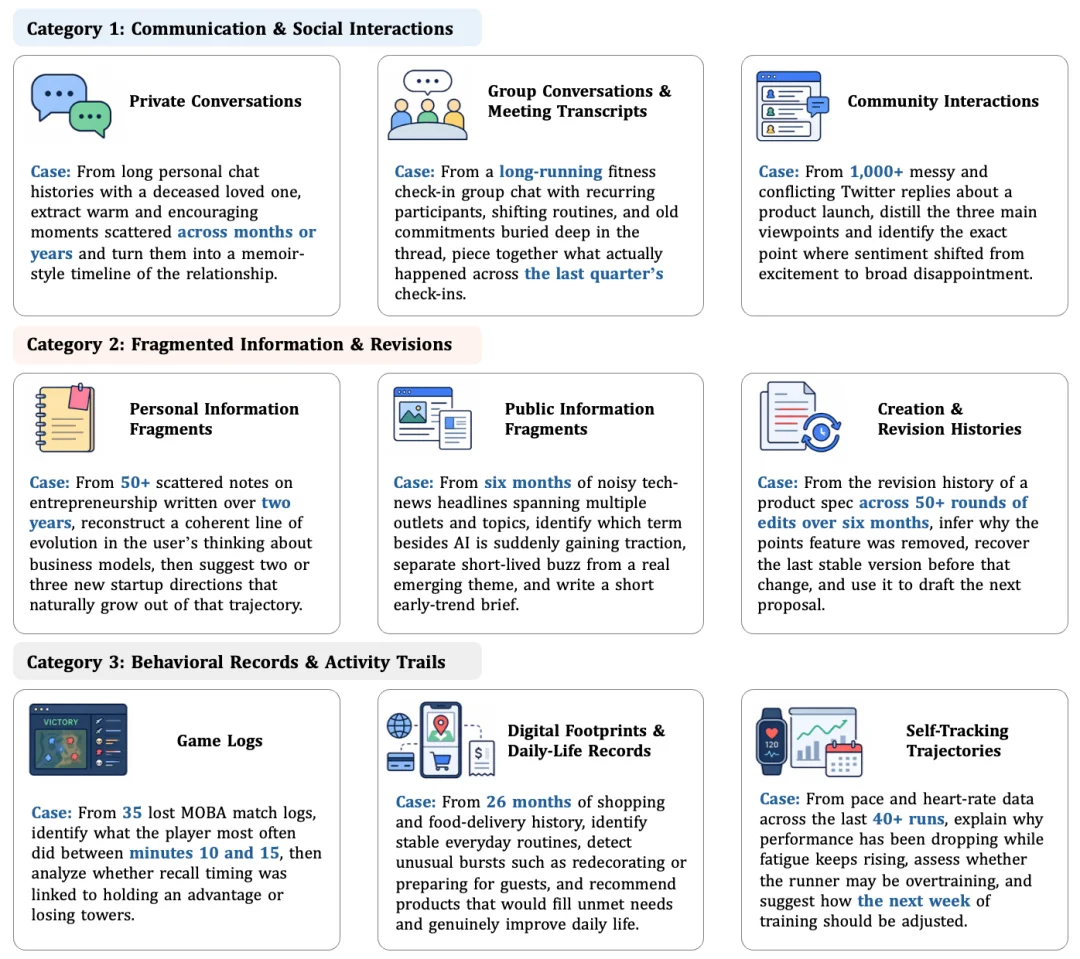

为了最大限度地覆盖最常见的真实场景,研究团队将整个测试基准划分为三大核心类别:

图:CL-bench Life 的 context 分类体系。

1. 沟通与社交互动(与他人交互时产生的上下文): 这一类覆盖一对一私聊,混乱的多人群聊,活跃的社区讨论等场景。要在这类任务中成功,AI 必须学会 “读懂话外之意”。它需要理解复杂的人际关系,感知隐藏的情绪变化,推理出一个群体如何逐渐形成共识,并从日常闲聊中分析出真正有用的信息。

2. 碎片信息与修改轨迹(围绕自身主动产生的上下文): 这一类包括零散的个人笔记、公共信息流,以及文档反复修改留下的历史记录。这一类 context 的难点包括但不限于:需要模型必须从非常凌乱的日常信息碎片中重建出完整的逻辑线,或整理并推理出一个想法或者安排是如何被多次修改的。

3. 行为记录与活动轨迹(在生活中被动产生的上下文): 这一类涵盖游戏日志、数字足迹,以及长期个人追踪记录。在这一类型的 context 中,AI 往往需要从一串行为痕迹中推理出背后所隐含的原因。例如,它要求模型进行分析一长段消费流水 / 健身数据等的行为记录,或者理解人的潜在习惯并发现长期习惯中的异常变化等。

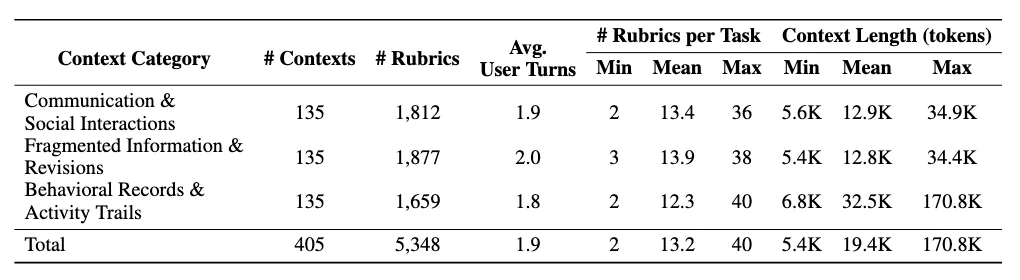

CL-Bench Life 还包含了 5348 条完全由纯人工编写的评分标准,平均每个任务对应 13.2 个考核点。这些 rubrics 被设计得尽可能原子化,从而能够更全面、更细粒度地评估模型的答案是否正确。

表:CL-bench Life 的统计信息,包括 context 和任务数量、rubrics 数量、context 中多轮对话的平均轮次、每个任务的 rubrics 数量,以及 context 的 token 长度。

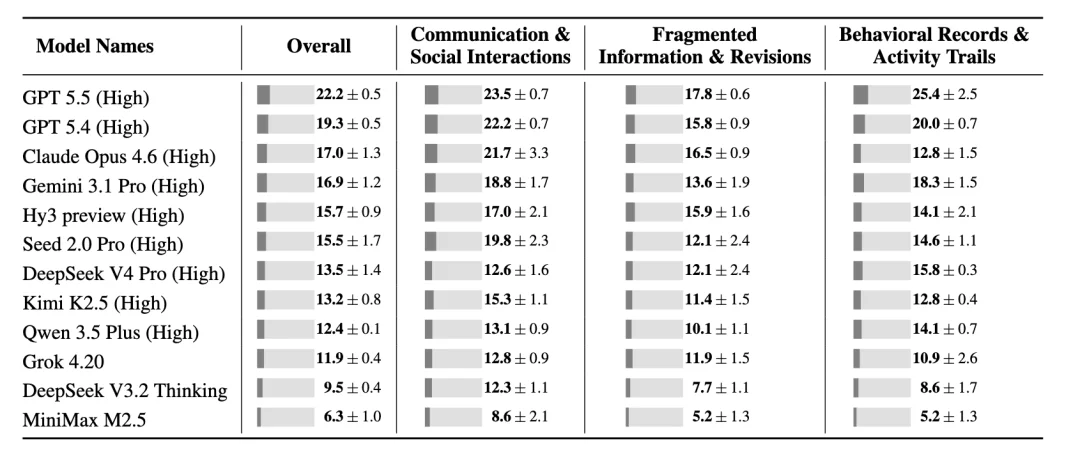

研究团队测试了 12 个不同的语言模型(更多模型的评测结果详见的开源榜单),初步的评测结果表明,这些模型平均只能解决 CL-bench Life 中 14.5% 的任务。即便是表现最好的 GPT-5.5(High)也只能解决 22.2% 的任务。这表明模型还不擅长处理高噪声的零碎 context。

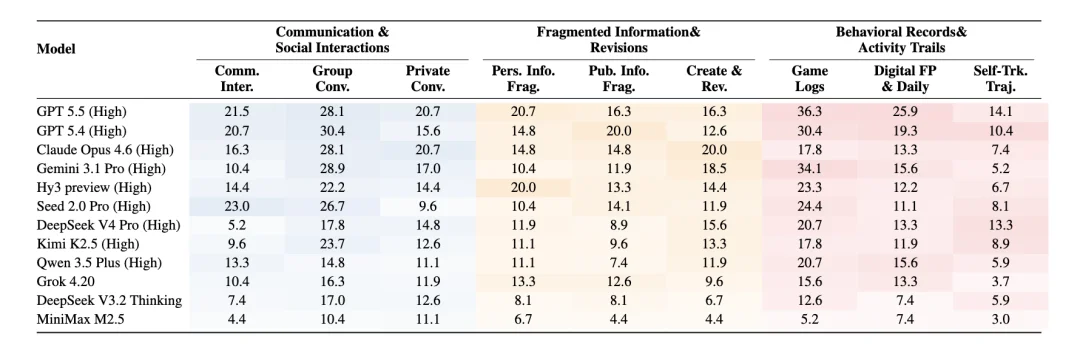

表:前沿语言模型在 CL-bench Life 上的任务解决率。

这一结果甚至比在 CL-bench 中的表现更低。在 CL-bench 中,同一批模型平均能够解决 20% 以上的任务。这一差异也证实了 CL-bench Life 测试的是另一维度的 context learning。CL-bench 中的 context 是来自专业领域的、往往相对更清楚,结构清晰,被有序的组织整理。此时,模型需要具备的能力是掌握新的知识例如规则或流程等,并有效使用它们。而相反的是,CL-bench Life 中的 context 是来自日常生活的,往往更混乱,无序,信息随时间轴可能被反复修改。在 CL-bench Life 中,模型需要整理分散在 context 各处的线索,处理噪声,并始终保持鲁棒。

这说明了,当模型面对的不再是清晰的、被相对有序整理过的 context,而是面对杂乱、碎片化、弱结构化的 context 时,context learning 会变得更加困难。这两个场景对模型提出不同方面和程度的 context learning 要求。

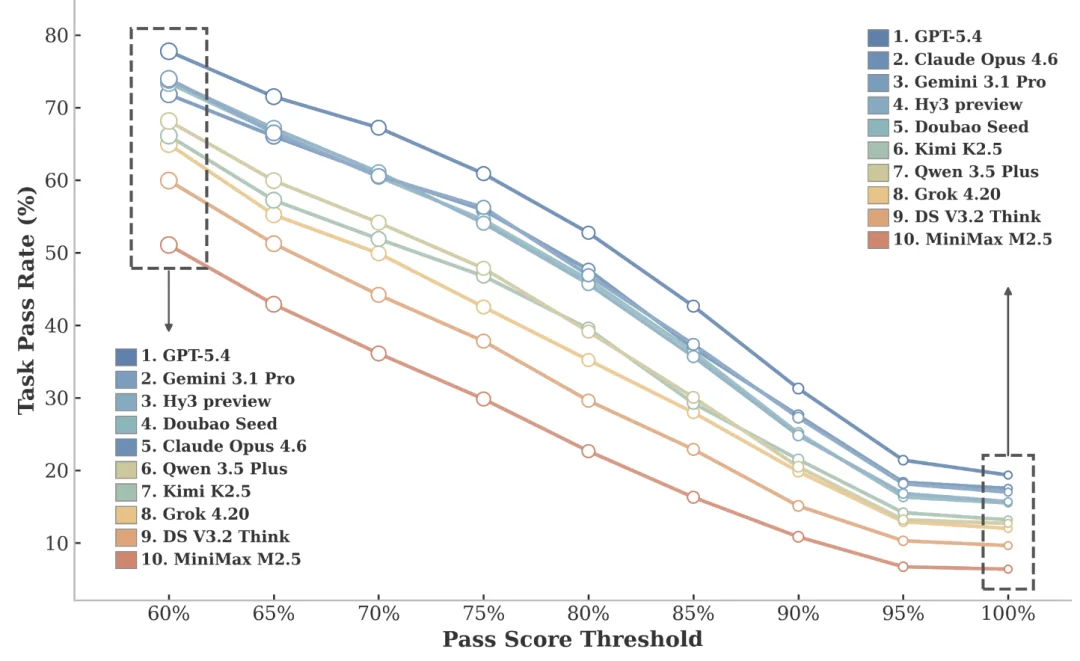

除了整体表现之外,进一步的实验分析还揭示了一些重要发现:

1. 在 CL-bench Life 中,虽然模型完美解决任务的比例不高,但部分正确的比例要高得多。当研究团队调整任务通过阈值时(即一个回答至少需要满足多少比例的 rubrics 才算正确),模型的通过率会发生明显变化。阈值越宽松,各个模型的通过率都会显著上升。这说明模型虽然很难完整解决一个任务,但确实能够理解其中一部分 context,并完成一部分任务。

图:模型在不同任务通过阈值下的表现。

与此同时,在不同阈值下,模型之间的相对排名大体保持稳定。这意味着 CL-bench Life 既能很好地区分 “理解部分 context” 和 “完美解决任务”,也能在这种情况下支持对不同模型进行相对稳定的比较。

表:CL-bench Life 各类别和子类别上的模型表现。

2. 不同类别的 context 对模型 context learning 能力的要求各有侧重。即便 CL-bench Life 中的 context 都属于日常生活场景,信息也都是碎片化的,但信息的类型并不一样,也导致了对模型的能力要求有不同的侧重。例如,在沟通和日常交流大类中,除了信息的碎片化外,困难也主要来自社交关系和多人互动:相关信息分散在交错的话题、讨论线也是重叠的、人物关系和对话的指代关系也更加复杂。而在碎片化信息和修订记录大类中,模型需要整合不连续的线索,并推理一个内容是如何随时间变化而不断被修改的。

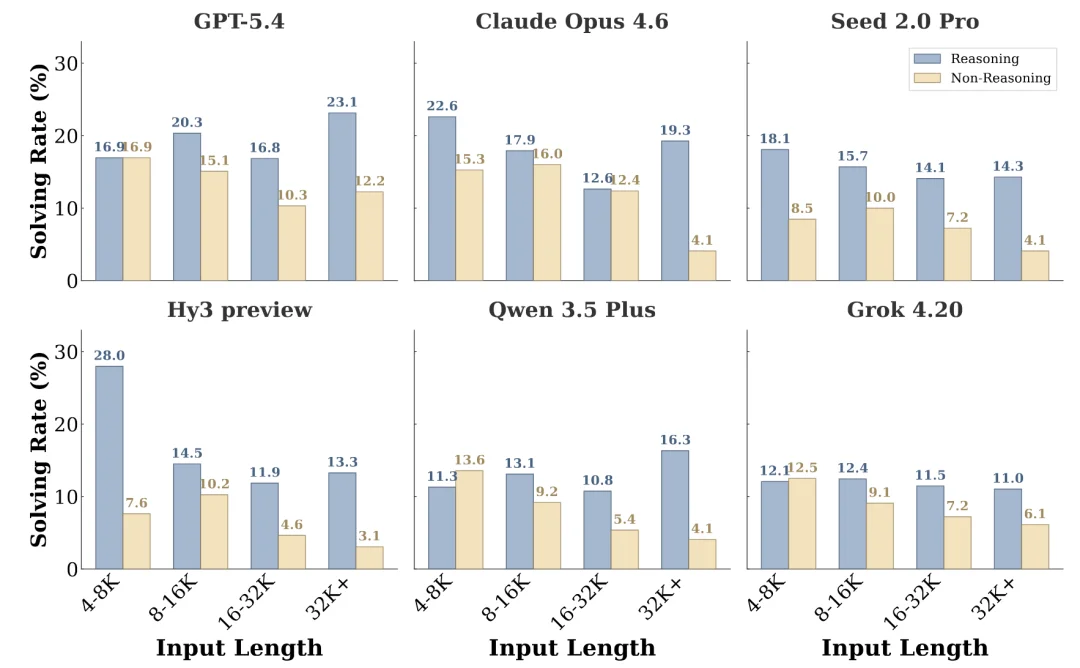

3. 模型在日常生活中 context learning 能力的不足,不能简单归因于长文推理能力的问题。研究团队发现,更长的输入确实可能让任务更难,但输入长度本身并不能完全决定任务难度。具体来说,模型一旦开启 reasoning 模式,context 长度和模型表现之间的关系就变得不那么相关(如下图所示)。这说明日常生活 context learning 的主要瓶颈并不只是模型能否处理更长的输入(即长文推理能力),还在于能否处理高噪声输入。

这与CL-bench 中的现象有所不同。在 CL-bench 中,随着 context 变长,模型表现通常会更明显地下滑,因为更长的输入往往意味着模型需要吸收更多新的复杂知识。而在 CL-bench Life 中,长度只是一个较弱的预测因素。即使 context 不长,但只要它包含大量的噪声、被反复修改,或真正的有用信息分散在的各处时,模型处理这些 context 也可能会非常困难。

图:在 reasoning 和 non-reasoning 下,不同 context 长度区间中的任务解决率。

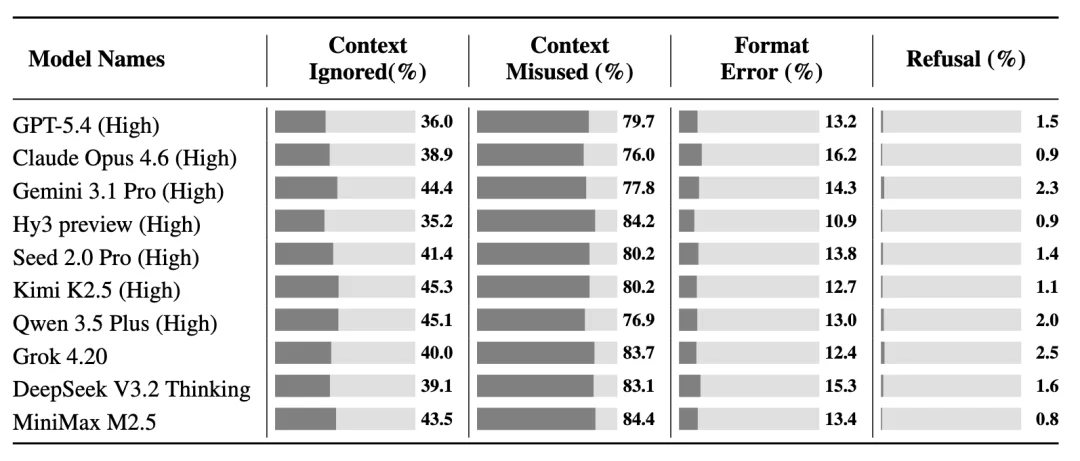

4. 为了进一步理解这些局限,研究团队分析了模型的失败原因。跨模型来看,最主要的错误类型是 context misuse:模型通常确实看到了 context,但仍然误解或误用了它。值得注意的是,这与 CL-bench 中的 context misuse 不完全相同。在 CL-bench 中,误用 context 往往意味着模型错误地应用了 context 新定义的知识。而在 CL-bench Life 中,错误更多来自模型理解错了一个日常中经常发生的 context。例如,混淆了一个随口提到的 “他” 到底指谁;依赖已经被后续的修订推翻了的早期信息进行推理;误把临时的草稿修改 / 口头的随意说辞当成最终决策;或者把一段个人的行为轨迹看成孤立事件,而没有推理出一个长期的习惯。另外,相比之下,格式错误在 CL-bench Life 中要少得多,模型直接拒答的情况也很少。

图:四类错误在不同模型中的分布。Context misuse 是主要失败因素,而格式错误和拒答相对较少。

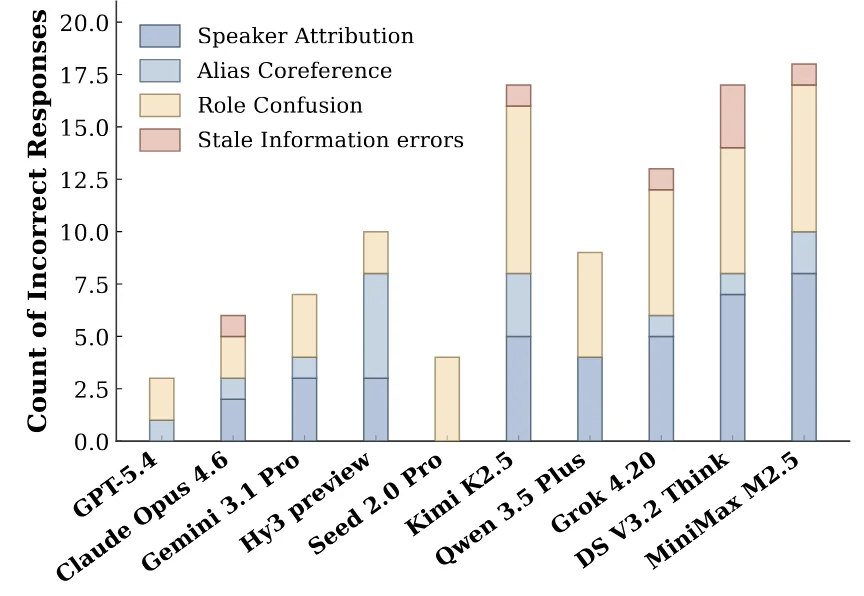

下面,研究团队深入分析了模型在群聊类 context 中的常见错误,来进一步探索模型在日常生活场景下 context learning 失败的原因。

图:沟通和日常交流类别中 群聊 context 的错误分析。

在群聊和会议类 context 中,最常见的错误是角色混淆以及说话人归因错误,例如模型不能正确记忆哪些话是谁说的以及引用了哪些话。例如,在一个由 Alice、Brenda、Clara 三人协作答复用户食谱与园艺提问的 Slack 频道中,Gemini 把 "创建频道、发起规则" 的 Alice 误认为是上级 ,把真正拍板裁决的 Clara 当作其下属,推断错了这个组织里面的人际关系角色。因此之后一连串的上下级汇报关系也搞错了。

这说明模型理解群聊 context 的核心难点不仅在于需要时刻跟踪事件的发生,这还需要在混乱的多人互动中持续维护用户信息、说话人的身份,以及在实际参与者之间不断变化的关系中保持鲁棒。

总体来看,这些进一步的实验发现说明了 CL-bench Life 并不只是 CL-bench 一个更难的版本,而是一个互补的评估基准:它评估模型是否能够在真实生活中那些杂乱、碎片化、持续变化的 context 上进行鲁棒推理。

CL-Bench Life 揭示了一个不容忽视的结论:即使是当今最顶尖的 AI 模型,也还远没有真正读懂我们的日常。 这也解释了很多人和 AI 交流时,会觉得 AI 还是不够机灵。即使我们把聊天记录、零散笔记、行为记录都交给模型,希望他能处理这些日常事务时,它有时还是 “抓不住重点”。这是因为它可能仅仅读到了信息,却没有真正理解这些信息在现实生活中的含义。

腾讯混元团队希望 CL-bench 和 CL-bench Life 能从两个互补方向共同推动 context learning 的发展:一手掌控专业领域中聚焦、有条理的知识;一手应对真实生活中碎片、混乱的现实,最终帮助 AI 在人类的工作和日常生活中都变得更加智能、实用和可靠。

但显而易见的是,这条围绕 context 发展的路并不会停在这里。让 AI 学会处理复杂 context,是它真正走进现实世界的关键。CL-bench 系列工作推动 AI 更深入理解 context 是这其中非常重要的一步,而让 AI 学会在长期使用中记忆、整理和组织 context,则是迈向真正能服务人类的个人助手的下一步。

文章来自于微信公众号 "机器之心",作者 "机器之心"