导读

Google悄悄干了一件大事——Gemini Embedding 2正式进入GA阶段,成为Gemini API中第一个原生多模态embedding模型。它能把文本、图片、视频、音频、PDF文档全部映射进同一个统一向量空间,支持100多种语言。已有法律检索公司Harvey、记忆型数据库Supermemory、时尚电商Nuuly跑出实打实的指标提升。开发者社区炸了,但质疑声也同步跟上。

5月1日,Google for Developers官方账号发了一条看起来不太起眼的推文:

"Now that Gemini Embedding 2 is GA, let's explore what the model unlocks — from agentic multimodal RAG to visual search — as it maps text, images, video, audio, and documents into a unified embedding space."

「Gemini Embedding 2已经GA了,来看看它解锁了什么——从agentic多模态RAG到视觉搜索——它把文本、图片、视频、音频和文档映射进一个统一的embedding空间。」

▲ Google for Developers 官方推文宣布Gemini Embedding 2正式GA,9000+次浏览

乍一看像是又一次例行产品更新。但仔细读完官方文档、开发者博客、社区讨论之后,你会发现——这次Google打的牌,根本不在"聊天能力"这张桌上。

它瞄准的是更底层的东西:检索基础设施。

Google AI官方账号几乎同一时间发了一条解释帖,把embedding模型比作"通用翻译器"(universal translator):

"Think of an embedding model as a 'universal translator.' It takes text, images, video, and audio data and turns them into a long string of numbers, like a unique digital fingerprint."

「把embedding模型想象成一种'通用翻译器'。它把文本、图片、视频和音频数据转化成一长串数字,就像一个独特的数字指纹。」

▲ Google AI 官方解释帖,近4万次浏览、656赞——一条科普帖能拿到这种数据,说明开发者确实在意这个方向

这个比喻精准地击中了核心:Gemini Embedding 2做的事情,就是给所有模态的数据发一张"统一身份证"。

文字有文字的指纹,图片有图片的指纹,视频有视频的指纹——但这些指纹全部在同一个坐标系里。这意味着你可以:

以前要拆四五套管线才能勉强做到的事,现在一个API调用就搞定。

过去说"多模态",大家想到的是什么?是大模型能看图、能听音频、能理解视频。但这些能力一直停留在"生成侧"——模型会回答问题,但你的检索系统依然是割裂的。

文本一套encoder,图片一套encoder,视频、音频再各有各的处理逻辑,最后靠额外对齐、重排、规则层硬拼起来。

Gemini Embedding 2这次最关键的一步,是把"理解能力"推到了召回层。

官方博客里有一句话特别值得细品:

"Beyond processing one modality at a time, this model natively understands interleaved input so you can pass multiple modalities of input (e.g., image + text) in a single request."

「它不只是一次处理一种模态——它原生理解交错混合输入,你可以在一个请求里传入多种模态的输入(比如图片+文本)。」

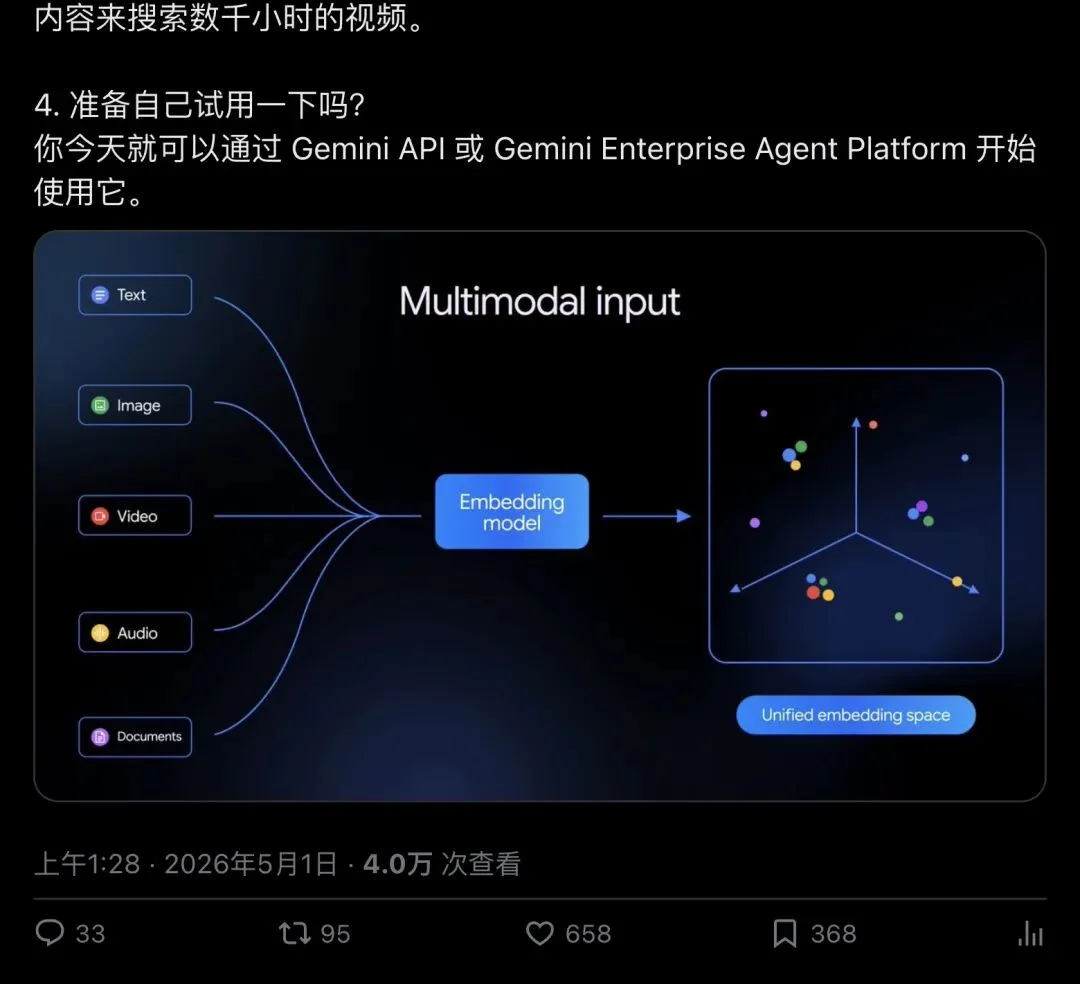

▲ Gemini API Embeddings 官方文档页——代码示例、维度策略、多模态接入一应俱全

注意"interleaved input"这个词。它强调的重点在于:一个请求里就能理解混合输入,并压成一个统一向量。

这跟"模型能看图"完全是两码事。

Google这次给出了非常详细的输入限制,说明这个能力已经在面向真实工程场景:

默认输出维度3072,但支持通过`output_dimensionality`参数截断到更小维度。官方推荐三档:768 / 1536 / 3072。

背后用的是Matryoshka Representation Learning(MRL)——大白话说就是"套娃学习":大向量的前缀本身就是一个有效的小向量。你不用每次都上满血3072维,768维可能就够用了,存储和检索成本直接砍掉一大块。

这组数字的意义,远比模型本身更实际——它让工程团队第一次能算清楚:视频知识库能不能做?语音片段要不要直接塞进召回?PDF需不需要预切页?

▲ Google The Keyword 官方博客——由Google DeepMind的产品经理Min Choi和Distinguished Engineer Tom Duerig联合发布

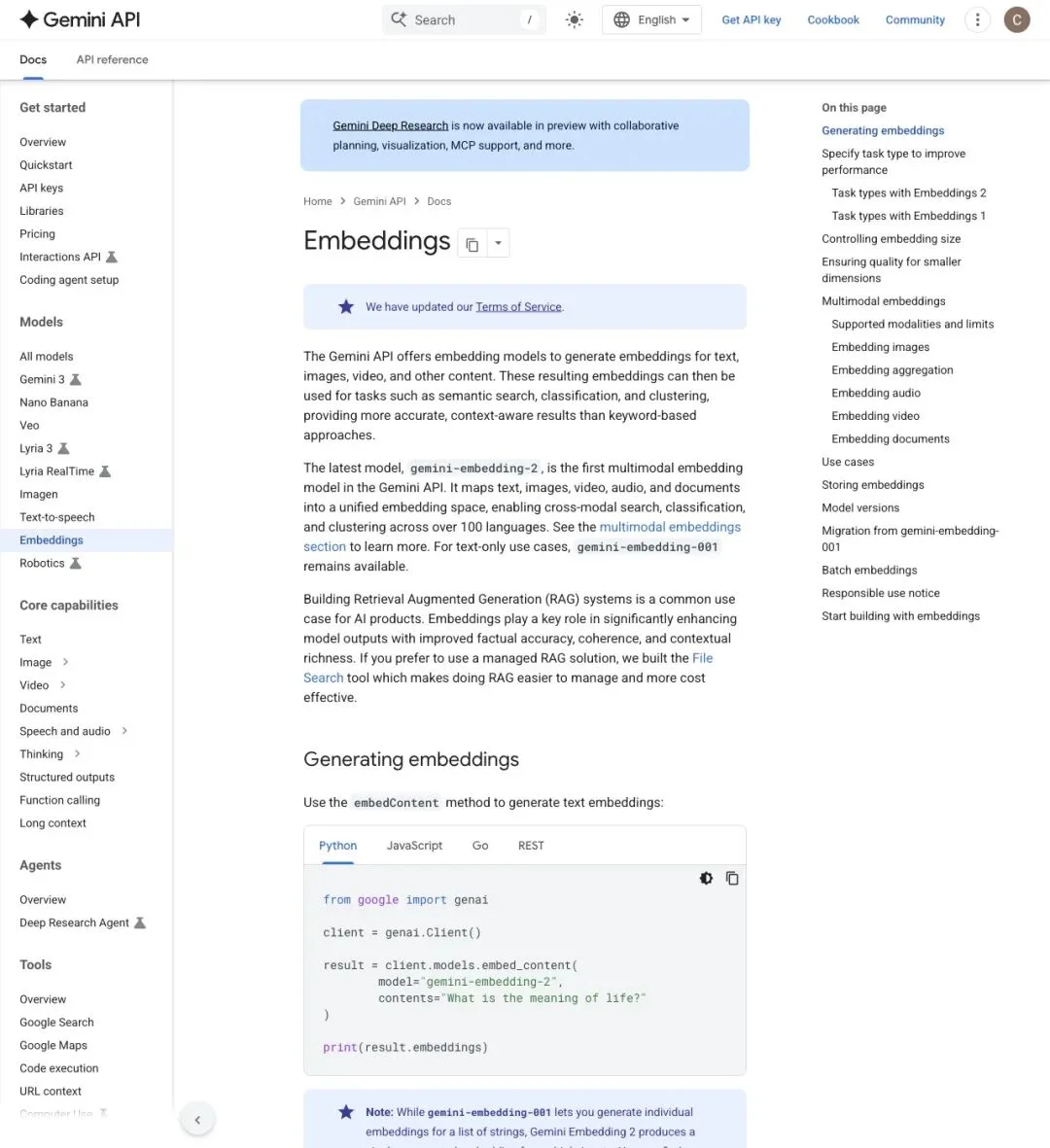

Google这次没有只讲概念,开发者博客直接甩出了三个落地案例。

Harvey——法律检索:Recall@20精度提升3%

法律行业最怕的就是"召回看似对、引用实际错"。Harvey在法律场景benchmark上,换用Gemini Embedding 2后,Recall@20精度提升了3个百分点。别小看这3%——在法律场景,一个错误引用可能就是一场官司。

Supermemory——记忆型数据库:search Recall@1提升40%

Supermemory是做AI记忆和个人知识库的。集成后,search Recall@1直接提升了40%。这个数字太炸了——它意味着"你问一个问题,系统第一次返回的结果就是正确答案"的概率,提高了将近一半。

Nuuly——时尚电商视觉搜索:识别率从74%飙升到超过90%

这是最让普通人秒懂的案例。Nuuly做服饰租赁,需要把仓库里拍的衣服照片和商品目录匹配起来。用了Gemini Embedding 2之后,Match@20从60%提升到接近87%,整体识别率从74%飙到超过90%。

拍一张衣服照片,系统就能在库存里精准找到"它是谁"——这才是"统一向量空间"四个字的真实含义。

▲ Google Developers Blog——详细展示了agentic multimodal RAG、visual search等应用场景和工程规格

seed tweet里专门用了`agentic retrieval`这个词。这几个字绝对经过反复斟酌。

因为AI agent要真正工作起来,光"会回答"远远不够。它需要:

Gemini Embedding 2补的,就是agent的眼睛和记忆索引层。

以前agent只能在纯文本里翻找,现在它可以"看"图片、"听"音频、"读"PDF,然后在同一个语义空间里做cross-modal检索。

Google把embedding和Gemini Enterprise Agent Platform绑在一起推,意图已经很明显:它想让开发者用一套检索底座,撑起整个agentic工作流。

开发者社区的反应很有意思——既兴奋又警觉。

Max Calkin直接说:没有Gemini Embedding 2,他的产品beacn.space根本做不出来。这是builder视角最直接的反馈——好不好用,看能不能立刻长出新功能。

▲ Max Calkin:没有Gemini Embedding 2,beacn.space就不可能实现

AI Security Gateway则从安全角度泼了一盆冷水:多模态embedding意味着图片、视频和音频现在都会通过你的embedding API。面部信息、文档、带有名字的音频——PII暴露面显著扩大,远超纯文本RAG的范围。

▲ AI Security Gateway:多模态embedding让PII暴露面显著扩大

Vanar则点出了另一个关键问题:这确实是跨模态统一表示的重要一步,但接下来真正要看的,是在现实世界的噪声和规模下,检索准确率到底站不站得住。

▲ Vanar:关键看真实世界噪声和规模下的检索准确性

HN上的讨论更加直白。

用户jeanloolz说:"This is colossal."因为几乎所有常见格式都能做embedding了。但他也补了一句——context window跟纯文本比还是偏小。

另一位用户Grimblewald立刻拿它跟Qwen的开源多模态embedding对比,质疑API-only模式下开发者根本没有控制权:

"Qwen gives great embeddings out of the gate while also being steerable... Not seeing the value add here."

「Qwen开箱就能给出很好的embedding,还能自己控制方向……看不出这边的附加价值在哪。」

还有人第一反应就是问pricing——对很多工程团队来说,embedding永远看的不只是模型质量,还有能不能大规模索引、长期跑得起。

▲ Hacker News上的讨论——36个赞,5条评论,兴奋与质疑并存

统一向量空间听起来很美,但有两个现实问题不能回避:

第一,切换embedding模型意味着整库重建索引。

这对任何已经在跑向量检索的团队来说都是大工程。即使新模型效果更好,也不等于能"无痛替换"。shadow test、A/B测试、逐步迁移,一个都不能少。

第二,多模态进来后,数据治理的复杂度直接翻倍。

以前只处理文本,团队主要担心文本泄露。现在图像里的脸、音频里的名字、视频里的场景、PDF里的敏感版式,全部进入了同一条处理链。

合规团队如果还在用纯文本时代的审计逻辑,迟早要出事。

这次Gemini Embedding 2的GA,表面上是一次产品更新,但更深层的信号是:Google正在把多模态从"演示能力"推向"开发者基础设施"。

以前多模态是demo里的亮点,现在它开始变成检索栈里的默认层。

当图、文、音、视频、PDF终于能在同一个向量空间里被统一检索,AI产品的天花板就不再被模态边界卡住了。

当然,开源社区不会坐视。Qwen的多模态embedding已经在路上,更多开源替代会接踵而至。API-only还是可自托管,闭源生态还是开源生态——这场关于AI检索底座归属权的战争,才刚刚打响。

文章来自于微信公众号 "桂宫说事",作者 "桂宫说事"

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】FASTGPT是基于LLM的知识库开源项目,提供开箱即用的数据处理、模型调用等能力。整体功能和“Dify”“RAGFlow”项目类似。很多接入微信,飞书的AI项目都基于该项目二次开发。

项目地址:https://github.com/labring/FastGPT

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI