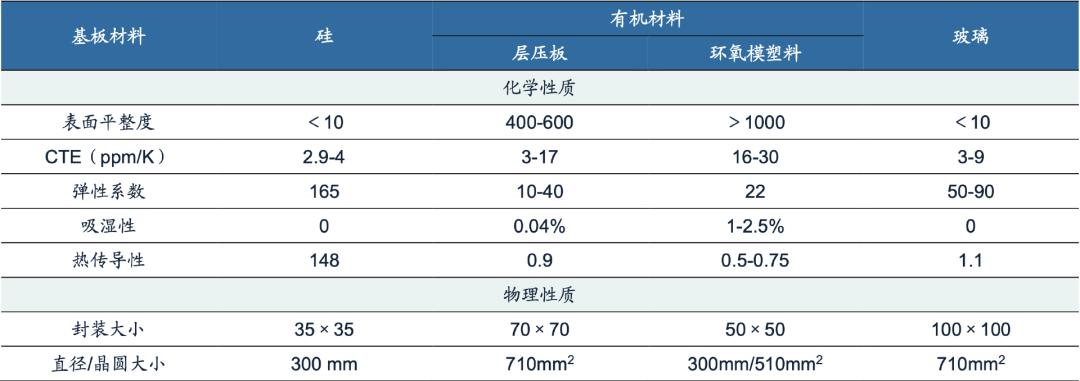

AI来了,玻璃基板概念也火过头了

AI来了,玻璃基板概念也火过头了这一把火,似乎烧得有点太猛烈。

这一把火,似乎烧得有点太猛烈。

北大-兔展联合发起的Sora开源复现计划Open-Sora-Plan,今起可以生成最长约21秒的视频了!

多模态大模型,也有自己的CoT思维链了! 厦门大学&腾讯优图团队提出一种名为“领唱员(Cantor)”的决策感知多模态思维链架构,无需额外训练,性能大幅提升。

AGI发展观点多元,技术风险需警惕管理。

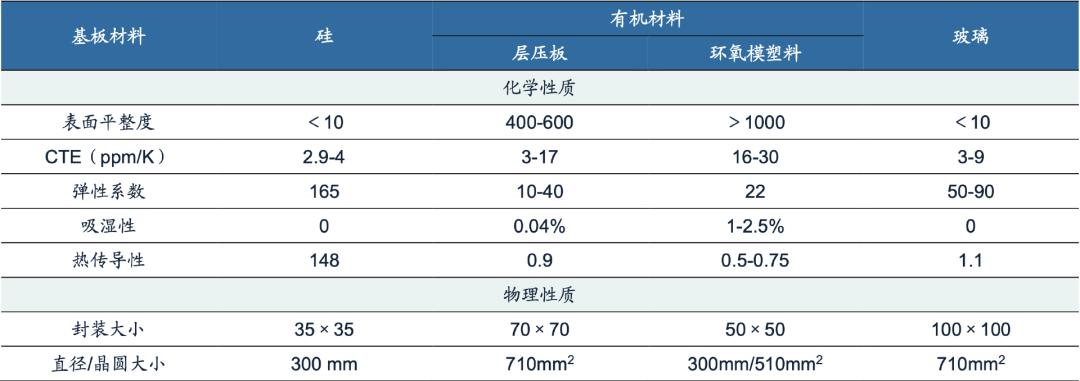

随着大语言模型(LLM)的快速发展,其在文本生成、翻译、总结等任务中的应用日益广泛。如微软前段时间发布的Copilot+PC允许使用者利用生成式AI进行团队内部实时协同合作,通过内嵌大模型应用,文本内容可能会在多个专业团队内部快速流转,对此,为保证内容的高度专业性和传达效率,同时平衡内容追溯、保证文本质量的LLM水印方法显得极为重要。

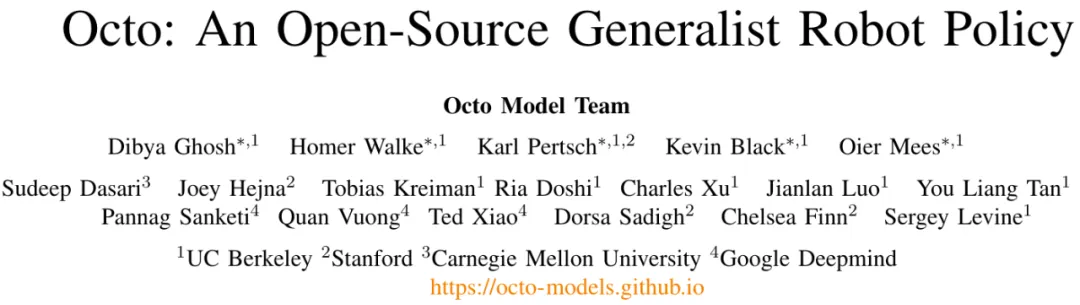

一位优秀的相声演员需要吹拉弹唱样样在行,类似地,一个优秀的机器人模型也应能适应多样化的机器人形态和不同的任务,但目前大多数机器人模型都只能控制一种形态的机器人执行一类任务。现在 Octo(八爪鱼)来了!这个基于 Transformer 的模型堪称当前最强大的开源机器人学习系统,无需额外训练就能完成多样化的机器人操控任务并能在一定程度适应新机器人形态和新任务,就像肢体灵活的八爪鱼。

iVideoGPT,满足世界模型高交互性需求。

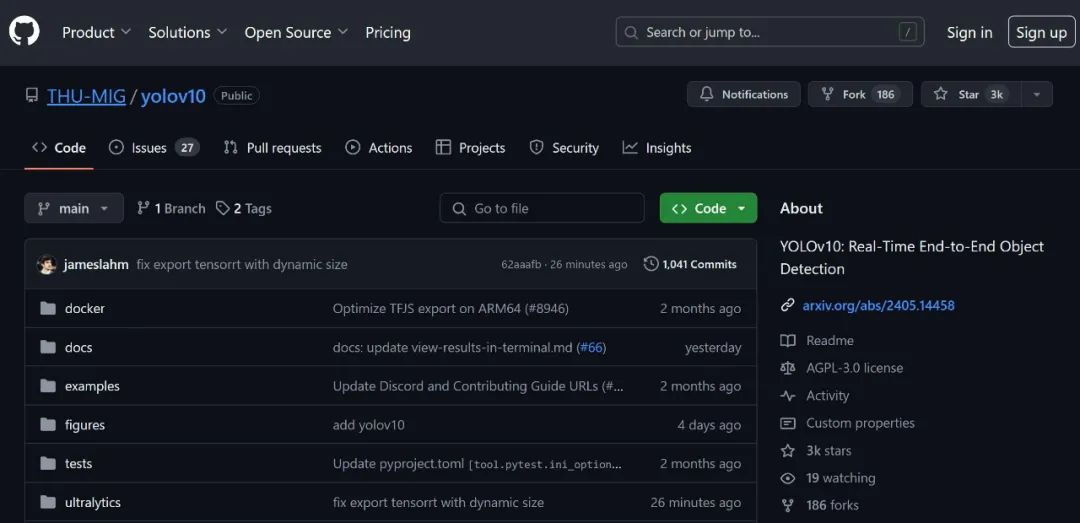

相同性能情况下,延迟减少 46%,参数减少 25%。

通过提示查询生成模块和任务感知适配器,大一统框架VimTS在不同任务间实现更好的协同作用,显著提升了模型的泛化能力。该方法在多个跨域基准测试中表现优异,尤其在视频级跨域自适应方面,仅使用图像数据就实现了比现有端到端视频识别方法更高的性能。

TinyLLaVA 项目由清华大学电子系多媒体信号与智能信息处理实验室 (MSIIP) 吴及教授团队和北京航空航天大学人工智能学院黄雷老师团队联袂打造。清华大学 MSIIP 实验室长期致力于智慧医疗、自然语言处理与知识发现、多模态等研究领域。北航团队长期致力于深度学习、多模态、计算机视觉等研究领域。

科学家们把Transformer模型应用到蛋白质序列数据中,试图在蛋白质组学领域复制LLM的成功。本篇文章能够带你了解蛋白质语言模型(pLM)的起源、发展,以及那些尚待解决的问题。

关于AI是否具有「心智理论」一直存在很多争议。Nature最新研究显示,GPT-4的行为可与人类媲美,甚至能够比人类更好地察觉出讽刺和暗示。虽然GPT-4在判断别人是否「失言」方面,未及人类水平,但这是因为它被不表达观点的护栏所限制,而并非因为其缺乏理解能力。

美国东北大学的计算机科学家 David Bau 非常熟悉这样一个想法:计算机系统变得如此复杂,以至于很难跟踪它们的运行方式。

本文介绍了香港科技大学(广州)的一篇关于大模型高效微调(LLM PEFT Fine-tuning)的文章「Parameter-Efficient Fine-Tuning with Discrete Fourier Transform」

为了将大型语言模型(LLM)与人类的价值和意图对齐,学习人类反馈至关重要,这能确保它们是有用的、诚实的和无害的。在对齐 LLM 方面,一种有效的方法是根据人类反馈的强化学习(RLHF)。尽管经典 RLHF 方法的结果很出色,但其多阶段的过程依然带来了一些优化难题,其中涉及到训练一个奖励模型,然后优化一个策略模型来最大化该奖励。

鹅厂搞了个150多人的“翻译公司”,从老板到员工都是AI智能体! 主营业务是翻译网络小说,质量极高,参与评价的读者认为比真人翻译得还要好。 而且相比于雇佣真人,用它来翻译文学作品,成本降低了近80倍。

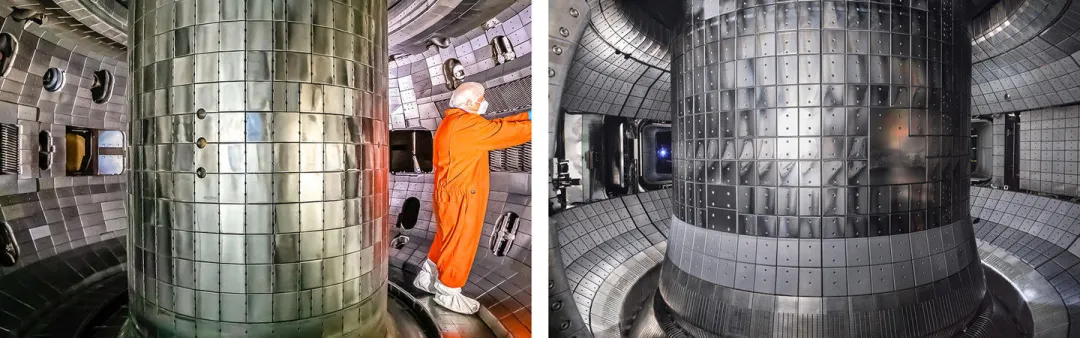

几十年来,核聚变释放能量的「精妙」过程一直吸引着科学家们的研究兴趣。 现在,在普林斯顿等离子体物理实验室(PPPL)中 ,科学家正借助人工智能,来解决人类面临的紧迫挑战:通过聚变等离子体产生清洁、可靠的能源。 与传统的计算机代码不同,机器学习不仅仅是指令列表,它可以分析数据、推断特征之间的关系、从新知识中学习并适应。

第一个以「泛化」能力为核心设计原则的可学习图像匹配器来了!

本文由GreenBit.AI团队撰写,团队的核心成员来自德国哈索·普拉特纳计算机系统工程院开源技术小组。我们致力于推动开源社区的发展,倡导可持续的机器学习理念。我们的目标是通过提供更具成本效益的解决方案,使人工智能技术在环境和社会层面产生积极影响。

既能像 Transformer 一样并行训练,推理时内存需求又不随 token 数线性递增,长上下文又有新思路了?

一直以来 AI 都是一个黑盒子(black box),其内部运作机制是不可见的。人们输入数据并得到结果,但无法检查输出结果的逻辑或者系统的代码。 而就在刚刚,Anthropic 宣布在理解人工智能模型内部运作机制方面取得重大进展。

在人工智能的辉煌历史中,Geoffrey Hinton教授不仅是深度学习的奠基人之一,更是推动了整个领域从理论到实践的转变。在这次深入的访谈中,Geoffrey Hinton分享了自己在人工智能研究中的个人经历、对深度学习未来发展的深刻见解,以及对当前技术可能带来的社会影响的深思熟虑。

关节置换手术被称为骨科的“世纪手术”。

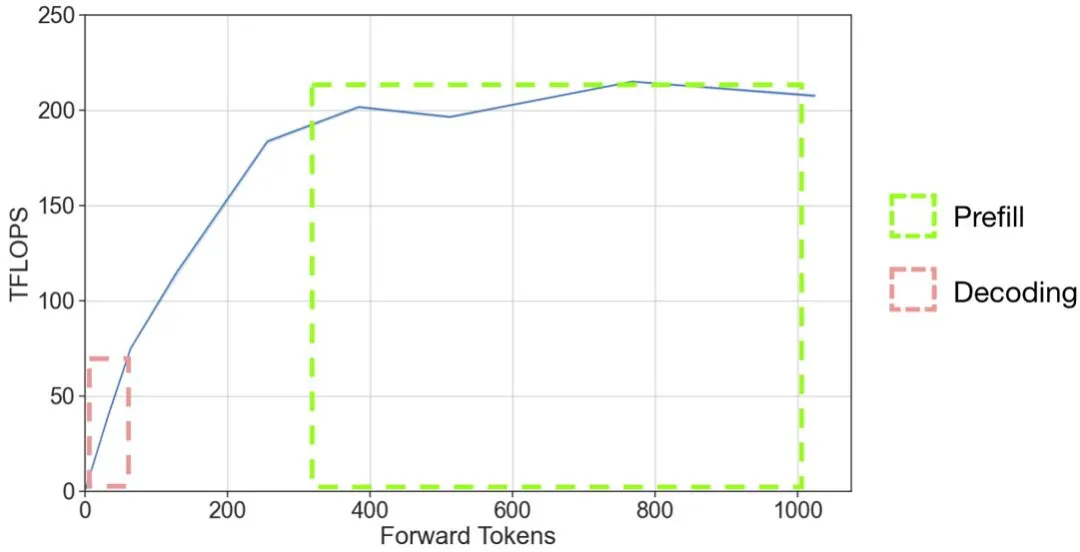

以 OpenAI 的 GPT 系列模型为代表的大语言模型(LLM)掀起了新一轮 AI 应用浪潮,但是 LLM 推理的高昂成本一直困扰着业务团队。

在 AI 领域,扩展定律(Scaling laws)是理解 LM 扩展趋势的强大工具,其为广大研究者提供了一个准则,该定律在理解语言模型的性能如何随规模变化提供了一个重要指导。

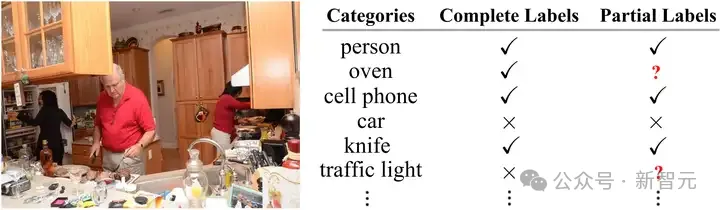

在多标签图像识别领域中,由于图像本身和潜在标签类别的复杂性,收集满足现有模型训练的多标签标注信息往往成本高昂且难以拓展。中山大学联合广东工业大学联手探索标注受限情况下的多标签图像识别任务,通过对多标签图像中的强语义相关性的探索研究,提出了一种异构语义转移(Heterogeneous Semantic Transfer, HST) 框架,实现了有效的未知标签生成。

5月22日,全球资本市场的“大网红”英伟达发布了2025财年第一财季(截至2024年4月28日)的报告。

在图像生成领域占据主导地位的扩散模型,开始挑战强化学习智能体。

本文讨论了大模型厂商的降价现象,并分析了其背后的技术和商业动机。

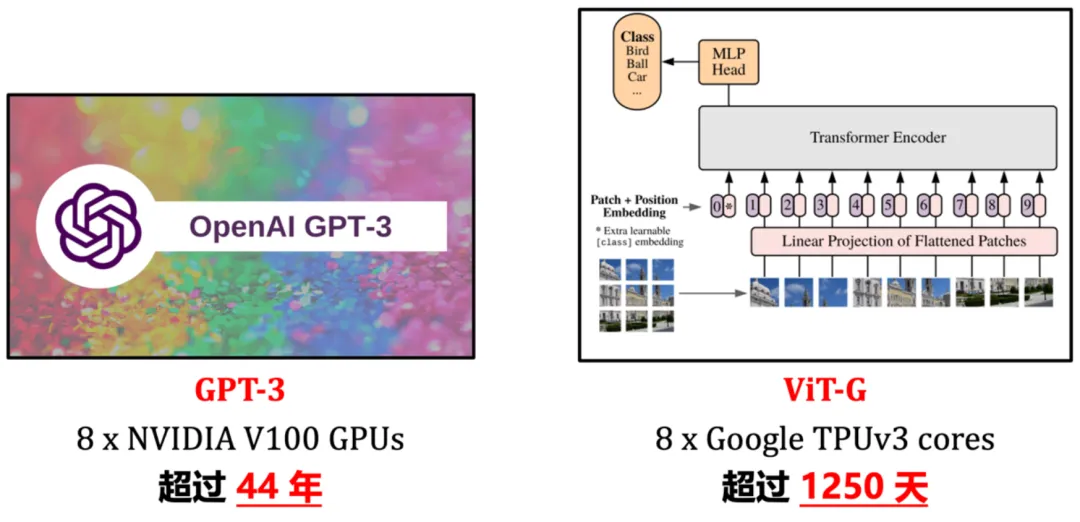

近年来,「scaling」是计算机视觉研究的主角之一。随着模型尺寸和训练数据规模的增大、学习算法的进步以及正则化和数据增强等技术的广泛应用,通过大规模训练得到的视觉基础网络(如 ImageNet1K/22K 上训得的 Vision Transformer、MAE、DINOv2 等)已在视觉识别、目标检测、语义分割等诸多重要视觉任务上取得了令人惊艳的性能。