AI创业一年,连电费都没赚回来

AI创业一年,连电费都没赚回来“逐梦AI圈”的中小创业者,何时圆梦?

“逐梦AI圈”的中小创业者,何时圆梦?

“用智能,开启无限可能” 2024惠普商用AI战略暨AI PC新品发布会在北京盛大举行。

Sora 的第一批使用者,详细讲述了自己使用其生成完整视频的制作过程。

OpenAI挖角谷歌、加班加点研发的AI搜索产品,马上就要上线了。

Gartner估计,到2028年,75%的程序员将使用AI编程工具。

因AI概念去年股价一飞冲天的“彩票大王”鸿博股份(002229.SZ),交出了一份令人失望的成绩单。

TOP FAVOR已经在服装创造上实现了AI的深度参与,涵盖设计、营销、供应链以及柔性智造等各个环节。

智东西5月8日报道,近日,微软发布了首个年度《负责任的人工智能透明度报告》。报告概述了微软2023年制定并部署的各种措施,以及其在安全部署AI产品方面取得的成就,如创建了30个负责任的人工智能(RAI)工具,扩大了RAI团队等。

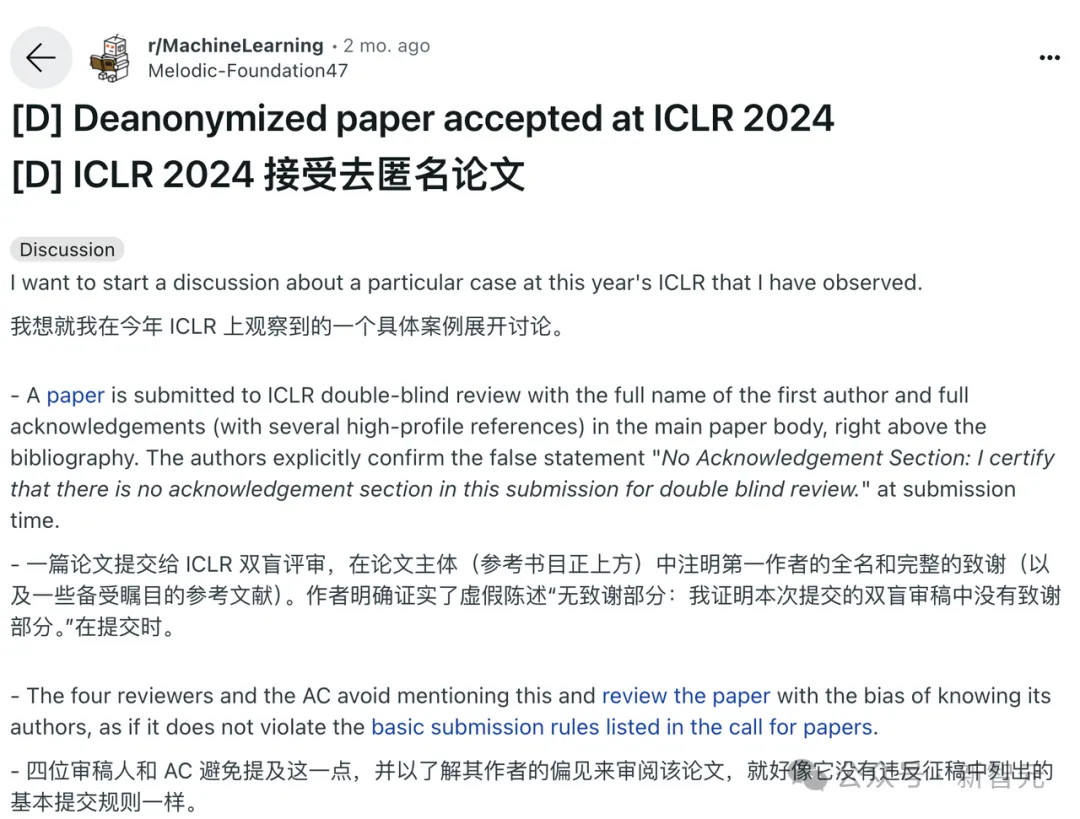

由于规格高、论文多,顶会论文审稿过程的公平性和透明度,向来是业界关注和争议的焦点。

推荐系统对于应对信息过载挑战至关重要,它们根据用户的个人偏好提供定制化推荐。近年来深度学习技术极大地推动了推荐系统的发展,提升了对用户行为和偏好的洞察力。

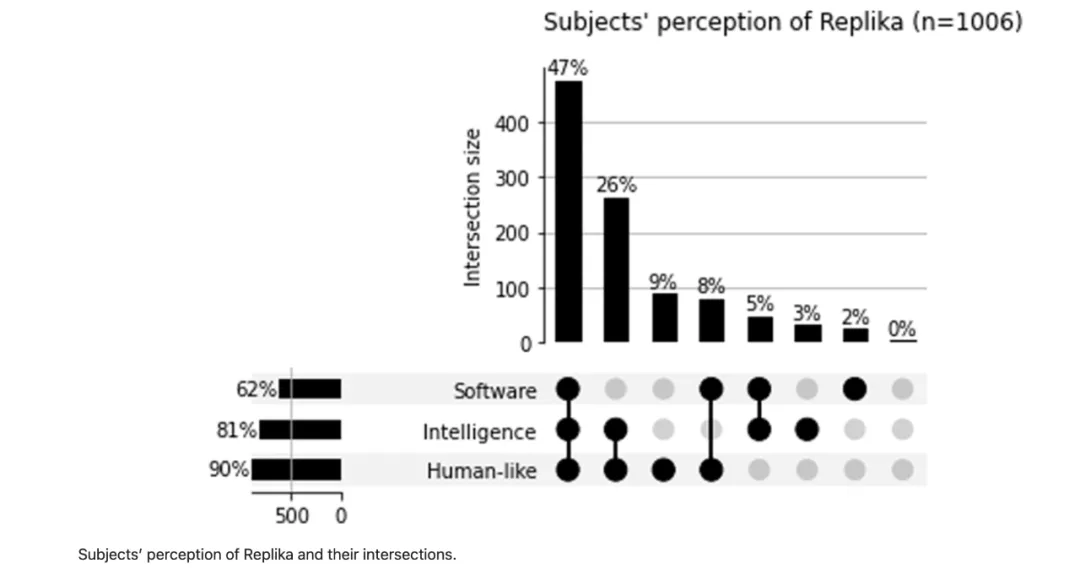

Character.AI 在效率工具的维度外,开辟了情感娱乐的赛道,甚至引发了 AI 聊天陪伴产品的热潮。在国内,类似的 AI 聊天陪伴类产品也越来越多。得益于新的技术变量,这类产品以一种新的方式,满足用户已被发掘过的需求。

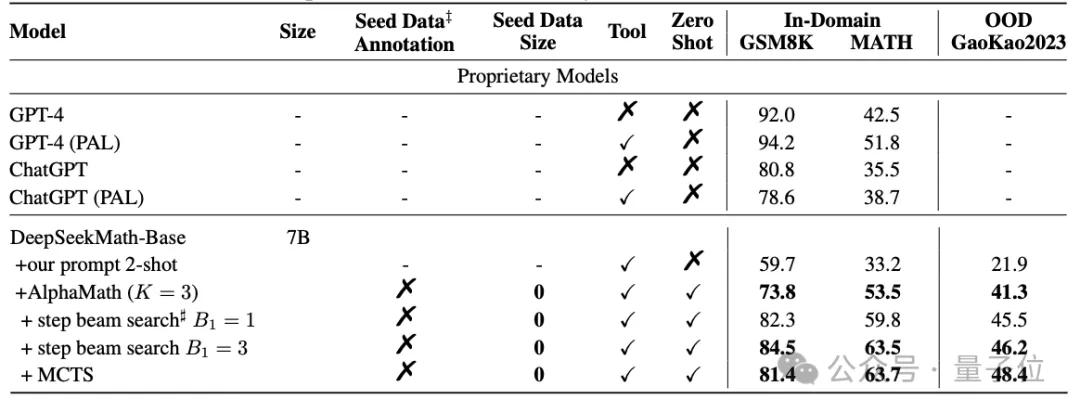

把AlphaGo的核心算法用在大模型上,“高考”成绩直接提升了20多分。

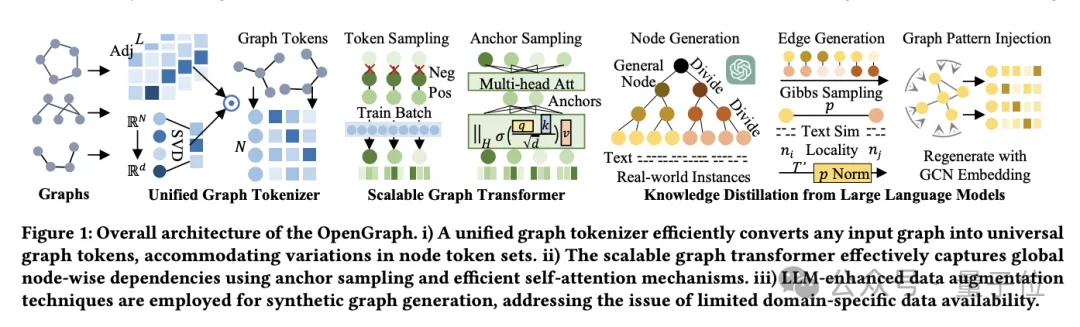

图学习领域的数据饥荒问题,又有能缓解的新花活了!

AlphaFold 3再登Nature!

首届ICLR时间检验奖,颁向变分自编码器VAE

OpenAI正在秘密A/B测试下一代模型,实力超强被怀疑是GPT-4.5或GPT-5。

据外媒The Verge 5月4日报道,自去年年初起,青少年开始流行与AI聊天机器人交朋友。The Verge记者杰西卡·卢卡斯(Jessica Lucas)近日采访了来自北美洲的4名未成年人,他们均沉迷于Character AI的聊天服务。

最近,网上出现大量“黏土”风格的人物照片。尤其是在小红书、微信朋友圈等社交平台,这类型的分享数量急剧上升,一股浓浓的《小羊肖恩》风。

据《华尔街日报》7日报道,苹果公司正在为数据中心服务器研发设计运行人工智能(AI)软件的芯片,这一举措或将使苹果在日益激烈的AI领域军备竞赛中占据优势。

Stack Overflow,一个类似知乎、Reddit的老牌网站,因专注于技术问答和社区运营,因此在全球程序员圈内备受欢迎。

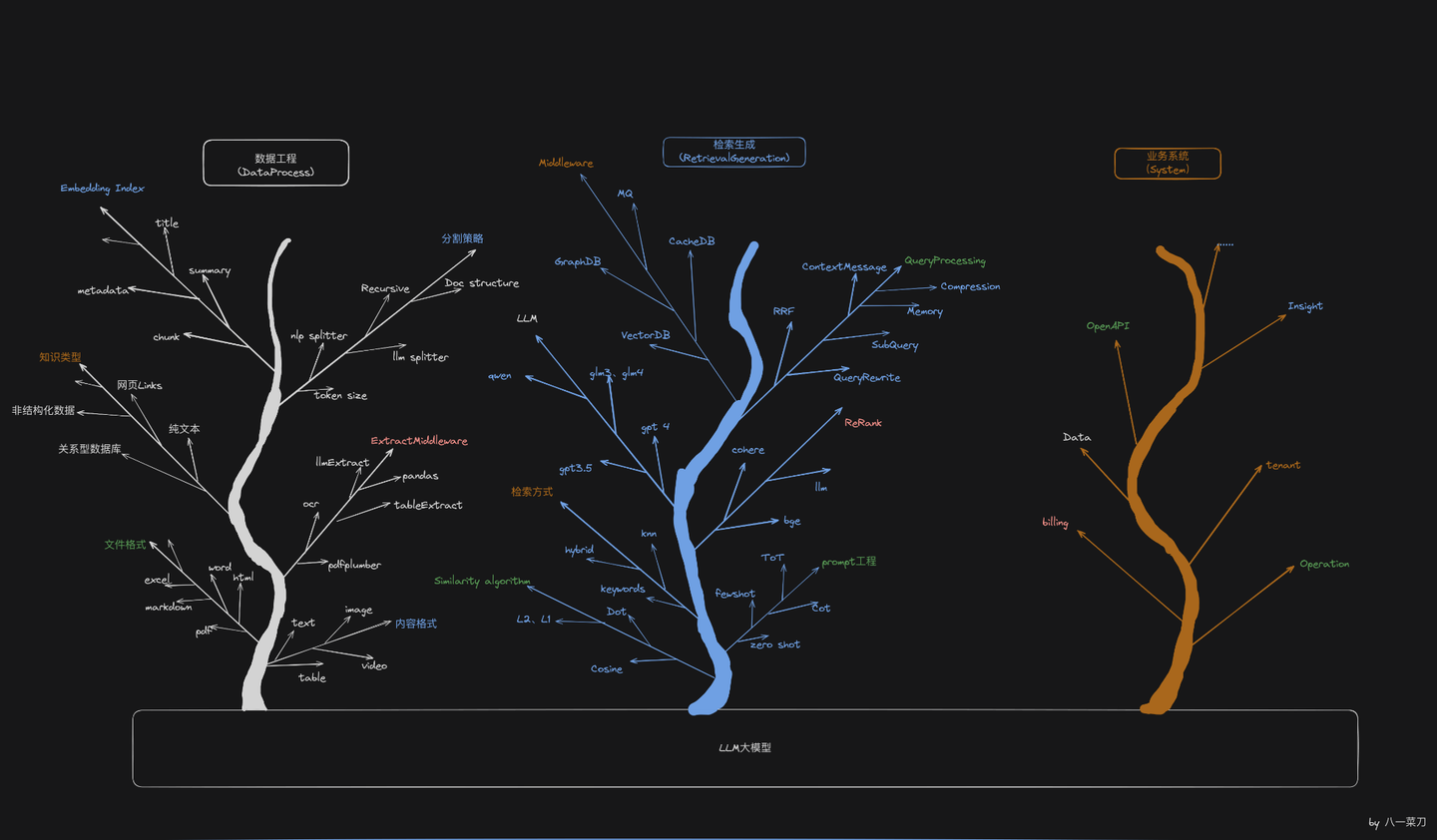

自从和员外上家公司离职后,我们就自己搞公司投入到了RAG大模型的AI产品应用的开发中,这中间有一个春节,前后的总时间大概是三个月左右,在这三个月期间,基本是昼夜兼程啊,到今天3月底结束,产品目前看是有了一个基础的雏形。

在上一篇文章「Unsloth微调Llama3-8B,提速44.35%,节省42.58%显存,最少仅需7.75GB显存」中,我们介绍了Unsloth,这是一个大模型训练加速和显存高效的训练框架,我们已将其整合到Firefly训练框架中,并且对Llama3-8B的训练进行了测试,Unsloth可大幅提升训练速度和减少显存占用。

多模态融合是多模态智能中的基础任务之一。

今年 3 月,以构建大型开源社区而闻名的 AI 初创公司 Hugging Face,挖角前特斯拉科学家 Remi Cadene 来领导一个新的开源机器人项目 ——LeRobot,引起了轰动。

ICLR 全称为国际学习表征会议(International Conference on Learning Representations),今年举办的是第十二届,于 5 月 7 日至 11 日在奥地利维也纳展览会议中心举办。

AI的发展将终结人类学习外语的需求?

如今,AI进步的速度,已经超出了我们对它用途的理解。

「Siri太笨,根本无法与ChatGPT竞争」,前苹果工程师John Burkey曾对Siri的评价如此不堪。

两周前,OpenBMB开源社区联合面壁智能发布领先的开源大模型「Eurux-8x22B 」。相比口碑之作 Llama3-70B,Eurux-8x22B 发布时间更早,综合性能相当,尤其是拥有更强的推理性能——刷新开源大模型推理性能 SOTA,堪称开源大模型中「理科状元」。

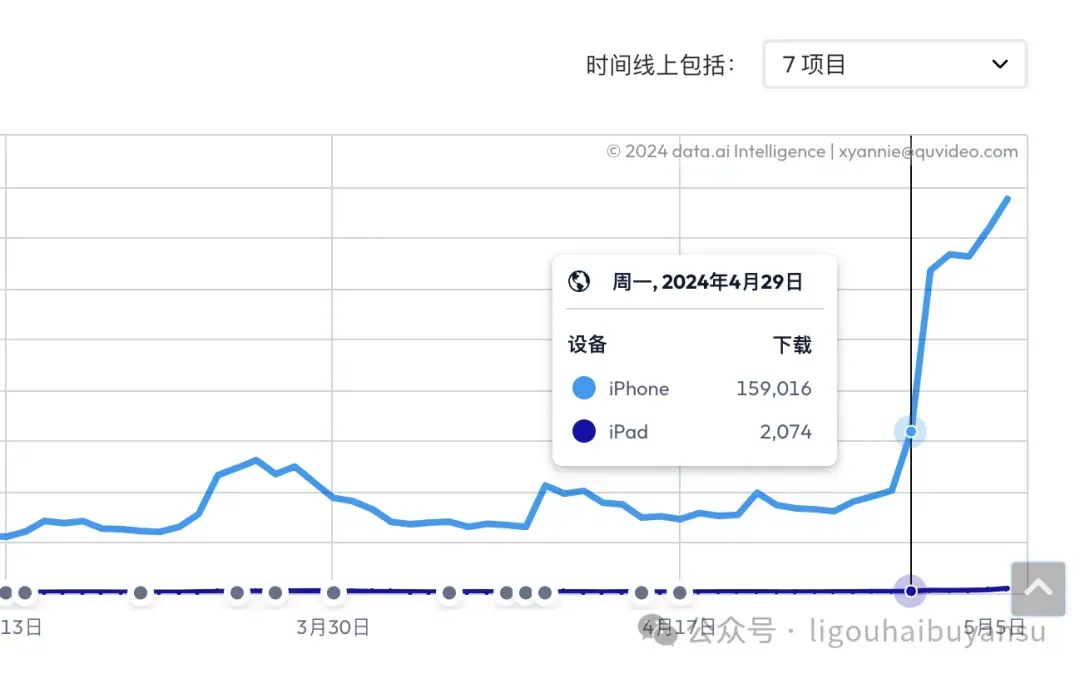

凭借黏土风格的照片生成,Remini 成为五一期间爆火的出圈 AI 应用,日下载量飙升到接近40万次。