Meta探索大模型记忆层,扩展至1280亿个参数,优于MoE

Meta探索大模型记忆层,扩展至1280亿个参数,优于MoE预训练语言模型通常在其参数中编码大量信息,并且随着规模的增加,它们可以更准确地回忆和使用这些信息。

预训练语言模型通常在其参数中编码大量信息,并且随着规模的增加,它们可以更准确地回忆和使用这些信息。

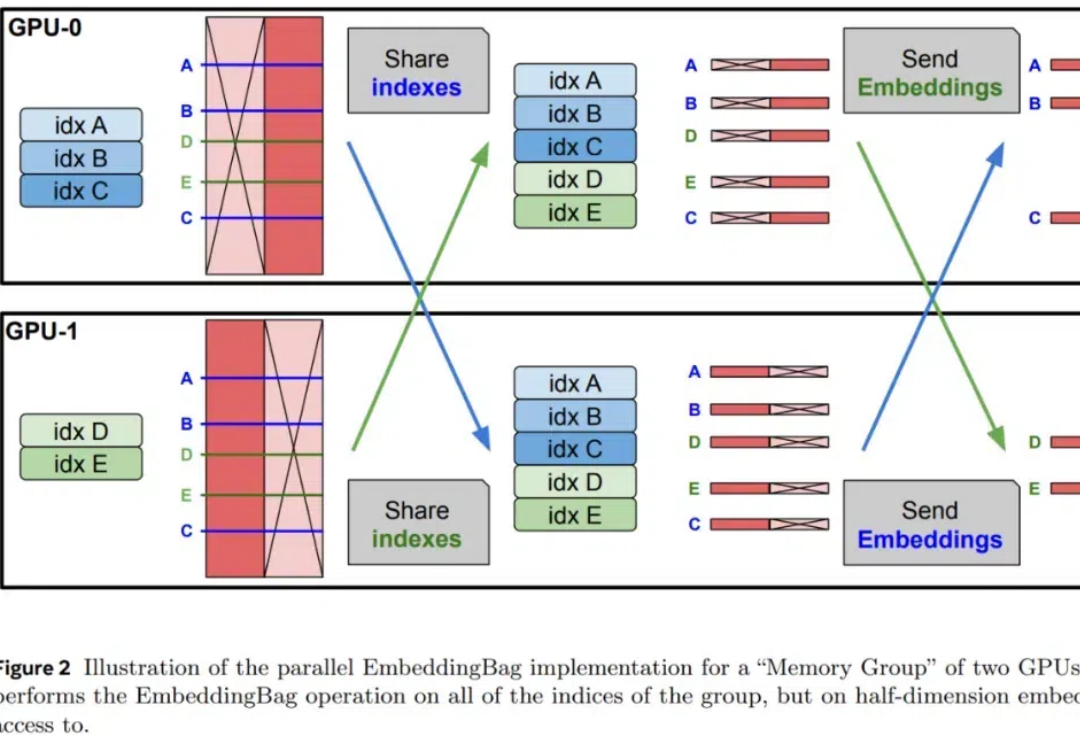

此项研究成果已被 AAAI 2025 录用。该论文的第一作者是南洋理工大学计算与数据科学学院 (CCDS) 的硕士生杨潇,师从苗春燕教授,主要研究方向是图神经网络。

2025年,一场前所未有的智能海啸即将席卷全球。这不是危言耸听,而是基于大量研究得出的预判。这篇万字长文从生态、业态、技术、产品、企业五大维度,系统预测了2025年可能发生的50个重要变革。

电影《钢铁侠》中,托尼·斯塔克的助手贾维斯(J.A.R.V.I.S.)能帮他控制各种系统并自动完成任务,曾让无数观众羡慕不已。

马斯克被啪啪“打脸”,自家大模型Grok的draw me新生图功能抽疯,画人总是画不对。

自回归文生图,迎来新王者——

2025年,AI应用将继续爆发。 刚刚过去的2024年,海外创投市场对AI公司的投资仍然活跃。根据Crunchbase的数据,AI公司的投资交易在2024年第三季度继续主导风险投资市场,它们在第三季度融资总额达190亿美元,占总风险投资的28%。

万字长文盘点 2024,展望 2025 2024 年,大语言模型(LLM)迎来了翻天覆地的变化。让我们一起回顾过去一年中这个领域的重大发现,梳理其中的关键主题和标志性时刻。

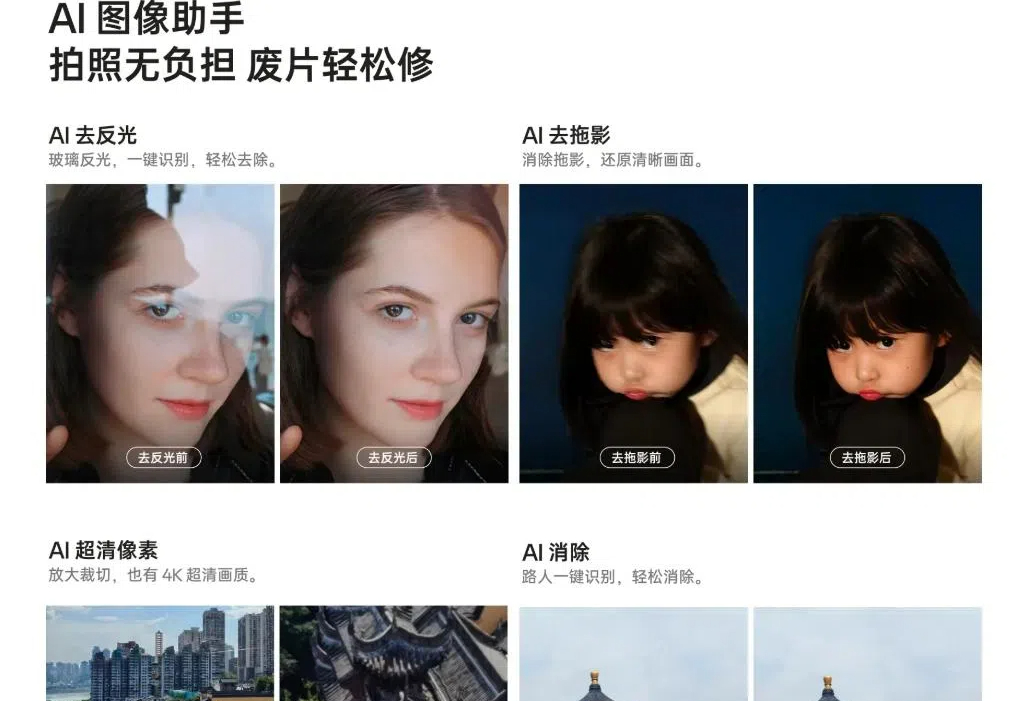

24年,计算摄影概念风靡,影像成了AI应用的主战场,不论是原生相机上应用AI技术去做调教,抑或颇受用户欢迎的AI消除等AI影像应用,都表明,AI给影像打开了全新的一扇窗。然而,对于摄影师来说,AI影像的出现真的是一件好事吗?

AI是工具,也是我们穿越生命洪流的舟楫 “刘春和只是脑瘫,不是个傻子。”