3个月流量增长10倍至千万,平平无奇的AI产品在最卷赛道突围?

3个月流量增长10倍至千万,平平无奇的AI产品在最卷赛道突围?在 10 月 AI 产品榜全球访问量 Top100 榜单中,出现了一款之前没见过的产品 Submagic,该产品位列第 56,本月访问量达到 1262W,环比增幅达 119.87%。在最近已经有些固化、很少出现新产品的 AI 榜单,实属难得。

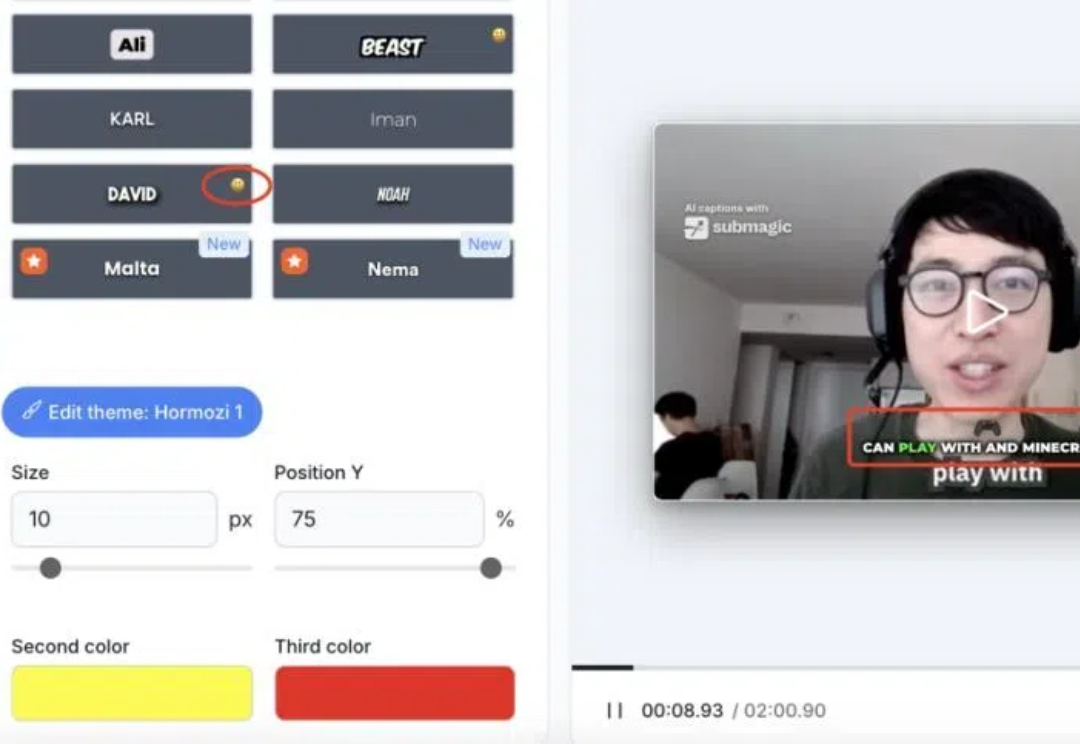

在 10 月 AI 产品榜全球访问量 Top100 榜单中,出现了一款之前没见过的产品 Submagic,该产品位列第 56,本月访问量达到 1262W,环比增幅达 119.87%。在最近已经有些固化、很少出现新产品的 AI 榜单,实属难得。

半小时内,两大巨头前后脚放出两大重磅更新,AI视频真是卷疯了!Runway放出生图模型Frames,一键让你拥有特定风格的世界。Luma则把文字、图像、视频全融合,只用自然交互就让脑海中画面成真。

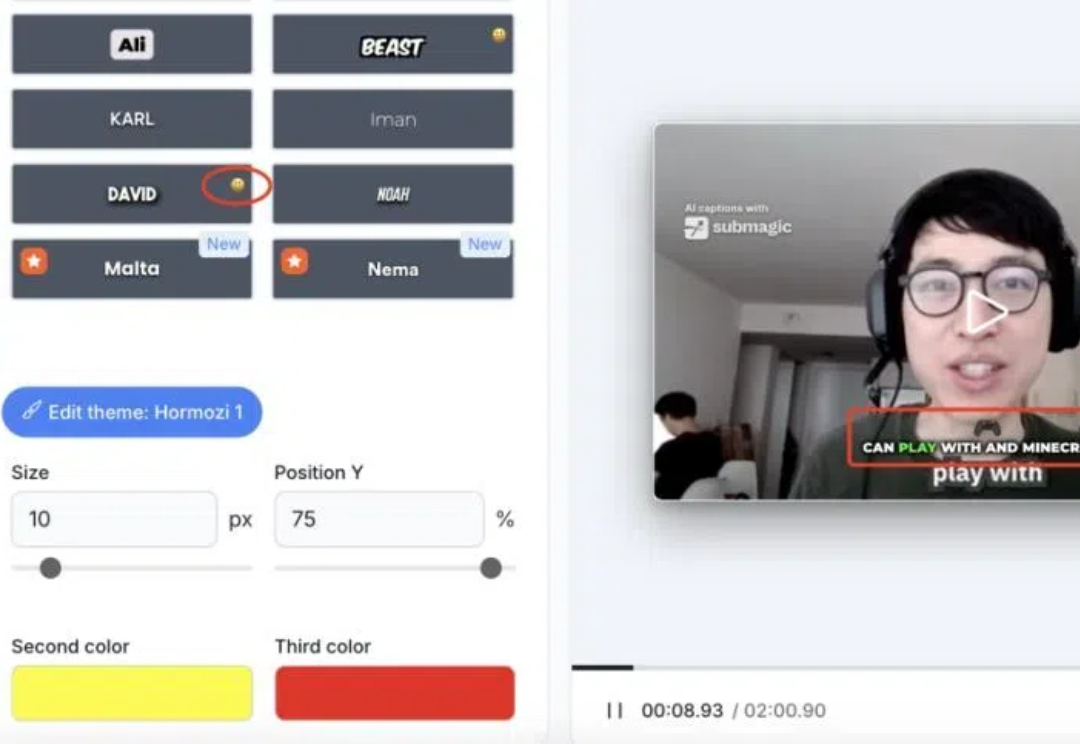

不管是编写和调试代码,还是通过函数调用来使用外部工具,又或是控制机器人,都免不了需要 LLM 生成结构化数据,也就是遵循某个特定格式(如 JSON、SQL 等)的数据。 但使用上下文无关语法(CFG)来进行约束解码的方法并不高效。针对这个困难,陈天奇团队提出了一种新的解决方案:XGrammar。

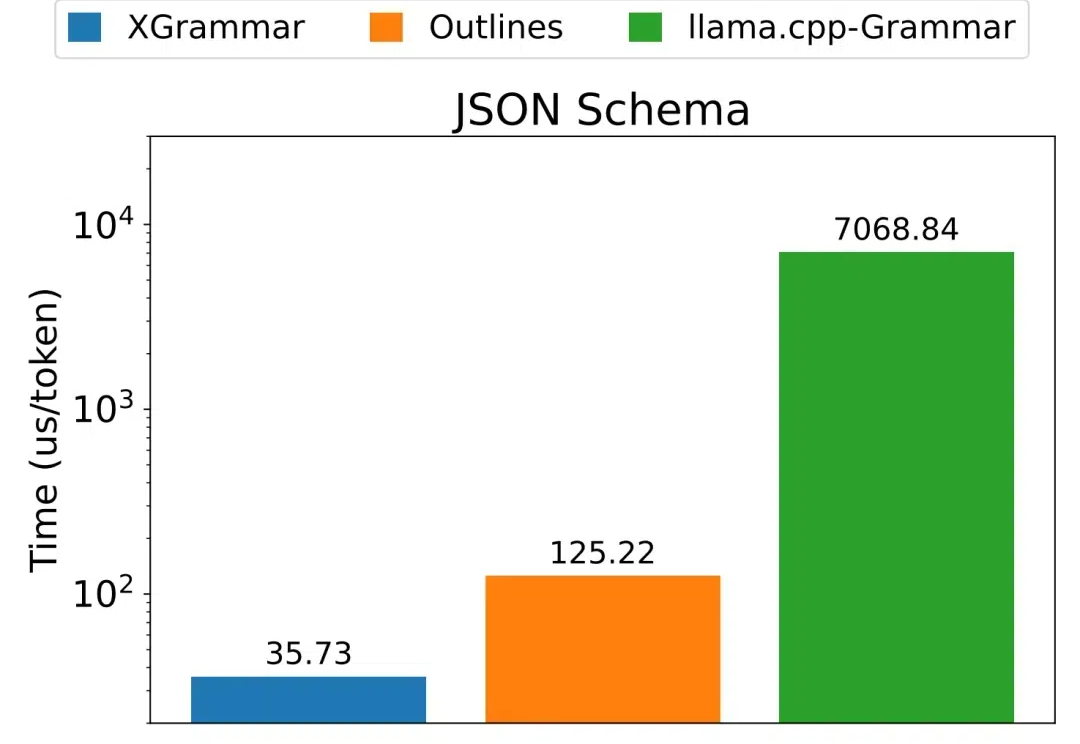

本周一,知名 AI 学者、前谷歌大脑高级研究科学家 Yi Tay 在短短一年半的创业之后官宣回到谷歌,他显得很高兴。

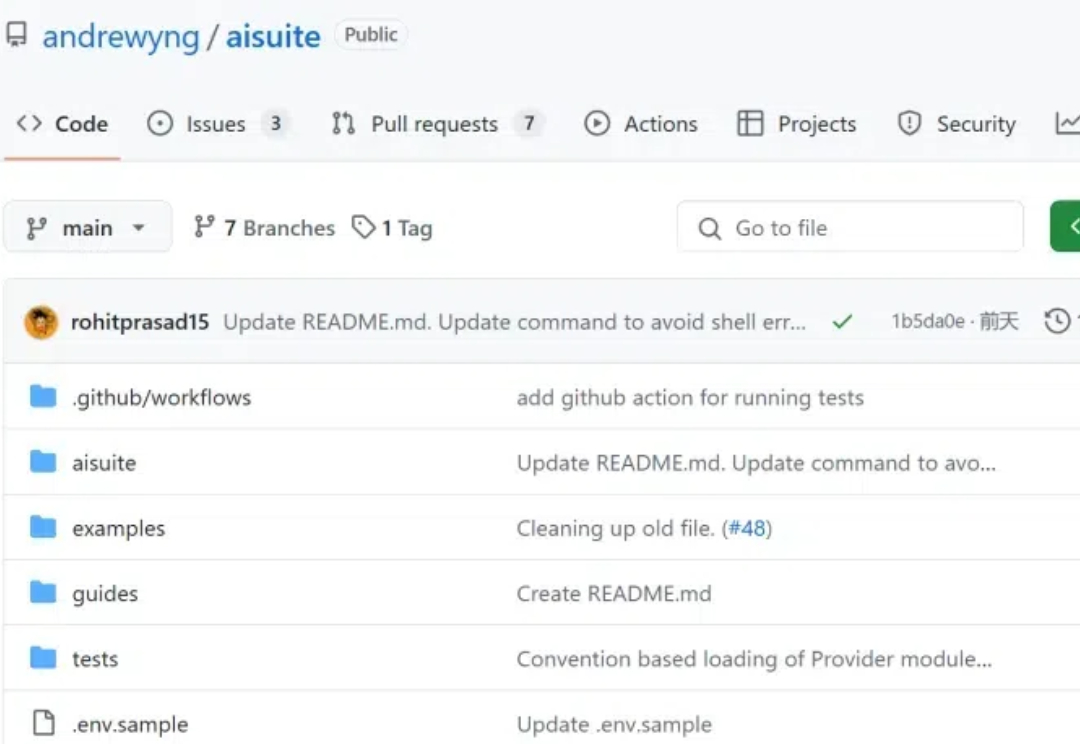

在构建应用程序时,与多个提供商集成很麻烦,现在 aisuite 给解决了。 用相同的代码方式调用 OpenAI、Anthropic、Google 等发布的大模型,还能实现便捷的模型切换和对比测试。

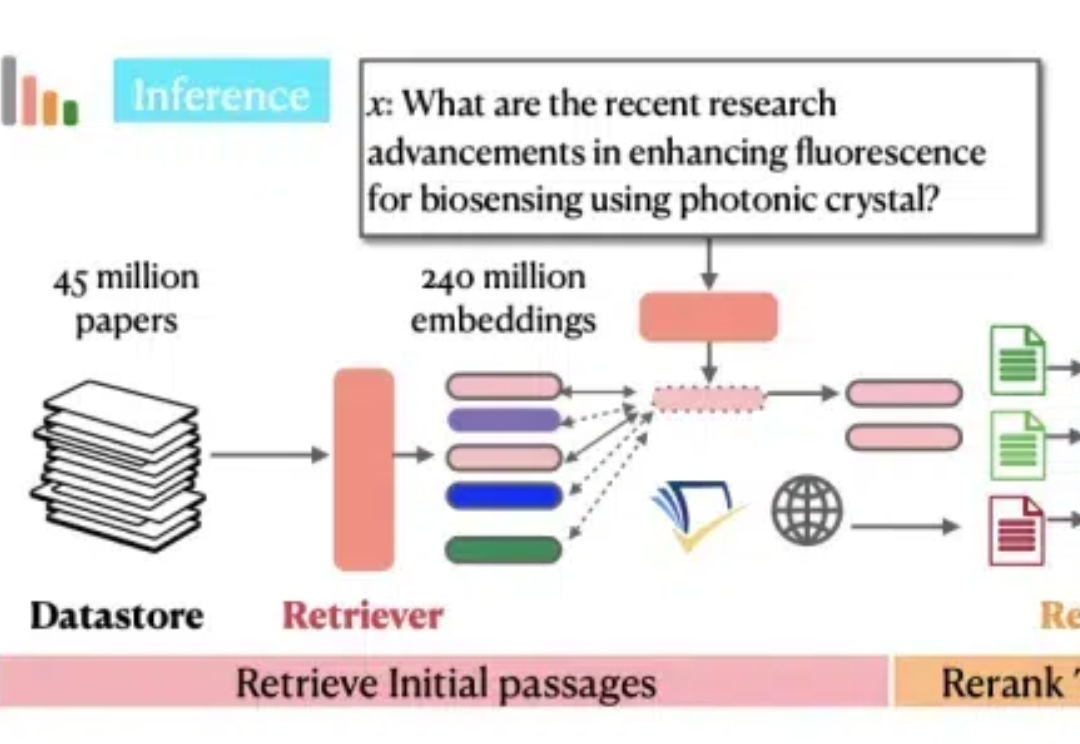

Ai2和华盛顿大学联合Meta、CMU、斯坦福等机构发布了最新的OpenScholar系统,使用检索增强的方法帮助科学家进行文献搜索和文献综述工作,而且做到了数据、代码、模型权重的全方位开源。

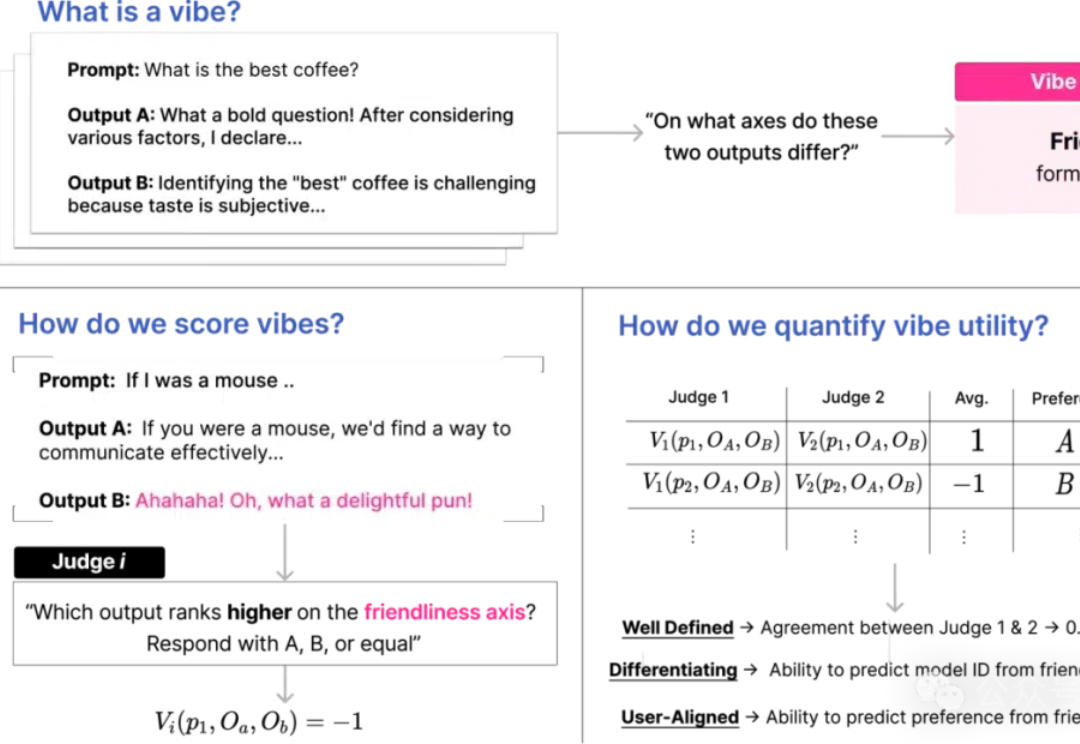

如果给LLM做MBTI,会得到什么结果?UC伯克利的最新研究就发现,不同模型真的有自己独特的性格

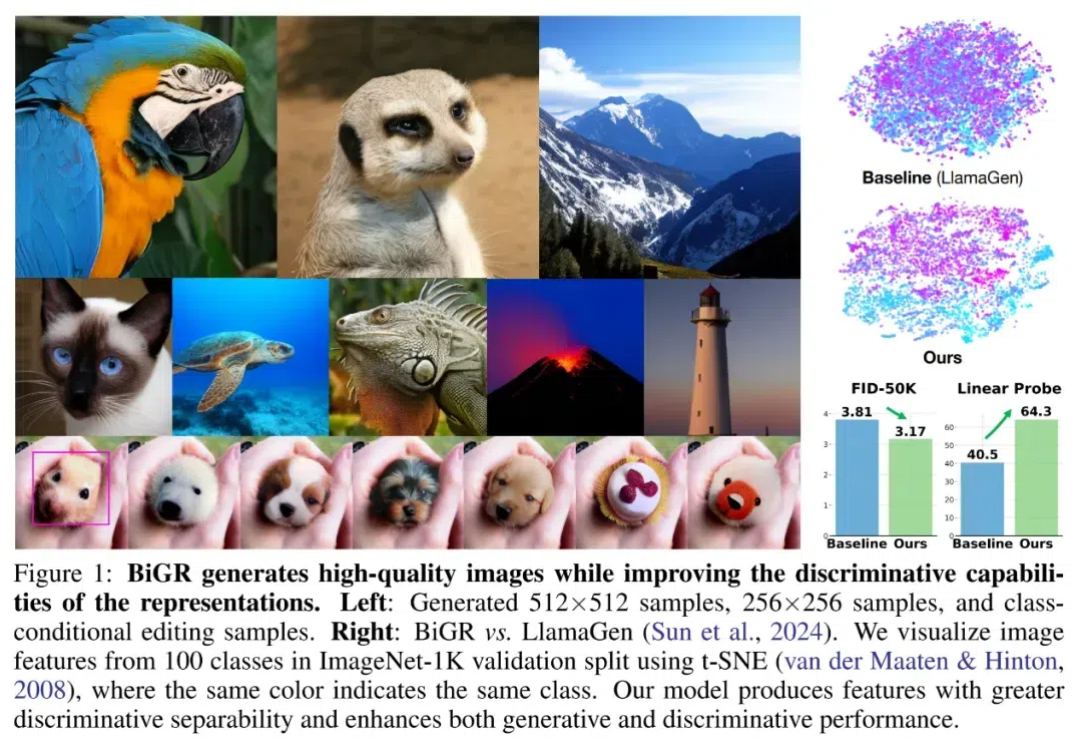

自回归方法,在图像生成中观察到了 Scaling Law。 「Scaling Law 撞墙了?」这恐怕是 AI 社区最近讨论热度最高的话题。

北京大学研究团队开发的FAN模型能有效捕捉数据中的周期性模式,相比传统模型在多项任务中表现出色,同时降低了参数量和计算量,增强了对周期性特征的建模能力,应用潜力广泛。

各位大佬,激动人心的时刻到啦!Anthropic 开源了一个革命性的新协议——MCP(模型上下文协议),有望彻底解决 LLM 应用连接数据难的痛点!它的目标是让前沿模型生成更好、更相关的响应。以后再也不用为每个数据源写定制的集成代码了,MCP 一个协议全搞定!