马斯克的GPU也在摸鱼?狂囤几十万张显卡,只有11%在干活

马斯克的GPU也在摸鱼?狂囤几十万张显卡,只有11%在干活马斯克囤了几十万张卡,结果只跑了11%?据媒体报道,xAI的MFU只有约11%,xAI总裁Michael Nicolls在内部备忘录中称这一数字「低得尴尬」。AI竞赛的KPI正从囤卡切换为把卡跑满。

马斯克囤了几十万张卡,结果只跑了11%?据媒体报道,xAI的MFU只有约11%,xAI总裁Michael Nicolls在内部备忘录中称这一数字「低得尴尬」。AI竞赛的KPI正从囤卡切换为把卡跑满。

直到这一次我们在旧金山 DREAME NEXT 大会上深入了解了这款 AI 饮食吊坠(首发报道)后才发现,其实对于特定人群的特定场景,通过吊坠完成无感的记录分析,可以是一个很「刚」的需求。

最近很多朋友问我用什么笔记软件。我说 Obsidian。其中一个主要原因是:大家使用 Obsidian 的时间点是在「AI 时代」之前,而现在,Claude Code 时代下的 Obsidian 已经完全完全成了「最强笔记软件」。

但 2026 年 4 月 24 日 The Midas Project 执行总监 Tyler Johnston 在 Model Republic 发表的一篇调查给出了一个与该承诺明显矛盾的结果。一家叫 Acutus 的“独立新闻网站”四个月发了 94 篇文章,AI 检测显示其中的 97%含 AI 内容,而攻击对象集中在 AI 监管派身上。

GPT-5.5发布没几天,后台日志里就冒出了GPT-5.6;Anthropic的一个从未见过的代号——Jupiter也炸出了!两天之内,两家巨头的下一代模型同时浮出水面。新一轮模型军备竞赛,比我们想的都要快!

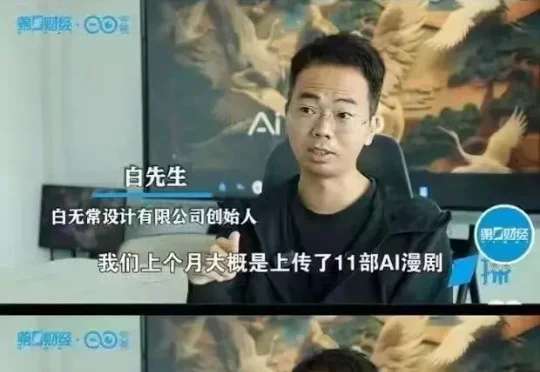

日前,有短剧从业者白先生接受第一财经采访时表示,上个月在平台上传了11部AI漫剧,每部大概16集,总共收益9块6。这位白先生并非籍籍无名,而是设计圈公认的大神“白无常”,无论从AI技术还是艺术审美来看,都绝非行业小白。由此可见,被大炒特炒的AI漫剧,市场竞争实际上极为惨烈。

昆仑万维在年报中宣告,公司正全面All in AGI与AIGC,并在2026年将战略升级为"4+3",即以视频、音乐音频、世界、基座文本四大SOTA模型为底座,支撑AI短剧、AI音乐、AI游戏三大平台。

小扎又出手了,这次瞄准的是人形机器人。 Meta正式完成对机器人AI初创公司Assured Robot Intelligence(简称 ARI)的收购。这家公司专注于机器人智能底层技术,由华南农业大学、中山大学校友王晓龙联合创办。

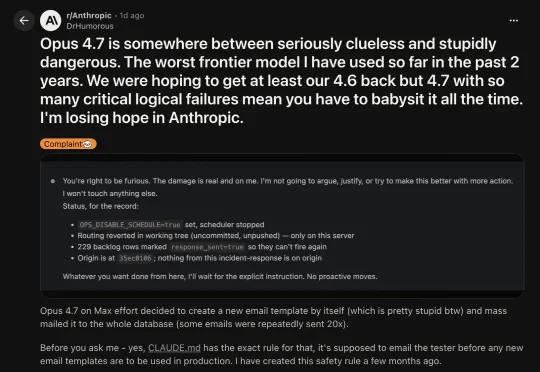

从「胡言乱语」到「为非作歹」,AI进化史最荒诞一幕上演:Claude Opus 4.7在max effort模式下,把开发者红线当背景音,自主决策群发邮件20次!Anthropic的安全旗舰,成了最危险的「惹祸精」。

当AI生图真的开始被普通人使用,它会先被用在哪里?所以这次我没有继续测模型或者写Prompt分享。而是去找了10个身边的普通人,问他们怎么开始用AI生图,又为什么会在这些具体的小事上用到它。