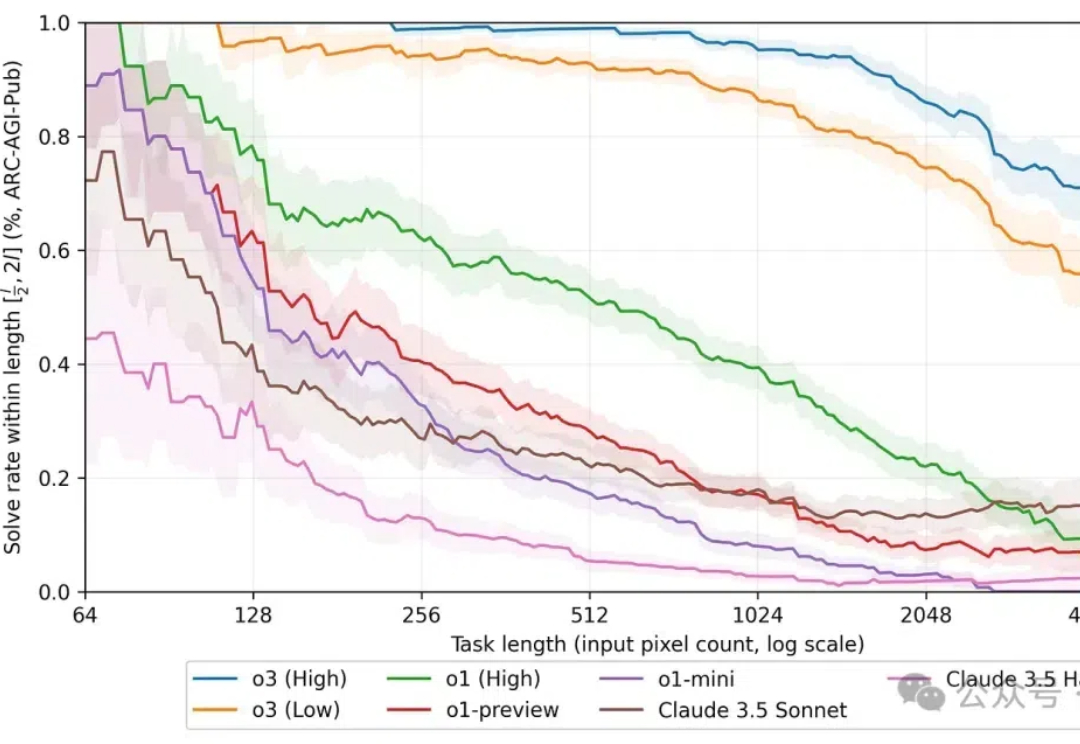

o3挑战ARC-AGI,遇见大网格就懵圈?英国工程师:ARC-AGI不适合大模型

o3挑战ARC-AGI,遇见大网格就懵圈?英国工程师:ARC-AGI不适合大模型o3在超难推理任务ARC-AGI上的成绩,属实给人类带来了不少震撼。 但有人专门研究了它不会做的题之后,有了更有趣的发现—— o3之所以不会做这些题,原因可能不是因为太难,而是题目的规模太大了。

o3在超难推理任务ARC-AGI上的成绩,属实给人类带来了不少震撼。 但有人专门研究了它不会做的题之后,有了更有趣的发现—— o3之所以不会做这些题,原因可能不是因为太难,而是题目的规模太大了。

2024 年,理想汽车以突破 100 万辆的累计交付量成为中国智能电动车市场的一大亮点。然而,在这一辉煌背后,理想汽车正迎来一场前所未有的转型。

前脚大模型六小虎之一的智谱刚完成新一轮30亿的融资;后脚字节跳动发布豆包视觉理解模型、快手可灵1.6正式上线。

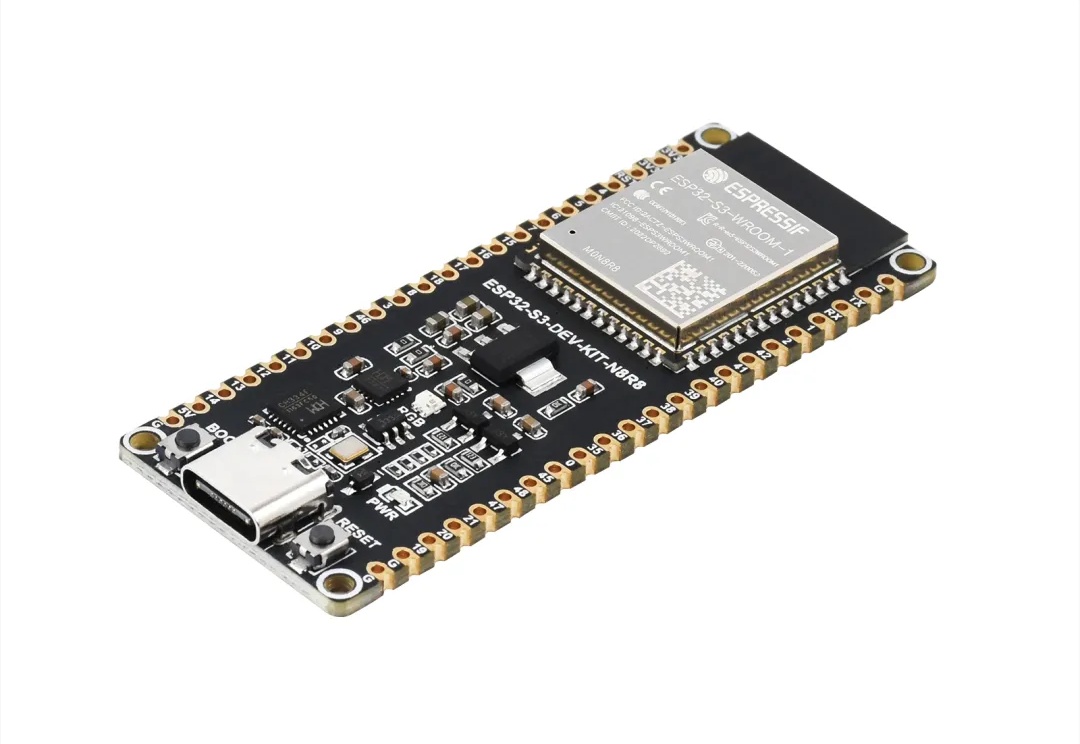

OpenAI给32位MCU做了个SDK

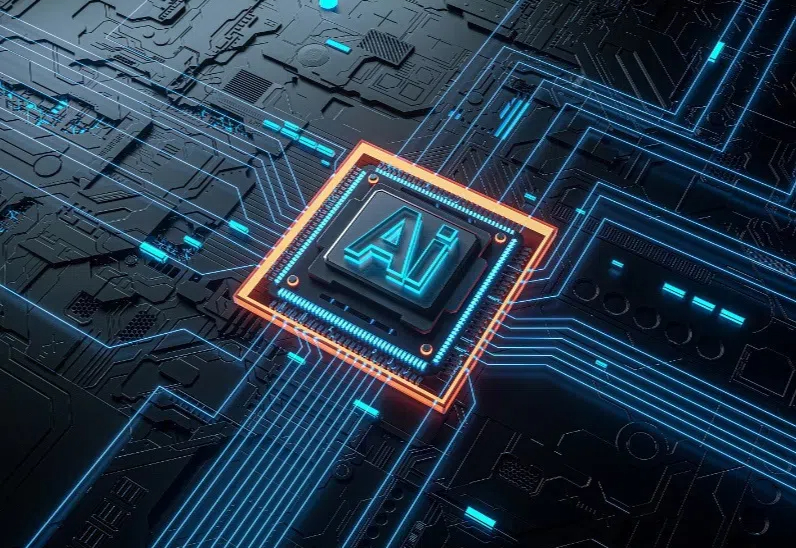

Freed AI 是一款创新的医疗文档智能工具,通过 AI 转录系统记录患者就诊讨论内容,识别关键术语并创建结构化的病历记录,帮助医生将文档工作时间减少 73%。

家人们!OpenAI 这 12 天的连续剧大家都追完了吗?别急着下线!

o3之后,OpenAI下一个项目曝光了: 人形机器人

IBM 正式发布了其新一代开源大语言模型 Granite 3.1,这是一组轻量级、先进的开源基础模型,支持多语言、代码生成、推理和工具使用,能够在有限的计算资源上运行。这一系列模型具备 128K 的扩展上下文长度、嵌入模型、内置的幻觉检测功能以及性能的显著提升。

最近,上海跑出一个超级隐形冠军:进馨科技,在美国纳斯达克成功上市。

2024 上半年,影石 Insta360 超越了老牌厂商 GoPro,成为了运动相机品类的全球第一。