一句话爆改三维场景!斯坦福吴佳俊团队新作:场景语言,智能补全文本到3D的场景理解

一句话爆改三维场景!斯坦福吴佳俊团队新作:场景语言,智能补全文本到3D的场景理解从文字生成三维世界的场景有多难?

从文字生成三维世界的场景有多难?

Claude团队三巨头同时接受采访,回应一切。 整整5个小时,创始人Dario Amodei、Claude性格设计师Amanda Askell、机制可解释性先驱Chris Olah无所不谈,透露了关于模型、公司和行业的很多内幕和细节。

研究人员通过案例研究,利用大型语言模型(LLMs)如GPT-4、Claude 3和Llama 3.1,探索了思维链(CoT)提示在解码移位密码任务中的表现;CoT提示虽然提升了模型的推理能力,但这种能力并非纯粹的符号推理,而是结合了记忆和概率推理的复杂过程。

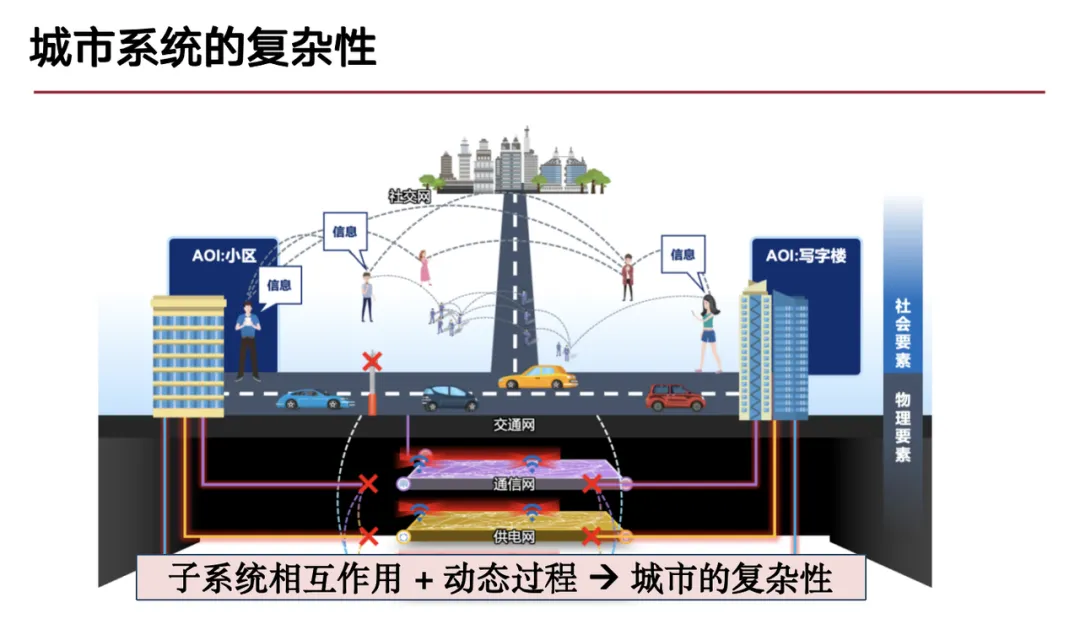

在 HyperAI超神经联合出品的 COSCon’24 AI for Science 论坛中,来自清华大学电子工程系城市科学与计算研究中心的博士后研究员丁璟韬带来了深度分享,以下为演讲精华实录。

随着去年的热潮逐渐冷却,AI 大模型创业领域进入调整期,各大公司的人才流动愈发频繁。

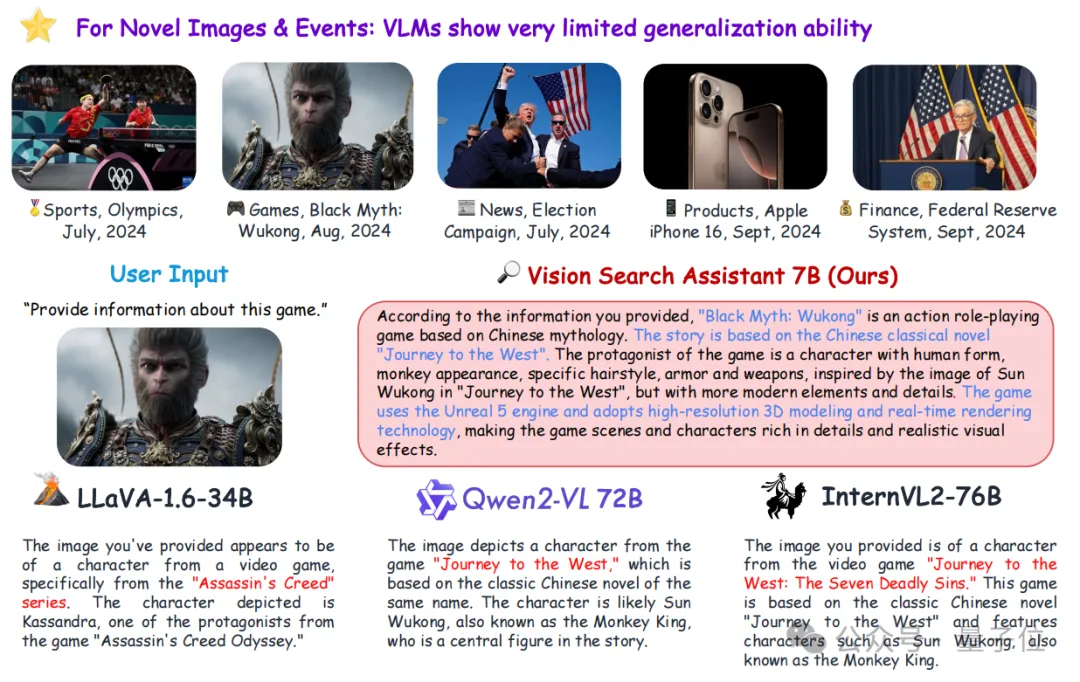

OpenAI推出SearchGPT没几天,开源版本也来了。 港中文MMLab、上海AI Lab、腾讯团队简易实现了Vision Search Assistant,模型设计简单,只要两张RTX3090就可复现。

时至 2024 年 10 月,生成式 AI 的热潮尚未褪去,但现实也已经与 GPT-3 刚刚发布时的那种狂热图景完全不同。

2024年5月8日,AlphaFold3 正式发布!时隔半年,今天,AlphaFold3 终于开源啦!

猛料来了,OpenAI下一代旗舰模型被曝提升不如预期。消息来自The Information,具体指代号“猎户座”(Orion)的模型相对GPT-4的提升幅度,小于GPT-4相对GPT-3,已进入收益递减阶段。或许这也是奥特曼曾说,可能不会把新模型命名为GPT-5的原因之一。

36氪获悉,AI口语学习软件「可栗口语」近日宣布完成数百万元天使轮融资,投资方为嘉程资本和源合资本,本轮及后续融资由源合资本担任独家财务顾问。此次融资资金,将主要用于团队扩展、核心技术研发和市场推广。