英伟达CEO黄仁勋:英伟达每年建新“AI 工厂”,AI性能年增2到3倍 | 最前线

英伟达CEO黄仁勋:英伟达每年建新“AI 工厂”,AI性能年增2到3倍 | 最前线性能翻倍的原因是,端到端建立整个数据中心和AI工厂,并开发软件。

搜索

搜索

性能翻倍的原因是,端到端建立整个数据中心和AI工厂,并开发软件。

真正的史诗级「3A」大作——AI作图、AI配乐、AI配音。 两眼一睁,开始卷饼。 最近,一款名为《沙威玛传奇》的土耳其卷饼小游戏,火爆全网。

特斯拉Optimus机器人发布会被曝远程操控。

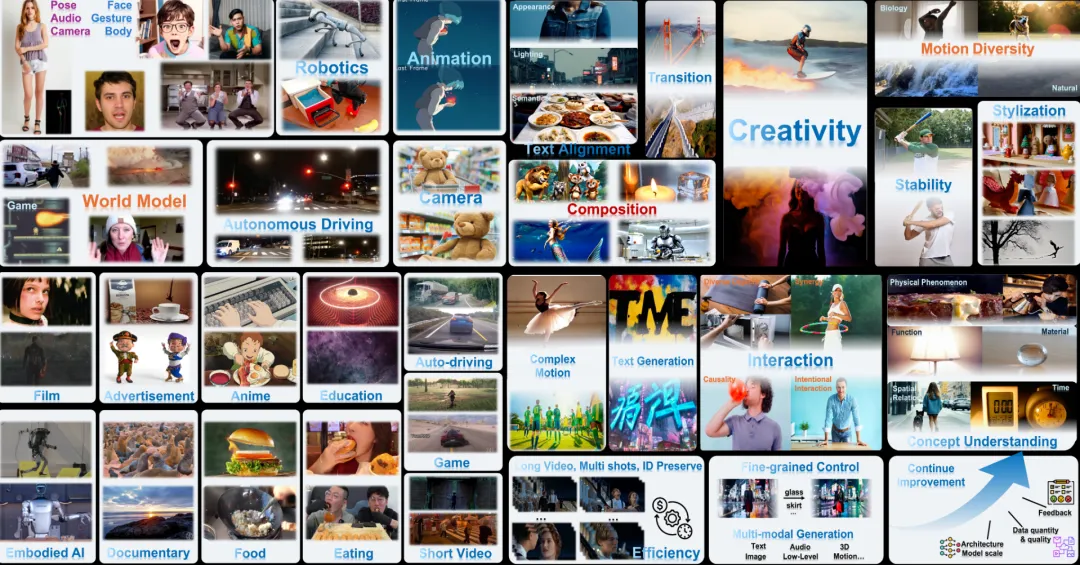

腾讯 AI Lab 联合中科大发布了一份针对类 SORA 视频生成模型的测评报告,重点聚焦目前最前沿的类 SORA DiT 架构的高质量视频生成闭源模型

基于端到端纯学习方法,提高机器人复杂环境下的泛化性。

就在刚刚,OpenAI 53页报告发现,你的名字会决定ChatGPT的回答。在少数情况下,不同性别、种族、民族背景的用户,会得到「量身定制」的回答,充满了AI的刻板印象。比如同样让ChatGPT起视频标题,男生会被建议简单生活,而女生则被建议做一顿晚餐。

AI对待每个人类都一视同仁吗? 现在OpenAI用53页的新论文揭示:ChatGPT真的会看人下菜碟。 根据用户的名字就自动推断出性别、种族等身份特征,并重复训练数据中的社会偏见。

男性用户也有属于自己的3D版“赛博女友”了? 2024年《恋与深空》的问世带领国产乙游进入3D时代,女性用户的“男友”从2D纸片人进化成了3D建模,这一创新致使《恋与深空》开服10个月依然稳坐乙游赛道TOP1,流水一度超过《王者荣耀》登顶iOS畅销榜,真实感更强的3D建模无疑成为了恋爱陪伴赛道的“当红炸子鸡”。

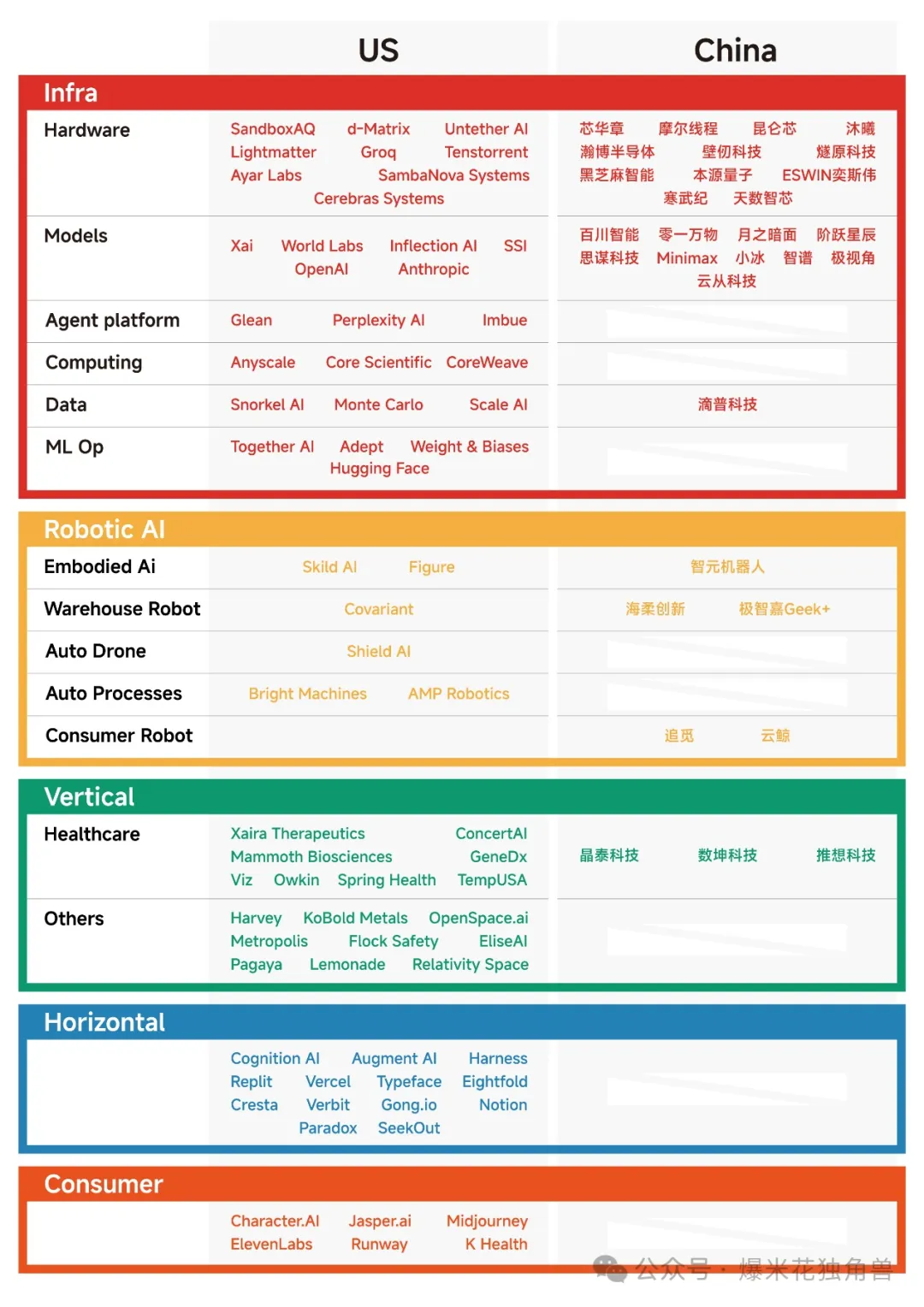

2023年的这时候,很多人都在讲,所有的产品都值得用AI再做一遍。

中国独角兽公司的平均估值约为 27.83 亿美元,而美国独角兽公司的平均估值约为 52.16 亿美元。美国是中国的接近2倍。