25 个智谱 AI 孵化的 AI 项目

25 个智谱 AI 孵化的 AI 项目智谱 AI Z 计划企业路演日:Z DemoDay(2024·Summer)于 8 月 4 日在智谱 AI 公司举办。现场共有 25 家 Z 计划企业参加路演,近 300 位投资人参会(空间有限,策划预期 180 位)。 这也是 Z 计划自发布以来,举办的首届大规模路演活动。现场路演项目覆盖大模型赛道各关键生态位,涉及算力优化、数据治理等基础设施,以及法律、金融、生物医药等多个垂直行业应用场景。

搜索

搜索

智谱 AI Z 计划企业路演日:Z DemoDay(2024·Summer)于 8 月 4 日在智谱 AI 公司举办。现场共有 25 家 Z 计划企业参加路演,近 300 位投资人参会(空间有限,策划预期 180 位)。 这也是 Z 计划自发布以来,举办的首届大规模路演活动。现场路演项目覆盖大模型赛道各关键生态位,涉及算力优化、数据治理等基础设施,以及法律、金融、生物医药等多个垂直行业应用场景。

没想到,撤诉之后,马斯克再度卷土重来,对OpenAI提起新诉讼。这一次,奥特曼和Greg Brockman直接被马斯克安了一个「共谋敲诈勒索」的罪名,被控违反联邦敲诈勒索法!

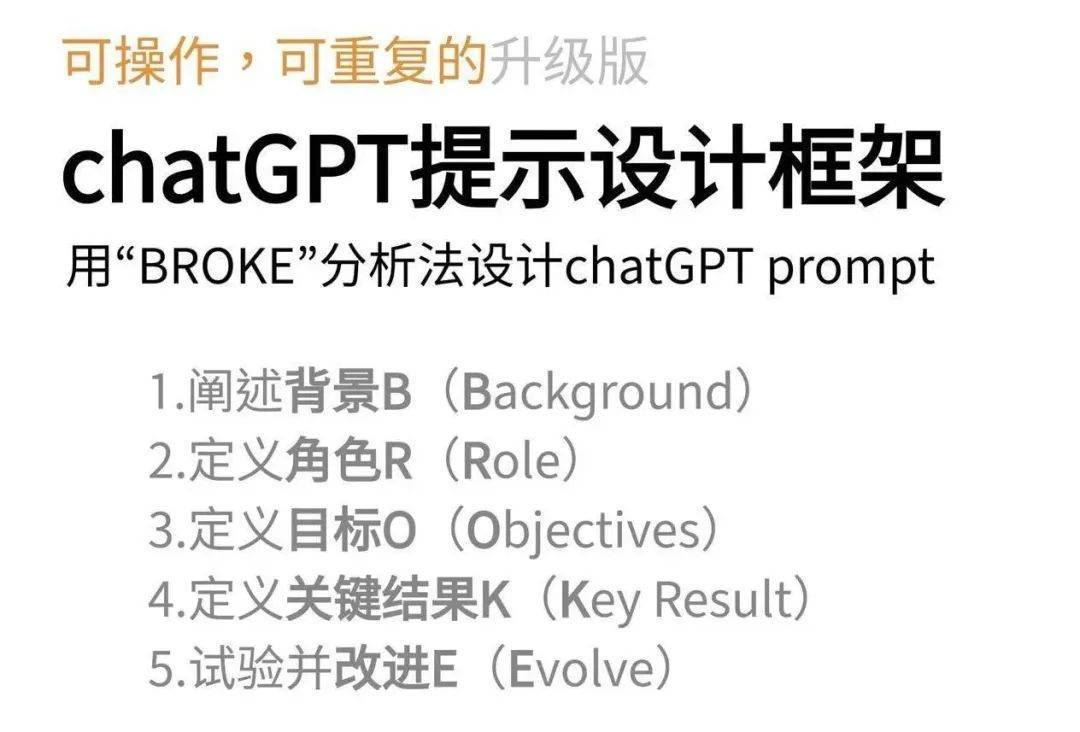

新加坡举办了首届GPT-4提示工程竞赛,Sheila Teo取得了冠军,我们来学习借鉴她采用的三项提示技巧: 使用CO-STAR框架构建提示词 2.使用分隔符将提示词分段 3.使用LLM系统提示

随着大型模型技术的持续发展,视频生成技术正逐步走向成熟。以Sora、Gen-3等闭源视频生成模型为代表的技术,正在重新定义行业的未来格局。然而,截至目前,仍未有一个开源的视频生成模型能够满足商业级应用的要求。

国产版Sora真的卷疯了。

36氪获悉,「心跃智能」宣布完成百万元种子轮融资,投资方为中山大学、广州大学心理学教授以及知名投资机构负责人等个人投资者。本轮融资资金将主要用于产品研发。

从前两年的百模大战到大语言模型 LLM(Large Language Model)的逐步落地应用,端侧AI始终是人工智能技术发展中至关重要的一环。 所谓的端侧AI,即用户在使用过程中不依赖云服务器,直接在终端设备本地使用AI服务。相比于ChatGPT4.0和最新推出的Llama3.1等依赖于云端接口的主流大语言模型,设备端边缘应用的紧凑模型有较强的私密性,也具有个性化操作和节省成本等诸多优势。

Llama 3.1刚发布不久,Llama 4已完全投入训练中。 这几天,小扎在二季度财报会上称,Meta将用Llama 3的十倍计算量,训练下一代多模态Llama 4,预计在2025年发布。

The Information近日爆出了一则OpenAI的亏损新闻,其中新增的关键数据包括: OpenAI目前单月收入约为2.83mnUSD,全年营收可能在35~45亿美金。 OpenAI 24年推理成本将达到40亿美金,训练成本将达到30亿美金。

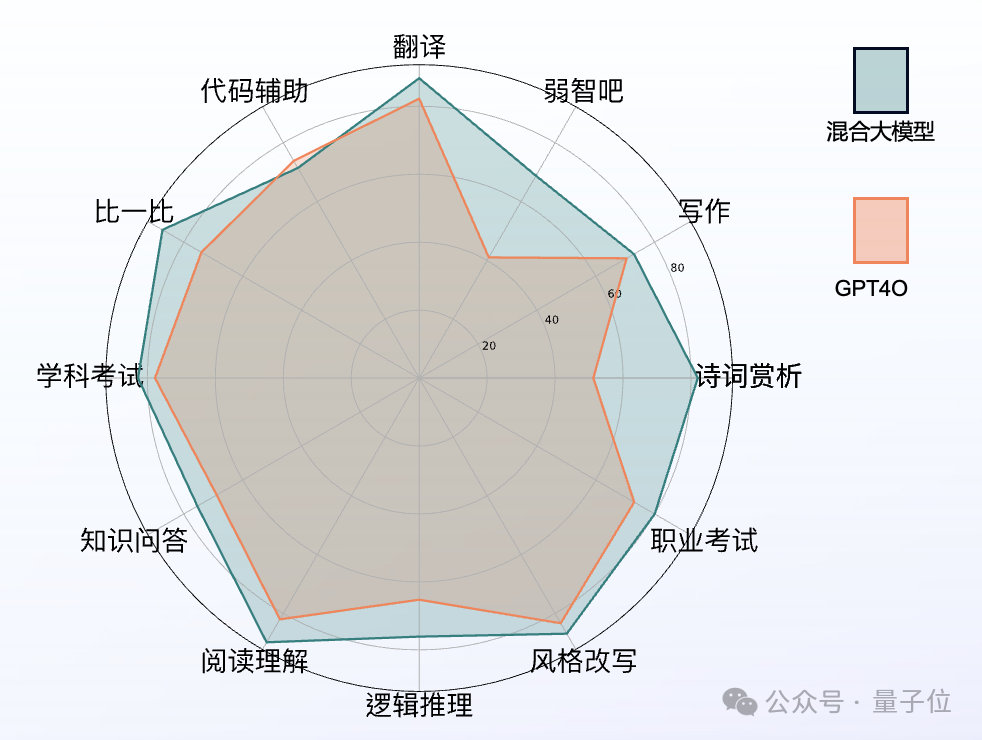

终于,国产大模型能在综合能力上也能与GPT-4o一决雌雄了。