博通开启AI基建2.0时代?美股又一批公司创新高,透露这些信号

博通开启AI基建2.0时代?美股又一批公司创新高,透露这些信号与英伟达的震荡走势形成对比的是,美股AI产业链新一批“明星股”正在崛起。这些公司覆盖了AEC、DCI、存储、ASIC、光纤等业务,多家透露订单强劲,从中或许不难窥见AI基建投资的最新风向。

与英伟达的震荡走势形成对比的是,美股AI产业链新一批“明星股”正在崛起。这些公司覆盖了AEC、DCI、存储、ASIC、光纤等业务,多家透露订单强劲,从中或许不难窥见AI基建投资的最新风向。

近日,Crusoe Energy 宣布已筹集 6.86 亿美元,使其最新融资目标达到 8.18 亿美元。这笔资金将主要用于在德克萨斯州建设一个大型 AI 数据中心,并计划将该中心租赁给 Oracle(甲骨文)、微软 和 OpenAI 等知名公司,以支持其不断增长的算力需求。

在2024 OCP全球峰会上,开发CXL交换机SoC和CXL IP的韩国无晶圆厂初创公司Panmnesia展示了第一个支持CXL的AI集群,该集群采用CXL 3.1交换机。

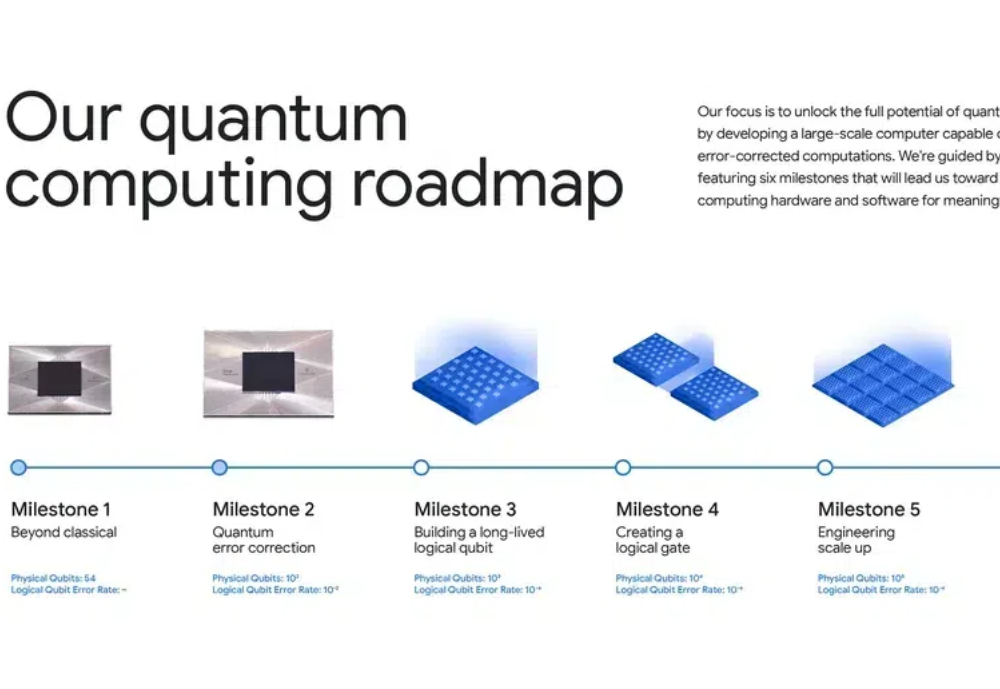

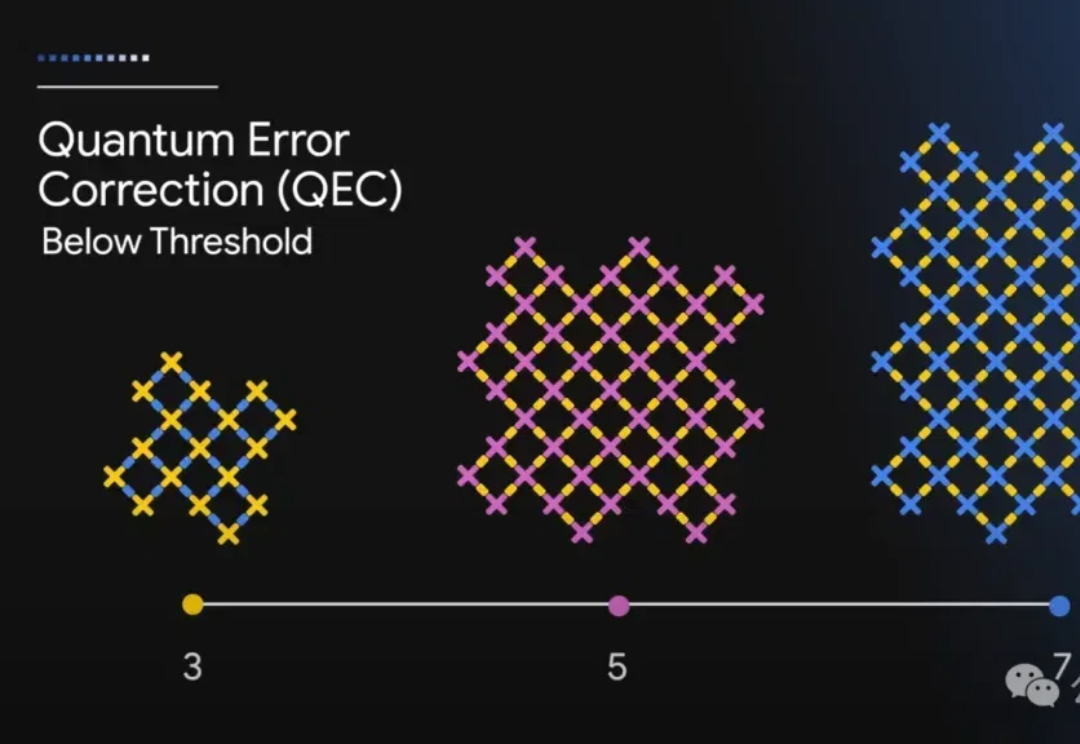

算力更强大,错误更少,量子计算的最大挑战之一被搞定了。 这是一个重要的里程碑。

全球科技圈都在为Sora疯狂,马斯克却轻轻给谷歌点了个赞(doge)。 就在OpenAI“双12”第三天,谷歌在前沿科技的另一极出手了: 发布最新量子芯片,5分钟内完成当今最快超级计算机之一需要10²⁵年才能完成的计算!

纠错功能表明,量子计算机的规模越大,其准确性就越高。

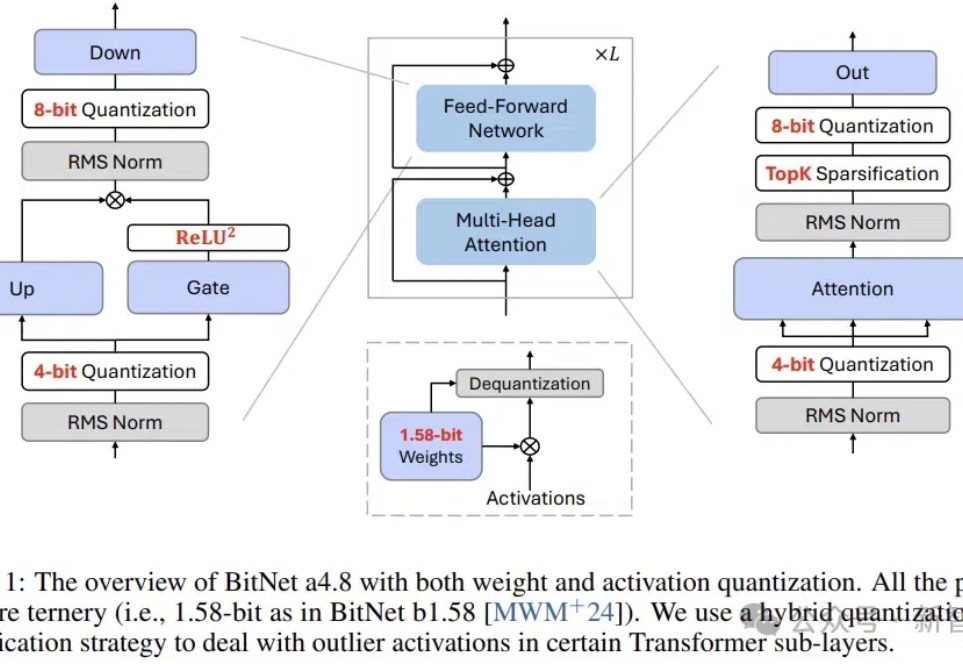

近日,BitNet系列的原班人马推出了新一代架构:BitNet a4.8,为1 bit大模型启用了4位激活值,支持3 bit KV cache,效率再突破。

拜登政府下台之前,还要公布一项限制芯片出口的新举措。据称,新规重点放在了对特定中国实体,以及100多家芯片制造设备研发公司的出口限制。另外,还会新增一些高带宽内存(HBM)条款。

近日,美国政府效率部的马部长(Elon Musk)“跨到科技界”做了一个超级计算机/数据中心,名字叫做 Colossus (巨像)。

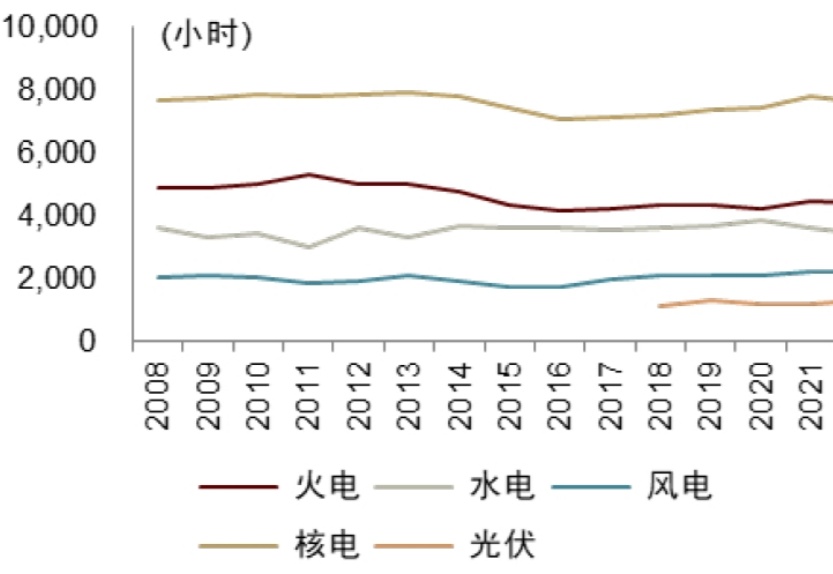

AI芯片越买越多,电却不够用了。