刚刚,神秘模型火了!网友:是OpenAI要开源?

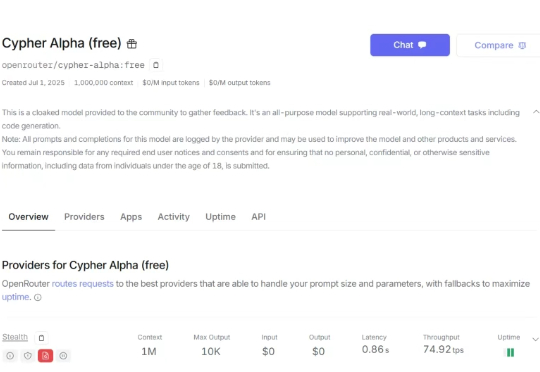

刚刚,神秘模型火了!网友:是OpenAI要开源?OpenRouter 又上新神秘模型了,支持 100 万 token 上下文,猜猜是谁家的。 刚刚,OpenRouter 上出现了一个神秘模型,该模型被命名为「Cypher Alpha」。其可以免费使用,100 万 token 上下文,还具有推理能力。

OpenRouter 又上新神秘模型了,支持 100 万 token 上下文,猜猜是谁家的。 刚刚,OpenRouter 上出现了一个神秘模型,该模型被命名为「Cypher Alpha」。其可以免费使用,100 万 token 上下文,还具有推理能力。

想象一下,凌晨三点你被电话吵醒,公司的核心系统彻底崩溃,数十万用户无法正常使用服务,每分钟损失数万美元。你和 50 个工程师挤在一个 Slack 紧急群里,面对着成千上万条日志、指标和报警,却根本找不到问题的根源。

AI 会计初创公司 Campfire 于 6 月 30 日宣布完成 3500 万美元 A 轮融资,由 Accel 领投,Foundation Capital、Y Combinator、Capital 49 以及 Mercury 首席财务官 Dan Kang 等天使投资人跟投。

6 月 17 日,一款 AI 占星产品 Starla-Call the Universe 进入了 iOS 美国下载总榜前 10,当笔者以为这又是一个昙花一现的产品时,它不仅能够持续坚守榜单 Top 10 长达半个月,而且到了 6 月 24 日,另一款产品 Astra-Life Advice 也进入了美榜前 10,两款同类产品相继进入 Top 10,并双双持续在榜超 1 周的时间。

谁会第一个到达ASI?SemiAnalysis大佬Dylan Patel脱口而出:OpenAI!最近,这位圈内最懂AI和芯片的大佬,毫不留情地戳穿了GPT-4.5惨败的原因,还揭露了Meta仓促模仿DeepSeek结果大翻车的内幕。

前两天,一个AI的虚拟IP火了,刷爆了整个AI圈。 这个AI IP,叫YURI,出自我心中一直封神的AI频道:AI.TALK。

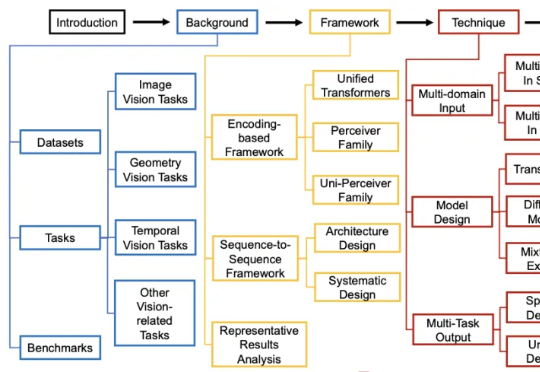

过去几年,通用视觉模型(Vision Generalist Model,简称 VGM)曾是计算机视觉领域的研究热点。

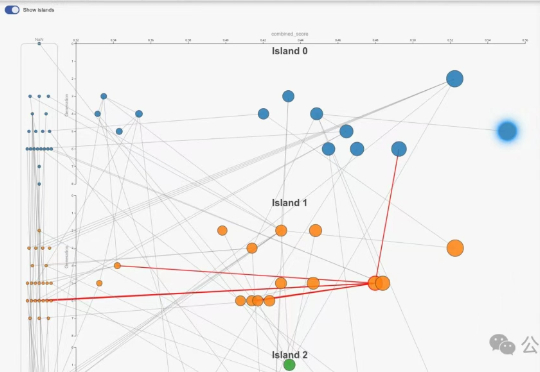

根据Xsignal AI Holo(AI全息)数据库数据,上图呈现出2025年5月海外Web端AI应用类型的发展全景。为方便您最快速掌握关键要点,X博士为您梳理出5个关键洞察(5 Key Insights):

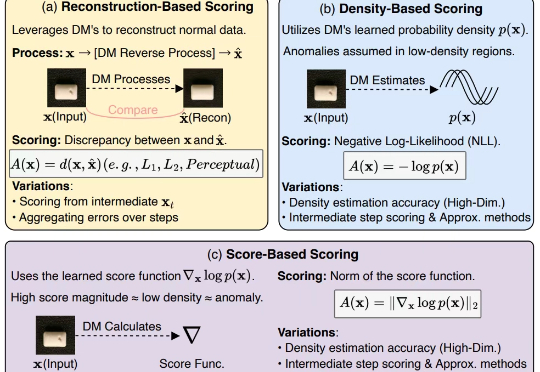

扩散模型(Diffusion Models, DMs)近年来展现出巨大的潜力,在计算机视觉和自然语言处理等诸多任务中取得了显著进展,而异常检测(Anomaly Detection, AD)作为人工智能领域的关键研究任务,在工业制造、金融风控、医疗诊断等众多实际场景中发挥着重要作用。

刚刚,AlphaEvolve又上大分了!基于它的开源实现OpenEvolve,靠自学成才、自己写代码,直接在苹果芯片上进化出了比人类还快21%的GPU核函数!这一刻,是自动化编程史上真正里程碑时刻,「AI为AI编程」的新时代正式开启,自动化奇点真要来了。