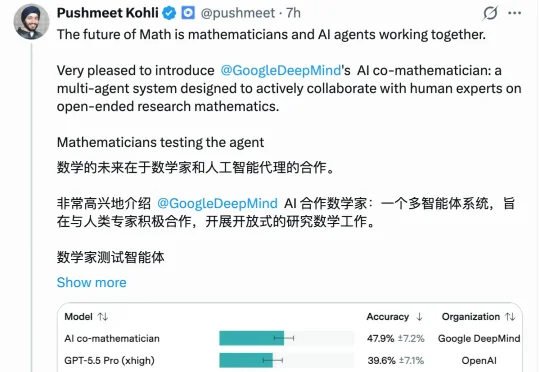

谷歌「AI联合数学家」来了!刷新最难数学AI基准SOTA,牛津教授用它解开群论悬案

谷歌「AI联合数学家」来了!刷新最难数学AI基准SOTA,牛津教授用它解开群论悬案群论领域几十年无解的第21.10号问题,被牛津数学家Marc Lackenby用谷歌一个新系统破解了。过程也很有意思:AI第一次给出的证明是错的,被系统里的审查Agent揪出了漏洞。

搜索

搜索

群论领域几十年无解的第21.10号问题,被牛津数学家Marc Lackenby用谷歌一个新系统破解了。过程也很有意思:AI第一次给出的证明是错的,被系统里的审查Agent揪出了漏洞。

随手打开 GitHub,2026 年的 Agent 项目热榜上有这样一个仓库: • 27,000+ stars,1,800+ forks • 零行 Python,零行 TypeScript,零行 JS • 作者是 Obsidian 的 CEO 本人,kepano • 整个仓库就是 5 个 Markdown 文件

AI 基础设施初创公司 RadixArk 宣布完成 1 亿美元种子轮融资,投后估值 4 亿美元。无论金额、估值还是投资人阵容,这都是 2026 年 AI Infra 赛道中目前最重的一笔早期下注。

我一直全程关注他打假的全过程,也一直有个想法:耿同学做的这些,能不能让 AI 分担一部分?这几天我琢磨了很久,也 Vibe Coding 了很久,最后做出来一个初版的 「学术打假 Skill——research-integrity-auditor」。

Anthropic 在短短几年内就成为了OpenAI 的最强劲敌!

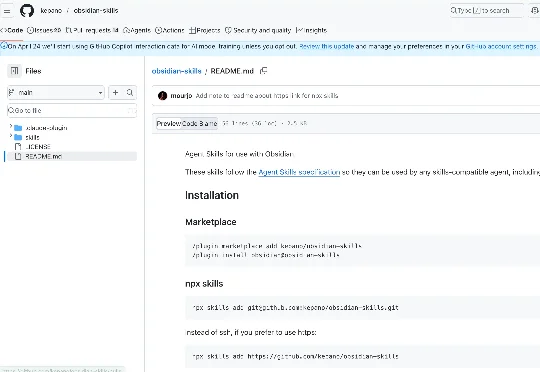

5月6日,主营AI招聘的初创公司Ethos宣布完成2275万美元(约合人民币1.55亿元)的A轮融资,由a16z领投,General Catalyst、XTX Markets、Evantic Capital和Common Magic跟投。

火爆全网的Harness架构,终于在最难的医疗圈落地了!从单次问诊到全天候赛博名医盯盘,大健康赛道彻底变天。

SWE-Bench 的创建者,刚刚又放出了一个地狱级新 benchmark。

两位哈佛毕业的女生 Eva Tuecke 和 Catherine Yeo 用 AI 改变了电池故障排查,她们创立的 Altara 公司在近日获得 700 万美元种子轮融资,估值 7 亿美元,领投方是 Greylock。Neo、BoxGroup 和 Liquid 2 Ventures 也参与了本轮融资,此外还有包括 Jeff Dean 在内的知名天使投资人以及 OpenAI 和 AMD 的高层领导。

做文献调研时,很多人的流程大概是这样的: