刚刚,小扎终极野心曝光:为数十亿人提供个人超级智能!

刚刚,小扎终极野心曝光:为数十亿人提供个人超级智能!扎克伯格携手Broadcom签下五年长约,自研芯片、GW级数据中心、百亿美元挖人——Meta正式向「人手一个超级智能」的终极目标发起冲锋。

搜索

搜索

扎克伯格携手Broadcom签下五年长约,自研芯片、GW级数据中心、百亿美元挖人——Meta正式向「人手一个超级智能」的终极目标发起冲锋。

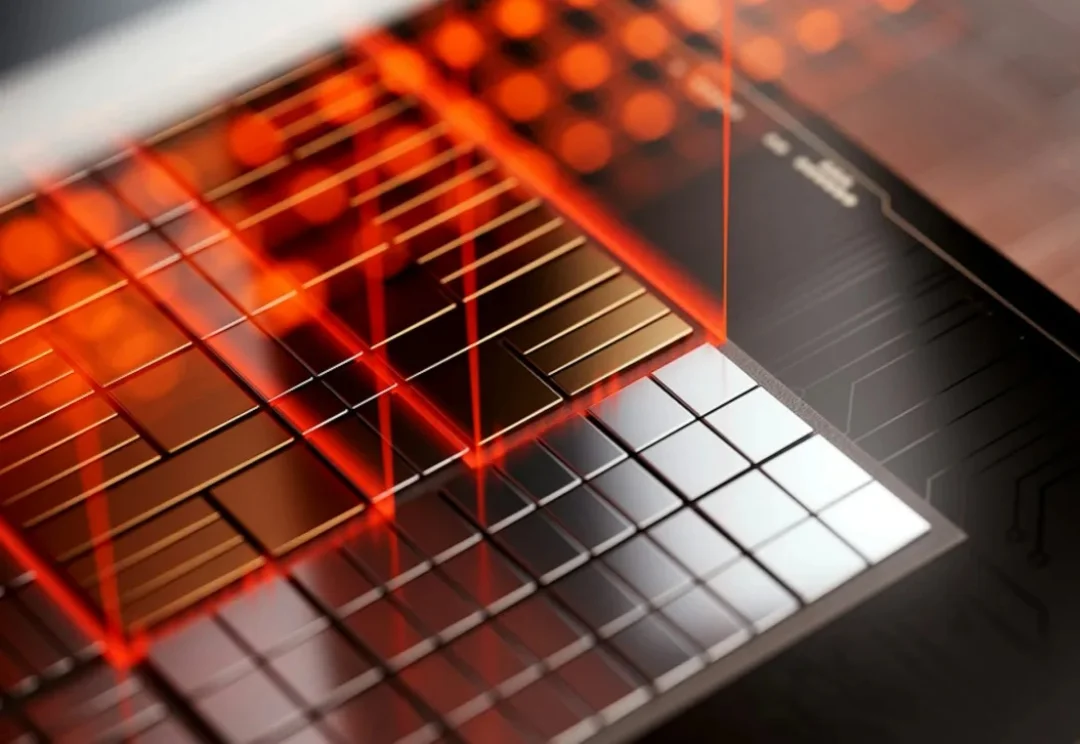

卡住英伟达Rubin产能的,既不是GPU也不是HBM,竟是一张绝缘薄膜?全球95%以上的供应,握在一家你只听过它味精的日本公司手里。

SiFive 是一家由加州大学伯克利分校工程师创办的公司,这些工程师创造了开源芯片设计,该公司已获得一轮超额认购的 4 亿美元融资,公司估值达 36.5 亿美元。

刚刚,深圳机器人芯片公司地瓜机器人宣布拿下1.5亿美元(约合人民币10.24亿元)B2轮新融资,某零售科技与供应链巨头、滴滴、Prosperity7风投基金、高瓴创投、淡马锡旗下Vertex Growth、五源资本等产业巨头及一线资本参投。

RISC-V摘掉紧箍咒!坐上高端算力牌桌,首次原生跑通千亿大模型。

目标年产超过1万亿瓦算力。

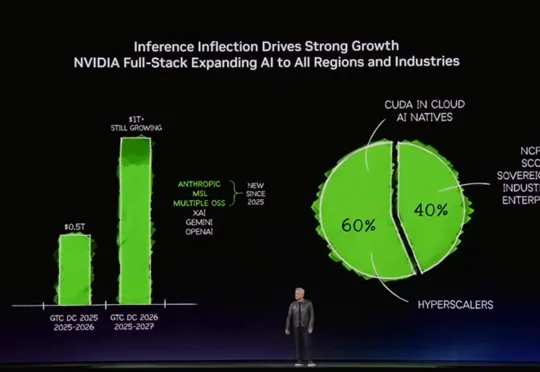

老黄:科技公司的算力焦虑,有 1 万亿刀那么大。北京时间今天凌晨两点,英伟达 GTC 大会在加州圣何塞正式召开,这回的 Keynote 注定要被各大公司 CEO 不断引用了。

OpenClaw太耗token,要烧光全球算力?追觅科技的答案是,把算力送上太空!200万颗的算力卫星,直接碾压了马斯克的SpaceX。不仅如此,他们也开始下场做芯片了。

英伟达200亿美元「招安」Groq,推理芯片赛道一夜变天。但在大洋彼岸,一家北大系创业公司刚刚交出了自己的流片答卷。

ZP独家获悉,AI芯片及系统架构研发商“上海昉擎科技”于近日完成 Pre-A3 轮融资,新引入投资人国开科创、钧山资本、建发新兴投资、多维资本,多维资本担任本轮融资财务顾问并担任后续融资独家财务顾问。