走在GPT 4.5前面?3D、视频直接扔进对话框,大模型掌握跨模态推理

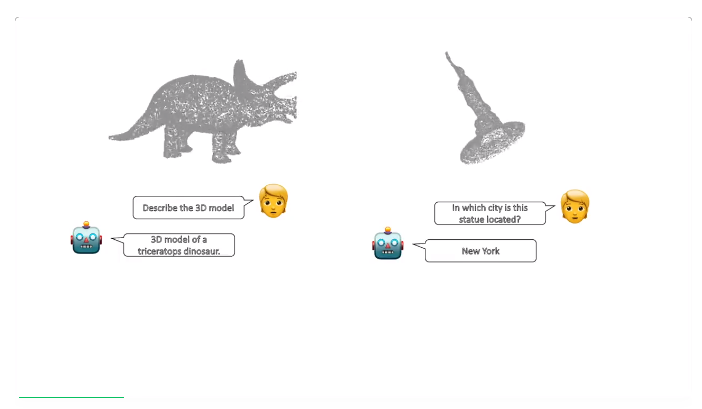

走在GPT 4.5前面?3D、视频直接扔进对话框,大模型掌握跨模态推理最近,有人在社交媒体上发布了一张有关 GPT4.5 更新的截图。图中内容显示,和 GPT 系列之前推出的模型相比,GPT4.5 最大的惊喜可能就是处理 3D 和视频的能力。至于 3D 能力到底是指看得懂 3D 图像,还是能输入 3D 模型,目前只能靠猜。

最近,有人在社交媒体上发布了一张有关 GPT4.5 更新的截图。图中内容显示,和 GPT 系列之前推出的模型相比,GPT4.5 最大的惊喜可能就是处理 3D 和视频的能力。至于 3D 能力到底是指看得懂 3D 图像,还是能输入 3D 模型,目前只能靠猜。

文生视频可以精细到什么程度?最近,阿里巴巴的一项研究给出了答案:1280×720 分辨率没有压力,而且生成效果非常连贯。

AI 视频生成有多卷?最近 Pika 的火热,重新带动了人们对 AI 视频生成的关注,甚至带动创始人父亲的上市公司接连涨停。

今年10月,《时代》杂志发布了一份「2023最佳发明」榜单,为了呼应AI浪潮,《时代》从去年开始就特别设置了「AI单元」。在今年入选的十几个应用中,排在老牌软件巨头Adobe和屠龙少年OpenAI之后的就是大火的文生视频应用——Runway Gen-2。

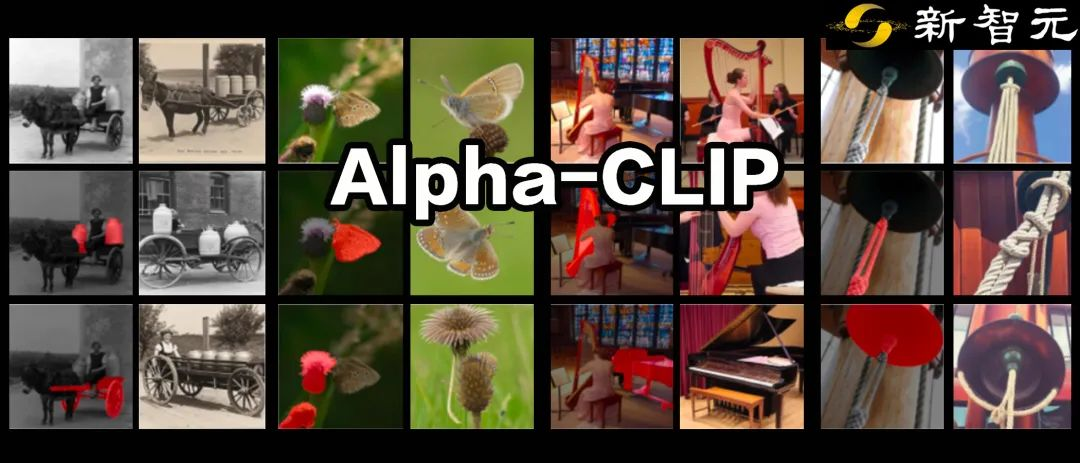

本文介绍了一个名为Alph-CLIP的框架,它在原始的接受RGB三通道输入的CLIP模型的上额外增加了一个alpha通道。在千万量级的RGBA-region的图像文本对上进行训练后,Alpha-CLIP可以在保证CLIP原始感知能力的前提下,关注到任意指定区域。通过替换原始CLIP的应用场景,Alpha-CLIP在图像识别、视觉-语言大模型、2D乃至3D生成领域都展现出强大作用。

最近,来自南大等机构的研究人员开发了一个通用的框架,用一段音频就能让照片上的头像讲多国语言。不论是头部动作还是嘴型都非常自然,看到很多不错的

Runway突然发布公告,宣称要开发通用世界模型,解决AI视频最大难题,未来要用AI模拟世界。

今天,李飞飞携斯坦福联袂谷歌,用Transformer生成了逼真视频,效果媲美Gen-2比肩Pika。2023年俨然已成AI视频元年!

啥?AI都能自己看电影大片了?贾佳亚团队最新研究成果,让大模型直接学会了处理超长视频。

Pika 1.0首测开启了!网友抢先体验,每个视频都是经典。Pika 1.0正式上线后,拿到内测资格的网友们已经玩疯了!