37项SOTA!全模态预训练范式MiCo:理解任何模态并学习通用表示|港中文&中科院

37项SOTA!全模态预训练范式MiCo:理解任何模态并学习通用表示|港中文&中科院GPT-4o掀起一股全模态(Omni-modal)热潮,去年的热词多模态仿佛已经不够看了。

GPT-4o掀起一股全模态(Omni-modal)热潮,去年的热词多模态仿佛已经不够看了。

AGI太遥远,只有模型降价是共识。

什么是 AGI?大模型和 Scaling Law 是其实现基座吗?怎么看价格战?四家大模型公司给出了自己的答案。

训练数据的数量和质量,对LLM性能的重要性已经是不言自明的事实。然而,Epoch AI近期的一篇论文却给正在疯狂扩展的AI模型们泼了冷水,他们预测,互联网上可用的人类文本数据将在四年后,即2028年耗尽。

谷歌DeepMind开发的AlphaFold一夜之间颠覆了生物学,这一革命性的突破背后,有一支怎样的团队?AlphaFold的缔造者之一、DeepMind研究副总裁分享了成功的秘密——如何组建一个团队来应对这一巨大的跨学科挑战并取得胜利。

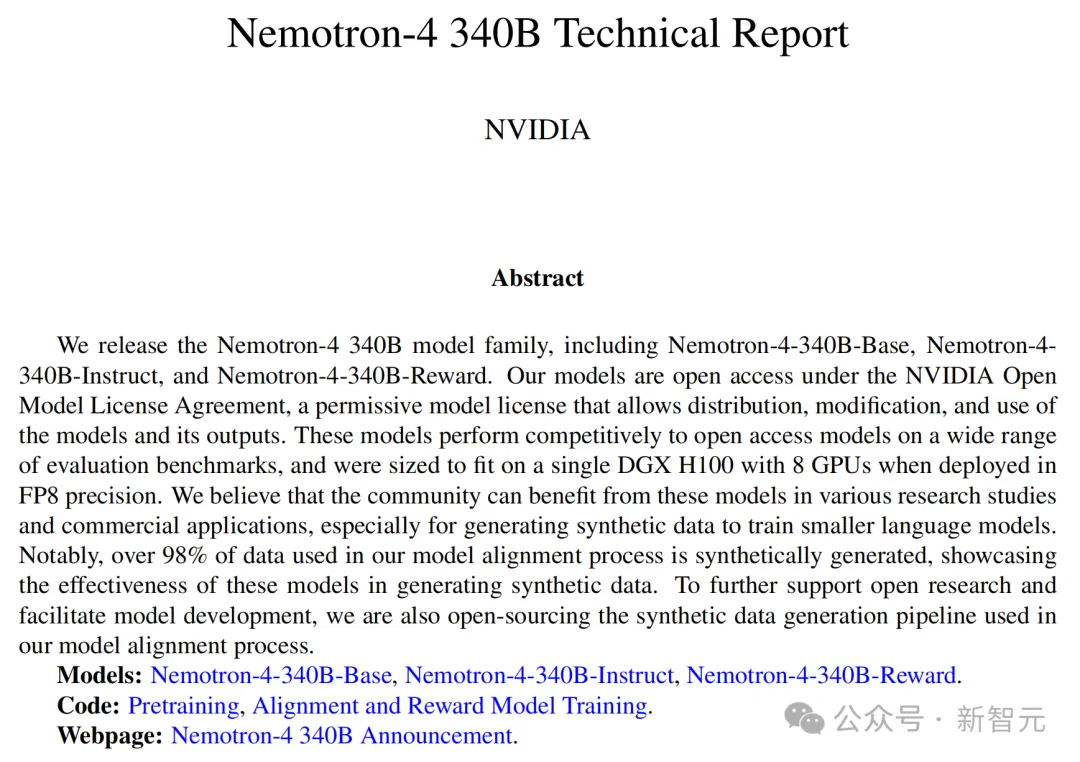

刚刚,英伟达全新发布的开源模型Nemotron-4 340B,有可能彻底改变训练LLM的方式!从此,或许各行各业都不再需要昂贵的真实世界数据集了。而且,Nemotron-4 340B直接超越了Mixtral 8x22B、Claude sonnet、Llama3 70B、Qwen 2,甚至可以和GPT-4掰手腕!

人形机器人的「Hello World」。

Copilot GPTs 下月停服,Recall AI 功能也被推迟发布,微软这是啥情况?

本文编译自播客 20VC,Harry Stebbings 与 Matt Lerner 谈论了 AI 时代中初创企业的最佳增长方法论。

本周国内最受关注的AI盛事,今日启幕。 活动规格之高,没有哪个关心AI技术发展的人能不为之吸引—— Sora团队负责人Aditya Ramesh与DiT作者谢赛宁同台交流,李开复与张亚勤炉边对话,Llama2/3作者Thomas Scialom,王小川、杨植麟等最受关注AI创业者……也都现场亮相。