大模型时代,百度智能云迎来最大机会

大模型时代,百度智能云迎来最大机会春节以来,DeepSeek 的爆火点燃了 AI 产业化的加速引擎,但 AI 的真正落地远不止于技术突破,更是对基础设施和生态系统的巨大考验。

春节以来,DeepSeek 的爆火点燃了 AI 产业化的加速引擎,但 AI 的真正落地远不止于技术突破,更是对基础设施和生态系统的巨大考验。

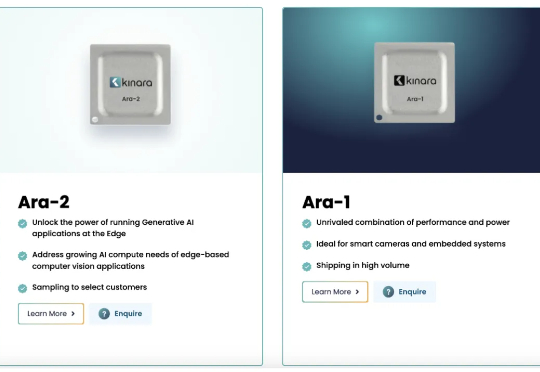

自从DeepSeek带火了蒸馏模型以后,更多人开始关注AI大模型在边缘端的部署。而在过去,TinyML一直也在MCU领域很火热。现在,边缘AI走得更快了,市场也正在走向爆发。

满血DeepSeek一体机,价格竟然被打到10万元级别了!

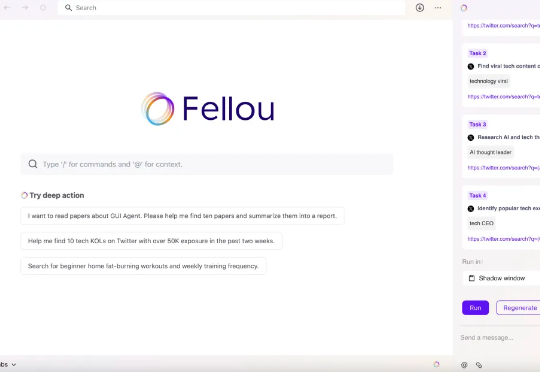

春天,1000 个通用 Agent 正在爆发。 所有的 Chatbot,都在改造成 Agent。技术在迁移,新的技术栈催生了新的产品形态——通用 Agent、Manus、Deep Research,一如过去两年大家的信仰,应用一定是中国开发者的机会。

“2月16日那一周,感觉全中国的政府企业都在上Deepseek,甚至很多单位原来一张卡都没有,突然就有了DeepSeek满血版。”金山办公Office产研事业部副总经理刘丹说道,“那段时间我认识的大部分领导也都在问,‘你们到底什么时候接,怎么样的节奏’,整个行业都特别火热。”

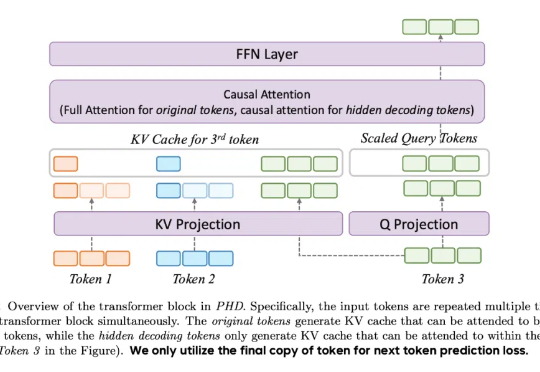

在当前大语言模型(LLMs)广泛应用于问答、对话等任务的背景下,如何更有效地结合外部知识、提升模型对复杂问题的理解与解答能力,成为 RAG(Retrieval-Augmented Generation)方向的核心挑战。

阿里Qwen3凌晨开源,正式登顶全球开源大模型王座!它的性能全面超越DeepSeek-R1和OpenAI o1,采用MoE架构,总参数235B,横扫各大基准。这次开源的Qwen3家族,8款混合推理模型全部开源,免费商用。

最近,DeepSeek-R1 和 OpenAI o1/03 等推理大模型在后训练阶段探索了长度扩展(length scaling),通过强化学习(比如 PPO、GPRO)训练模型生成很长的推理链(CoT),并在奥数等高难度推理任务上取得了显著的效果提升。

年初,DeepSeek 上线,18 天内即获得了 1600 万次下载,登顶 140 国下载榜单。让人意料之外而又情理之中的是,AI最火的功能不是翻译、写作,而是算命。有数据显示,#DeepSeek 算命等话题在小红书上吸引了超过 6600 万次浏览。

终于,免费用户也能用上OpenAI的DeepResearch了,量子位也进行了新鲜实测!OpenAI深夜官宣,基于o4-mini某个版本的轻量版DeepResearch正式上线。按照官方说法,轻量版的回答会更短,但智能水平将几乎无异于满血版本。