国运级的创新?从 DeepSeek-V3 到 R1 的架构创新与误传的万字长文分析

国运级的创新?从 DeepSeek-V3 到 R1 的架构创新与误传的万字长文分析DeepSeek 的最新模型 DeepSeek-V3 和 DeepSeek-R1 都属于 MoE(混合专家)架构,并在开源世界产生了较大的影响力。特别是 2025 年 1 月开源的 DeepSeek-R1,模型性能可挑战 OpenAI 闭源的 o1 模型。

DeepSeek 的最新模型 DeepSeek-V3 和 DeepSeek-R1 都属于 MoE(混合专家)架构,并在开源世界产生了较大的影响力。特别是 2025 年 1 月开源的 DeepSeek-R1,模型性能可挑战 OpenAI 闭源的 o1 模型。

DeepSeek火的一塌糊涂,其访问量暴涨614%,已成全球第二大爆火应用。马斯克剧透,xAI将发布比R1更好的模型。

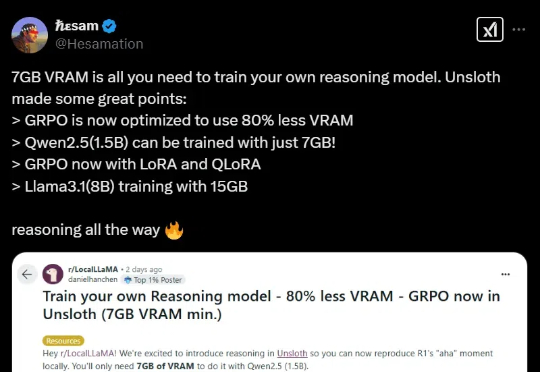

黑科技来了!开源LLM微调神器Unsloth近期更新,将GRPO训练的内存使用减少了80%!只需7GB VRAM,本地就能体验AI「啊哈时刻」。

DeepSeek让国内一众大模型同行度过了一个“痛苦”的春节。年前,DeepSeek掀起AI海啸,有某大厂大模型业者就捶胸顿足:“产品超出了我的想象,比咱家的各方面都好,真想跳槽到DeepSeek。”还有很多人反思,为啥咱自家就没做出DeepSeek。也有业者不服气,认为“它的火只是一种情绪的泡沫。”

目前在淘宝、小红书、抖音等短视频平台及知识星球等知识付费平台上,已经涌现出大量顶着DeepSeek名义进行赚钱的项目,赚钱模式大致可分为三大类:卖课程、卖AI服务、博眼球打造个人IP。三项中,以卖课程最为盛行。

在柏林工业大学的一场圆桌对话当中,奥特曼再一次谈到了DeepSeek,并大赞开源模型对世界的贡献。对话中,奥特曼还发表了对AGI的最新看法,透露了十足的信心,他认为,虽然会遇到阻碍和挑战,但他相信人类终将实现AGI。

Perplexity CEO Arvin Srinivas 在今天 CNBC 采访中谈到了 Perplexity 与 DeepSeek 的整合,以及作为美国初创公司如何确保用户数据安全、避免审查问题,并提出了其与 TikTok 合并的战略构想。

爆火的DeepSeek,足以载入史册。很多年后人们回想起这一刻,结论或许是从2022年底OpenAI发布ChaGPT,中国AI发展的主流叙事始终是“追赶”,而DeepSeek横空出世,将“追赶“变成了“创新”和“普及”,甚至是“重塑”和“超越”。

刚刚,腾讯云再放大招——不仅上线了 DeepSeek-R1 和 V3 原版模型的 API 接口,还将它们接入了大模型知识引擎,并支持联网搜索,成为国内率先实现这一能力的云厂商。

2月8日,昆仑万维旗下「天工AI」正式推出PC版重大更新——上线“DeepSeek R1 + 联网搜索”功能。这一全新升级,不仅解决了用户长期以来关注的DeepSeek联网功能无法使用的问题,还优化了R1版本偶尔崩溃的困扰,为用户带来更加稳定、高效、智能的AI体验。