实测昆仑万维对话AI「Skyo」,会读诗、知晓雷军摆拍

实测昆仑万维对话AI「Skyo」,会读诗、知晓雷军摆拍算起来,距离 5 月 14 日 OpenAI 发布 GPT-4o 高级语音模式已经过去了半年时间。在这期间,AI 实时语音对话已经成为了有能力大厂秀肌肉、拼实力的新战场。

算起来,距离 5 月 14 日 OpenAI 发布 GPT-4o 高级语音模式已经过去了半年时间。在这期间,AI 实时语音对话已经成为了有能力大厂秀肌肉、拼实力的新战场。

研究人员通过案例研究,利用大型语言模型(LLMs)如GPT-4、Claude 3和Llama 3.1,探索了思维链(CoT)提示在解码移位密码任务中的表现;CoT提示虽然提升了模型的推理能力,但这种能力并非纯粹的符号推理,而是结合了记忆和概率推理的复杂过程。

猛料来了,OpenAI下一代旗舰模型被曝提升不如预期。消息来自The Information,具体指代号“猎户座”(Orion)的模型相对GPT-4的提升幅度,小于GPT-4相对GPT-3,已进入收益递减阶段。或许这也是奥特曼曾说,可能不会把新模型命名为GPT-5的原因之一。

随着AI大模型在今年618前夕打起价格战,当以GPT-4o为代表的多模态大模型将交互体验也推向更高的层次,也意味着杀手级AI应用或许真的来到了奇点时刻。如今AI行业的创业者已经不再聚焦大模型,而是开始尝试用AI赋能具体的应用场景。

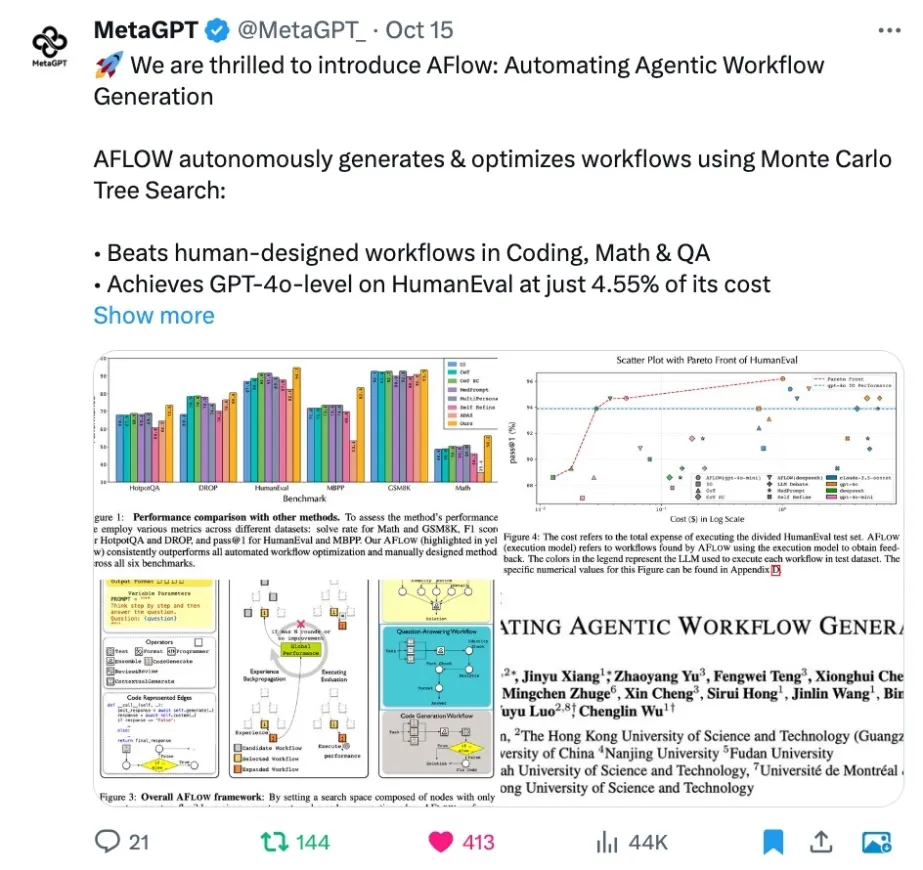

对于 LLM 从业者来说,让 LLM 落地应用并发挥作用需要手动构建并反复调试 Agentic Workflow,这无疑是个繁琐过程,一遍遍修改相似的代码,调试 prompt,手动执行测试并观察效果,并且换个 LLM 可能就会失效,有高昂的人力成本。许多公司甚至专职招聘 Prompt Engineer 来完成这一工作。

OpenAI出了个新功能,直接让ChatGPT输出的速度原地起飞! 这个功能叫做“预测输出”(Predicted Outputs),在它的加持之下,GPT-4o可以比原先快至多5倍。

视觉语言模型(如 GPT-4o、DALL-E 3)通常拥有数十亿参数,且模型权重不公开,使得传统的白盒优化方法(如反向传播)难以实施。

与最先进的开源方法甚至闭源模型 GPT-4o 相比,MMedAgent 在各种医疗任务中实现了卓越的性能。此外,MMedAgent 在更新和集成新医疗工具方面表现出效率。

中国企业对于生成式AI应用场景的了解都来自于ChatGPT的传说,但中国企业能使用的GenAI资源与ChatGPT却没有关系。直截了当地说,中国企业目前能够使用的GenAI资源都比GPT-4要差很多,注意不是“有差距”,而是“差很多”,这是中国企业考虑生成式AI问题的基本前提。

一群大模型玩你画我猜,人类一旁围观超起劲儿。 就像下面这张图展示的,由Grok画长颈鹿,一堆大模型根据生成内容猜答案。参赛选手包括GPT-4o、Claude、Llama、Gemini、Grok等。