OpenAI机密五级AGI路线图曝光!GPT-4仍处L1,内部AI接近博士水平18个月诞生

OpenAI机密五级AGI路线图曝光!GPT-4仍处L1,内部AI接近博士水平18个月诞生OpenAI全新的AGI路线图,刚刚被曝出了!OpenAI将AI划分为5个等级,自称其AI模型正处于L1,但很快就会达到L2(推理者)。而根据其前研究员预测,五级AGI最快将在27年实现。

OpenAI全新的AGI路线图,刚刚被曝出了!OpenAI将AI划分为5个等级,自称其AI模型正处于L1,但很快就会达到L2(推理者)。而根据其前研究员预测,五级AGI最快将在27年实现。

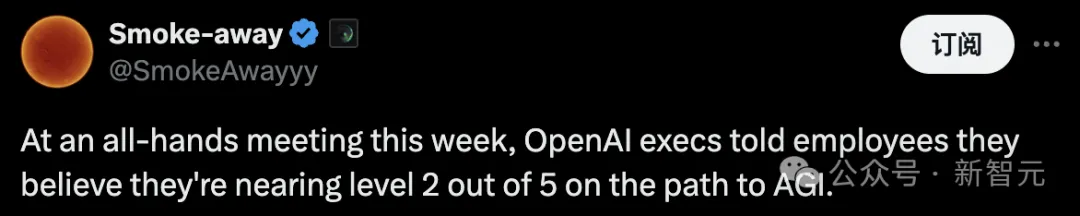

《思考快与慢》中人类的两种思考方式,属实是被Meta给玩明白了。

评估大模型是否诚实的基准来了!

大模型权威测试,翻车了?! HuggingFace都在用的MMLU-PRO,被扒出评测方法更偏向闭源模型,被网友直接在GitHub Issue提出质疑。

四大 VLM,竟都在盲人摸象?

来自佐治亚理工学院和英伟达的两名华人学者带队提出了名为RankRAG的微调框架,简化了原本需要多个模型的复杂的RAG流水线,用微调的方法交给同一个LLM完成,结果同时实现了模型在RAG任务上的性能提升。

WHO 表示,1/3 的癌症可以通过早发现、早治疗得以治愈。

Anthropic首席执行官表示,当前AI模型训练成本是10亿美元,未来三年,这个数字可能会上升到100亿美元甚至1000亿美元。要知道,GPT-4o这个曾经最大的模型也只用了1亿美元。千亿美刀,究竟花在了哪里?

GPT-4o的“AI视频通话”一鸽再鸽,但网友却是急不可耐想要体验。

2024 年,为何期待已久的 AGI 应用大爆发迟迟没有来临?