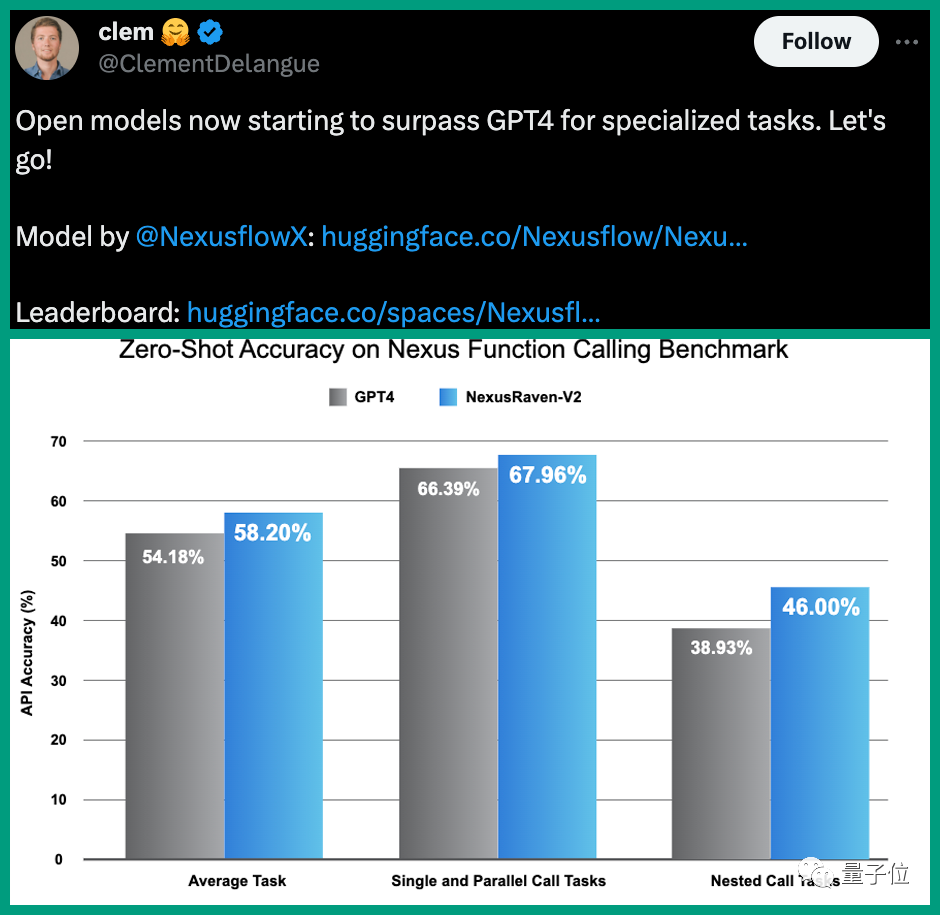

清华特奖焦剑涛大模型创业:突破GPT-4工具使用能力,搞开源种子轮融资七千万

清华特奖焦剑涛大模型创业:突破GPT-4工具使用能力,搞开源种子轮融资七千万开源模型终于开始超越GPT-4了。

开源模型终于开始超越GPT-4了。

OpenAI GPT-4V 和 Google Gemini 都展现了非常强的多模态理解能力,推动了多模态大模型(MLLM)快速发展,MLLM 成为了现在业界最热的研究方向。

在Gemini开放API不到一周的时间,港中文等机构就完成评测,联合发布了多达128页的报告,结果显示:在37个视觉理解任务上,Gemini-Pro表现出了和GPT-4V相当的能力。

AI颠覆化学研究再次登上Nature!由CMU和Emerald Cloud Lab团队开发的GPT-4加持的AI工具,在不到4分钟的时间成功复现2010年诺奖研究成果。

相比GPT-3,GPT-4 (包括GPT-3.5) 的能力有了非常巨大的进步。这背后其实得益于一个很重要的过程引入:微调。

这个由 GPT-4 驱动的“AI 实验室伙伴”名为 Coscientist,由来自卡内基梅隆大学和 Emerald Cloud Lab 的研究团队共同提出,刚刚登上了权威科学期刊 Nature。

AI大模型的答案,不是只有ChatGPT。被ChatGPT压制了一整年的谷歌,终于在AI大模型领域亮出了大招,推出了AI模型Gemini,6分钟的演示视频直接刷爆全球互联网。

近期,关于GPT-4.5提前泄露的消息在全网疯传,逼的OpenAI研究员甚至Altman本人下场否认,但这仍然挡不住愉快吃瓜的网友。

多模态技术是 AI 多样化场景应用的重要基础,多模态大模型(MLLM)展现出了优秀的多模态信息理解和推理能力,正成为人工智能研究的前沿热点。上周,谷歌发布 AI 大模型 Gemini,据称其性能在多模态任务上已全面超越 OpenAI 的 GPT-4V,再次引发行业的广泛关注和热议。

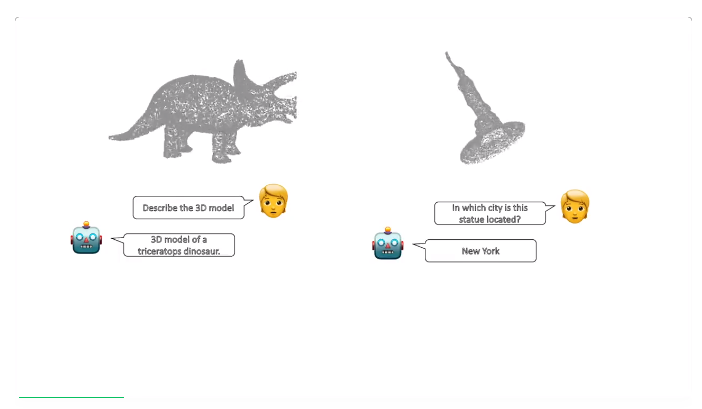

最近,有人在社交媒体上发布了一张有关 GPT4.5 更新的截图。图中内容显示,和 GPT 系列之前推出的模型相比,GPT4.5 最大的惊喜可能就是处理 3D 和视频的能力。至于 3D 能力到底是指看得懂 3D 图像,还是能输入 3D 模型,目前只能靠猜。