在RTE2024,窥见实时AGI的未来

在RTE2024,窥见实时AGI的未来GPT-4o的高级语音模式让我们看到了AI也可以具备低延迟且自然流畅的对话能力。丝滑的体验让智能助手真正摆脱了“智障”的帽子,科幻电影《Her》中的场景,走进了现实。

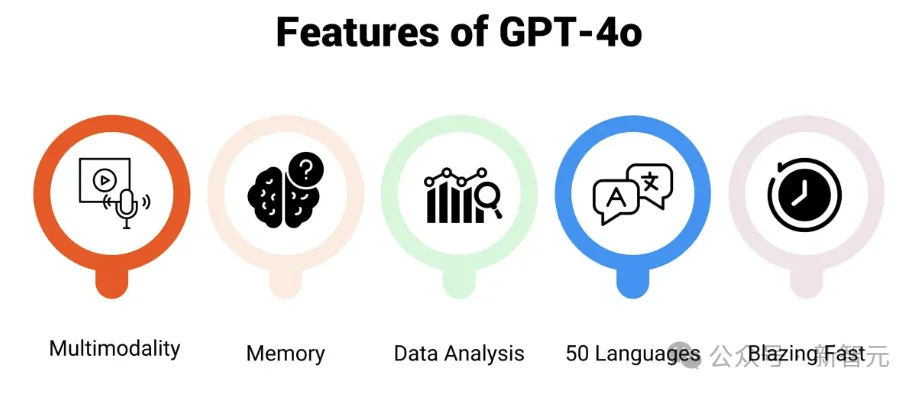

GPT-4o的高级语音模式让我们看到了AI也可以具备低延迟且自然流畅的对话能力。丝滑的体验让智能助手真正摆脱了“智障”的帽子,科幻电影《Her》中的场景,走进了现实。

马斯克终于兑现8月承诺了,xAI API正式上线。不过,价格却是GPT-4o两倍。

把《我的世界》交给大模型,会怎么样?

昨天,Kimi突然给我打了个电话,我这才发现自己被“灰度”了。 灰度测试的内容是Kimi的语音通话功能。 现在进入Kimi App,就能看到底部问答框旁边多了一个电话的图标,点击即可发起语音通话。

苹果研究者发现:无论是OpenAI GPT-4o和o1,还是Llama、Phi、Gemma和Mistral等开源模型,都未被发现任何形式推理的证据,而更像是复杂的模式匹配器。无独有偶,一项多位数乘法的研究也被抛出来,越来越多的证据证实:LLM不会推理!

英伟达开源了超强模型Nemotron-70B,后者一经发布就超越了GPT-4o和Claude 3.5 Sonnet,仅次于OpenAI o1!AI社区惊呼:新的开源王者又来了?业内直呼:用Llama 3.1训出小模型吊打GPT-4o,简直是神来之笔!

零一万物的最新模型,打榜赢了GPT-4o。

国产大模型首次在公开榜单上超过GPT-4o! 就在刚刚,“大模型六小强”之一的零一万物正式对外发布新旗舰模型——Yi-Lightning(闪电)。

o1 作为 OpenAI 在推理领域的最新模型,大幅度提升了 GPT-4o 在推理任务上的表现,甚至超过了平均人类水平。o1 背后的技术到底是什么?OpenAI 技术报告中所强调的强化学习和推断阶段的 Scaling Law 如何实现?

多模态大语言模型(MLLM)如今已是大势所趋。 过去的一年中,闭源阵营的GPT-4o、GPT-4V、Gemini-1.5和Claude-3.5等模型引领了时代。