GPT-4o模仿人类声音,诡异尖叫引OpenAI研究员恐慌!32页技术报告出炉

GPT-4o模仿人类声音,诡异尖叫引OpenAI研究员恐慌!32页技术报告出炉【新智元导读】五颗草莓到底指什么?盼了一天一夜,OpenAI只发来一份32页安全报告。报告揭露:在少数情况下,GPT-4o会模仿你的声音说话,或者忽然大叫起来……事情变得有趣了。

【新智元导读】五颗草莓到底指什么?盼了一天一夜,OpenAI只发来一份32页安全报告。报告揭露:在少数情况下,GPT-4o会模仿你的声音说话,或者忽然大叫起来……事情变得有趣了。

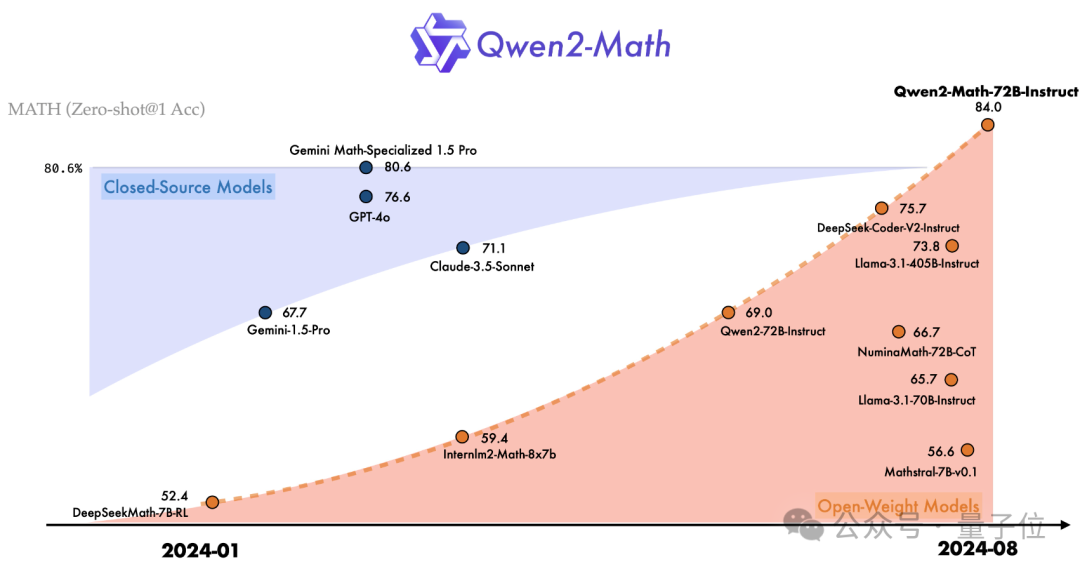

最强数学大模型,现在易主!

GPT-4o的怪癖暴露了,还是被官方公开的!

应广大用户需求,OpenAI终于发布重量级新功能。

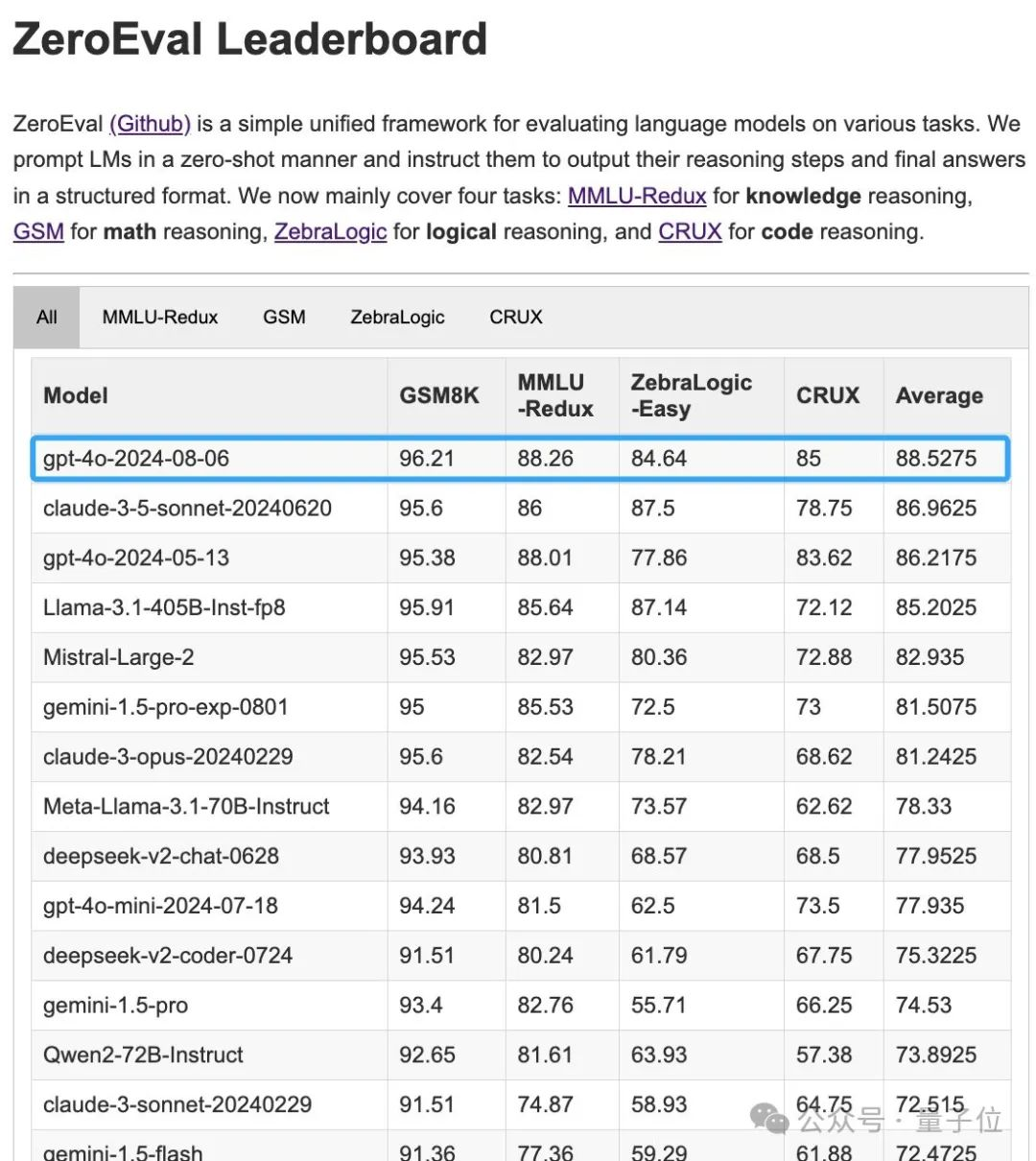

GPT-4o新版本突然上线,更强更便宜。

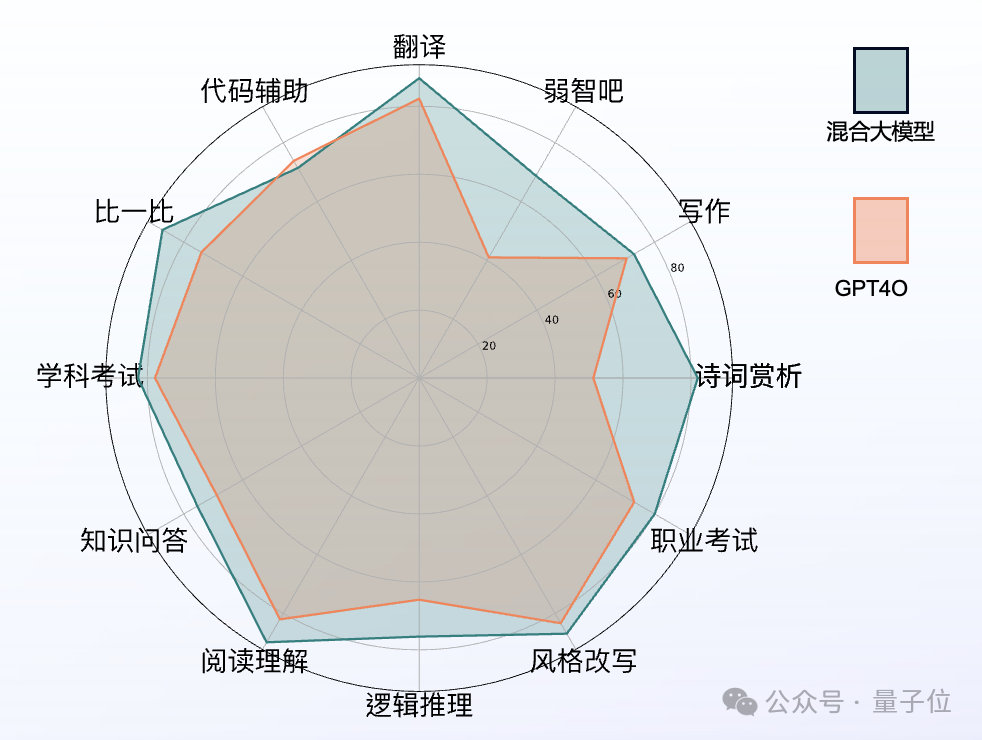

终于,国产大模型能在综合能力上也能与GPT-4o一决雌雄了。

靴子终于落地,OpenAI的AI搜索还是来了。7月26日,就在推出小模型GPT-4o mini的一周后,OpenAI方面公布了备受外界关注的搜索产品SearchGPT。尽管目前SearchGPT仅向10000名测试用户开放,但OpenAI CTO Mira Murati在社交平台已经透露,最终目标是将搜索功能直接整合到ChatGPT中。

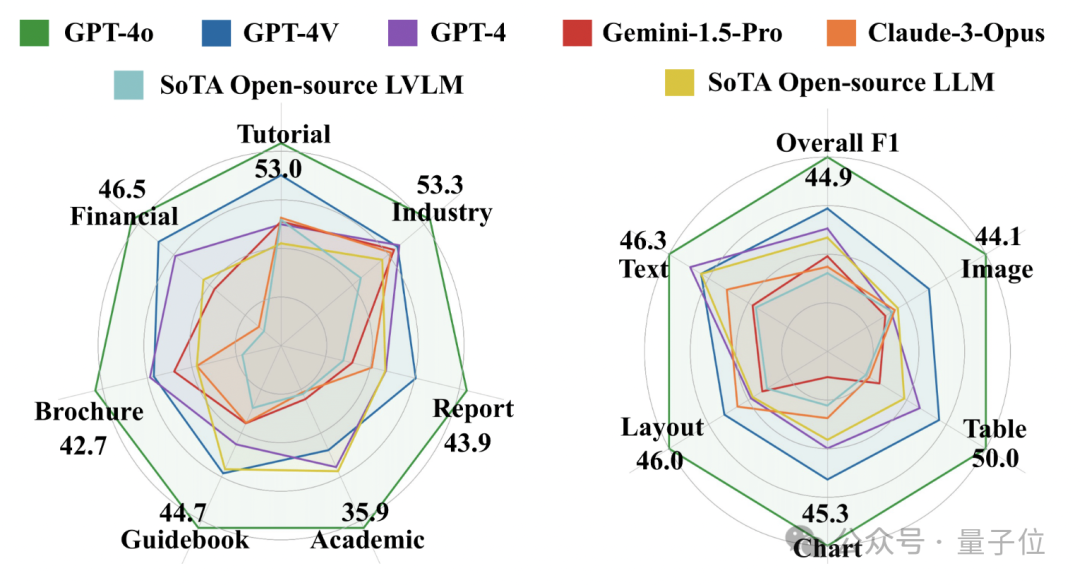

图文并茂的PDF长文档在日常生活中无处不在。过去人们通常使用OCR,layout detection等方法对PDF长文档进行解析。但随着多模态大模型的发展,PDF长文档的端到端阅读理解成为了可能。

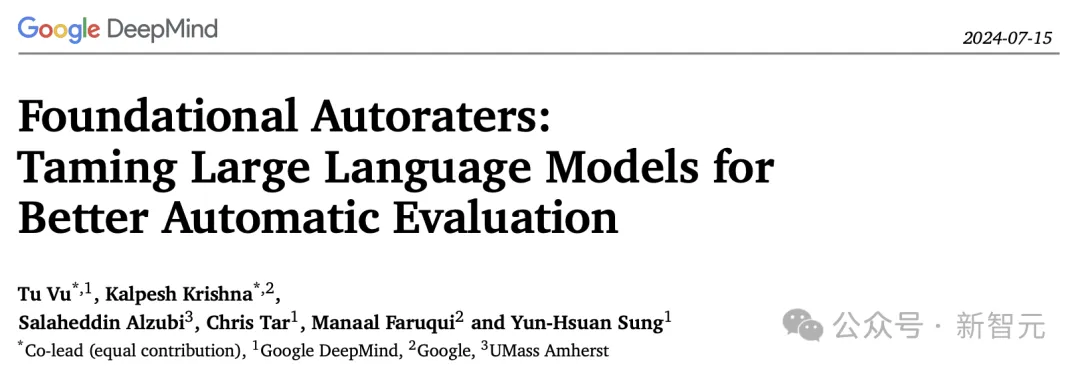

谷歌DeepMind推出LLM自动评估模型FLAMe系列,FLAMe-RM-24B模型在RewardBench上表现卓越,以87.8%准确率领先GPT-4o。

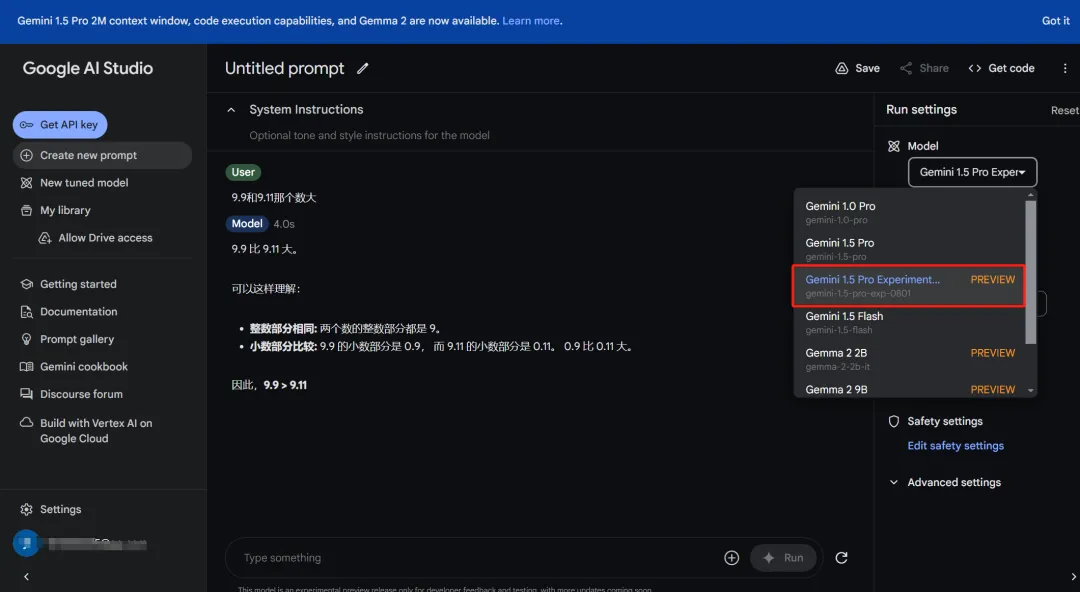

这么强的模型,谷歌给大家免费试用。