奥特曼专访自曝OpenAI掌握AGI密钥,2025年降临!1人1万块GPU缔造十亿独角兽

奥特曼专访自曝OpenAI掌握AGI密钥,2025年降临!1人1万块GPU缔造十亿独角兽AGI 2025年到来,ASI几千天内降临,奥特曼在最新专访中金句频出。不仅如此,他的话还得到了德扑之父、自家员工的证实。

AGI 2025年到来,ASI几千天内降临,奥特曼在最新专访中金句频出。不仅如此,他的话还得到了德扑之父、自家员工的证实。

智东西11月8日报道,生成式AI的发展或将加剧电子垃圾问题。

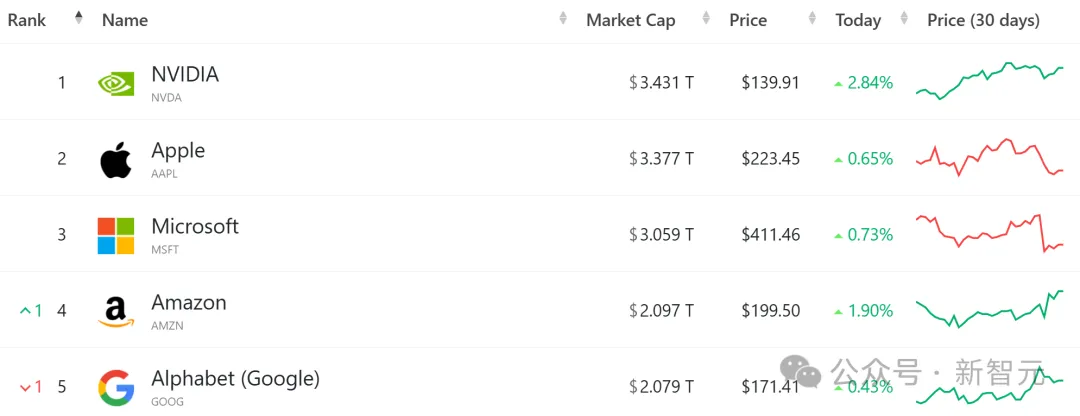

继6月短暂超越苹果市值后,英伟达再次超越苹果成为全球最高市值公司!

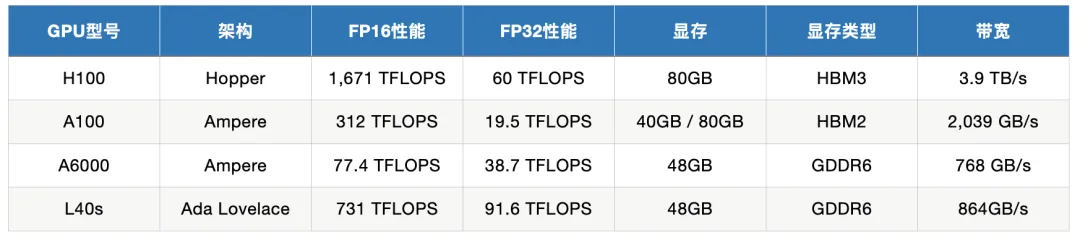

双十一大促没有羊毛可薅?A800价格低至5.88元/卡时,H800价格低至9.99元/卡时。限量开抢,先到先得!还有充值返现活动:充5000返900,充3000返500,充1000返150。

在人工智能(AI)领域,特别是深度学习和神经网络训练中,GPU(图形处理单元)已经成为不可或缺的硬件。但为什么AI对GPU的要求高,而不是CPU(中央处理单元)呢?让我们通过一个生动的比喻来揭开这个谜团。

通过深入分析这些 GPU 的性能指标,我们将探讨它们在模型训练和推理任务中的适用场景,以帮助用户在选择适合的 GPU 时做出明智的决策。同时,我们还会给出一些实际有哪些知名的公司或项目在使用这几款 GPU。

最近有一篇题为《2美元的H100:GPU泡沫是如何破灭的?》的文章异常火热,甚至投资人都认为英伟达坚挺的股价就是被这一篇文章所摧毁。

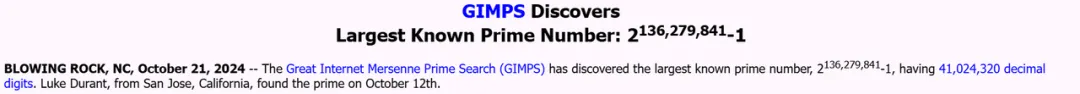

人类已知最大的素数,被GPU发现了!英伟达前员工Luke Durant发现的2136279841-1,比前一个纪录保持者多出1600万位,由A100计算,H100确认。为此,小哥搭了数千个GPU的「云超算」,分布在17个国家。

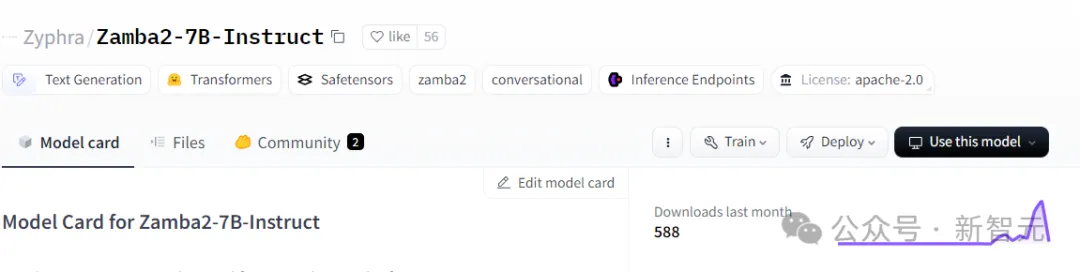

Zamba2-7B是一款小型语言模型,在保持输出质量的同时,通过创新架构实现了比同类模型更快的推理速度和更低的内存占用,在图像描述等任务上表现出色,能在各种边缘设备和消费级GPU上高效运行。

TL;DR:DuoAttention 通过将大语言模型的注意力头分为检索头(Retrieval Heads,需要完整 KV 缓存)和流式头(Streaming Heads,只需固定量 KV 缓存),大幅提升了长上下文推理的效率,显著减少内存消耗、同时提高解码(Decoding)和预填充(Pre-filling)速度,同时在长短上下文任务中保持了准确率。