Memory和RAG的区别在哪?用「上下文工程」做出个性化 AI(谷歌白皮书精读)

Memory和RAG的区别在哪?用「上下文工程」做出个性化 AI(谷歌白皮书精读)谷歌在第三天发布了《上下文工程:会话与记忆》(Context Engineering: Sessions & Memory) 白皮书。文中开篇指出,LLM模型本身是无状态的 (stateless)。如果要构建有状态的(stateful)和个性化的 AI,关键在于上下文工程。

搜索

搜索

谷歌在第三天发布了《上下文工程:会话与记忆》(Context Engineering: Sessions & Memory) 白皮书。文中开篇指出,LLM模型本身是无状态的 (stateless)。如果要构建有状态的(stateful)和个性化的 AI,关键在于上下文工程。

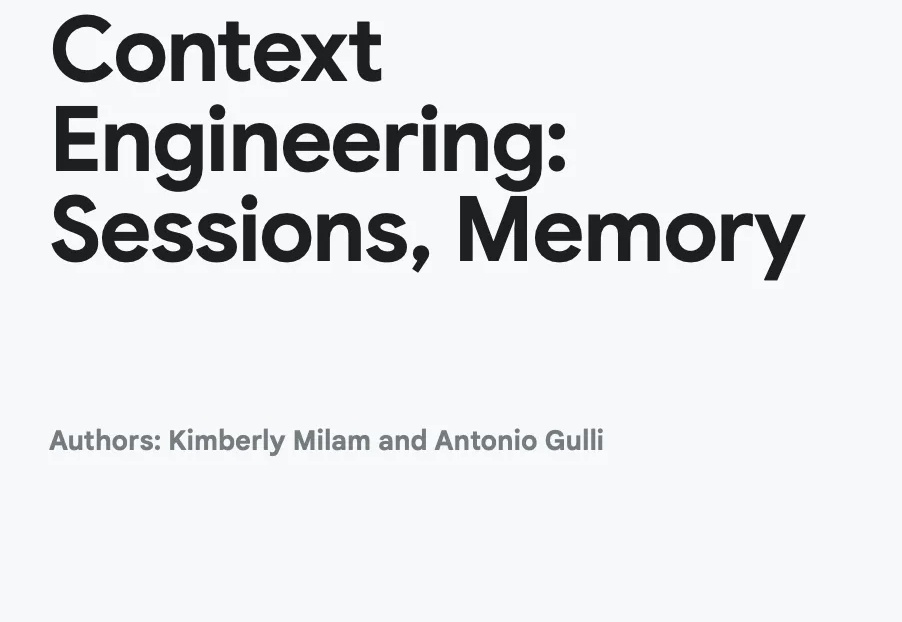

独立研究者 Jianli Zhao 等人近日的一项新研究发现,通过在有害请求前填充一长串无害的解谜推理序列(harmless puzzle reasoning),就能成功对推理模型实现越狱攻击。他们将这种方法命名为思维链劫持(Chain-of-Thought Hijacking)。

在这个新访谈中,Sutton 与多位专家一起,进一步探讨 AI 研究领域存在的具体问题。

Lessie 的定位简单直接:People Search AI Agent。一句话描述它的能力:帮你从互联网与数据库里快速找到任何人,并自动化完成初步联络。创始人、投资人、KOL、潜在客户、行业专家、合作伙伴……只要你能用自然语言描述需求,Lessie 就能迅速在全球范围内挖掘到合适的人选。

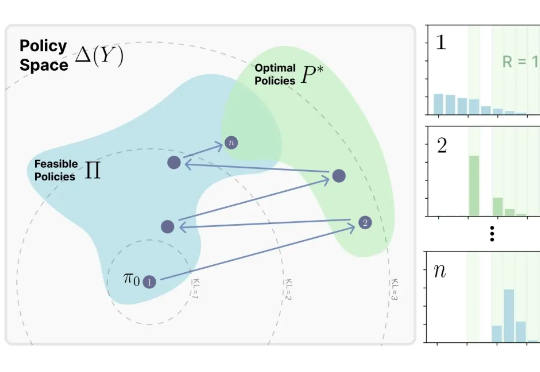

来自MIT Improbable AI Lab的研究者们最近发表了一篇题为《RL's Razor: Why Online Reinforcement Learning Forgets Less》的论文,系统性地回答了这个问题,他们不仅通过大量实验证实了这一现象,更进一步提出了一个简洁而深刻的解释,并将其命名为 “RL's Razor”(RL的剃刀)。

如果你正在做出海业务,无论是做跨境电商、独立站,还是SaaS软件,你一定逃不开一个核心问题:如何低成本地获取海外精准流量?

Legora从观察律师朋友被"thankless tasks"拖累的痛苦中诞生,通过"真正合作伙伴"而非单纯工具的协作理念,解决了传统法律研究低效问题——AI可为律师每周节省4小时、年增10万美元计费时间,目前已服务250家顶级律所实现数据室审查从数周压缩至数小时。

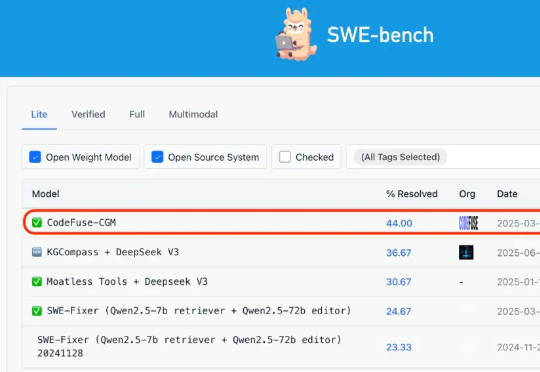

Agentless+开源模型,也能高质量完成仓库级代码修复任务,效果媲美业界 SOTA 。

AI 搜索 Agent 产品 Genspark 近期被 Anthropic 官方点名了。「Less structure, more intelligence.」是 AI 搜索 Agent 产品 Genspark 一直以来坚持的基本原则。Genspark 团队认为,过度结构化的工作流程会限制创造力和深度,赋予专业 Agent 更多自主权,自由选择并灵活运用多种工具来处理问题,反而能释放出更强的能力。

这篇文章不只是关于 Coding Agent 的使用体验,也包括对相关关键技术,例如语言搜索、MCP 的探索和理解。Coding Agent 结合 MCP 是一种值得探索的新的自动化方式。