瑞士信息与通信科技公司Lakera为生成式AI开发安全解决方案,保护AI应用程序安全 | 瑞士创新100强

瑞士信息与通信科技公司Lakera为生成式AI开发安全解决方案,保护AI应用程序安全 | 瑞士创新100强瑞士信息与通信科技公司Lakera成立于2021年,该公司为生成式AI应用程序开发的安全工具拥有专有的威胁情报数据库,可防御对大型语言模型(LLM)的各类攻击并对AI应用程序进行压力测试检测漏洞,为AI应用程序提供企业级的安全保护。

搜索

搜索

瑞士信息与通信科技公司Lakera成立于2021年,该公司为生成式AI应用程序开发的安全工具拥有专有的威胁情报数据库,可防御对大型语言模型(LLM)的各类攻击并对AI应用程序进行压力测试检测漏洞,为AI应用程序提供企业级的安全保护。

AI训AI必将成为一大趋势。Meta和NYU团队提出让大模型「自我奖励」的方法,让Llama2一举击败GPT-4 0613、Claude 2、Gemini Pro领先模型。

IPA 已经成了现代智能手机不可或缺的标配,近期的一篇综述论文更是认为「个人 LLM 智能体会成为 AI 时代个人计算的主要软件范式」。

自 ChatGPT 等大型语言模型推出以来,为了提升模型效果,各种指令微调方法陆续被提出。本文中,普林斯顿博士生、陈丹琦学生高天宇汇总了指令微调领域的进展,包括数据、算法和评估等。

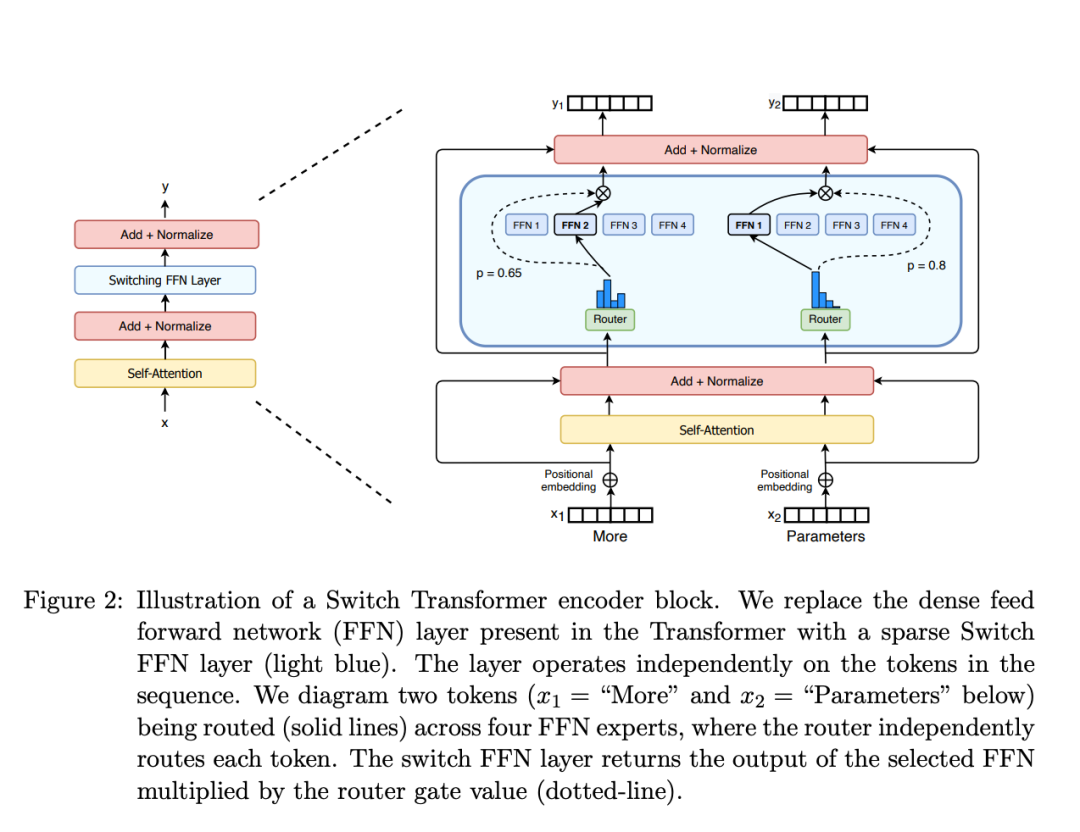

本文将介绍 MoE 的构建模块、训练方法以及在使用它们进行推理时需要考虑的权衡因素。

多模态大模型GPT-4V也会「有眼无珠」。UC San Diego纽约大学研究人员提出全新V*视觉搜索算法逆转LLM弱视觉宿命。

对模型参数量的迷信、执念也许可以放下了,混合多个小模型也是未来构造对话型 AI 的一个光明的方向。

来自纽约大学和UC伯克利的研究团队成功捕捉到了多模态大模型在视觉理解方面存在的重大缺陷。针对这个问题,他们进一步提出了一个将DINOv2特征与CLIP特征结合的方法,有效地提升了多模态大模型的视觉功能。

在 AI 应用的路线上,有赞和 Monica.im(简称 Monica)是两种截然不同的代表。

没想到啊,开源大模型家族里,居然挤进来一位特别的选手:来自央企,身份为运营商。