AI大瓜!字节豆包LLM负责人婚内出轨同组HRBP

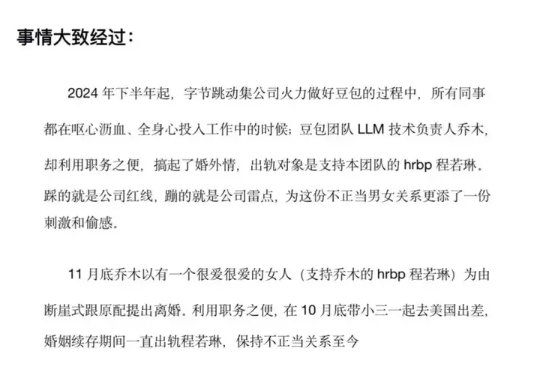

AI大瓜!字节豆包LLM负责人婚内出轨同组HRBP今天字节暴了一个八卦,豆包LLM技术负责人乔某婚内出轨HRBP程某某,还不给原配自己亲女儿抚养费。据说乔某已经结婚11年了,2014年进入字节,有两个女儿,而程之前还和乔下属谈过恋爱,也知道他有妻子,知三当三啊,有人还说乔还公款带着程一起去美国出差。

搜索

搜索

今天字节暴了一个八卦,豆包LLM技术负责人乔某婚内出轨HRBP程某某,还不给原配自己亲女儿抚养费。据说乔某已经结婚11年了,2014年进入字节,有两个女儿,而程之前还和乔下属谈过恋爱,也知道他有妻子,知三当三啊,有人还说乔还公款带着程一起去美国出差。

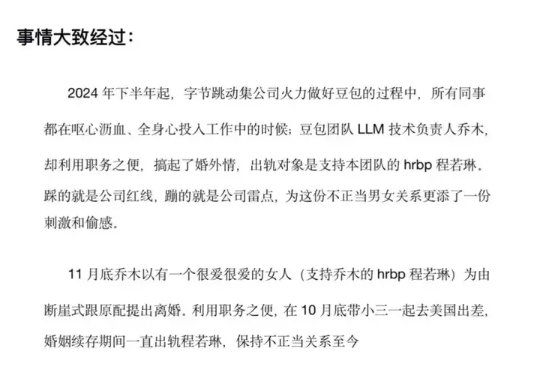

在拾象团队的 2025 的 AI 关键预测中,我们提到:随着 Agent 时代到来,OS 才是 LLM 厂商们最高的护城河,从 computer use 到 MCP,Anthropic 构建 OS 的决心是 AI labs 中最强、最明显的。

AI界「智商大考」ARC-AGI-2重磅出炉了!一个人类用5分钟轻松解开的谜题,却让最顶尖LLM全线崩盘得分挂零,o3更是从曾经76%暴跌至4%。它正式宣告,人类还未实现AGI。

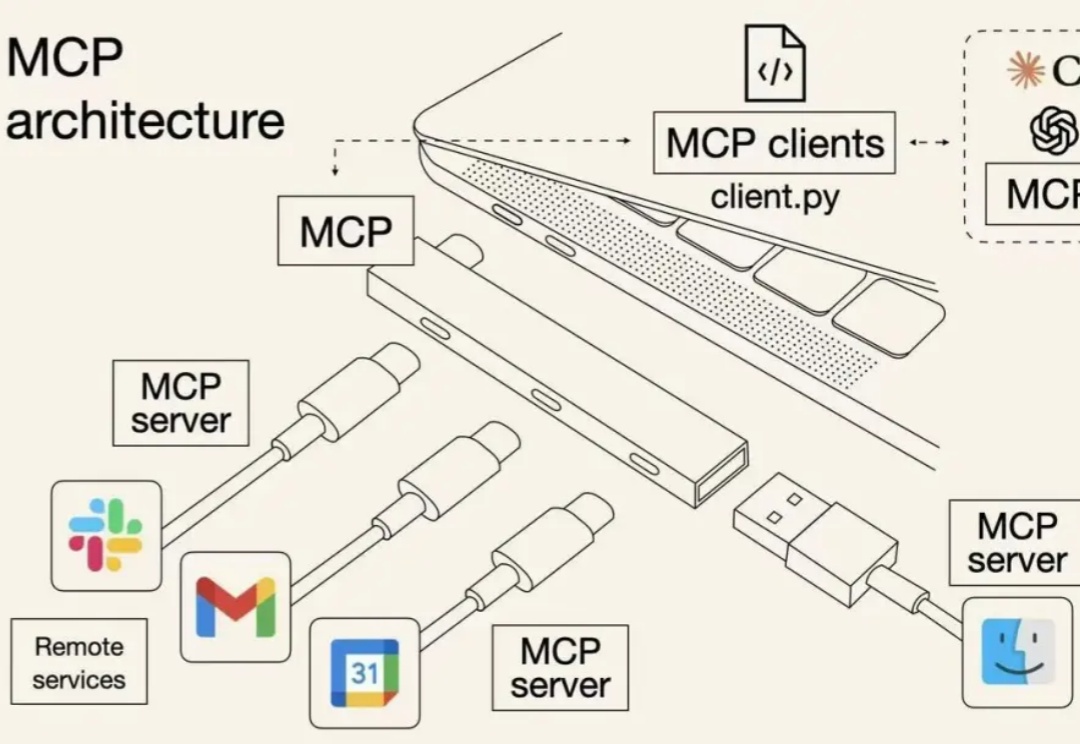

本文基于一项系统性研究《A Survey on the Optimization of Large Language Model-based Agents》,该研究由华东师大和东华大学多位人工智能领域的研究者共同完成。研究团队通过对大量相关文献的分析,构建了一个全面的LLM智能体优化框架,涵盖了从理论基础到实际应用的各个方面。您有兴趣可以找来读一下这篇综述。

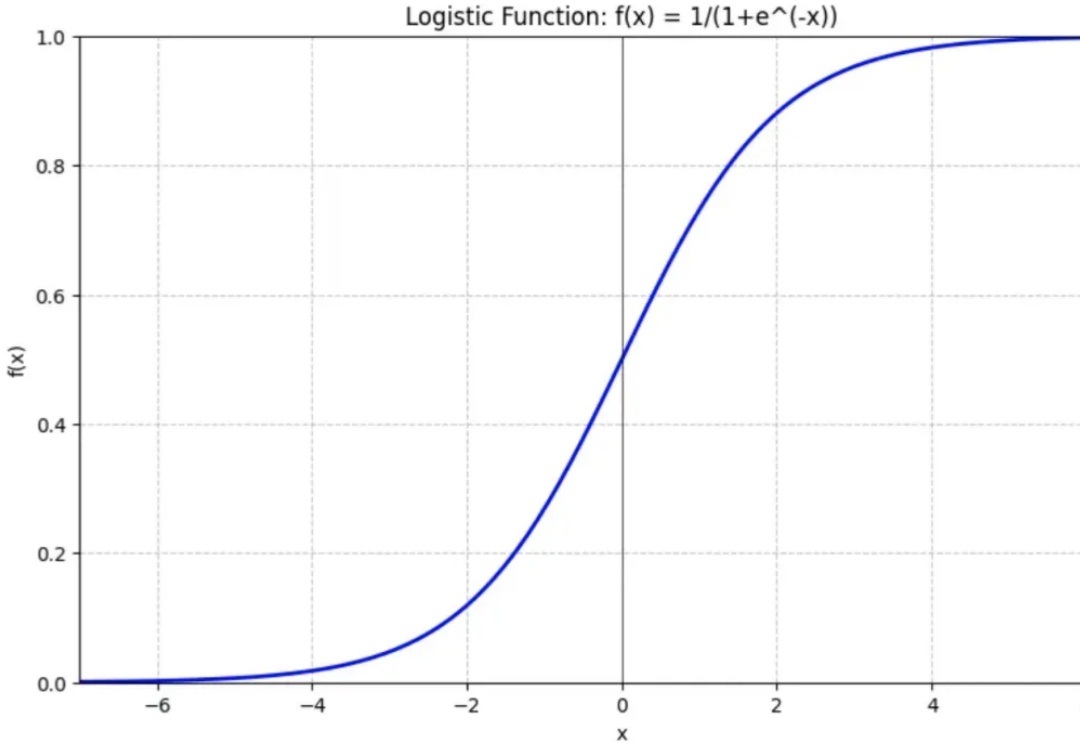

LLM本质上是一个基于概率输出的神经网络模型。但这里的“概率”来自哪里?今天我们就来说说语言模型中一个重要的角色:Softmax函数。(相信我,本文真的只需要初等函数知识)

块离散去噪扩散语言模型(BD3-LMs)结合自回归模型和扩散模型的优势,解决了现有扩散模型生成长度受限、推理效率低和生成质量低的问题。通过块状扩散实现任意长度生成,利用键值缓存提升效率,并通过优化噪声调度降低训练方差,达到扩散模型中最高的预测准确性,同时生成效率和质量优于其他扩散模型。

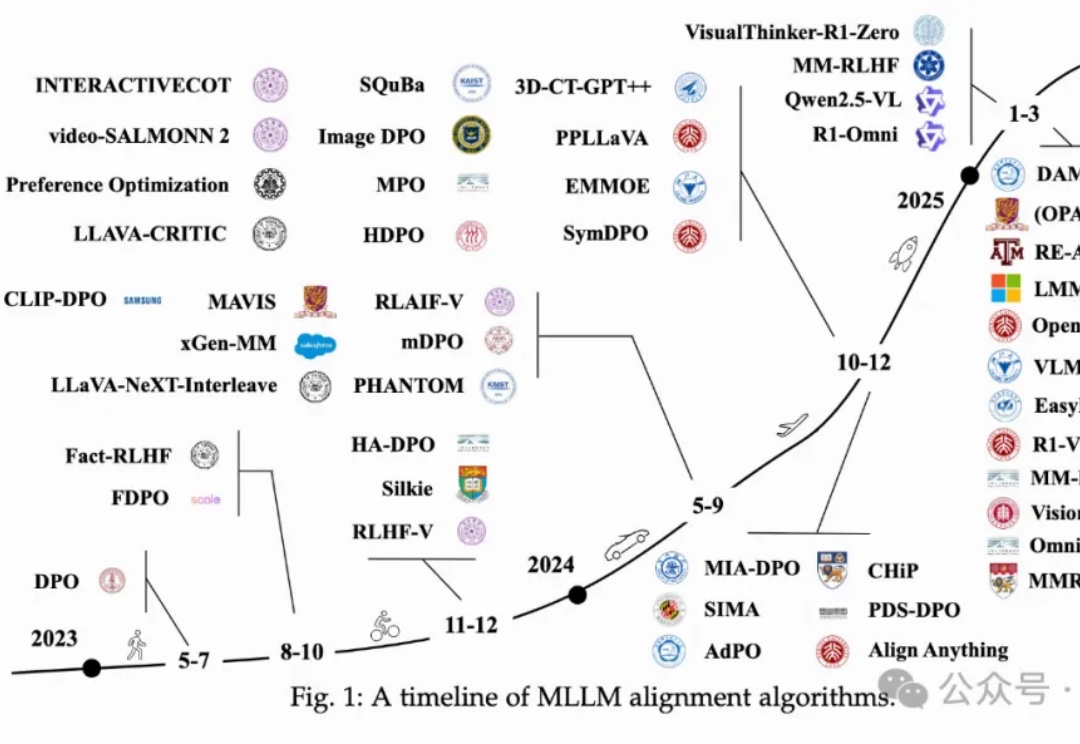

万字长文,对多模态LLM中对齐算法进行全面系统性回顾!

华人学者、斯坦福大学副教授 James Zou 领导的团队提出了 TextGrad ,通过文本自动化“微分”反向传播大语言模型(LLM)文本反馈来优化 AI 系统。只需几行代码,你就可以自动将用于分类数据的“逐步推理”提示转换为一个更复杂的、针对特定应用的提示。

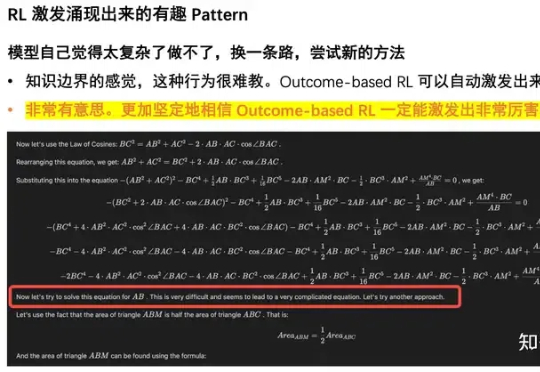

清华智能产业研究院(AIR)博三在读,去年六月份,出于对语言模型 LLM 的强烈兴趣,加入了字节 as Top Seed Intern,在人工智能的最前沿进行探索。刚好这个话题和我现在做的工作强相关,我分享一下自己的观点和亲身体验。

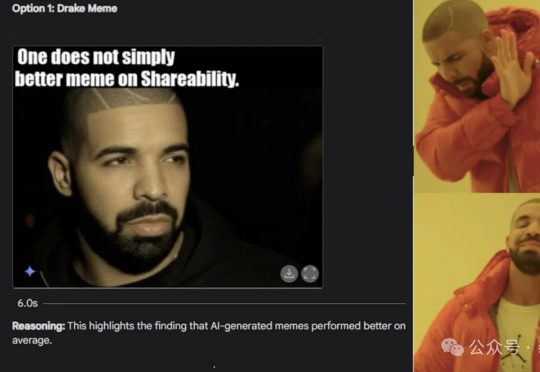

研究发现,LLM在创作梗图时表现出惊人的幽默感与创造力,甚至超越了人类创作者!AI创作的梗图评分更高,但最具灵魂的作品仍来自人类。