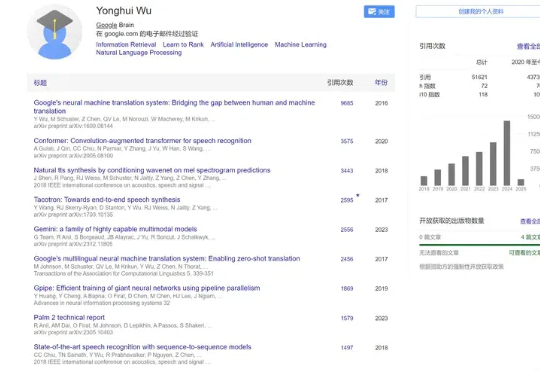

字节调整AI部门Seed,刚从Gemini加盟的吴永辉成新负责人

字节调整AI部门Seed,刚从Gemini加盟的吴永辉成新负责人多位接近字节的人士对硅星人透露,字节的AI核心部门Seed正在快速调整定位和调兵遣将。刚刚从谷歌加入字节跳动的AI大牛、参与了Gemini开发的Google Fellow吴永辉博士,将成为Seed新的负责人,替换原LLM团队及Seed总负责人朱文佳,团队内部正在梳理调整汇报关系。

搜索

搜索

多位接近字节的人士对硅星人透露,字节的AI核心部门Seed正在快速调整定位和调兵遣将。刚刚从谷歌加入字节跳动的AI大牛、参与了Gemini开发的Google Fellow吴永辉博士,将成为Seed新的负责人,替换原LLM团队及Seed总负责人朱文佳,团队内部正在梳理调整汇报关系。

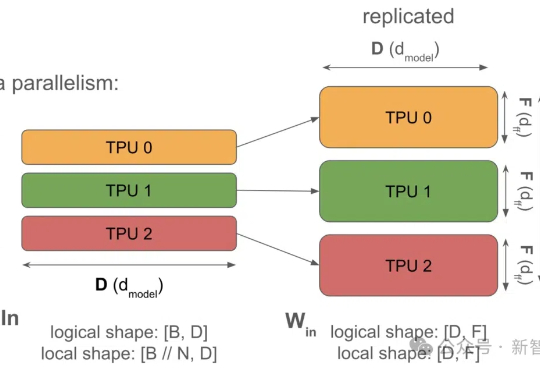

谷歌团队发布LLM硬核技术教科书,从「系统视图」揭秘LLM Scaling的神秘面纱。Jeff Dean强调书中藏着谷歌最强AI模型Gemini训练的更多信息。

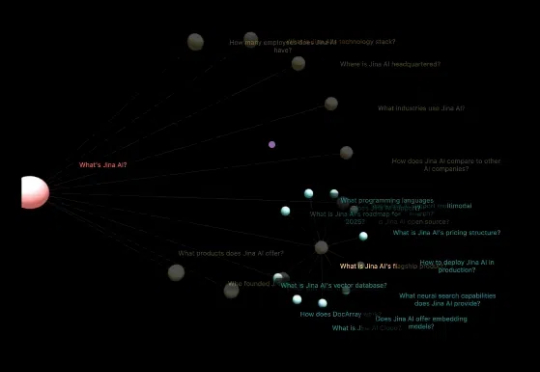

最初,查询扩展是为那些靠关键词匹配来判断相关性的搜索系统设计的,比如 tf-idf 或其他稀疏向量方案。这类方法有些天然的缺陷:词语稍微变个形式,像 "ran" 和 "running",或者 "optimise" 和 "optimize",都会影响匹配结果。虽然可以用语言预处理来解决一部分问题,但远远不够。技术术语、同义词和相关词就更难处理了。

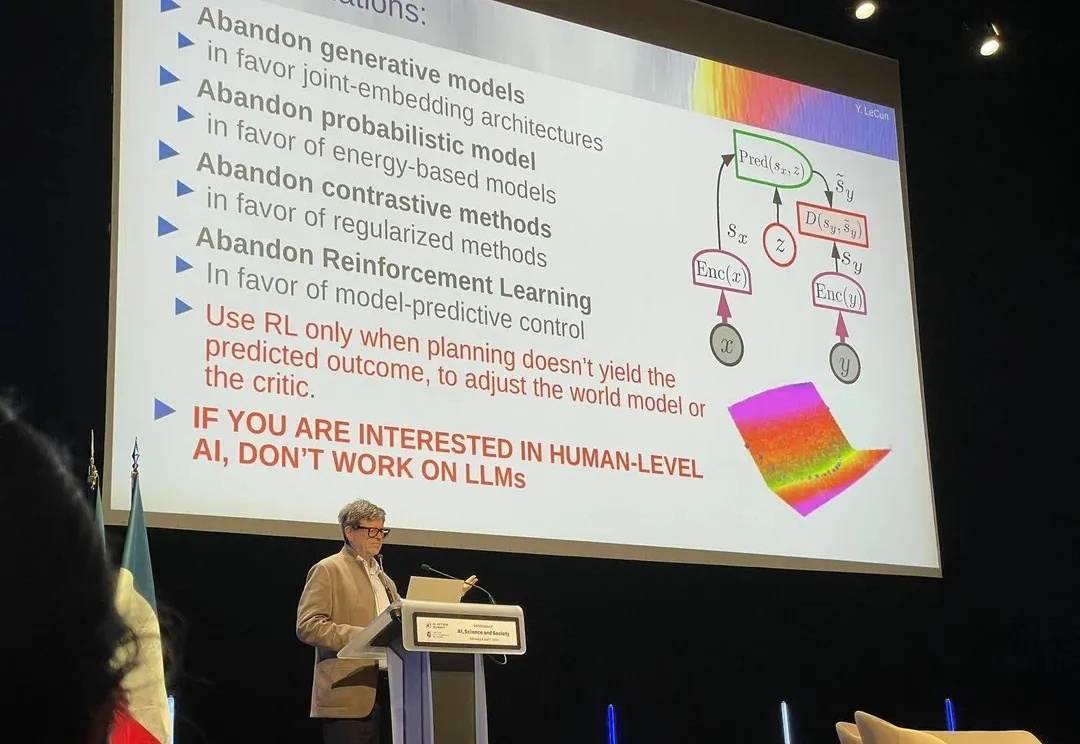

在当今的 AI 领域,图灵奖得主 Yann LeCun 算是一个另类。即便眼见着自回归 LLM 的能力越来越强大,能解决的任务也越来越多,他也依然坚持自己的看法:自回归 LLM 没有光明的未来。

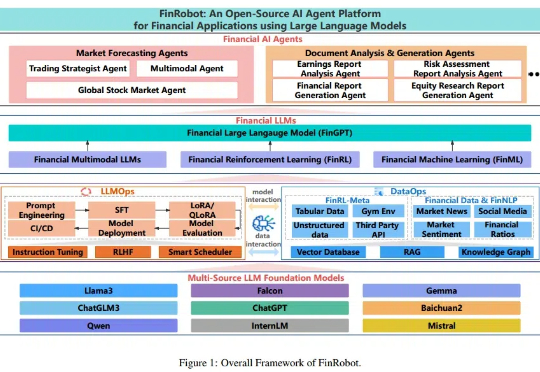

随着金融机构和专业人士越来越多地将大语言模型(LLMs)纳入其工作流程中,金融领域与人工智能社区之间依然存在显著障碍,包括专有数据和专业知识的壁垒。本文提出了 FinRobot,一种支持多个金融专业化人工智能智能体的新型开源 AI 智能体平台,每个代理均由 LLM 提供动力。

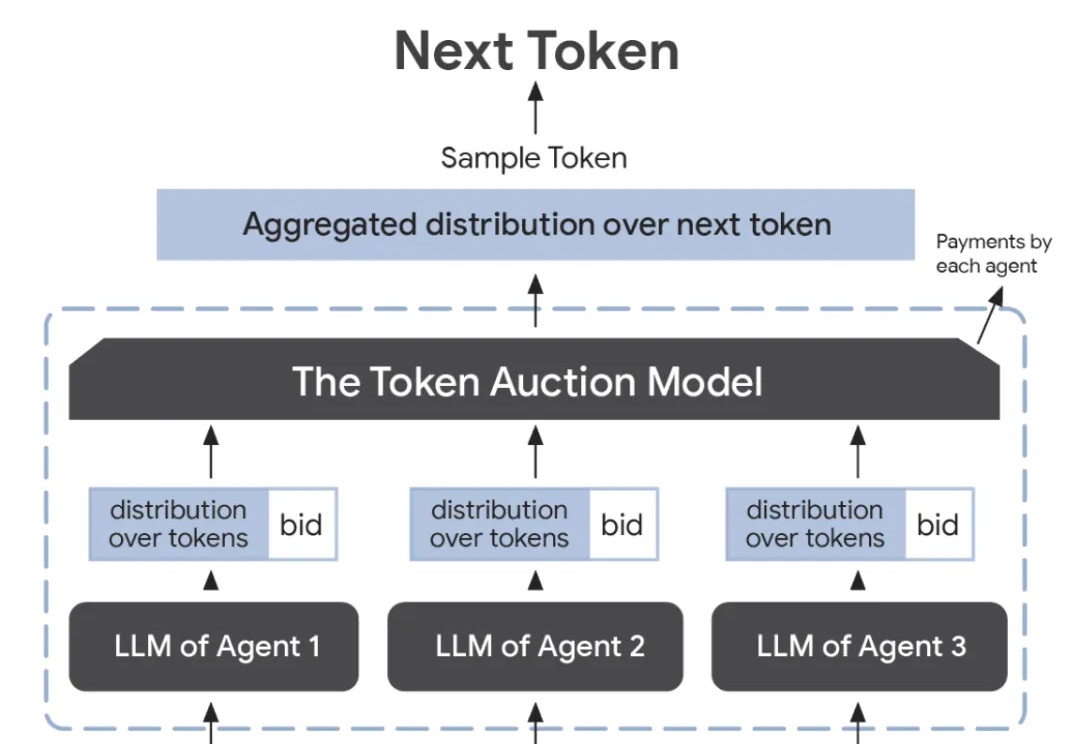

谷歌研究人员提出了一种创新的token拍卖模型,通过「竞拍」的方式,让智能体在文本生成过程中进行出价,确保最终输出能满足各方利益,实现最佳效果。这一机制优化了广告、内容创作等领域的协作。

DeepSeek团队最新力作一上线,就获得Ai2研究所大牛推荐,和DeepSeek铁粉们的热情研读!他们提出的CodeI/O全新方法,通过代码提取了LLM推理模式,在逻辑、数学等推理任务上得到显著改进。

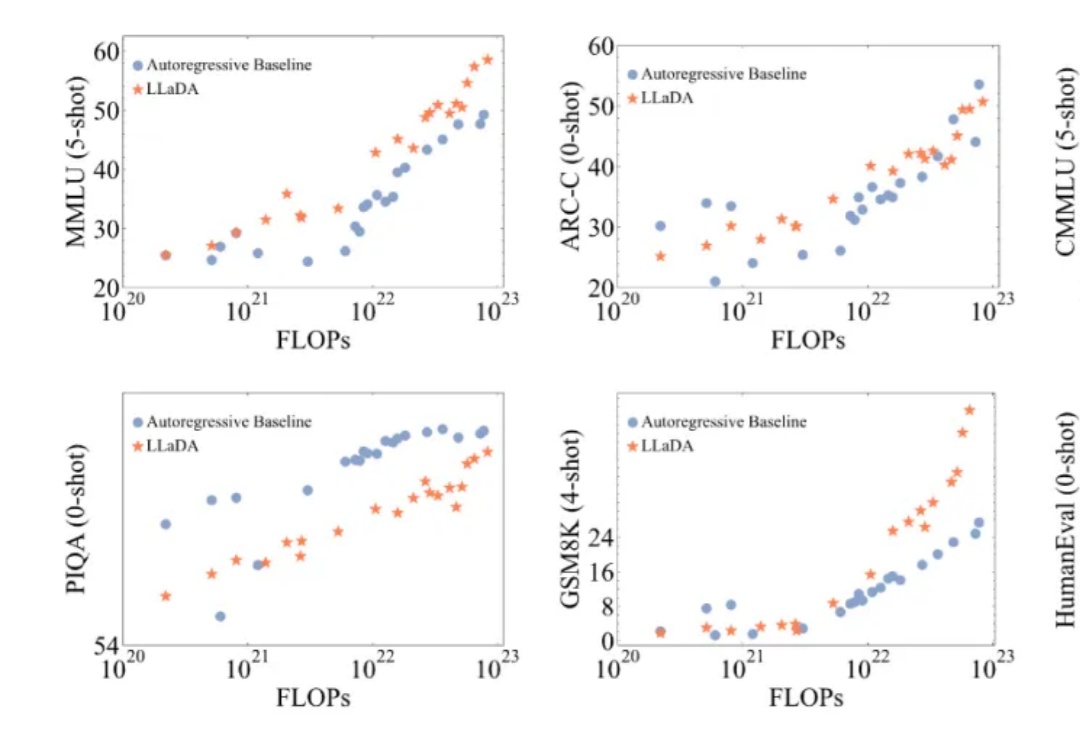

近年来,大语言模型(LLMs)取得了突破性进展,展现了诸如上下文学习、指令遵循、推理和多轮对话等能力。目前,普遍的观点认为其成功依赖于自回归模型的「next token prediction」范式。

中国初创企业DeepSeek(深度求索)开发的高性能、低成本生成式AI(人工智能)大规模语言模型(LLM)受到了全世界的关注。日本经济新闻(中文版:日经中文网)就如何评价该公司的最新AI模型、安全性方面的风险、以及对日本企业的影响等问题,采访了日本AI研究领域的第一人、东京大学教授松尾丰。

近年来,多模态大模型(MLLM)在视觉理解领域突飞猛进,但如何让大语言模型(LLM)低成本掌握视觉生成能力仍是业界难题!