ICLR 2025 Spotlight | 参数高效微调新范式!上海交大联合上海AI Lab推出参数冗余微调算法

ICLR 2025 Spotlight | 参数高效微调新范式!上海交大联合上海AI Lab推出参数冗余微调算法低秩适配器(LoRA)能够在有监督微调中以约 5% 的可训练参数实现全参数微调 90% 性能。

低秩适配器(LoRA)能够在有监督微调中以约 5% 的可训练参数实现全参数微调 90% 性能。

3月31日,AI制药公司Isomorphic Labs宣布在第一次外部融资中筹集了6亿美元,由Thrive Capital领投,GV参投,现有投资者谷歌母公司Alphabet跟投。Isomorphic Labs成立于2021年,创始人兼CEO为2024年诺贝尔化学奖得主Demis Hassabis,其使命是运用AI治疗所有疾病。

近一年以来,AI 视频生成技术发展迅猛。自 2024 年初 Sora 问世后,大家惊喜地发现:原来 AI 可以生成如此逼真的视频,一时间各大高校实验室、互联网巨头 AI Lab 以及创业公司纷纷入局视频生成领域。

得叻,现在机器人公司的发布会,都由人形机器人自己主持了。

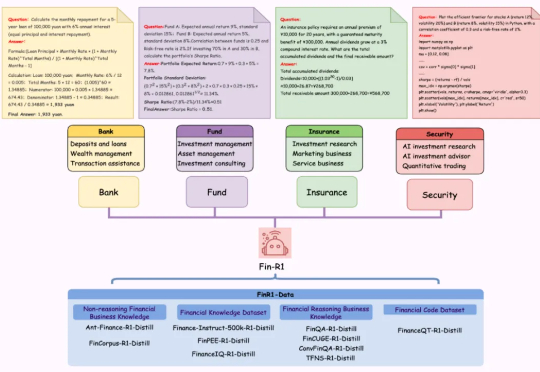

近日,上海财经大学统计与数据科学学院张立文教授与其领衔的金融大语言模型课题组(SUFE-AIFLM-Lab)联合数据科学和统计研究院、财跃星辰、滴水湖高级金融学院正式发布首款 DeepSeek-R1 类推理型人工智能金融大模型:Fin-R1,以仅 7B 的轻量化参数规模展现出卓越性能,全面超越参评的同规模模型并以 75 的平均得

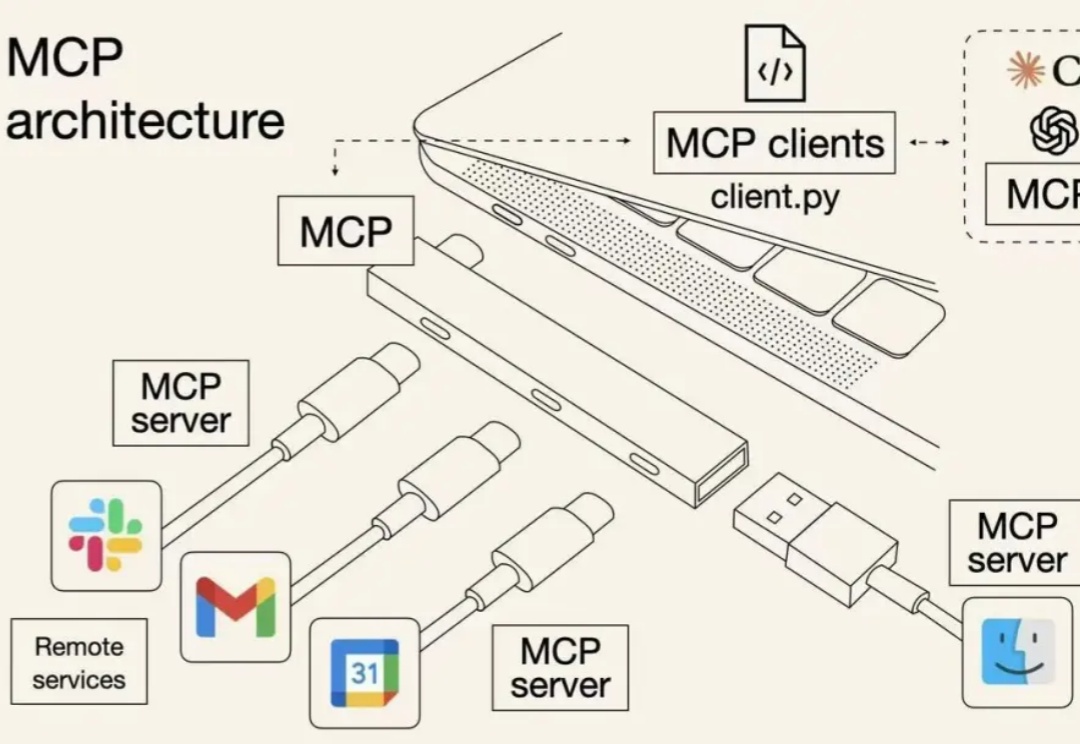

在拾象团队的 2025 的 AI 关键预测中,我们提到:随着 Agent 时代到来,OS 才是 LLM 厂商们最高的护城河,从 computer use 到 MCP,Anthropic 构建 OS 的决心是 AI labs 中最强、最明显的。

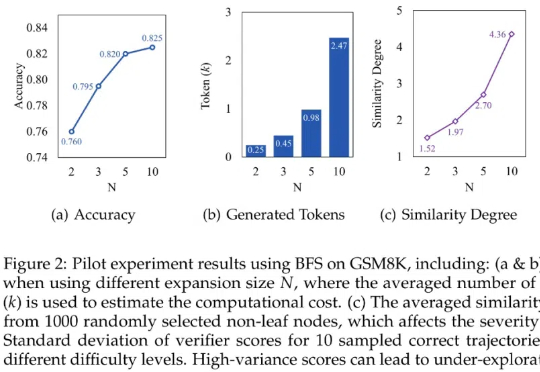

本文探讨基于树搜索的大语言模型推理过程中存在的「过思考」与「欠思考」问题,并提出高效树搜索框架——Fetch。本研究由腾讯 AI Lab 与厦门大学、苏州大学研究团队合作完成。

一个超越DeepSeek GRPO的关键RL算法出现了!这个算法名为DAPO,字节、清华AIR联合实验室SIA Lab出品,现已开源。禹棋赢,01年生,本科毕业于哈工大,直博进入清华AIR,目前博士三年级在读。去年年中,他以研究实习生的身份加入字节首次推出的「Top Seed人才计划」。

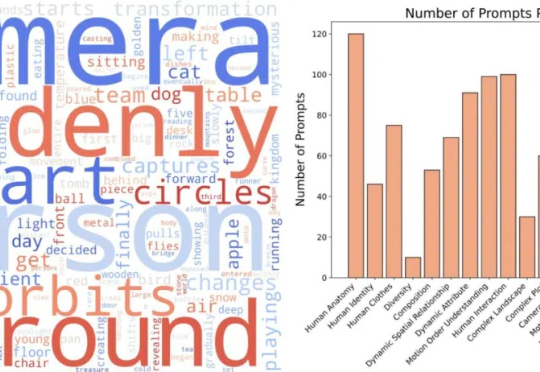

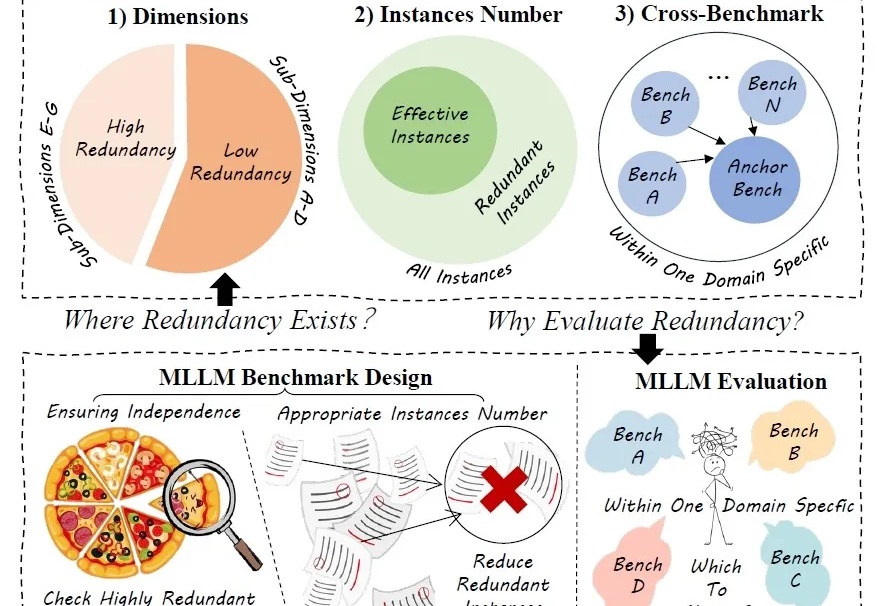

评估多模态AI模型的那些复杂测试,可能有一半都是“重复劳动”!

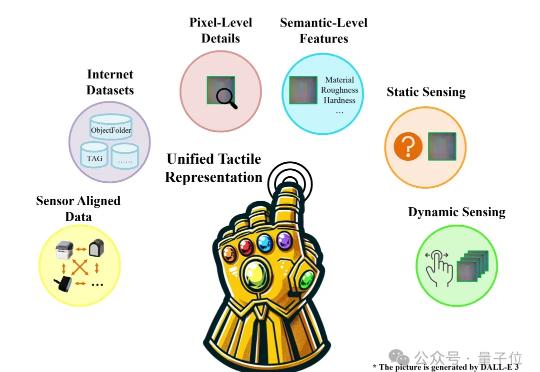

机器人怎样感知世界?