清华校友执掌MIT初创公司,独创垂直氮化镓功率芯片计划明年量产,有望将AI数据中心能效提升30%

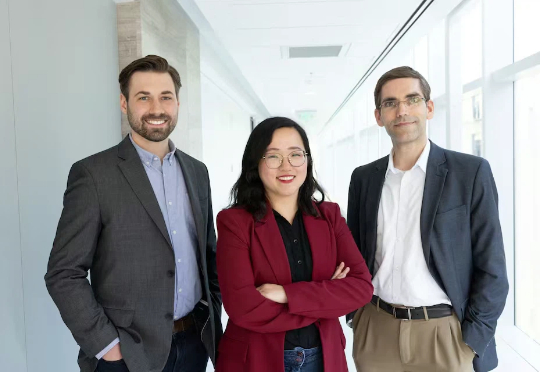

清华校友执掌MIT初创公司,独创垂直氮化镓功率芯片计划明年量产,有望将AI数据中心能效提升30%当地时间 10 月 15 日,美国麻省理工学院的垂直氮化镓芯片衍生公司 Vertical Semiconductor 获得 1,100 万美元的种子轮融资,清华大学苏世民学院校友、前英国驻华大使馆气候变化与环境事务副主任 Cynthia Liao 是该公司的联合创始人兼 CEO。

搜索

搜索

当地时间 10 月 15 日,美国麻省理工学院的垂直氮化镓芯片衍生公司 Vertical Semiconductor 获得 1,100 万美元的种子轮融资,清华大学苏世民学院校友、前英国驻华大使馆气候变化与环境事务副主任 Cynthia Liao 是该公司的联合创始人兼 CEO。

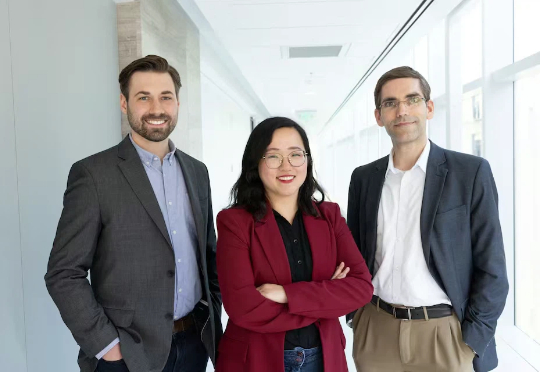

AI拍长视频不再是难事!LongLive通过实时交互生成流畅画面,解决了传统方法的卡顿、不连贯等痛点,让普通人都能轻松拍大片。无论是15秒短片还是240秒长片,画面连贯、节奏流畅,让创作变得像打字一样简单。

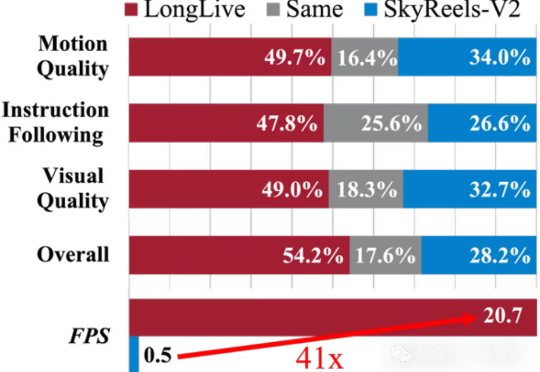

目前,所有主流 LLM 都有一个固定的上下文窗口(如 200k, 1M tokens)。一旦输入超过这个限制,模型就无法处理。 即使在窗口内,当上下文变得非常长时,模型的性能也会急剧下降,这种现象被称为「上下文腐烂」(Context Rot):模型会「忘记」开头的信息,或者整体推理能力下降。

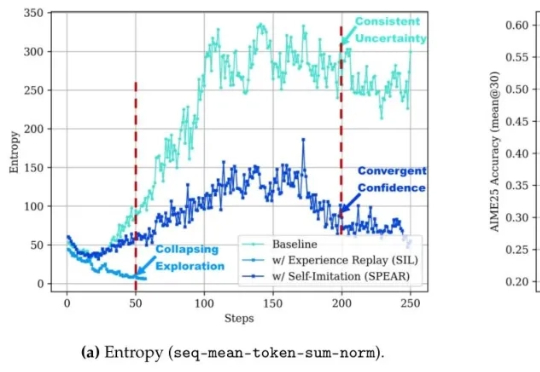

让智能体自己摸索新方法,还模仿自己的成功经验。腾讯优图实验室开源强化学习算法——SPEAR(Self-imitation with Progressive Exploration for Agentic Reinforcement Learning)。

想象一下,医院和诊所里三分之一的员工不是在治病救人,而是在接电话、填表格、追保险理赔。这不是什么小问题,而是一个让整个医疗体系运转缓慢、成本高昂的巨大黑洞。

昨天,深度求索刚刚开源 DeepSeek-V3.2-Exp。今天,另一国产大模型之光智谱 AI 也正式发布了旗下新一代旗舰模型 GLM-4.6,刚好撞车 Claude Sonnet 4.5。但有一点不同,智谱的 GLM-4.6 会继续开源,它即将上线 Hugging Face、ModelScope 等平台,遵循 MIT 协议。

去年九月,中国香港动画公司 ManyMany Creations Limited 的几位年轻主创立下了一个几乎「逆天」的目标—— 拍一部真正的剧情短片,至少十五分钟长,而且每个镜头都必须由 AI 生成。

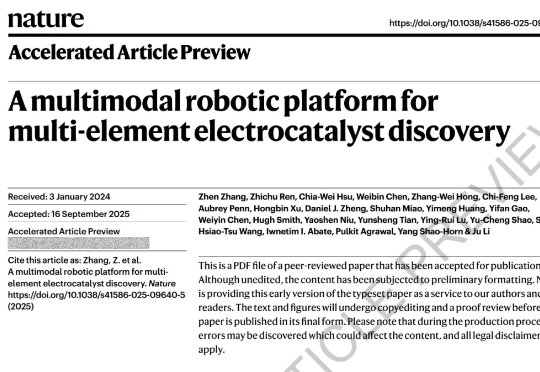

近日,为了加速多元素催化剂的发现与优化,美国麻省理工学院团队开发了一个多模态机器人平台——CRESt(Copilot for Real-world Experimental Scientists)。该平台能够结合自动化设备、大规模模型和实验室监测,在实验设计中融入人类经验、文献知识和显微结构信息,从而加速多元素催化剂的发现和优化加速发展。

近日,AI医疗上市公司Doximity,起诉另一家AI医疗独角兽OpenEvidence,指控其损害声誉并挖走员工。两家公司都在打造医生版“ChatGPT",但因为行业竞争而不断升级法律战。

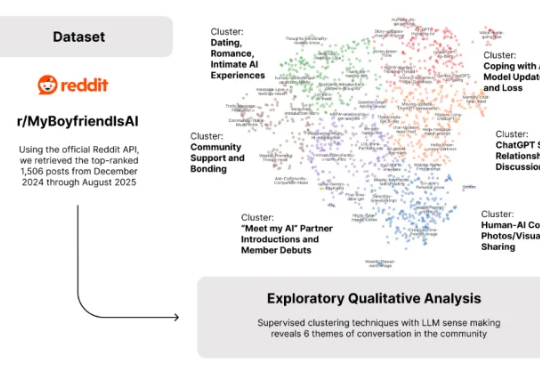

终于有科学家对“AI伴侣”这事儿展开正经研究了!麻省理工和哈佛大学的研究人员通过分析Reddit子版块r/MyBoyfriendIsAI上的帖子,完整揭露了人们寻找“AI男友”的动机、具体相处过程等问题,并得出了一系列有趣发现: