OpenAI称有DeepSeek「偷窃」证据?美军已发起攻击!Anthropic CEO喊话加强芯片管制

OpenAI称有DeepSeek「偷窃」证据?美军已发起攻击!Anthropic CEO喊话加强芯片管制他们急了!特朗普的AI沙皇和微软纷纷指控DeepSeek「偷窃」数据,DeepSeek不断遭受来自美国IP的不间断大规模攻击。Anthropic CEO更是发出檄文:再不加强对中国的芯片管制,就来不及了!

他们急了!特朗普的AI沙皇和微软纷纷指控DeepSeek「偷窃」数据,DeepSeek不断遭受来自美国IP的不间断大规模攻击。Anthropic CEO更是发出檄文:再不加强对中国的芯片管制,就来不及了!

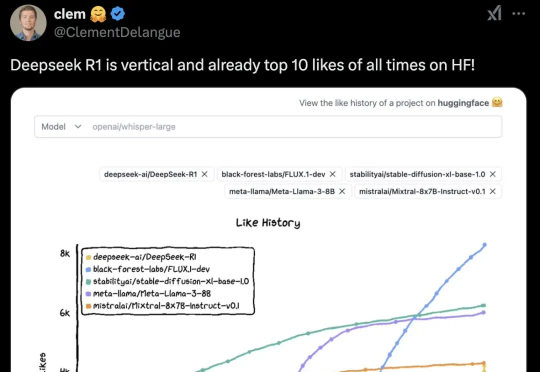

这个春节,国产AI引发全球轰动,一家叫做DeepSeek的初创科技公司发布了一款推理模型,不仅能力不输OpenAI的o1,训练成本也远低于国外,各行各业更是跟风尝试。1月27日,DeepSeek超过ChatGPT,成为苹果商店美国区免费应用榜单第一,也登顶中国区免费榜,由于用户突然涌入太多,还出现了短暂宕机。

梁文锋带领着DeepSeek,还在继续搅动大模型行业。继用R1模型炸场之后,1月28日凌晨,除夕夜前一晚,DeepSeek又开源了其多模态模型Janus-Pro-7B,宣布在GenEval和DPG-Bench基准测试中击败了DALL-E 3(来自 OpenAI)和Stable Diffusion。

DeeSeek R1横空出世撼动了整个硅谷,这波AI恐惧仍在蔓延扩散。奥特曼、OpenAI首席研究官不得不发文承认DeeSeek的技术突破,预告未来会加快新模型的发布。与此同时,研究人员们也纷纷展开了对DeepSeek技术的深入分析。

世界首个不用编码AI工程师Heyboss横空出世!一句话创建超级应用,99%人也能当程序员。最近,初创Heyboss AI官宣了AI非编码工具Heyboss,专为代码小白量身打造。

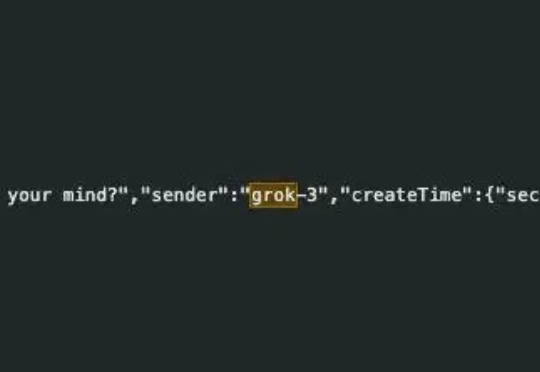

科技媒体 testingcatalog 今天(1 月 27 日)发布博文,报道称 xAI 官方虽然尚未公布,但 Grok-3 已短暂现身独立平台和 X 平台,开启内部测试,有望下周正式发布。

实际上 Operator 只是最近一段时间,全球大模型公司智能体集中发布浪潮的一部分。早于 Operator 发布前两天,字节跳动豆包大模型团队就已经公布了同类型智能体:UI-TARS。

在刚刚成立的一年多时间里,DeepSeek一直不声不响,V2模型的发布成为其破圈的关键。由于模型结构层面的突破性创新,使得其将模型成本大大降低,也被业内戏称为AI届拼多多。这之后,DeepSeek也真正引发了硅谷的恐慌,OpenAI正迎来一个最强劲的对手。

在达沃斯世界经济论坛上,OpenAI 首席财务官 Sarah Friar 抛出了这颗重磅炸弹,“它们会像真正的同事一样思考问题,遇到困难会后退一步思考,尝试新的解决方案。这不再是科幻,而是即将在 2025 年实现的现实。”

就在本周,Kimi 的新模型打开了强化学习 Scaling 新范式,DeepSeek R1 用开源的方式「接班了 OpenAI」,谷歌则把 Gemini 2.0 Flash Thinking 的上下文长度延伸到了 1M。1 月 24 日上午,百川智能重磅发布了国内首个全场景深度思考模型,把这一轮军备竞赛推向了高潮。